DeepSeek-R1: Incentivizing Reasoning Capability in LLMs via Reinforcement Learning

요즘 hot🔥 한 deepsick 논문

open ai에 비해 1/30 비용 절감을 해서 많은 관심을 끌었다

초반엔 가입자 수가 너무 많아서 회원 가입이 안되더라구요..😅

강화 학습을 통해 대규모 언어 모델의 추론 능력을 향상하는 방향으로 접근

1. Introduction

LLM이 발전 하면서 AGI(Artificial General Intelligence)에 접근 가능을 시사함

기존에는 후처리 방식의 SFT로 LLM의 추론 능력을 높여왔음

이번 연구에서는 강화학습(RL)만 사용해 LLM이 스스로 추론 능력을 발전시킬 수 있음을 보여줍니다.

LLM 발전 배경 및 후처리의 중요성

효과적인 테스트 타임 스케일링(test-time scaling)은 아직 연구 요함

순수 강화학습(RL)을 통한 추론 능력 향상

본 논문에서는 Supervised Fine-Tuning 없이, model에 GRPO라는 RL 프레임워크를 적용

모델의 문제점 및 개선

가독성 문제와 언어 혼합 문제

소량의 고품질 cold-start 데이터를 활용

1.1 Contributions

Post-Training: 순수 강화학습 기반 추론 모델 개발

Supervised Fine-Tuning 없이, RL만을 이용하여 자발적으로 발전시킴

두 단계의 RL과 두 단계의 SFT를 결합한 Pipeline을 통해 DeepSeek-R1을 구축

Distillation: 대형 모델의 추론 패턴을 소형 모델로 이전

작은 모델에서도 뛰어난 추론 성능을 구현할 수 있음을 보임

1.2 Summary of Evaluation Results

Reasoning tasks

AIME 2024와 MATH-500과 같은 수학 및 추론 벤치마크에서 DeepSeek-R1은 높은 Pass@1 점수를 기록

knowledge

MMLU, MMLU-Pro, GPQA Diamond 등의 교육 및 지식 벤치마크에서 DeepSeek-R1은 DeepSeek-V3보다 월등한 성과

others

창의적 글쓰기, 일반 질문 응답, 편집, 요약 등 다양한 언어 생성 작업에서도 높은 성능

AlpacaEval 2.0과 ArenaHard 같은 평가에서는 각각 87.6%와 92.3%의 win-rate를 기록

긴 문맥을 요구하는 작업에서도 DeepSeek-R1은 DeepSeek-V3를 크게 능가하는 결과

2. Approach

기존의 감독 학습(SFT)에 의존하는 방식과 달리, 순수 강화학습(RL)을 활용하여 LLM의 추론 능력을 향상시키는 방법

2.1 Overview

기존 연구들은 대량의 감독 데이터를 활용해 모델 성능을 높임

하지만, RL만으로도 모델이 스스로 복잡한 추론 과정을 발전시킬 수 있음을 보여줌

2.2 Deepsick-R1-Zero: Reinforcement Learning on the Base Model

2.2.1. Reinforcement Learning Algorithm

전통적인 critic 네트워크 대신, 질문마다 여러 응답 그룹을 샘플링

그룹 내 평균 보상을 기준으로 정책을 업데이트

클리핑 및 KL 페널티를 통해 안정적인 학습을 유도합니다.

2.2.2. Reward Modeling

정확도 보상

문제의 정답 여부를 평가

형식 보상

체인 오브 씽크(CoT)가 정해진 태그 <think> 와 </think> 안에 위치하도록 유도

2.2.3 Training Template

모델이 추론 과정을 기록 후 최종 답변을 제공

특정 문제 해결 전략에 치우치지 않고, 자연스러운 추론 과정의 발전을 관찰

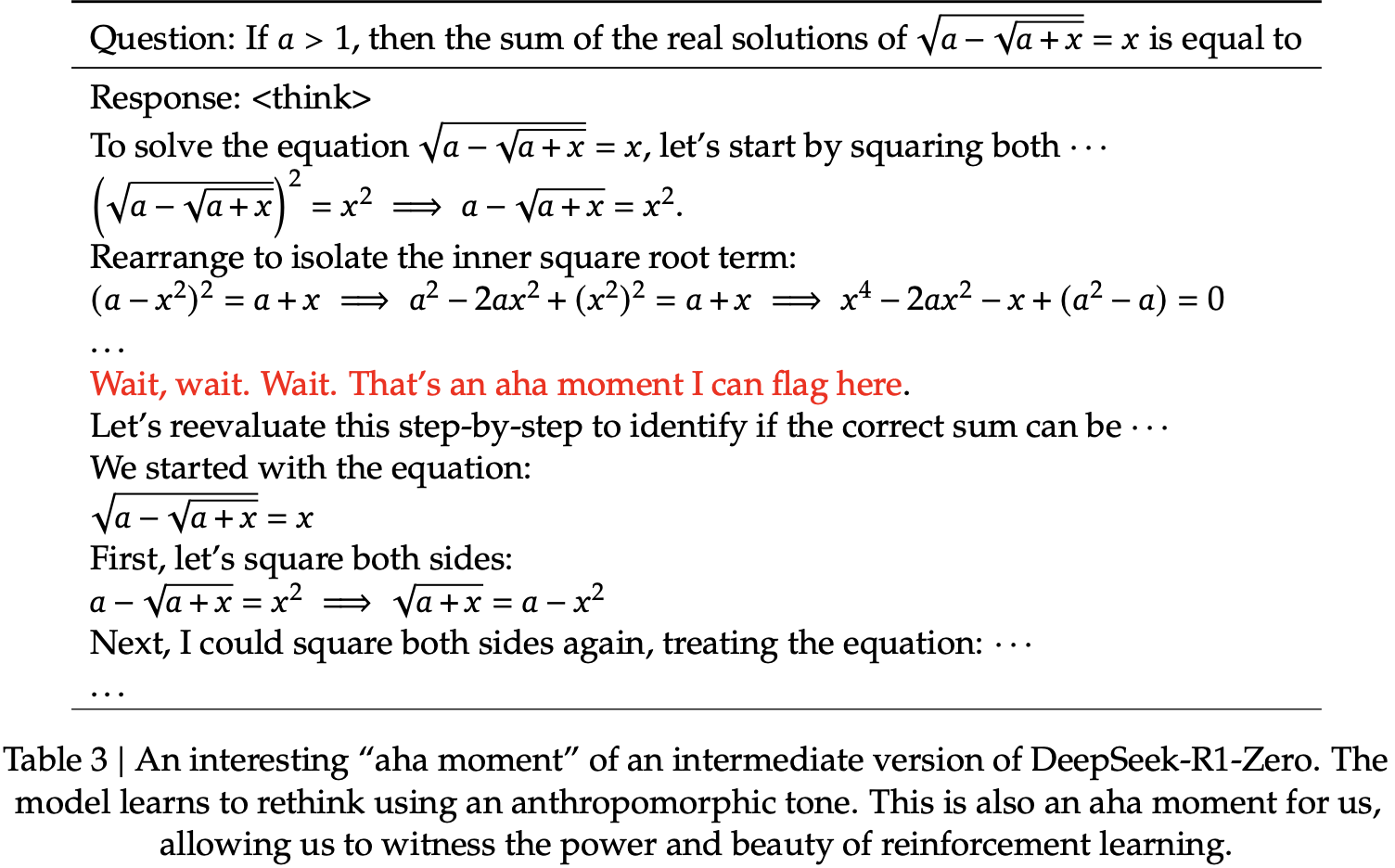

2.2.4 Performance, Self-evolution Process and Aha Moment of DeepSeek-R1-Zero

RL 학습 과정에서 모델은 AIME 2024 벤치마크의 pass@1 점수를 15.6%에서 71.0%까지 크게 향상

aha moment of deepseek-r1-zero

DeepSeek-R1-Zero의 aha moment는 모델이 학습 도중에 스스로 사고 과정을 재구성, 개선

2.3 DeepSeek-R1: Reinforcement Learning with Cold Start

2.3.1. Cold Start

모델을 미세 조정하기 위해 소량의 긴 CoT 데이터를 수집

2.3.2. Reasoning-oriented Reinforcement Learning

모델의 추론 능력을 향상시키기 위해 대규모 RL 훈련을 적용

2.3.3. Rejection Sampling and Supervised Fine-Tuning

RL이 수렴한 후, SFT 데이터를 수집하여 모델의 일반적인 작업 능력을 향상