Introduction

과대적합과 과소적합 그리고 해결하기위한 방법에 대해서 알아보자.

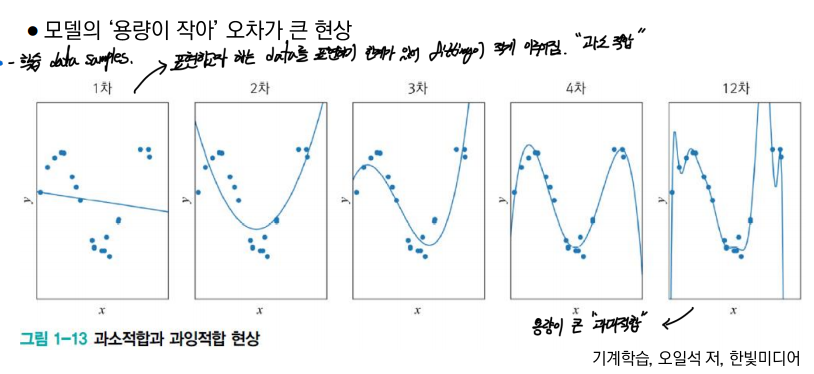

과소 적합이란?

모델의 용량이 작아서 오차가 커지는 현상을 말한다.

표현하고자 하는 data를 표현하는데 있어서 fitting이 적게 이루어 진 경우 이러한 현상이 나타난다.

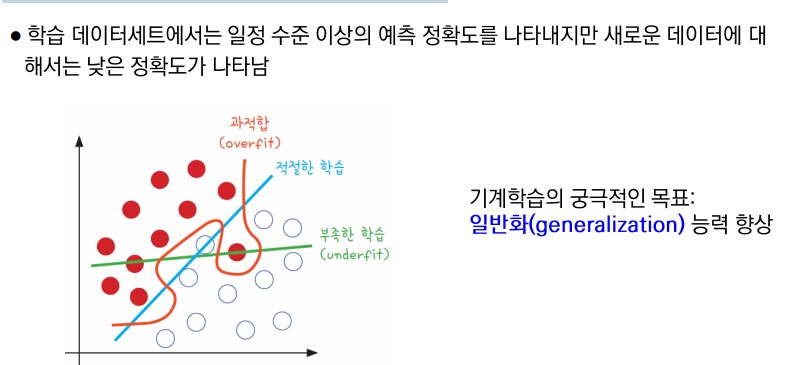

과대 적합이란?

모델이 너무나 학습 데이터 세트에 맞춰 진것을 의미한다.

즉, 사소한 노이즈 조차도 모델에 학습된 것을 뜻한다. 과도하게 적합된 데이터 세트로 test data set에 대해서는 크게 나타나게 된다.

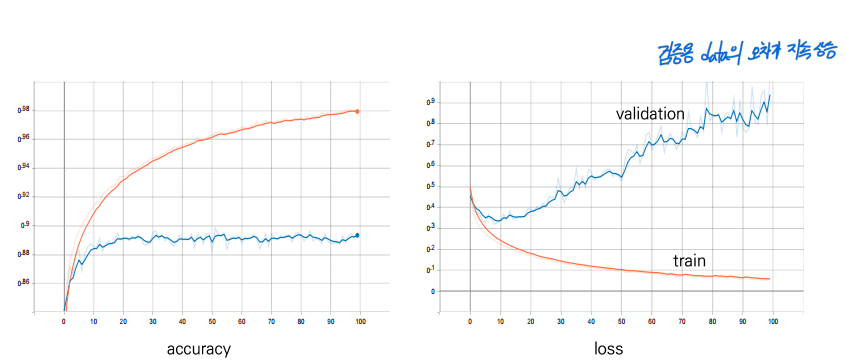

과대적합상태의 정확도와 loss 분석

학습을 진행함에 있어 train data에 대해서는 오차가 감소하나

validation data에 대해서는 오히려 오차가 증가하는 것을 확인할 수 있다.

과대와 과소의 예시

3차 함수정도가 적당하게 학습된 것으로 보인다.

0차와 1차는 과소적합, 9차는 과대적합이 이루어 진 것이다.

bias와 variance

바이어스와 분산

- bias는 편향을 뜻한다. 정답과의 얼마나 떨어져 있는가를 의하는 것이다.

- variance은 분산으로 데이터가 얼마나 퍼져있는가를 의미한다.

결과적으로 과녁 🎯의 중앙(정답)에 가까워지기 위해서는 두 값이 모두 낮아야한다.

하지만 이들은 trade-off관계로 적정 선을 찾는 것이 중요하다.

데이터 세트의 유형

학습데이터, 학습시에 사용하는 검증데이터, 학습이 끝난 후 테스트를 위한 테스트 데이터로 나뉜다.

from sklearn.model_selection import train_test_split

X_train, X_test, Y_train, Y_test = train_test_split(X,

Y, test_size=0.3, random_state=seed)k-fold cross validation

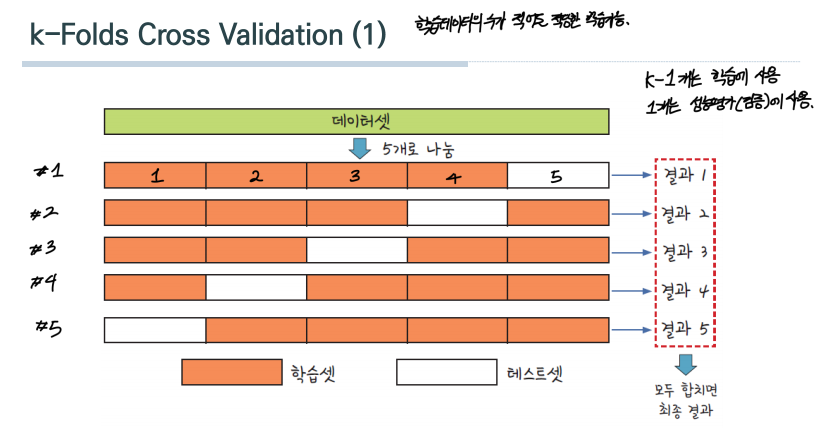

학습에 사용되는 데이터의 수가 적어도 적당하게 학습이 가능하도록 할 수 있다!

데이터의 증강과는 다른 방식으로 데이터의 수가 적어도 학습이 가능하게 하는 방법이다.

1. 데이터셋을 k개로 나눠 k번 검증하는 것인데, 이때 데이터 셋은 k-1개의 학습데이터와 1개의 test데이터로 분리한다.

2. 이때 StratifiedKfold방식을 사용하여 분류에 사용되는 데이터의 클래스의 종류가 하나로 편향되지 않도록 각 분리된 데이터에 들어가게 된다.

3. 이렇게 k개로 나눠진 데이터셋들은 총 k번을 번갈아가며 test데이터 셋의 역할을 수행한다.

4. 결과적으로 총 k번의 학습이 이루어지고 Loss와 Accuracy또한 k개가 나오게 되고,

이후 오차의 평균을 통해 최적의 모델을 선정할 수 있다.

from sklearn.model_selection import StratifiedKFold

skf = StratifiedKFold(n_splits=n_fold, shuffle=True,

random_state=seed)

model = Sequential()

model.add(Dense(24, input_dim=60, activation='relu'))

model.add(Dense(10, activation='relu'))

model.add(Dense(1, activation='sigmoid’))

model.compile(loss='mean_squared_error',

optimizer='adam',

metrics=['accuracy’])

for train, test in skf.split(X, Y):

model.fit(X[train], Y[train], epochs=100, batch_size=5)✨과적합을 피하는 방법

매우매우 중요하다!

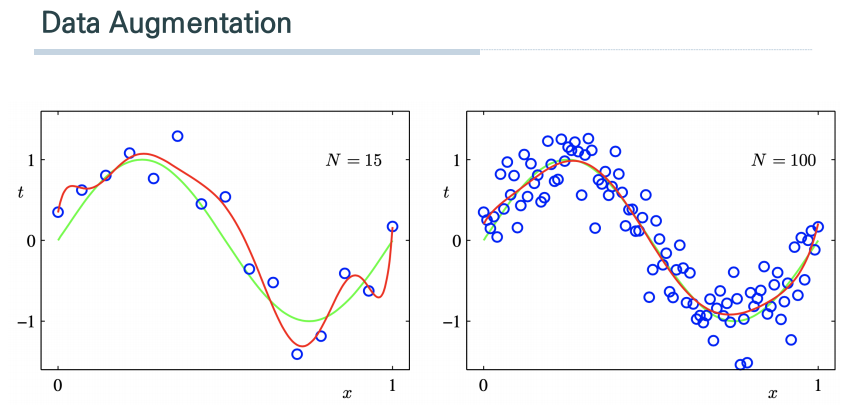

1. 데이터 증식

학습되는 데이터 세트가 적으면 하나하나의 데이터가 모델의 입장에서는 소중하다.

따라서 해당 몇몇 데이터만을 보고 학습하는 모델은 해당 데이터들에게 편향된 모델이 될 수 밖에 없고, 이는 과적합의 문제가 발생한다. 따라서 이를 막기위해 데이터를 증강 시키는 것이다. 데이터 증강에 대해서 자세한 내용은 다음 part 19에서 다룬다.

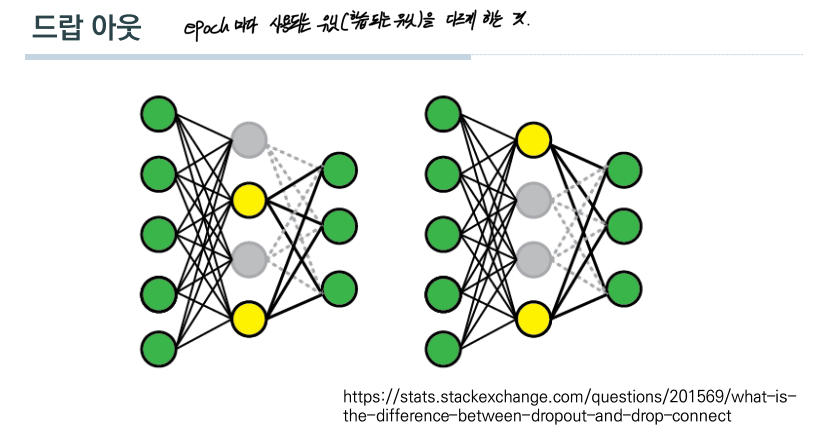

2. Dropout

epoch마다 0~1사이의 확률로 뉴런이 꺼지는 것을 의미한다.

즉, 꺼지게 된 해당 뉴런은 학습이 일어나지 않도록 하는 것이다. 이렇게 하는 이유는 특정 feature에 대해서 과도하게 학습되는 것을 막는 것이다.

예를 들어 배, 바나나, 사과를 분류하는 문제에서 최종 Classfication을 내리는데 있어서 "크기" 정보가 큰 상관 관계에 있다고 가정하자.

그렇다면 학습시에 "크기"정보에 대해서 큰 가중치가 설정되고, "크기"정보를 제외한 나머지 Feature들은 제대로 학습이 어렵다. 따라서 "크기"정보를 dropout하고 학습을 시킨다면 "크기"정보가 아닌 나머지 "무게", "이심률"또한 종합적으로 사용되는 것이다.

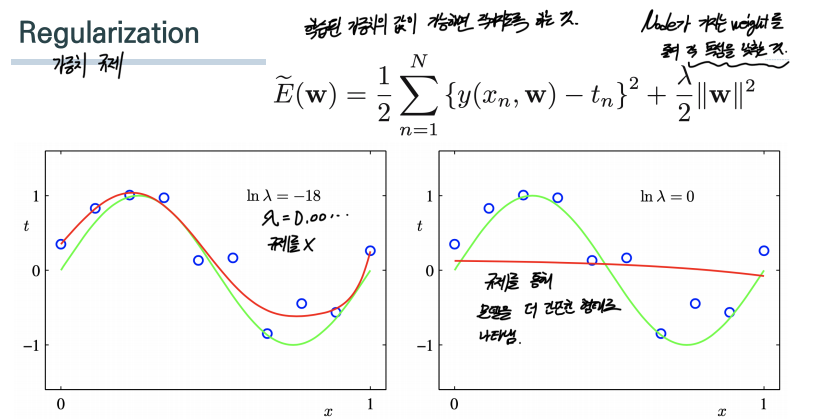

3. 가중치 규제(Weight Regularzation)

각 feature의 가중치가 가지는 특성을 규제시킴으로써 특정 데이터들에 대해서만 적합하도록 하는 것이 아닌, 모델의 일반화 능력을 향상시키는 것이다.

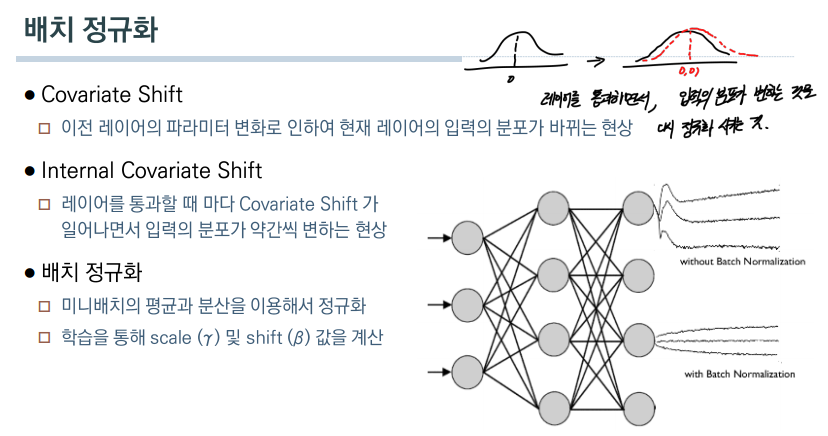

4. 배치 정규화(Batch Normalization)

hidden Layer에서 이전 레이어의 파라미터의 변화로 입력의 분포가 변화하면서 입력의 분포가 달라지게 된다. 따라서 이러한 입력의 분포가 달라졌을 때 출력값을 정규화 하는 층을 추가하여 배치를 정규화 해주는 과정을 시행한다. 배치 정규화를 통해 큰 lr를 지정할 수 있을뿐더러, 학습하는 과정 자체를 전체적으로 안정화시켜 과적합의 문제를 해결한다.

- Covariate Shift : 이전 레이어의 파라미터 변화로 인하여 현재 레이어의 입력의 분포가 바뀌는 현상

- Internal Covariate Shift : 레이어를 통과할 때 마다 Covariate Shift 가 일어나면서 입력의 분포가 약간씩 변하는 현상

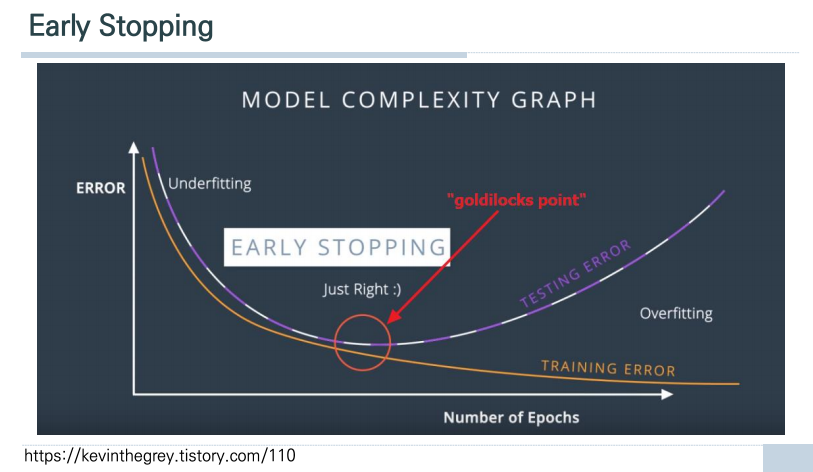

5. 조기 학습 중단 (Early Stopping)

모델이 결국 overfitting이 발생하는 이유가 무엇일까?

바로 학습이 계속 진행된다는 근본적인 문제를 해결하는 것이다.

Vaildata의 Loss가 최소가 되는 지점까지만 학습을 진행하고 Loss가 증가하는 순간 조기에 학습을 중단시켜, 과적합이 발생하지 않도록 하는 방법이다.