딥러닝 학습 Week 5

강의 전, 사전 지식 학습

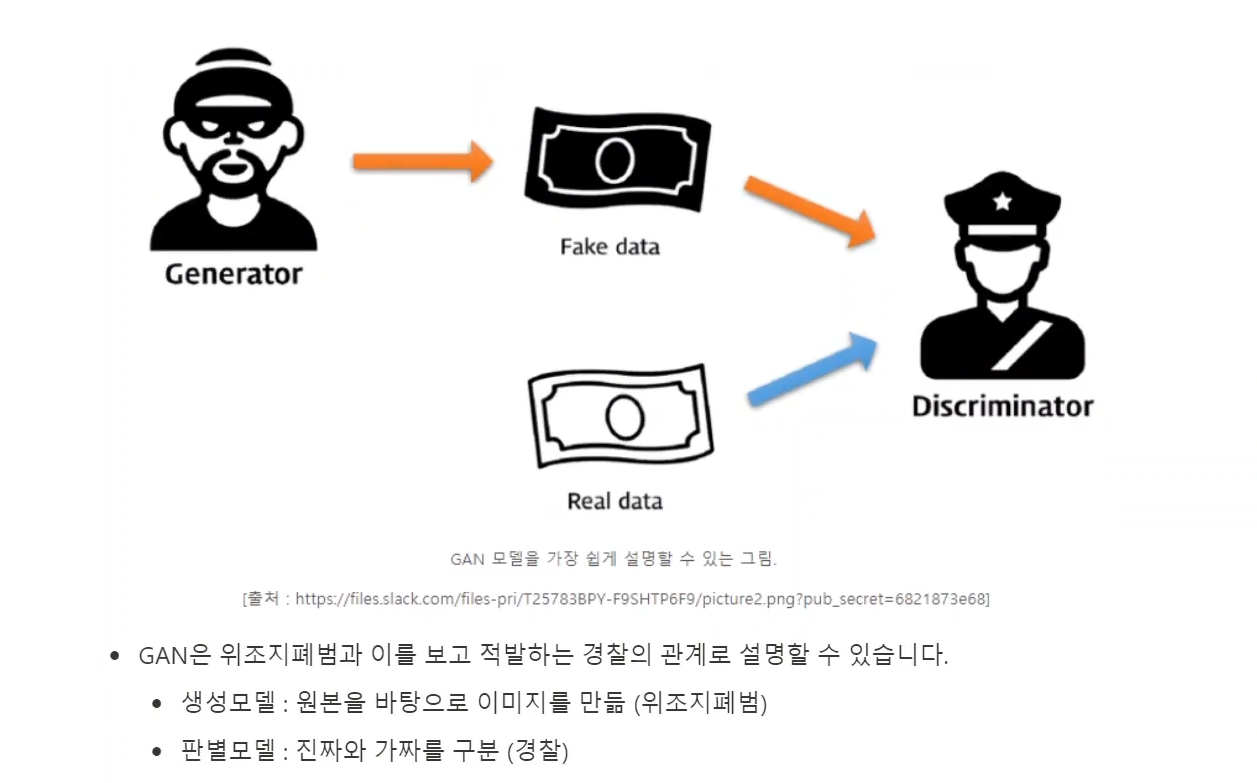

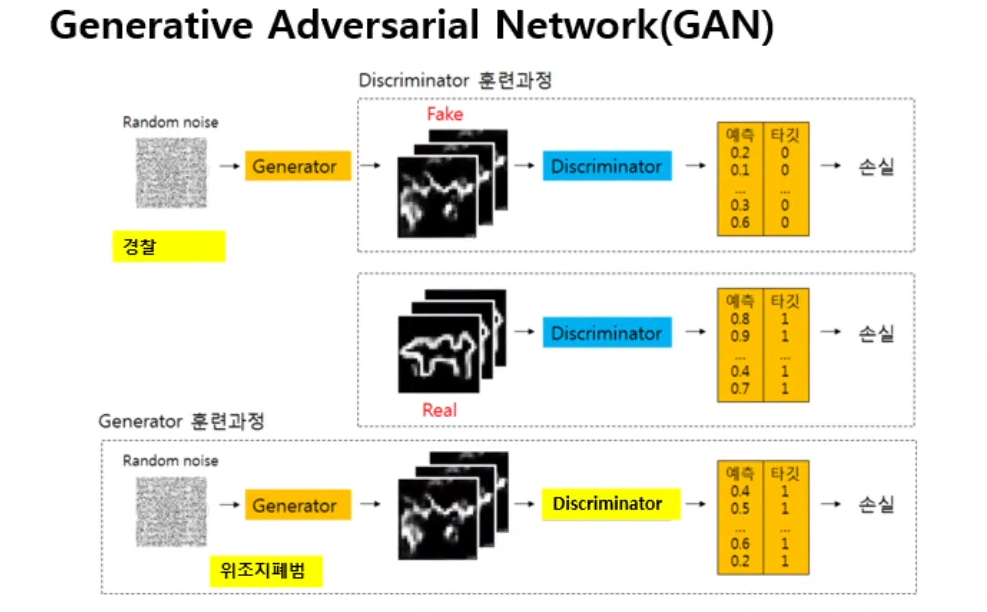

- GAN 모델 자세히 알아보기

Generative Adversarial Network(GAN)

- GAN이 어떻게 학습하는지 알아보기

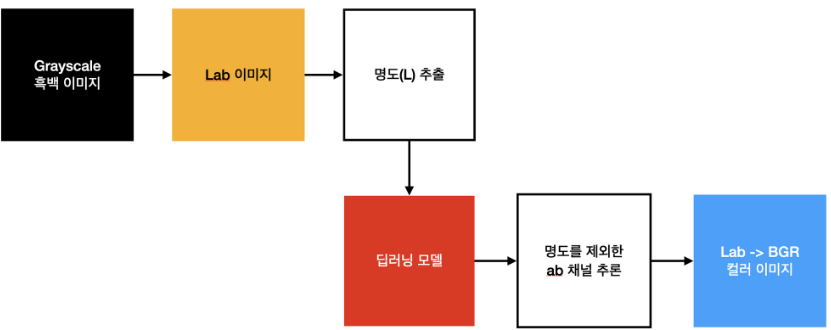

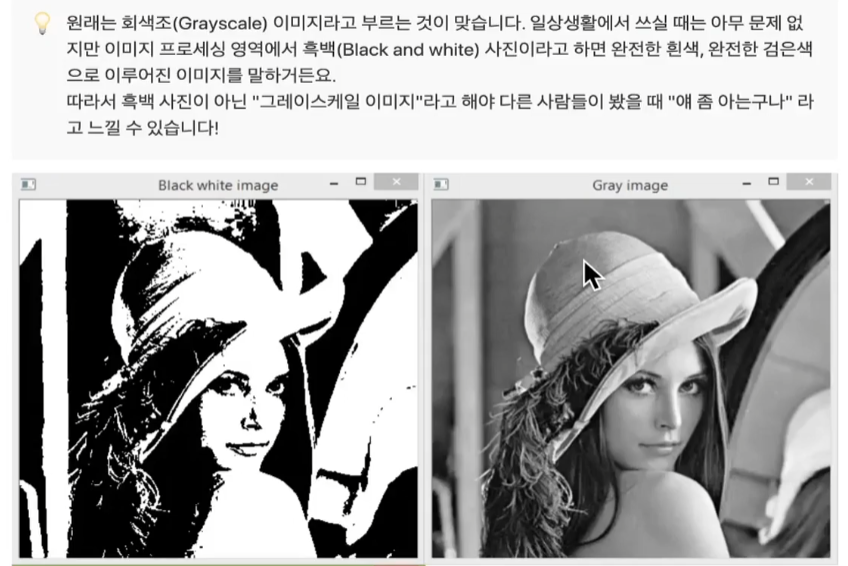

흑백사진을 컬러 사진으로 변경

- 흑백 사진 Gray Scale

- LAB 컬러 시스템

이미지를 Lab 컬러로 변경한 후 L 채널을 입력으로 받아 ab 채널을 예측

import cv2

import numpy as np

# 모델 로드######################################################################################

proto = 'models/colorization_deploy_v2.prototxt'

weights = 'models/colorization_release_v2.caffemodel'

# readNetFromCaffe 딥러닝 모델 프레임 워크

net = cv2.dnn.readNetFromCaffe(proto, weights)

pts_in_hull = np.load('models/pts_in_hull.npy')

pts_in_hull = pts_in_hull.transpose().reshape(2, 313, 1, 1).astype(np.float32)

net.getLayer(net.getLayerId('class8_ab')).blobs = [pts_in_hull]

net.getLayer(net.getLayerId('conv8_313_rh')).blobs = [np.full((1, 313), 2.606, np.float32)]

######################################################################################################

# 전처리######################################################################################

# 이미지 로드

img = cv2.imread('imgs/02.jpg')

# 높이 넓이 체널 입력

h, w, c = img.shape

# 이미지 값 복사

img_input = img.copy()

# 이미지 전처리

# 딥러닝 모델은 보통 소수점 형태로 학습시킨다.

# 정수형인 img 값을 실수형으로 변환

img_input = img_input.astype('float32') / 255.

# 컬러 시스템을 LAB 시스템으로 변경

img_lab = cv2.cvtColor(img_input, cv2.COLOR_BGR2Lab)

# L체널 추출

img_l = img_lab[:, :, 0:1]

blob = cv2.dnn.blobFromImage(img_l, size=(224, 224), mean=[50, 50, 50])

######################################################################################################

# 결과 추론

net.setInput(blob)

output = net.forward()

# 후처리

# squeeze : 차원 축소

# transpose : 차원 변형

output = output.squeeze().transpose((1, 2, 0))

# 이미지 크기 변형

# 미리 저장해둔 원본 이미지 사이즈로 변형

output_resized = cv2.resize(output, (w, h))

# concatenate 이미지 L 체널과 OUTPUT의 a,b 체널 합치기

# axis=2 : 체널 방향

output_lab = np.concatenate([img_l, output_resized], axis=2)

# lab 컬러 시스템을 BGR로 변경

output_bgr = cv2.cvtColor(output_lab, cv2.COLOR_Lab2BGR)

output_bgr = output_bgr * 255

# 255값이 넘어간 값을 자라낸다.

output_bgr = np.clip(output_bgr, 0, 255)

# OUPUT을 정수형으로 변환

output_bgr = output_bgr.astype('uint8')

######################################################################################################

cv2.imshow('img', img_input)

cv2.imshow('result', output_bgr)

cv2.waitKey(0)

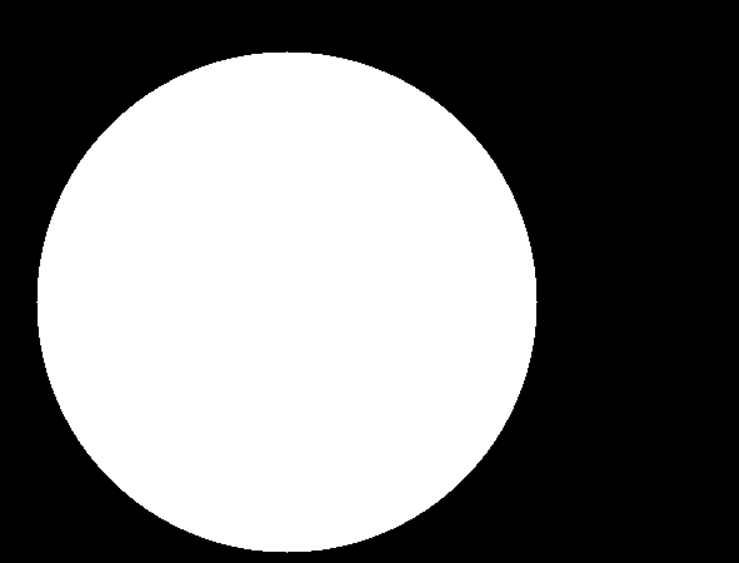

- 특정 부분만 컬러로 변경하기

마스킹 작업

# 마스크 만들기

# 이미지와 같은 형태로 bgr을 모두 0으로 채운다.

mask = np.zeros_like(img, dtype='uint8')

mask = cv2.circle(mask, center=(260, 260), radius=200, color=(1, 1, 1), thickness=-1)

# 마스크 부위를 컬러로 채운다.

color = output_bgr * mask

# 이미지 반전

gray = img * (1 - mask)

output2 = color + gray

cv2.imshow('result2', output2)해상도 향상

- 패키지 설치

pip install opencv-contrib-python

윈도우의 경우 pip install --user opencv-contrib-python을 입력해주세요import cv2

# SuperResImpl : 초 해상도

sr = cv2.dnn_superres.DnnSuperResImpl_create()

# 해상도를 3배 늘린다.

sr.readModel('models/EDSR_x3.pb')

sr.setModel('edsr', 3)

img = cv2.imread('imgs/06.jpg')

# upsample : 이미지 확장한 결과를 result에 저장

result = sr.upsample(img)

# x,y 방향으로 3배씩 리사이즈

resized_img = cv2.resize(img, dsize=None, fx=3, fy=3)

cv2.imshow('img', img)

cv2.imshow('resized_img', resized_img)

cv2.imshow('result', result)

cv2.waitKey(0)숙제

-

다른 그레이 스케일 이미지로 시도

https://www.pexels.com/ko-kr/search/grayscale/ -

그레이 스케일 영상 시도

https://www.pexels.com/ko-kr/search/videos/grayscale/ -

직사각형 부분 마스크 씌우기

-

컬러 복원 + 화질 , 해상도 향상

숙제 풀이

- 다른 그레이 스케일 이미지 컬러로 변경

import cv2

import numpy as np

# 모델 로드######################################################################################

proto = 'models/colorization_deploy_v2.prototxt'

weights = 'models/colorization_release_v2.caffemodel'

# readNetFromCaffe 딥러닝 모델 프레임 워크

net = cv2.dnn.readNetFromCaffe(proto, weights)

pts_in_hull = np.load('models/pts_in_hull.npy')

pts_in_hull = pts_in_hull.transpose().reshape(2, 313, 1, 1).astype(np.float32)

net.getLayer(net.getLayerId('class8_ab')).blobs = [pts_in_hull]

net.getLayer(net.getLayerId('conv8_313_rh')).blobs = [np.full((1, 313), 2.606, np.float32)]

######################################################################################################

# 전처리######################################################################################

# 이미지 로드

img = cv2.imread('imgs/08.jpg')

h, w, c = img.shape

# 사이즈가 너무 커서 재조정

img = cv2.resize(img, (w//3, h//3))

h, w, c = img.shape

cv2.imshow('img', img)

# 높이 넓이 체널 입력

h, w, c = img.shape

# 이미지 값 복사

img_input = img.copy()

# 이미지 전처리

# 딥러닝 모델은 보통 소수점 형태로 학습시킨다.

# 정수형인 img 값을 실수형으로 변환

img_input = img_input.astype('float32') / 255.

# 컬러 시스템을 LAB 시스템으로 변경

img_lab = cv2.cvtColor(img_input, cv2.COLOR_BGR2Lab)

# L체널 추출

img_l = img_lab[:, :, 0:1]

blob = cv2.dnn.blobFromImage(img_l, size=(224, 224), mean=[50, 50, 50])

######################################################################################################

# 결과 추론

net.setInput(blob)

output = net.forward()

# 후처리

# squeeze : 차원 축소

# transpose : 차원 변형

output = output.squeeze().transpose((1, 2, 0))

# 이미지 크기 변형

# 미리 저장해둔 원본 이미지 사이즈로 변형

output_resized = cv2.resize(output, (w, h))

# concatenate 이미지 L 체널과 OUTPUT의 a,b 체널 합치기

# axis=2 : 체널 방향

output_lab = np.concatenate([img_l, output_resized], axis=2)

# lab 컬러 시스템을 BGR로 변경

output_bgr = cv2.cvtColor(output_lab, cv2.COLOR_Lab2BGR)

output_bgr = output_bgr * 255

# 255값이 넘어간 값을 자라낸다.

output_bgr = np.clip(output_bgr, 0, 255)

# OUPUT을 정수형으로 변환

output_bgr = output_bgr.astype('uint8')

cv2.imshow('img', img)

cv2.imshow('result', output_bgr)

cv2.waitKey(0)- 그레이 스케일 영상 시도

import cv2

import numpy as np

# 모델 로드######################################################################################

proto = 'models/colorization_deploy_v2.prototxt'

weights = 'models/colorization_release_v2.caffemodel'

# readNetFromCaffe 딥러닝 모델 프레임 워크

net = cv2.dnn.readNetFromCaffe(proto, weights)

pts_in_hull = np.load('models/pts_in_hull.npy')

pts_in_hull = pts_in_hull.transpose().reshape(2, 313, 1, 1).astype(np.float32)

net.getLayer(net.getLayerId('class8_ab')).blobs = [pts_in_hull]

net.getLayer(net.getLayerId('conv8_313_rh')).blobs = [np.full((1, 313), 2.606, np.float32)]

######################################################################################################

cap = cv2.VideoCapture('videos/01.mp4')

while True:

ret, img = cap.read()

if ret == False:

break

# 전처리######################################################################################

# 이미지 로드

# 높이 넓이 체널 입력

h, w, c = img.shape

# 사이즈 조정

img = cv2.resize(img, (w//5, h//5))

h, w, c = img.shape

# 이미지 값 복사

img_input = img.copy()

# 이미지 전처리

# 딥러닝 모델은 보통 소수점 형태로 학습시킨다.

# 정수형인 img 값을 실수형으로 변환

img_input = img_input.astype('float32') / 255.

# 컬러 시스템을 LAB 시스템으로 변경

img_lab = cv2.cvtColor(img_input, cv2.COLOR_BGR2Lab)

# L체널 추출

img_l = img_lab[:, :, 0:1]

blob = cv2.dnn.blobFromImage(img_l, size=(224, 224), mean=[50, 50, 50])

######################################################################################################

# 결과 추론

net.setInput(blob)

output = net.forward()

# 후처리

# squeeze : 차원 축소

# transpose : 차원 변형

output = output.squeeze().transpose((1, 2, 0))

# 이미지 크기 변형

# 미리 저장해둔 원본 이미지 사이즈로 변형

output_resized = cv2.resize(output, (w, h))

# concatenate 이미지 L 체널과 OUTPUT의 a,b 체널 합치기

# axis=2 : 체널 방향

output_lab = np.concatenate([img_l, output_resized], axis=2)

# lab 컬러 시스템을 BGR로 변경

output_bgr = cv2.cvtColor(output_lab, cv2.COLOR_Lab2BGR)

output_bgr = output_bgr * 255

# 255값이 넘어간 값을 자라낸다.

output_bgr = np.clip(output_bgr, 0, 255)

# OUPUT을 정수형으로 변환

output_bgr = output_bgr.astype('uint8')

cv2.imshow('result', output_bgr)

if cv2.waitKey(30) == ord('q'):

break- 직사각형 부분 마스크 씌우기

import cv2

import numpy as np

# 모델 로드######################################################################################

proto = 'models/colorization_deploy_v2.prototxt'

weights = 'models/colorization_release_v2.caffemodel'

# readNetFromCaffe 딥러닝 모델 프레임 워크

net = cv2.dnn.readNetFromCaffe(proto, weights)

pts_in_hull = np.load('models/pts_in_hull.npy')

pts_in_hull = pts_in_hull.transpose().reshape(2, 313, 1, 1).astype(np.float32)

net.getLayer(net.getLayerId('class8_ab')).blobs = [pts_in_hull]

net.getLayer(net.getLayerId('conv8_313_rh')).blobs = [np.full((1, 313), 2.606, np.float32)]

######################################################################################################

# 전처리######################################################################################

# 이미지 로드

img = cv2.imread('imgs/05.jpg')

# 높이 넓이 체널 입력

h, w, c = img.shape

# 이미지 값 복사

img_input = img.copy()

# 이미지 전처리

# 딥러닝 모델은 보통 소수점 형태로 학습시킨다.

# 정수형인 img 값을 실수형으로 변환

img_input = img_input.astype('float32') / 255.

# 컬러 시스템을 LAB 시스템으로 변경

img_lab = cv2.cvtColor(img_input, cv2.COLOR_BGR2Lab)

# L체널 추출

img_l = img_lab[:, :, 0:1]

blob = cv2.dnn.blobFromImage(img_l, size=(224, 224), mean=[50, 50, 50])

######################################################################################################

# 결과 추론

net.setInput(blob)

output = net.forward()

# 후처리

# squeeze : 차원 축소

# transpose : 차원 변형

output = output.squeeze().transpose((1, 2, 0))

# 이미지 크기 변형

# 미리 저장해둔 원본 이미지 사이즈로 변형

output_resized = cv2.resize(output, (w, h))

# concatenate 이미지 L 체널과 OUTPUT의 a,b 체널 합치기

# axis=2 : 체널 방향

output_lab = np.concatenate([img_l, output_resized], axis=2)

# lab 컬러 시스템을 BGR로 변경

output_bgr = cv2.cvtColor(output_lab, cv2.COLOR_Lab2BGR)

output_bgr = output_bgr * 255

# 255값이 넘어간 값을 자라낸다.

output_bgr = np.clip(output_bgr, 0, 255)

# OUPUT을 정수형으로 변환

output_bgr = output_bgr.astype('uint8')

######################################################################################################

# 마스크 만들기

# 이미지와 같은 형태로 bgr을 모두 0으로 채운다.

mask = np.zeros_like(img, dtype='uint8')

# mask = cv2.circle(mask, center=(260, 260), radius=200, color=(1, 1, 1), thickness=-1)

mask = cv2.rectangle(mask, pt1=(400, 360), pt2=(220, 100), color=(1, 1, 1), thickness=-1)

# 마스크 부위를 컬러로 채운다.

color = output_bgr * mask

# 이미지 반전

gray = img * (1 - mask)

output2 = color + gray

cv2.imshow('result', output2)

cv2.waitKey(0)- 컬러 복원 + 화질 , 해상도 향상

import cv2

import numpy as np

proto = 'models/colorization_deploy_v2.prototxt'

weights = 'models/colorization_release_v2.caffemodel'

# readNetFromCaffe 딥러닝 모델 프레임 워크

net = cv2.dnn.readNetFromCaffe(proto, weights)

pts_in_hull = np.load('models/pts_in_hull.npy')

pts_in_hull = pts_in_hull.transpose().reshape(2, 313, 1, 1).astype(np.float32)

net.getLayer(net.getLayerId('class8_ab')).blobs = [pts_in_hull]

net.getLayer(net.getLayerId('conv8_313_rh')).blobs = [np.full((1, 313), 2.606, np.float32)]

# SuperResImpl : 초 해상도

sr = cv2.dnn_superres.DnnSuperResImpl_create()

# 해상도를 4배 늘린다.

sr.readModel('models/EDSR_x3.pb')

sr.setModel('edsr', 4)

img = cv2.imread('imgs/07.jpg')

h, w, c = img.shape

# 사이즈 조정

img = cv2.resize(img, (w//4, h//4))

# 해상도 늘리고 사이즈 재조정

result = sr.upsample(img)

result = cv2.resize(result, (w, h))

# 높이 넓이 체널 입력

h, w, c = result.shape

# 이미지 값 복사

img_input = result.copy()

# 이미지 전처리

# 딥러닝 모델은 보통 소수점 형태로 학습시킨다.

# 정수형인 img 값을 실수형으로 변환

img_input = img_input.astype('float32') / 255.

# 컬러 시스템을 LAB 시스템으로 변경

img_lab = cv2.cvtColor(img_input, cv2.COLOR_BGR2Lab)

# L체널 추출

img_l = img_lab[:, :, 0:1]

blob = cv2.dnn.blobFromImage(img_l, size=(224, 224), mean=[50, 50, 50])

######################################################################################################

# 결과 추론

net.setInput(blob)

output = net.forward()

# 후처리

# squeeze : 차원 축소

# transpose : 차원 변형

output = output.squeeze().transpose((1, 2, 0))

# 이미지 크기 변형

# 미리 저장해둔 원본 이미지 사이즈로 변형

output_resized = cv2.resize(output, (w, h))

# concatenate 이미지 L 체널과 OUTPUT의 a,b 체널 합치기

# axis=2 : 체널 방향

output_lab = np.concatenate([img_l, output_resized], axis=2)

# lab 컬러 시스템을 BGR로 변경

output_bgr = cv2.cvtColor(output_lab, cv2.COLOR_Lab2BGR)

output_bgr = output_bgr * 255

# 255값이 넘어간 값을 자라낸다.

output_bgr = np.clip(output_bgr, 0, 255)

# OUPUT을 정수형으로 변환

output_bgr = output_bgr.astype('uint8')

cv2.imshow('img', img)

cv2.imshow('result', output_bgr)

cv2.waitKey(0)