학습목표

- 이미지 데이터가 가진 특징을 이해한다.

- 각 컴퓨터 비전 태스크들의 목표와 차이점을 이해한다.

이미지 "데이터" 이해하기

-

이미지 데이터 분석

이미지 데이터를 분석한다는 의미는 3차원의 숫자 덩어리를 입력으로 받아 그 안에 숨겨진 패턴을 찾는다는 뜻이다.

-

인간의 이미지 인식 vs 컴퓨터의 이미지 인식

-

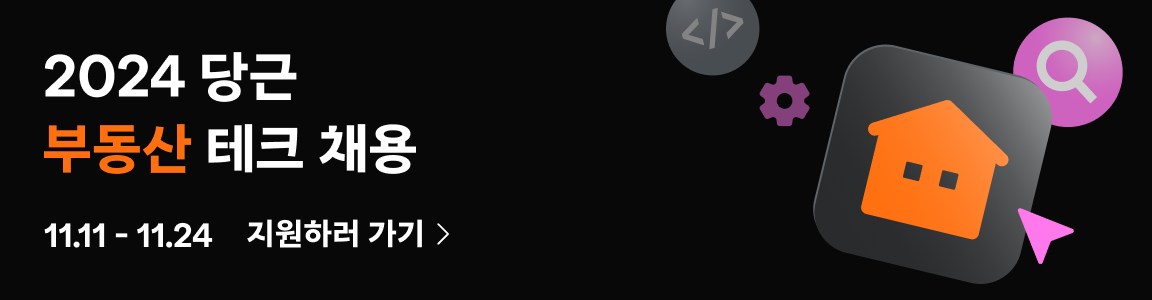

인간의 이미지 인식

인간이 이미지를 인식할 때는 반사된 빛의 일부가 눈에 입력으로 들어오면 눈의 세포를 통해 빛의 신호가 전기 신호로 변환되어 뇌로 전달된다. 그 후 뇌에서 이미지가 출력된다. -

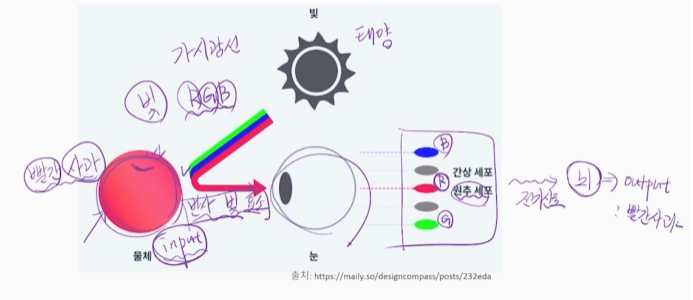

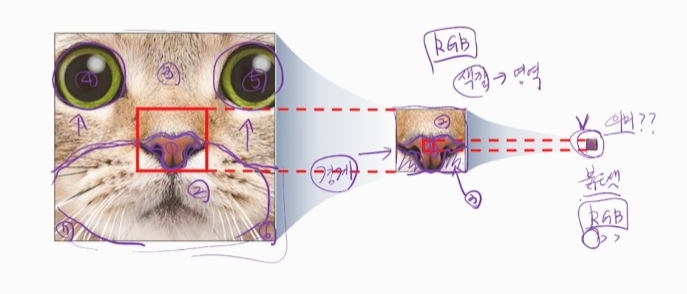

컴퓨터의 이미지 인식

컴퓨터는 고양이를 '고양이'라고 인식하지 않는다.

컴퓨터에게 고양이 이미지는 그저 RGB라는 3개의 채널을 통해서 입력된 숫자 덩어리이다(Input).

숫자가 입력으로 컴퓨터에 주어지면 컴퓨터의 연산 장치로 연산이 처리되고 결과를 출력한다.

-

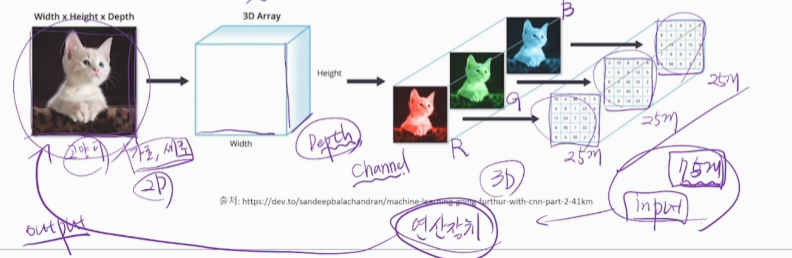

이미지 내의 정보 찾아보기

-

데이터 = 정보?

이미지 데이터의 픽셀 하나에 담긴 숫자 자체에는 아무런 정보(패턴)가 없다. 그저, 숫자일 뿐이다.

-

이미지 내의 정보

- 사람

- 사람

-

이미지 속 정보의 특징

-

컴퓨터

이미지 데이터 안의 정보는 하나의 픽셀 그 자체가 아닌 주변의 여러 개의 픽셀과의 관계를 통해서 드러낸다. (관계 = 같다/다르다 를 판별하는 것)(나무가 아니라 숲을 봐라)

-

컴퓨터 비전의 다양한 테스크

-

이미지

object : 대상, 객체

-

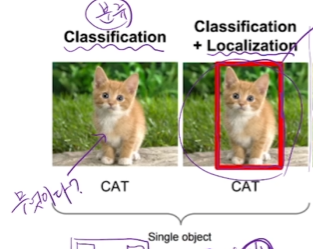

Single object(하나의 객체가 있을 때)

Classification(분류 태스크) :

대상이 무엇이냐? 즉, 1개의 객체의 class를 예측하는 태스크이다.Classification + Localization :

객체의 위치를 찾아내는 태스크로, Bounding Box(BBox)를 통해 위치를 지정한다. -

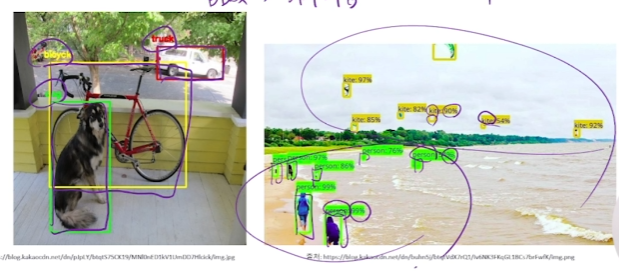

Multiple objects(여러개의 객체가 있을 때)

Object Detection :

BBox + Classification

Object Detection는 Bounding Box로 위치를 지정하고, 각 Bounding Box 안의 obejct를 classification을 하는 것

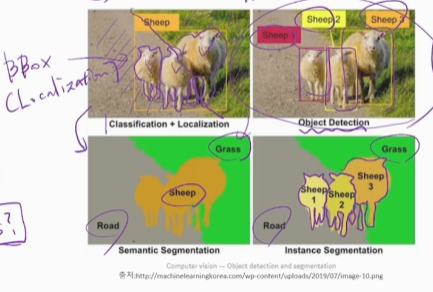

Segmentation(분할) :

픽셀 수준에서의 의미를 찾는 태스크이다. Segmentation은 이미지를 픽셀 단위로 분해하고 픽셀의 class를 분류하는 Semantic Segmentation와 픽셀이 어떤 개별 객체(=개체, Instance)로 구분되는지 분류하는 Instance Segmentation로 구분할 수 있다.

-

정리

- 이미지 데이터를 분석하는 것은 3차원의 숫자 덩어리에 숨겨진 패턴을 찾는 것이다.

- 이미지의 픽셀이 가진 의미는 주변 픽셀들과의 관계에 의해서 결정된다.

- 컴퓨터 비전 태스크에는 Classification, Object Dection, Segmentation 등이 있다.