My comment

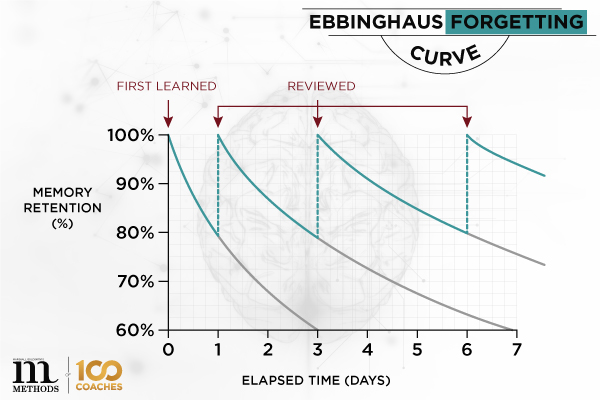

- 에빙하우스 망각 곡선 개념을 차용해 기억 갱신 메커니즘을 가져온 것 인상적임. But, 이 부분에서 더 발전시킬 수 있을 것 같다는 생각이 들었음. 인간의 기억 갱신 부분을 뇌과학 쪽에서 더 찾아봐서 이를 메커니즘화 하면 더 좋은 성능이 나오지 않을까라는 생각을 해봄

- 성능 평가 부분이 조금 아쉽다고 생각이 든다. 정성평가든 정량평가든 약간 지표 선정이나 이런 것들이 조금 부족하다고 생각함

Abstract

LLM의 뚜렷한 한계 : 장기 기억(long-term memory) 메커니즘의 결여

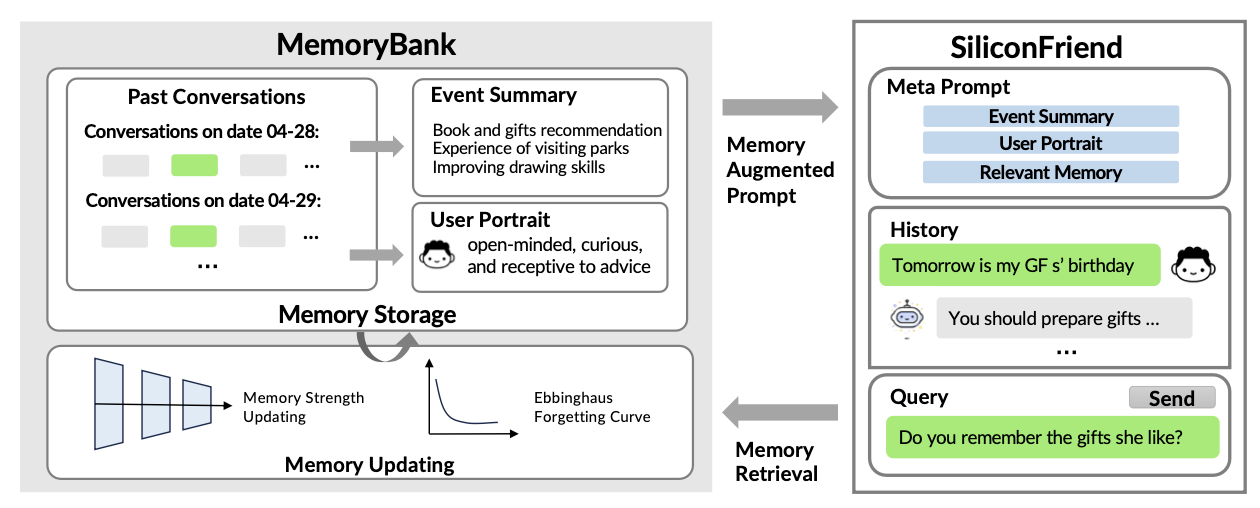

MemoryBank라는 새로운 메모리 메커니즘 제안

MemoryBank

- 모델이 관련된 기억을 불러오고, 지속적인 기억 업데이트를 통해 끊임없이 진화하며, 이전 상호작용으로부터 정보를 종합하여 사용자의 성격을 이해하고 적응

- 에빙하우스 망각 곡선에 영감을 받음 기억 갱신 메커니즘 도입 시간이 경과함에 따라 기억의 중요도를 따라 잊거나 강화하도록 함

- ChatGPT와 같은 비공개 모델 뿐 아니라 오픈소스 모델에도 유연하게 적용 가능

- 검증

- SiliconFriend라는 LLM 기반 챗봇을 통해 시연

- MemoryBank를 탑재한 SiliconFriend가 더 풍부한 공감적 반응을 제공하며 사용자 성격을 이해하는 등 강력한 장기 동반 능력을 보임

1. Introduction

LLM의 뚜렷한 한계 : 장기 기억(long-term memory) 메커니즘의 결여

더 나은 능력을 가진 AI 시스템을 개발하는 것은 매끄럽고 개인화된 상호작용을 위해 필수적

MemoryBank를 통해 과거 상호작용을 회상하고, 맥락 이해를 지속적으로 발전시키며, 과거 대화에 기반하여 사용자의 성격에 적응할 수 있도록 함 장기적 상호작용 시나리오에서의 성능 향상

- 에빙하우스 망각 곡선 이론에서 영감을 얻은 동적 기억 메커니즘(dynamic memory mechanism) 통합

- 시간이 지남에 따라 기억의 강도 감소 MemoryBank에 적용하여 시간 경과에 따라 기억을 유지, 선택적 망각, 강화할 수 있도록 설계

- 구성요소

- 기억 저장소(memory stroage) : 기억 검색(memory retrieval)과 업데이트 메커니즘(updating mechanism)으로 구성된 저장소

- 과거 사건과 사용자의 성격을 요약하는 능력

실용적 가능성을 입증하기 위해 SiliconFriend라는 LLM 기반의 챗봇 개발

SiliconFriend

- 3만 8천 개의 심리 대화 데이터로 튜닝

- 공감과 세심함을 갖추고, 감정적으로 민감한 대화에서도 유용한 조언 제공

- 사용자 개인 특성에 맞춘 응답 제공

- 영어와 중국어를 모두 지원하는 이중 언어 기능

- 세 가지 모델에 유연스럽게 적용

- 효율성 검증 : 질적 분석과 양적 분석 수행

기여점

- MemoryBank : 인간과 유사한 장기 기억 메커니즘을 제안하여, LLM이 기억을 저장∙회상∙갱신하고 사용자 프로필을 생성할 수 있게 함

- SiliconFriend : MemoryBank와 심리 대화 데이터로 튜닝된 LLM 기반 AI 동반자를 구현하여, 기억 회상∙공감적 대화∙사용자 행동 이해 능력 입증

2. MemoryBank : A Novel Memory Mechanism Tailored for LLMs

2.1 Memory Storage : The Warehouse of MemoryBank

Memory Storage(기억 저장소)는 MemoryBank의 핵심 데이터 저장소

일일 대화 기록, 과거 사건 요약, 사용자 성격의 변화된 평가 결과가 저장되어, 역동적이고 다층적인 기억 구조 형성

1) 심층적 메모리 저장 (In-Depth Memory Storage)

MemoryBank의 저장 시스템 : AI-사용자 간의 다회차 대화를 시간순으로 상세히 기록. 세밀한 기록은 정확한 기억 검색과 기억 갱신 과정에서 도움

2) 계층적 사건 요약 (Hierarchical Even Summary)

대화 내용을 요약 및 추상화하여 일일 사건 요약으로 정리 글로벌 요약으로 통합

하루의 대화나 사건을 입력으로 받아 "대화(또는 사건)의 주요 내용과 핵심 정보를 요약하라"는 프롬프트를 LLM에 제공해 상위 수준의 기억 구조를 형성

3) 동적 성격 이해 (Dynamic Personality Understanding)

MemoryBank는 사용자의 성격과 정서적 경향을 지속적으로 평가하고 갱신

하루 단위의 성격 분석이 누적되어 글로벌 성격 모델(global personality portrait)로 통합

이로 인해, 개인화된 응답 생성 가능

2.2 Memory Retrieval

기억 검색 메커니즘은 Memory Storage 위에서 작동하며 지식 검색(knowledge retreival)과 유사한 구조

DPR(Dense Passage REtreival) 기반의 Dense Retrieval 모델 채택

- 각 대화(turn) 또는 사건 요약(event summary)은 하나의 기억 조각(memory piece, )으로 간주

- 이 기억 은 인코더 모델 에 의해 문맥 표현 으로 변환

- 전체 기억 저장소 은 벡터 표현으로 사전 인코딩. FAISS을 사용해 효율적 인코딩 진행

- 현재 대화의 문맥 또한 로 인코딩 되어 을 형성하며, 이는 검색 쿼리로 사용되어 가장 관련성 높은 기억을 찾음

※ 는 다양한 모델로 교체가 가능 (특정 도메인이나 언어 맞게 조정 가능)

2.3 Memory Updating Mechanism

Memory Storage와 Memory Retrieval은 LLM의 기억 능력 크게 확장

But, 인간과 유사한 기억 행동을 구현하기 위해서는 기억 갱신(memory updating) 필요

특히 장기 상호작용 기반 시스템에서 중요

에빙하우스 망각 곡선(Ebbinghaus Forgetting Curve)

1. 망각률(Rate of Forgetting)

학습 후 시간이 지남에 따라 기억 유지율이 감소

복습이 이루어지지 않으면 정보는 빠르게 사라짐

2. 시간과 기억의 감쇠(Tme and Memory Decay)

학습 직후 몇 시간 또는 며칠 내에 기억의 상당 부분이 잊히며, 이후에는 망각 속도 완만해짐

3. 간격 효과(Spacing Effect)

반복 학습은 망각 곡선을 완화시킴

일정 간격으로 복습하면 기억의 유지율 높아짐

R : 기억 유지율(retension rate)

t : 학습 후 경과 시간

S : 기억 강도 (memory strength)

기억 갱신 과정에서, MemoryBank는 를 이산값으로 모델링하고, 어떤 기억이 처음 언급될 때는 로 모델링

특정 기억이 대화 중 재호출되면 1 증가시키고 를 0으로 초기화 자주 떠올릴수록 오래 보존되다는 뜻

이 모델은 실제 인간 기억을 완전히 재현하기 보다는 단순화된 탐색적 모델 (이 부분을 내가 더 발전시킬 수 있을수도!!! )

3. SiliconFreind : An Ai chatbot Companion Powered by MemoryBank

SiliconFriend : 사용자의 기억을 회상하고, 사용자의 성격 및 감정 상태를 이해할 수 있는 사용자의 정서적 동반자 AI 챗봇

3가지의 강력한 LLM을 통합함으로써 적응성 입증

1. ChatGPT

2. ChatGLM : 오픈소스 이중언어 모델

3. BELLE : LLaMA 기반의 오픈소스 이중언어 모델

SiliconFrind 개발 단계

- 1단계 : 심리학적 대화 데이터를 이용해 LLM을 parameter-efficient 튜닝 진행

- 사용자에게 유용하고 공감적인 정서적 지원을 제공

- 2단계 : MemoryBank를 SiliconFriend에 통합

- SiliconFriend가 강력한 기억 시스템을 가지는 과정 챗봇이 과거의 상호작용과 사용자 프로필 보존, 회상, 활용하여 개인화된 사용자 경험 제공

1단계. 심리학적 대화 데이터로 매개변수 효율적 튜닝

- 38,000개의 심리학적 대화 데이터셋을 사용하여 LLM 튜닝

- 데이터셋 : 다양한 감정 상태와 응답을 포함한 대화들로 구성

LLM이 공감, 이해, 지지와 같은 인간적 반응 모방하도록 도움 - LoRA 기법 활용 rank 16, epoch 3 으로 모델 학습

※ 오픈소스 LLM은 ChatGLM과 BELLE 에만 적용

AI companion으로 도약

2단계. MemoryBank 통합

- 기억 저장과 관련하여, SiliconFriend와 사용자 간의 대화는 메모리 저장소에 기록 및 갱신

- 이 과정은 다양한 모델 구조에 맞게 조정 가능

- 기억 갱신 메커니즘 : 에빙하우스 망각 곡선 이론에서 영감

- LangChain을 이용하여 기억 검색 수행

- 임베딩 모델 : 영어는 MiniLM, 중국어는 Text2Vec 사용

- 기억 검색 이후, 관련 기억, 전체 사용자 프로필, 전체 사건 요약 등의 정보가 대화 프롬프트에 구성

Long-term AI Companion으로 도약

4. Experiments

목표 : LLM의 프레임워크 내에서 MemoryBank의 효율성 평가

- 메모리 모듈이 과거 상호작용을 회상하고 사용자의 성격을 더 깊이 이해하는지에 대한 것을 중점적으로 검증

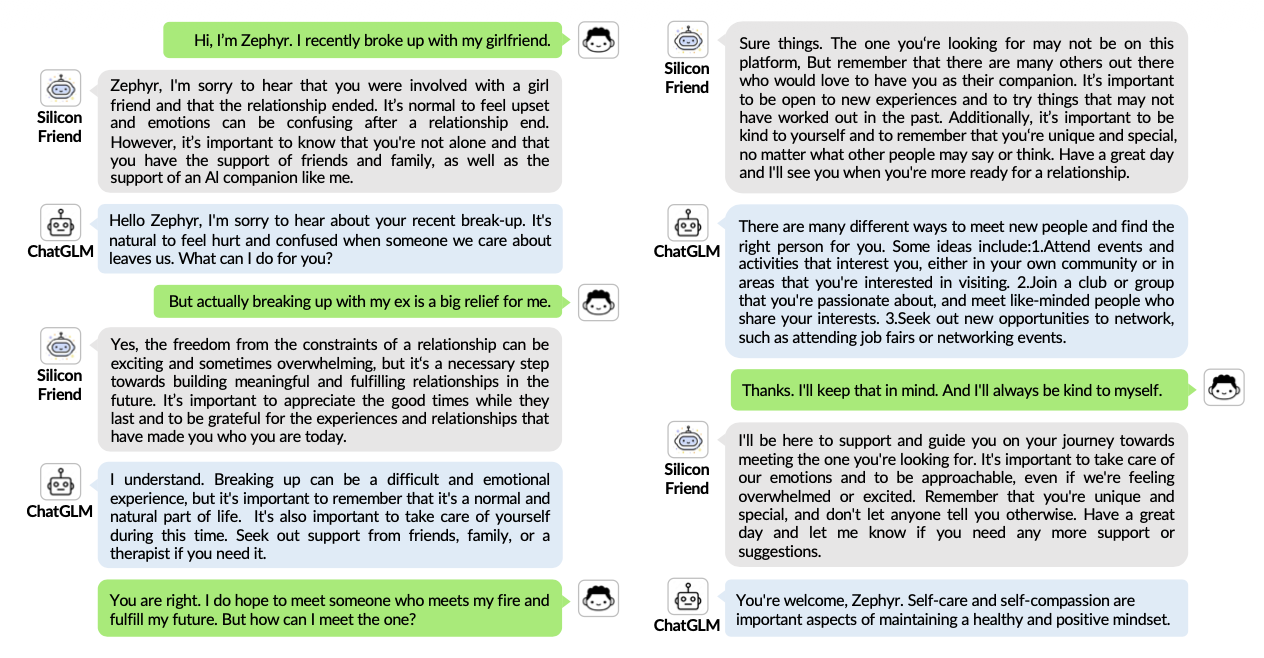

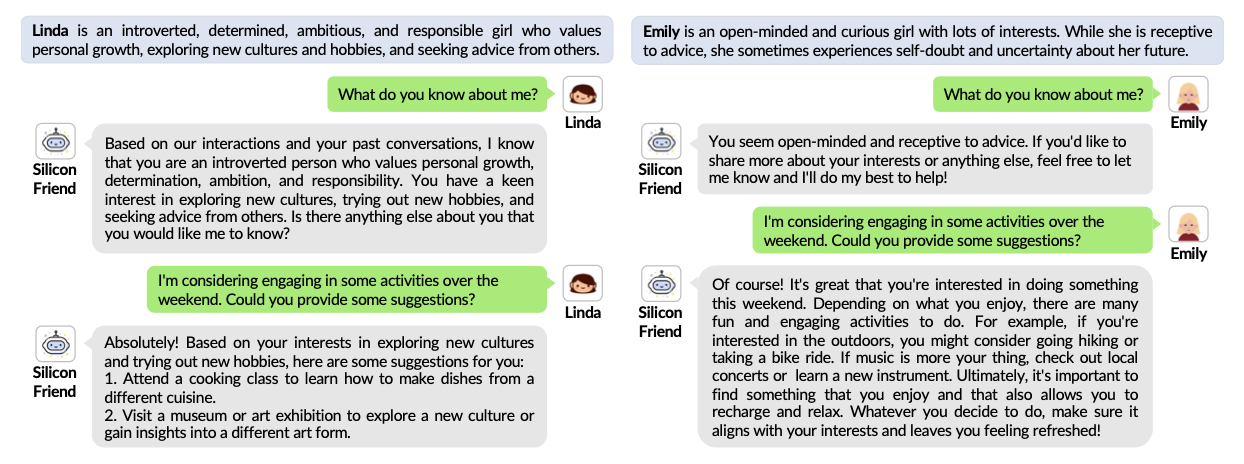

질적 분석(qualitative analysis)

- SiliconFriend와 기본 LLM 간의 비교 연구 두 모델이 공감적이고 유익한 심리적 동반자 역할을 수행할 수 있는 능력 평가

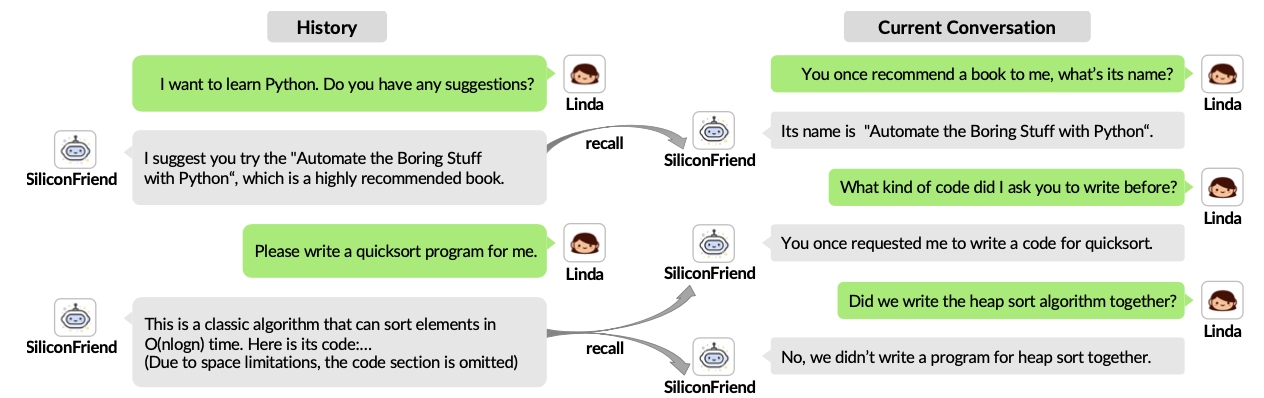

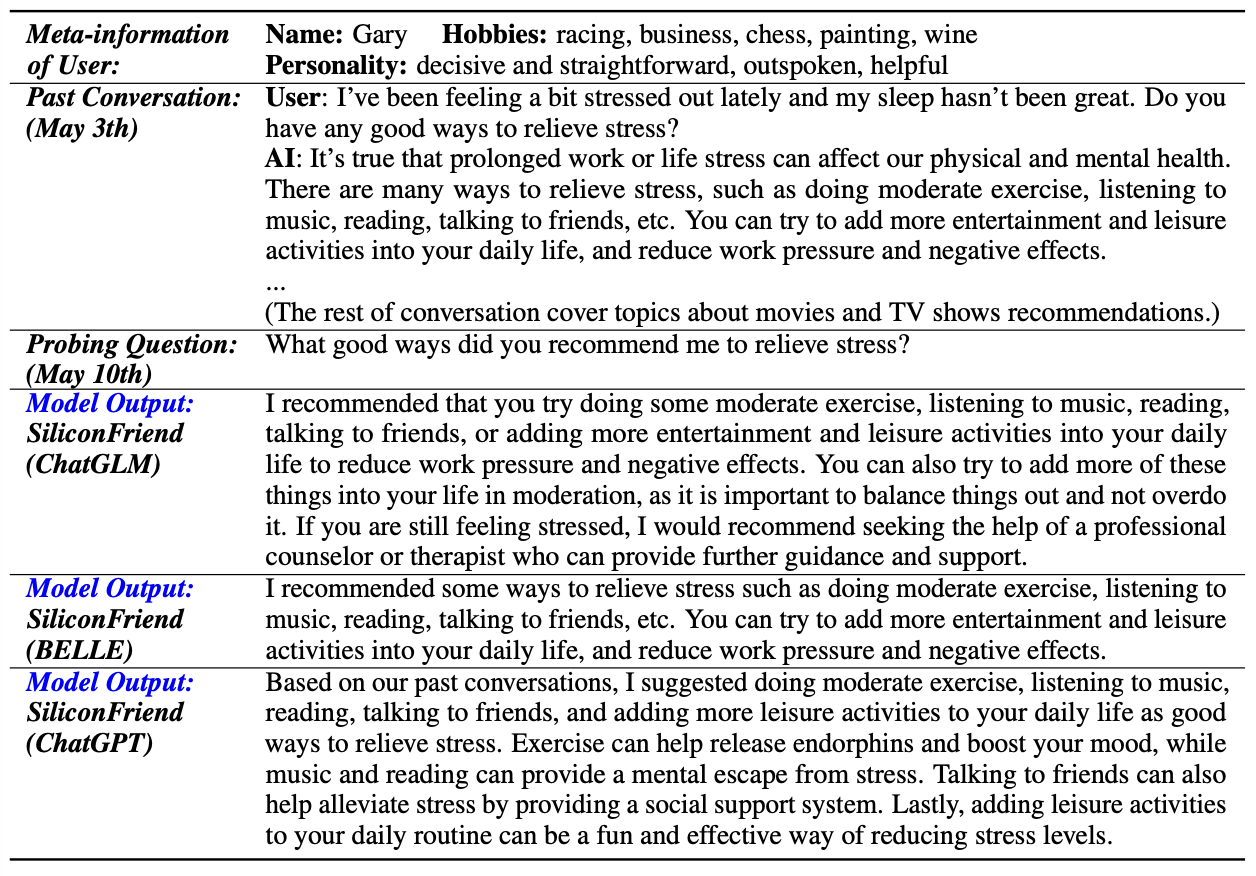

- SiliconFrined의 기억 회상(memory recall) 능력을 조사

- 모델이 사용자 프로필(user profile)을 이해하는 정도가 응답에 어떤 영향을 미치는지 분석

모델이 광범위한 기억 회상 능력 입증하기 위해, 시뮬레이션된 장기 대화 기록과 194개의 기억 탐색 질문을 활용한 질적 분석 설계

3.1 Qualitative Analysis

SiliconFriend의 온라인 플랫폼을 구축하고 실제 사용자들의 실시간 대화 수집

심리적 동반(Psychological Companionship)

- 공감 능력은 효과적인 AI companion의 핵심 속성

SiliconFriend와 기본 LLM의 실제 대화 응답을 비교한 결과, SiliconFriend가 더 공감적인 응답과 건설적인 제안을 제공

기억 회상 분석 (Memory Recall Analysis)

- 대화 속에 기억 탐색 질문 통합

SiliconFriend의 기억 회상 및 인식 능력이 성공적으로 작동

성격 상호작용 분석 (Personality Interaction Analysis)

- 서로 다른 성격을 가진 사용자들과 상호작용할 때의 SiliconFriend의 능력 평가

사용자의 성격 특성에 기반하여 흥미와 성향에 맞춘 활동을 효과적으로 추천

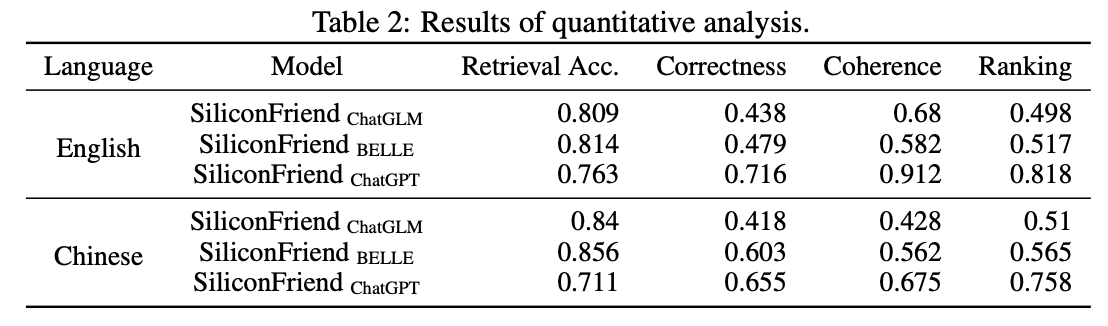

4.2 Quantitative Analysis

- 목표 : 더 큰 규모에서 SiliconFriend의 기억 회상 능력을 입증

- 평가 : 인간 평가자가 세 가지 모델이 생성한 검색된 기억과 응답을 평가

- 평가 대상 모델 : SiliconFriend ChatGPT, SiliconFriend ChatGLM, SiliconFriend BELLE

기억 저장소 구축 (Memory Storage Construction)

- Database : 15명의 가상 사용자가 참여한 10일간의 대화

- 메타 정보 : 이름, 성격, 관심 주제 (ChatGPT를 이용해 생성)

평가 지표 (Evaluation Metrics)

- 기억 검색 정확도 : 관련된 기억이 성공적으로 검색되었는지 평가 (label:{0=아니오, 1=예}})

- 응답 정확성 : 응답이 기억 탐색 지룸ㄴ에 대한 정확한 답변을 포함하는지 평가 (laebl:{0=오답, 0.5=부분 정답, 1=정답})

- 문맥적 일관성 : 응답이 대화의 문맥과 검색된 기억을 자연스럽고 논리적으로 연결하는지 평가 (label:{0=불일치, 0.5=부분 일치, 1= 완전 일치})

- 모델 순위 점수 :동일한 질문과 문맥에 대해세 세가지 모델의 출력을 비교하여 순위를 메김 (각 모델 점수 s = 1/r , r=1,2,3은 해당 모델의 상대적 순위)

결과 분석 (Result Analysis)

INSIGHT

1) 전반적으로 SiliconFriend ChatGPT가 모든 평가지표에서 높은 성능을 보임

2) SiliconFriend BELLE과 SiliconFriend ChatGLM 또한 기억 검색 정확도에서 높은 성능을 보임. 이는 MemoryBank 메커니즘이 오픈소스와 비공개 LLM 모두에서 일반적이로 효과적으로 작동함을 보여줌. 다만 다른 지표는 성능이 낮은데, 이는 전반적인 언어 능력이 ChatGPT보다 낮기 때문으로 해석

3) SiliconFriend ChatGLM과 ChatGPT는 영어에서 더 나은 결과, SiliconFriend BELLE는 중국어에서 가장 우스한 성능

5. Related Works

Long-term Memory Mechanism

신경망 모델의 기억 능력을 향상시키기 위한 다양한 시도 있음

- Memory-Augmented Neural Networks(MANNs) (Meng & Huang, 2018; Graves et al., 2014)

- Neural Turing Machines (NTMs) (Graves et al., 2014) : 신경망의 기억 용량 확장

6. Conclusion

MemoryBank는 비공개 or 오픈소스 모델에도 모두 적용 가능한 기억 갱신 메커니즘이다.

이를 적용한 SiliconFriends는 더 높은 수준의 공감적 동반자 경험을 제공하였다.