2025년 3주차에 공개된 주목할만한 AI 분야의 논문들을 소개합니다.

대규모 언어 모델(LLM) 기술 분야

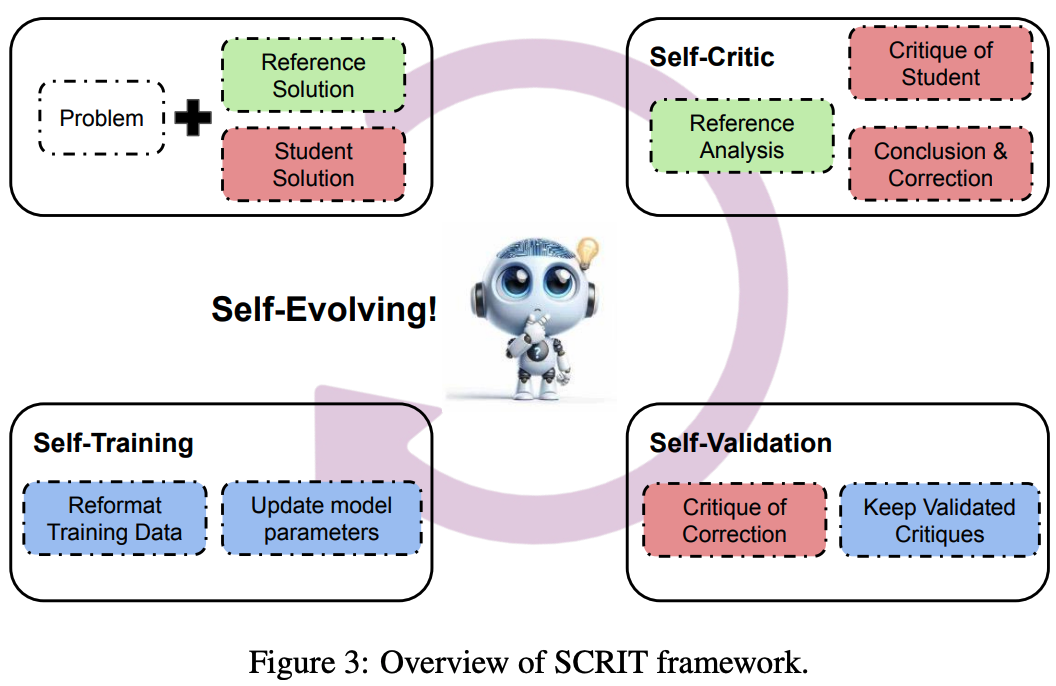

Enabling Scalable Oversight via Self-Evolving Critic

SCRIT(Self-evolving CRITic)는 대규모 언어 모델(LLM)의 비평 능력을 외부 감독 없이 자체적으로 발전시키는 새로운 프레임워크입니다. 기존 접근법들이 인간의 평가나 더 강력한 모델에 의존했던 것과 달리, SCRIT는 참조 해결책을 사용한 대조 기반 자기 비평과 수정 결과를 통한 자체 검증 메커니즘을 통해 합성 데이터를 생성하고 이를 학습함으로써 비평 능력을 향상시킵니다. Qwen2.5-72B-Instruct를 사용한 실험에서 비평-수정 및 오류 식별 벤치마크에서 최대 10.3%의 성능 향상을 달성했으며, 데이터와 모델 크기에 따라 성능이 향상되고 자체 검증 구성 요소가 중요한 역할을 한다는 것을 입증했습니다.

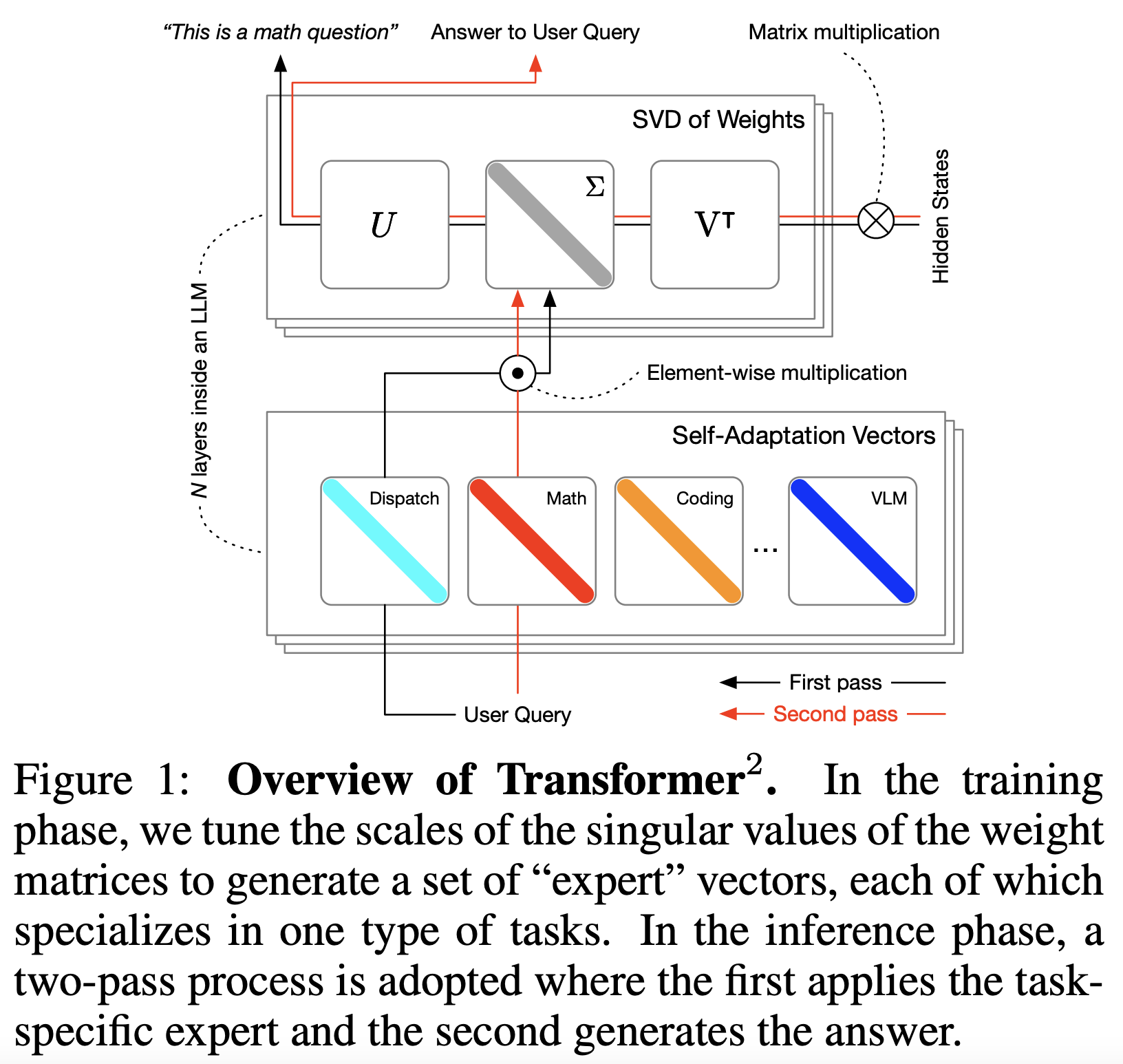

Transformer^2: Self-adaptive LLMs

Transformer^2는 대규모 언어 모델(LLM)이 실시간으로 새로운 작업에 적응할 수 있게 하는 혁신적인 자가 적응 프레임워크입니다. 가중치 행렬의 특이 성분만을 선택적으로 조정하는 방식을 채택하며, 추론 과정에서 두 단계 메커니즘을 사용합니다: 먼저 작업의 특성을 파악하고, 강화학습으로 훈련된 작업별 "전문가" 벡터들을 동적으로 혼합하여 입력된 프롬프트에 맞는 targeted 행동을 생성합니다. LoRA와 같은 기존 방식들보다 적은 매개변수로 더 높은 효율성을 달성했으며, 다양한 LLM 구조와 시각-언어 작업에서도 뛰어난 성능을 보여주어 진정한 동적, 자기 조직화 AI 시스템을 위한 중요한 진전을 이루었습니다.

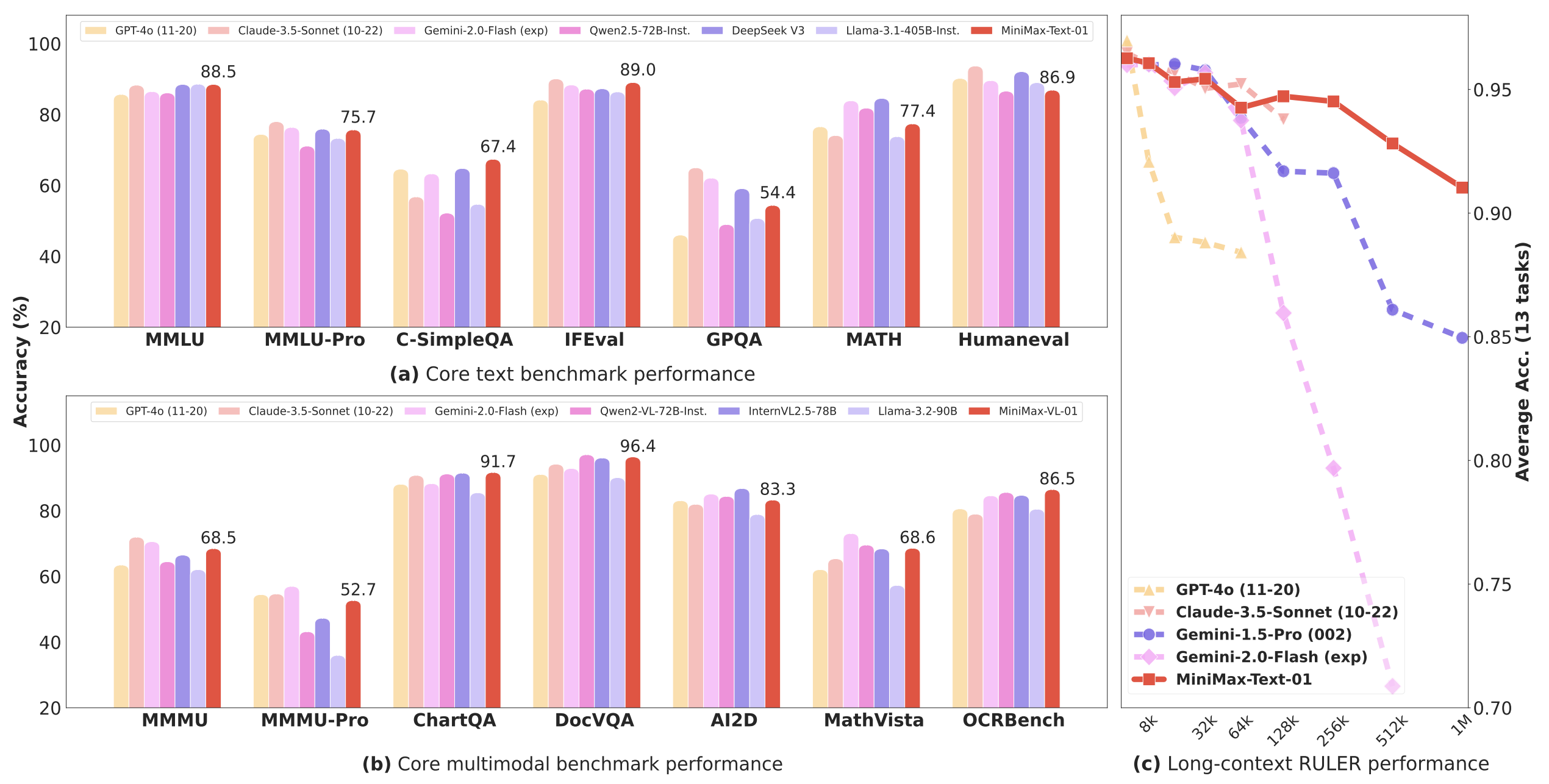

MiniMax-01: Scaling Foundation Models with Lightning Attention

MiniMax-01 시리즈는 MiniMax-Text-01과 MiniMax-VL-01을 포함하는 새로운 모델로, 최고 수준의 모델들과 견줄만한 성능을 보이면서도 더 긴 컨텍스트를 처리할 수 있는 능력을 제공합니다. 번개 주의(lightning attention) 메커니즘과 전문가 혼합(MoE)을 통합하여 총 4,560억 개의 매개변수를 가진 모델을 만들었으며, 각 토큰당 459억 개의 매개변수가 활성화됩니다. 최적화된 병렬 전략과 효율적인 계산-통신 중첩 기술을 개발하여 수백만 토큰의 컨텍스트를 처리할 수 있게 했으며, 특히 MiniMax-Text-01은 학습 시 100만 토큰, 추론 시 400만 토큰까지 처리할 수 있습니다. 실험 결과 GPT-4o와 Claude-3.5-Sonnet과 같은 최신 모델들과 비슷한 성능을 보이면서도 20-32배 더 긴 컨텍스트 윈도우를 제공합니다.

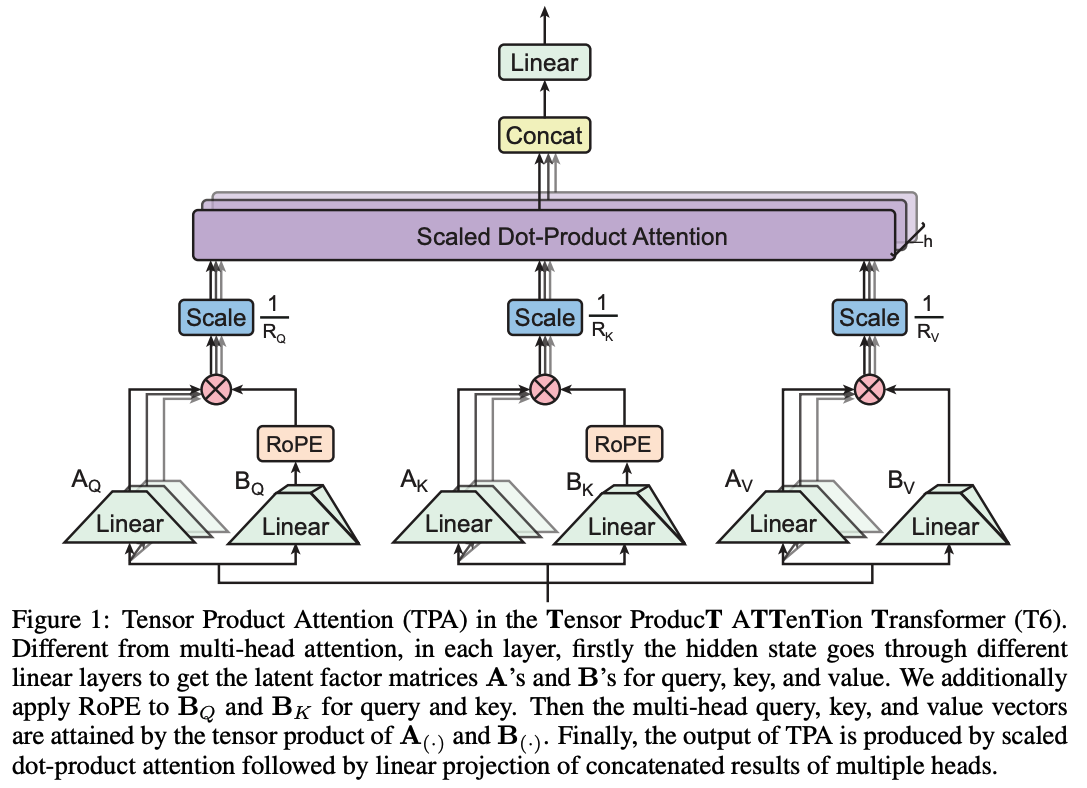

Tensor Product Attention Is All You Need

Tensor Product Attention(TPA)는 텐서 분해를 활용하여 쿼리, 키, 값을 압축적으로 표현함으로써 언어 모델의 키-값(KV) 캐시 크기를 크게 줄이는 새로운 주의 메커니즘입니다. 맥락적 저차원 성분으로 표현을 분해하고(맥락적 분해) RoPE와 원활하게 통합하여 모델 품질과 메모리 효율성을 동시에 향상시켰습니다. 이를 기반으로 개발된 T6(Tensor ProducT ATTenTion Transformer) 모델은 MHA, MQA, GQA, MLA 등 기존의 Transformer 기준 모델들보다 우수한 성능을 보여주었으며, 특히 제한된 자원에서도 더 긴 시퀀스를 처리할 수 있어 현대 언어 모델의 중요한 확장성 문제를 해결했습니다.

멀티모달 AI/시각-언어 처리 분야

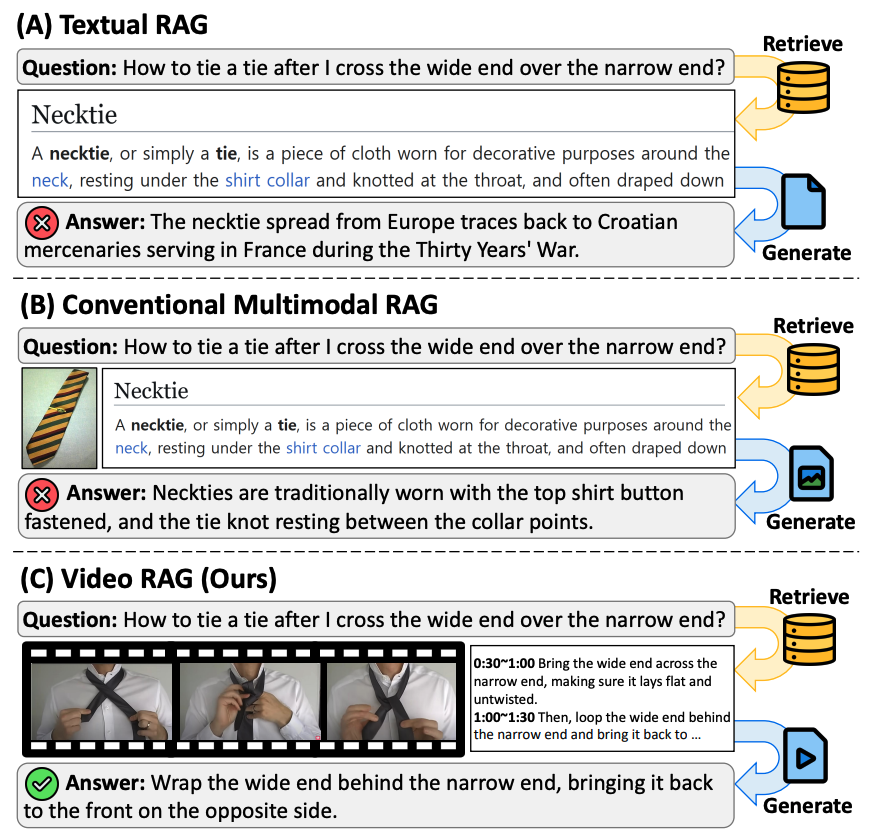

VideoRAG: Retrieval-Augmented Generation over Video Corpus

VideoRAG는 기존의 텍스트 중심 RAG(Retrieval-Augmented Generation) 접근법을 확장하여 비디오를 지식 소스로 활용하는 새로운 프레임워크입니다. 기존 방식들이 미리 정의된 비디오를 사용하거나 비디오를 단순히 텍스트로 변환했던 것과 달리, VideoRAG는 질의에 따라 관련 비디오를 동적으로 검색하고 비디오의 시각적, 텍스트적 정보를 모두 활용하여 출력을 생성합니다. 특히 대규모 비디오 언어 모델(LVLM)을 활용하여 비디오 콘텐츠를 직접 처리하고 검색된 비디오를 질의와 함께 원활하게 통합하는 방식을 채택했으며, 실험을 통해 관련 기준 모델들보다 우수한 성능을 입증했습니다.

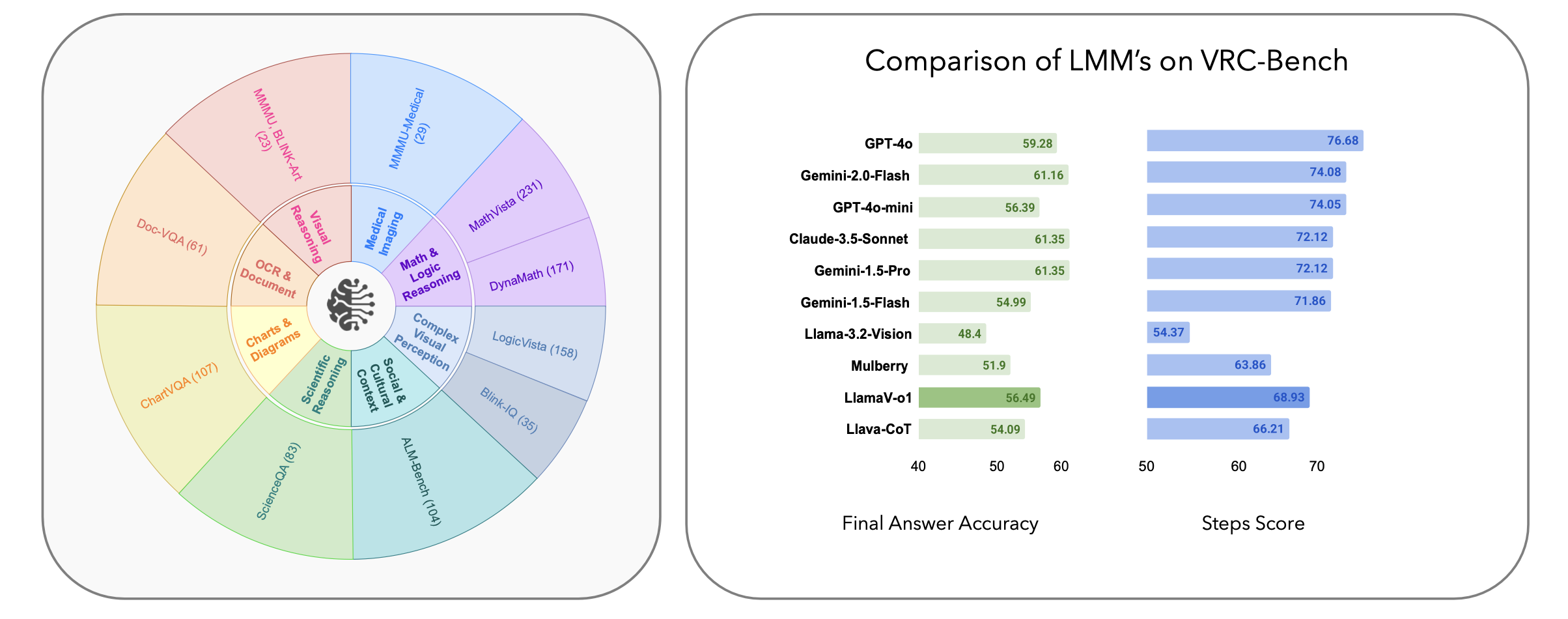

LlamaV-o1: Rethinking Step-by-step Visual Reasoning in LLMs

이 연구는 대규모 언어 모델(LLM)의 시각적 추론 능력을 향상시키기 위한 종합적인 프레임워크를 제안합니다. 세 가지 주요 기여를 합니다: 1) 복잡한 시각 인식부터 과학적 추론까지 8개 카테고리에 걸쳐 4천 개 이상의 추론 단계를 포함하는 새로운 시각 추론 벤치마크를 도입, 2) 개별 단계의 정확성과 논리적 일관성을 평가하는 새로운 평가 지표 개발, 3) 단계적 커리큘럼 학습 접근법을 사용하여 훈련된 새로운 다중 모달 시각 추론 모델 LlamaV-o1 개발. LlamaV-o1은 기존 오픈소스 모델들을 능가하고 비공개 독점 모델들과 견줄만한 성능을 보여주었으며, 특히 Llava-CoT보다 6개 벤치마크에서 평균 3.8% 더 높은 점수를 달성하면서도 추론 속도는 5배 더 빠릅니다.

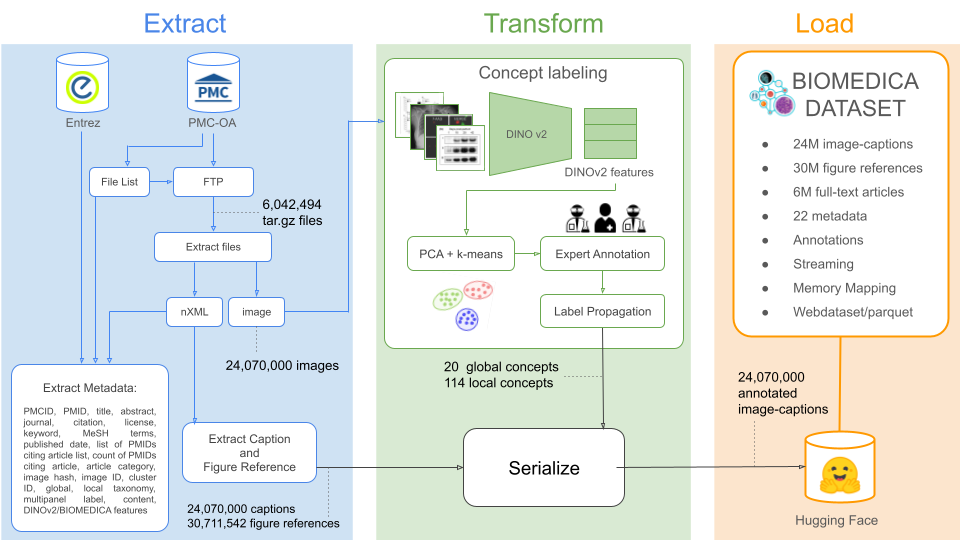

BIOMEDICA: An Open Biomedical Image-Caption Archive, Dataset, and Vision-Language Models Derived from Scientific Literature

BIOMEDICA는 생물학과 의학 분야의 시각-언어 모델(VLM) 개발을 위한 대규모 오픈소스 프레임워크입니다. PubMed Central의 오픈 액세스 논문들에서 2,400만 개 이상의 이미지-텍스트 쌍을 추출하고 주석을 달아 포괄적인 데이터셋을 구축했습니다. 이를 기반으로 개발된 BMCA-CLIP 모델은 스트리밍 방식으로 지속적인 사전 학습이 가능하며, 병리학, 방사선학, 안과학, 피부과학, 외과학, 분자생물학, 기생충학, 세포생물학 등 40개 작업에서 최고 수준의 성능을 달성했습니다. 특히 제로샷 분류에서 평균 6.56%(피부과학에서 29.8%, 안과학에서 17.5%)의 성능 향상을 보여주었으며, 기존 방법보다 10배 적은 계산량으로 더 나은 이미지-텍스트 검색 성능을 달성했습니다.

로보틱스/컴퓨터 비전 분야

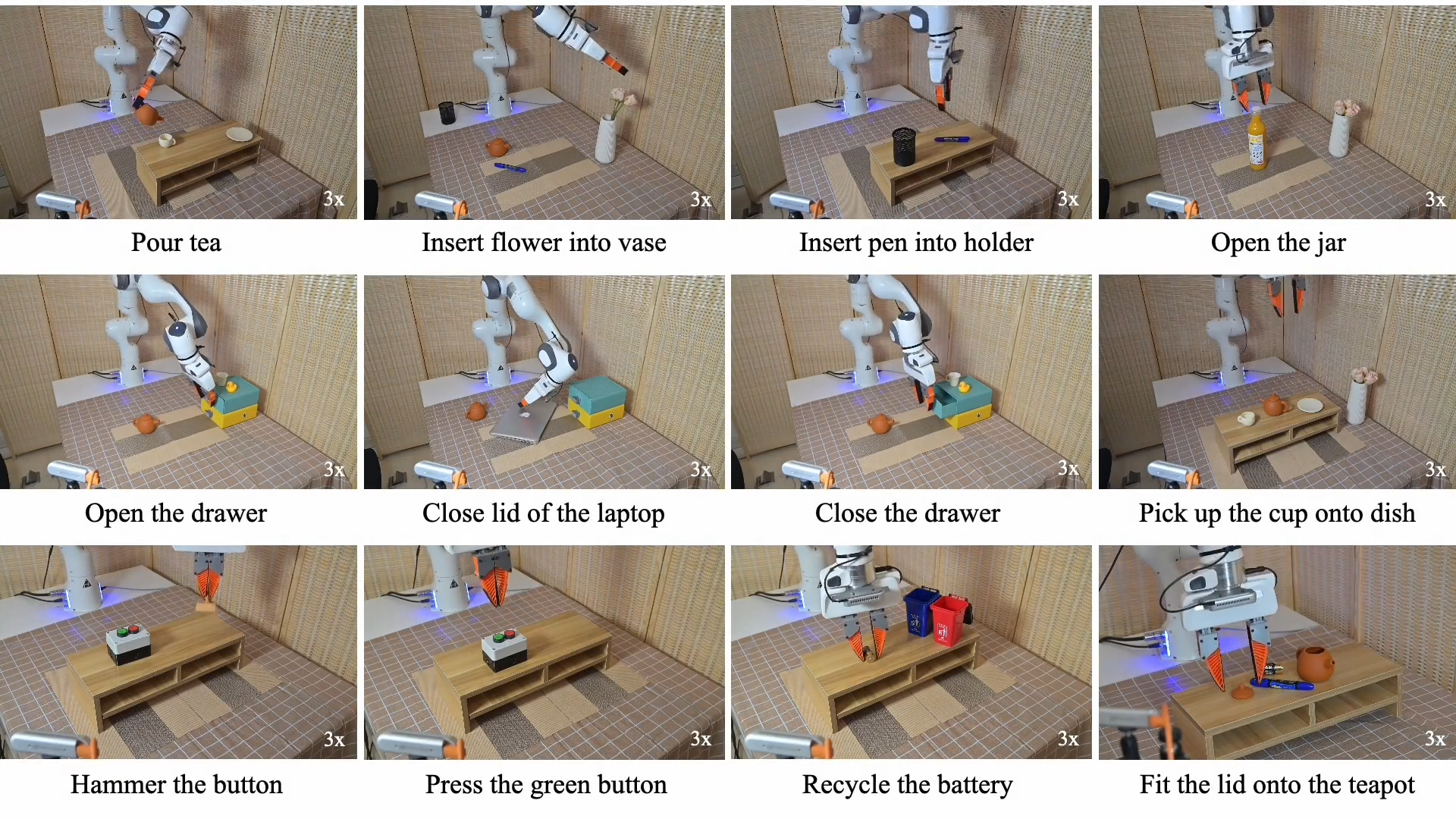

OmniManip: Towards General Robotic Manipulation via Object-Centric Interaction Primitives as Spatial Constraints

이 연구는 구조화되지 않은 환경에서 작동할 수 있는 일반적인 로봇 시스템 개발을 위해 새로운 객체 중심 표현 방식을 제안합니다. 비전-언어 모델(VLM)이 상식적 추론에는 뛰어나지만 정밀한 조작에 필요한 3D 공간 이해가 부족하다는 문제를 해결하기 위해, 객체의 기능적 특성에 기반한 정규 공간을 도입하여 상호작용 기본 요소(점과 방향)를 의미있게 표현합니다. 이중 폐쇄 루프 방식을 통해 기본 요소 재샘플링, 상호작용 렌더링, VLM 확인을 통한 고수준 계획과 6D 포즈 추적을 통한 저수준 실행을 결합하여, VLM의 미세조정 없이도 실시간 제어가 가능한 개방형 어휘 로봇 조작 시스템을 구현했습니다. 다양한 로봇 조작 작업에서 뛰어난 제로샷 일반화 성능을 보여주었습니다.

MangaNinja: Line Art Colorization with Precise Reference Following

MangaNinja는 참조 이미지를 기반으로 라인 아트를 채색하는 확산 모델 기반 시스템입니다. 정확한 캐릭터 세부 사항 전사를 위해 두 가지 핵심 설계를 도입했는데, 참조 컬러 이미지와 대상 라인 아트 사이의 대응 관계 학습을 위한 패치 셔플링 모듈과 세밀한 색상 매칭을 가능하게 하는 포인트 기반 제어 방식입니다. 자체 수집한 벤치마크에서 기존 솔루션들보다 더 정확한 채색 성능을 보여주었으며, 특히 제안된 대화형 포인트 제어를 통해 까다로운 케이스, 캐릭터 간 채색, 다중 참조 조화와 같은 기존 알고리즘으로는 처리하기 어려운 작업들도 성공적으로 수행할 수 있음을 입증했습니다.

수학적/논리적 추론 분야

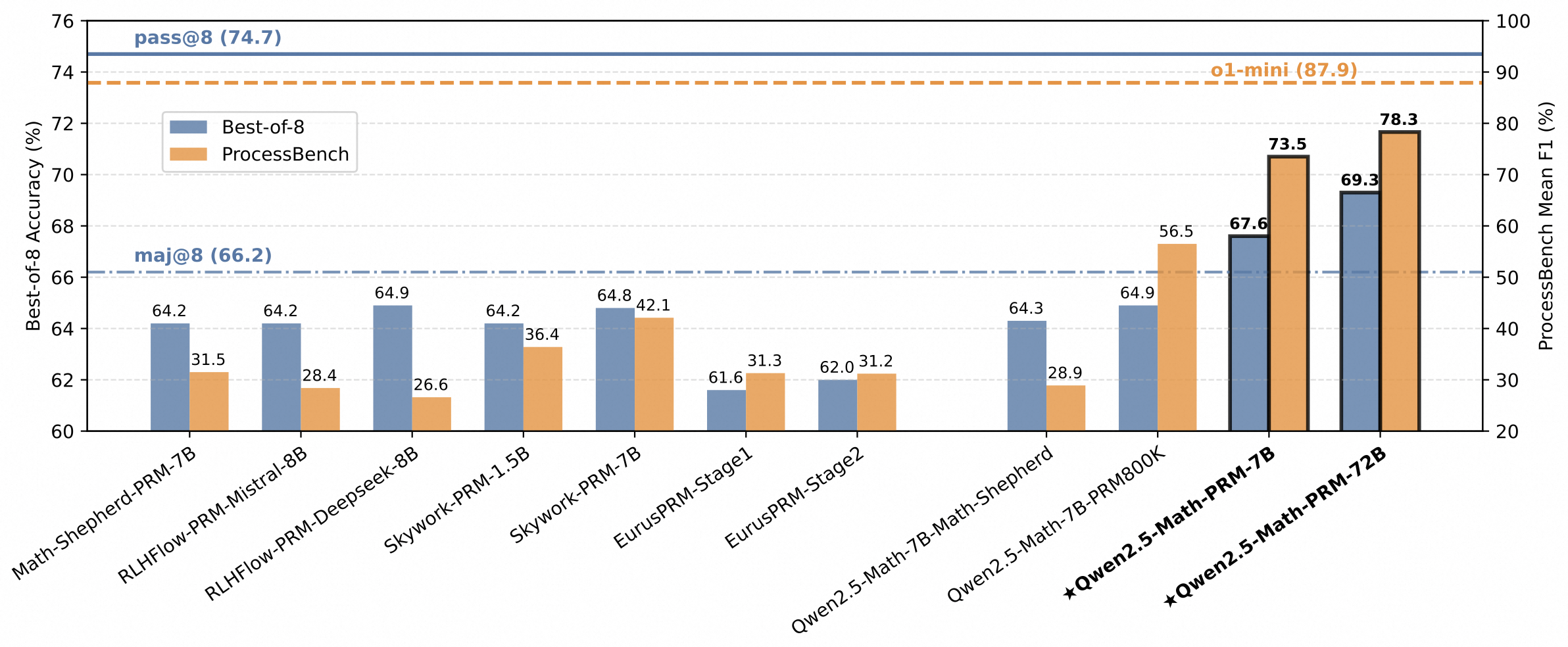

The Lessons of Developing Process Reward Models in Mathematical Reasoning

이 연구는 대규모 언어 모델(LLM)의 수학적 추론 과정에서 중간 오류를 식별하고 완화하기 위한 과정 보상 모델(PRM)의 개선 방안을 제시합니다. 기존의 몬테카를로(MC) 추정 기반 데이터 합성이 LLM 판단이나 인간 주석보다 성능과 일반화가 떨어진다는 점을 실험을 통해 입증했으며, Best-of-N(BoN) 평가 전략의 잠재적 편향을 세 가지(신뢰할 수 없는 정책 모델의 응답, PRM의 과도한 관용, 결과 중심 평가로의 편향) 측면에서 분석했습니다. 이러한 문제들을 해결하기 위해 MC 추정과 LLM 판단을 통합하는 합의 필터링 메커니즘을 개발하고, 응답 수준과 단계 수준 메트릭을 결합한 포괄적인 평가 프레임워크를 제안했으며, 이를 통해 모델 성능과 데이터 효율성을 크게 향상시켰습니다.