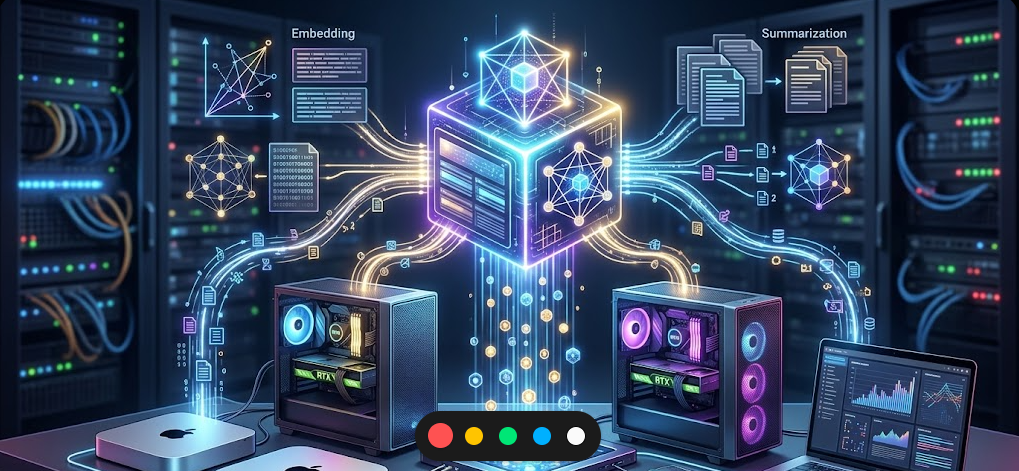

방구석 PC 5대로 가성비 LLM 클러스터 구축하기

얼마 전 LM-Studio에서 야심 차게 선보인 'LM-Link' 기능, 다들 확인해 보셨나요?

하나의 계정에 최대 5대의 컴퓨터를 연결해서 마치 하나의 거대한 서버처럼 동작하게 만들어주는 매력적인 기능입니다.

평소 대량의 문서를 처리해야 할 일이 많아, 이번 기회에 제 주변의 가용 머신들을 영혼까지 끌어모아 소규모 LLM 클러스터를 직접 구축해 본 후기를 풀어볼까 합니다.

1. 하드웨어 및 모델 세팅

성능 테스트를 위해 꽤 묵직한 라인업을 구성했습니다.

- 머신 구성: 맥 미니 M4(64GB) 2대 + RTX 4080 머신 1대 + RTX 3090 머신 2대

- 사용 모델: * 임베딩:

Qwen 3 Embedding 8- LLM:

Qwen 3.5 35B

- LLM:

과부하를 막기 위해 욕심부리지 않고 각 머신당 모델들을 하나씩만 로딩했습니다.

LM-Link 환경에서는 어떤 머신에서 어떤 모델이 도는지 헷갈릴 수 있기 때문에, 로딩 시 뒤에 별명을 붙여 명확하게 구분해 주었습니다.

2. 병렬 처리와 VRAM 최적화

로딩 시 병렬 처리 수치는 4로 세팅했습니다.

스펙상 더 높게 줄 수도 있겠지만, LLM과 임베딩 두 모델 모두에게 각각 20K의 컨텍스트 창을 넉넉하게 할당하다 보니 VRAM 한계를 고려했을 때 Parallel 4 정도가 가장 안정적인 마지노선이었습니다.

이렇게 세팅한 뒤, 클러스터링 된 API를 향해 동시에 20건씩 병렬로 비동기 요청을 던지는 코드를 작성해 구동해 보았습니다.

3. 경이로운 퍼포먼스와 실무 활용도

결과는 기대 이상이었습니다.

5대의 머신이 동시에 20건의 요청을 나누어 처리하는 모습이 꽤나 감동적이더군요.

- 처리 속도: 20건 동시 처리 기준으로 초당 200~400토큰 정도를 뿜어냅니다.

동적 할당이나 네트워크 상태 때문인지 성능 범위의 편차가 다소 넓긴 합니다. - 실무 투입: 이 정도 성능이면 유료 API 결제 없이도 대규모 DB 작업이 완벽하게 커버됩니다.

특히 대량의 PDF 문서들을 청킹해서 요약하거나, pgvector 같은 벡터 DB에 수많은 임베딩 값을 밀어 넣고 하이브리드 검색 기반의 Q&A 시스템을 구축할 때 그 진가를 발휘합니다.

막대한 토큰 비용 걱정 없이 이 모든 파이프라인을 로컬 환경에서 매끄럽게 태울 수 있다는 게 가장 큰 장점입니다.

4. 총평 및 향후 계획: 노는 PC의 재발견

가장 만족스러운 점은, 수천만 원짜리 초고가 엔터프라이즈급 머신 1대 없이도 훌륭한 퍼포먼스를 뽑아낼 수 있다는 것입니다.

이쯤 되니 서랍 속에서 놀고 있는 예전 PC나 내장 그래픽 노트북들을 싹 다 모아서 자잘한 기능들을 전담할 '서브 클러스터'를 하나 더 구축할까 진지하게 고민 중입니다.

35B 같은 무거운 모델은 힘들겠지만, 8B 수준의 모델이나 가벼운 임베딩 모델들은 구형 노트북으로도 충분히 잘 돌아가니까요.

단일 머신의 한계를 훌쩍 뛰어넘게 해주는 LM-Link, 로컬 인퍼런스를 즐기시는 개발자분들이라면 꼭 한번 구성해 보시길 강력히 추천합니다!