들어가며...

오늘날 llm의 기준이 되는 트랜스포머에 대해 알아보자.

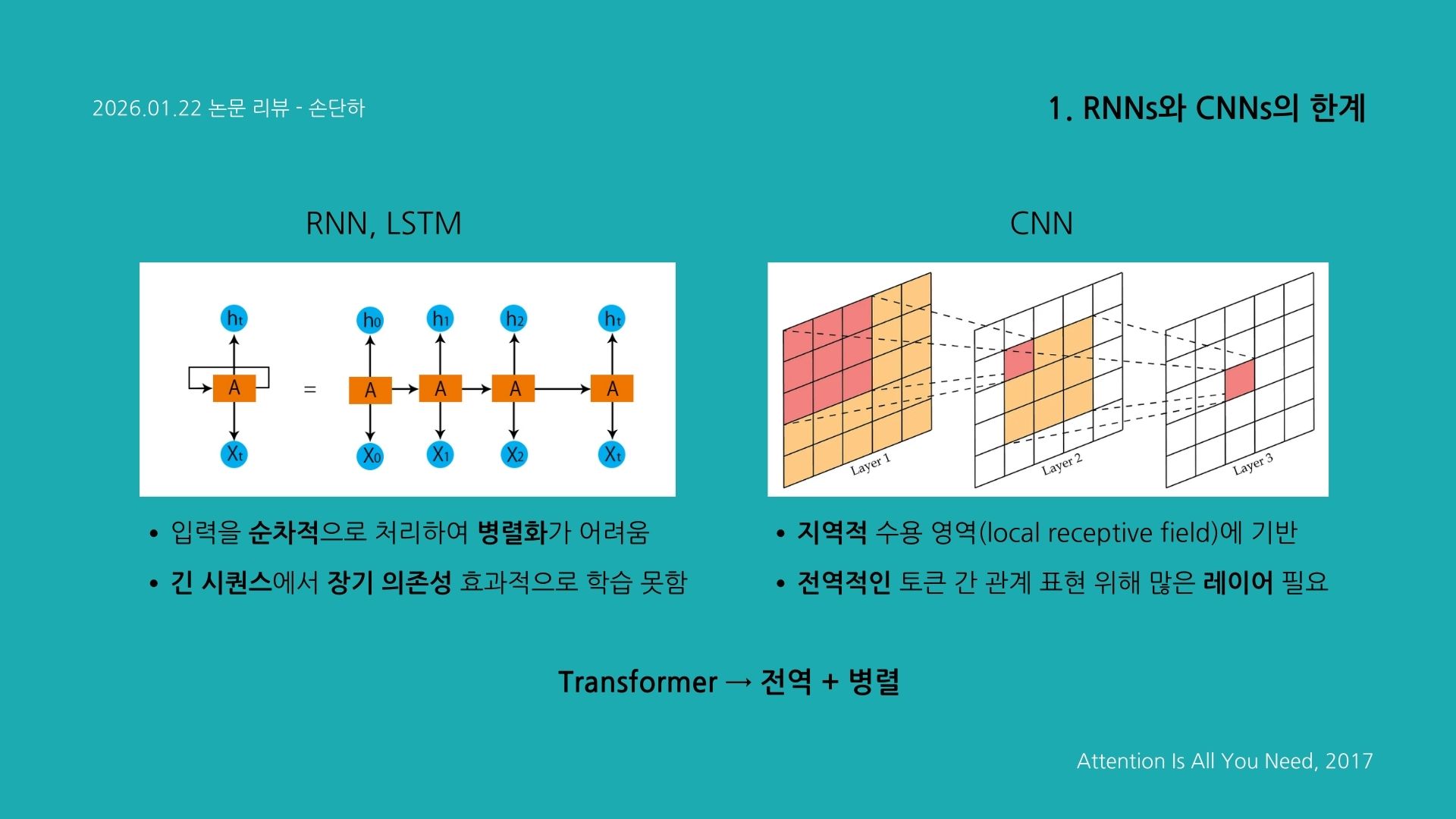

1. RNNs과 CNNs의 한계

2. Attention 매커니즘

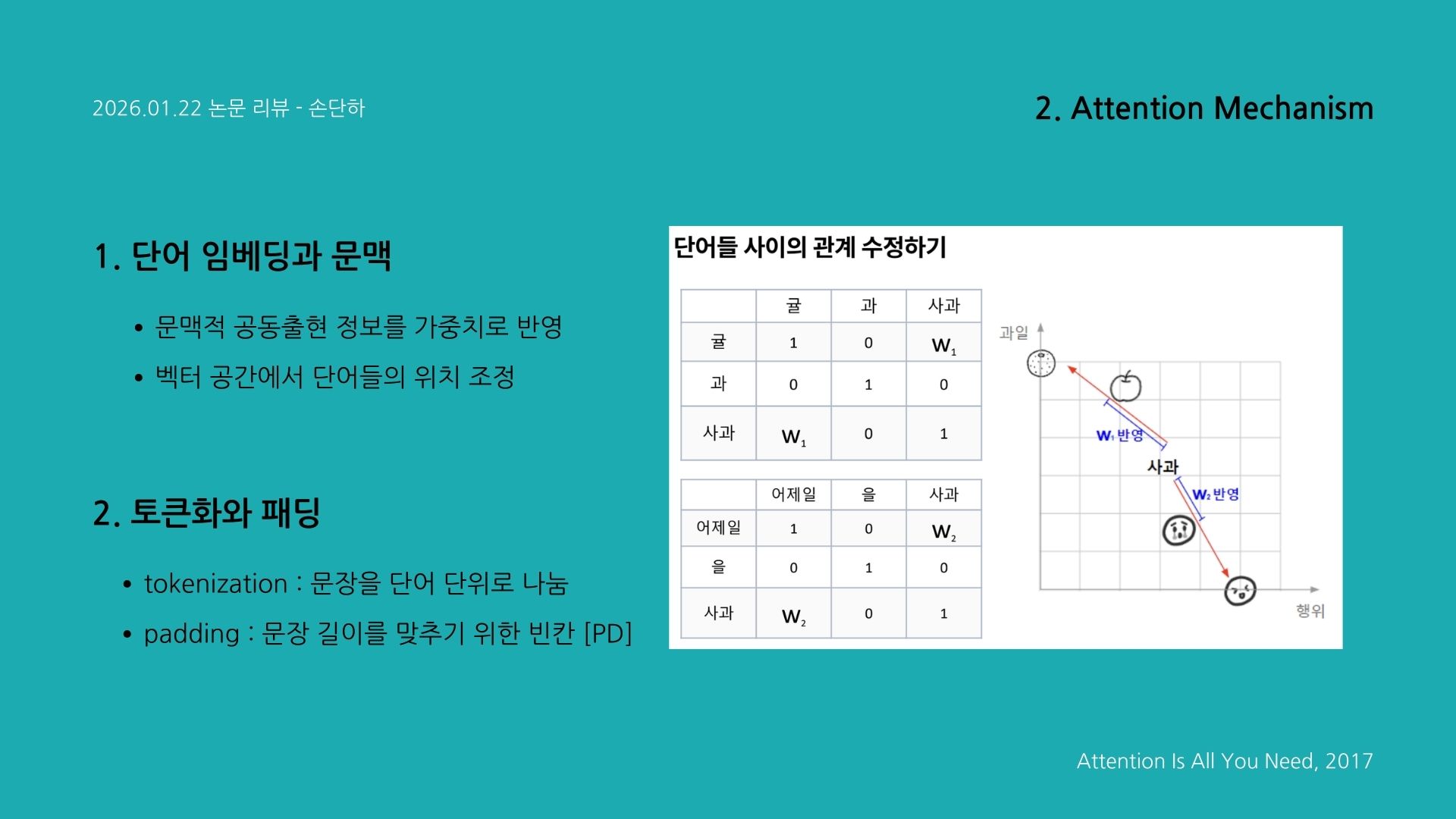

2-1. 단어 임베딩과 문맥

2-2. 토큰화와 패딩

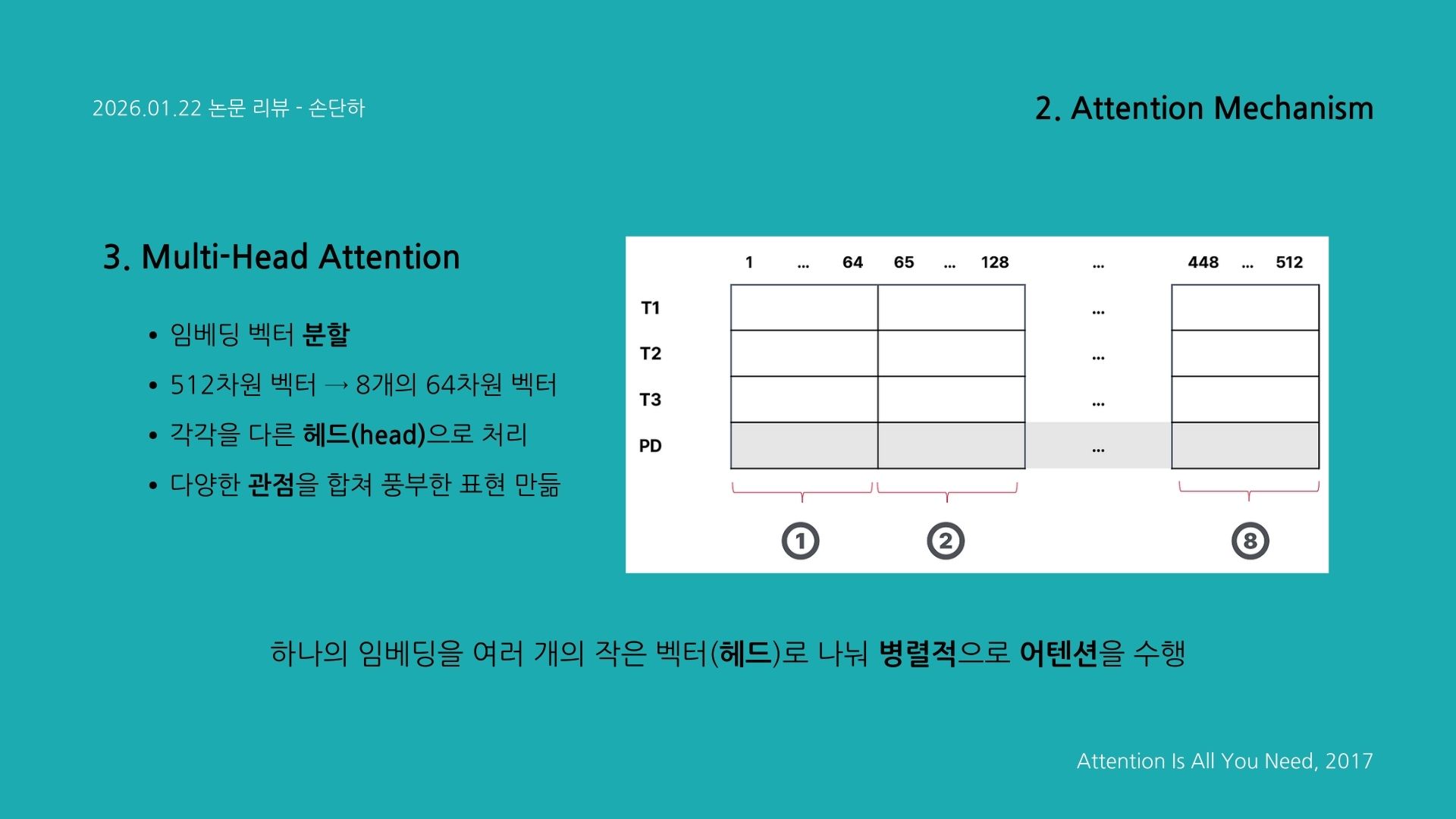

2-3. 멀티헤드 어텐션

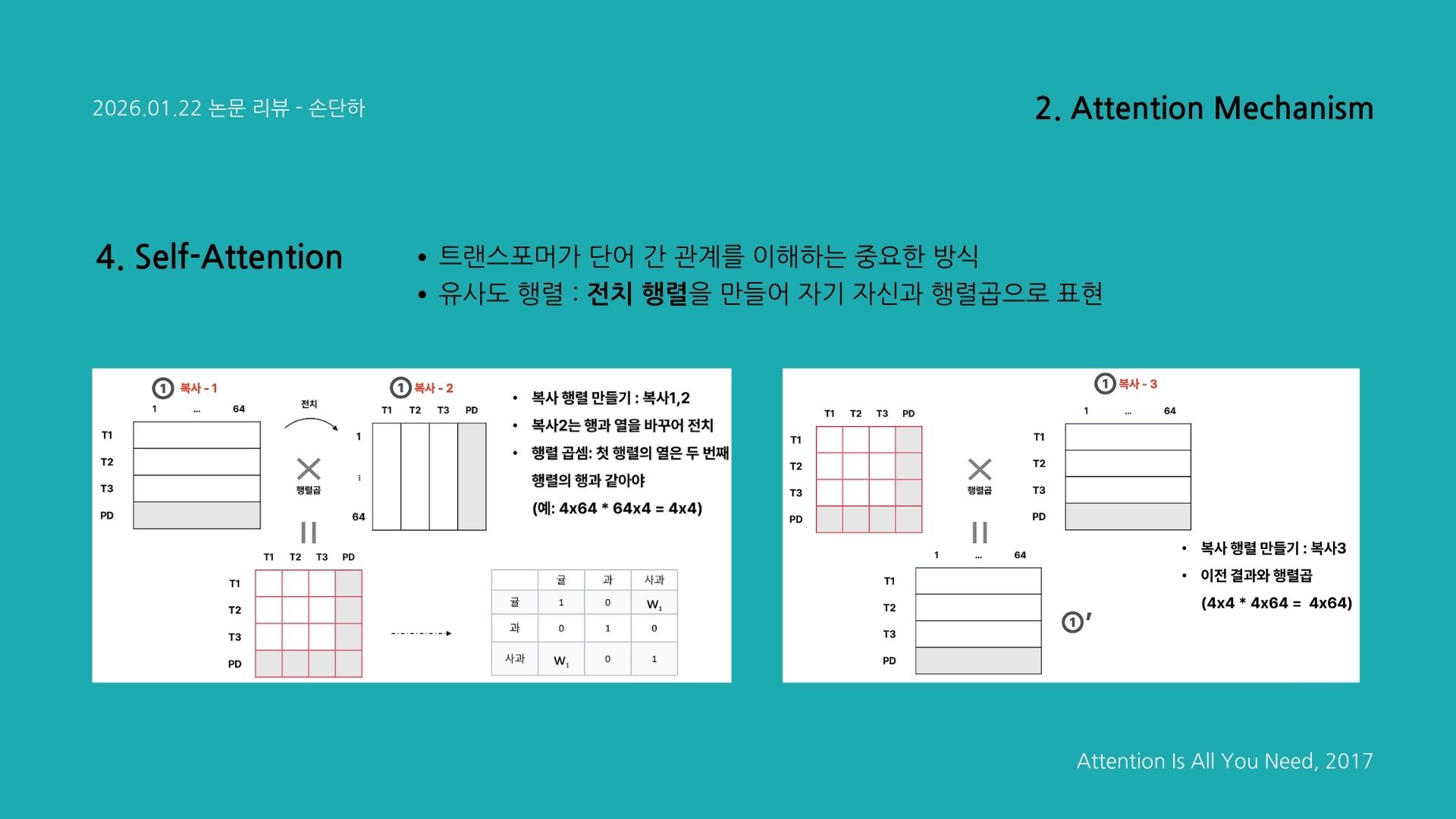

2-4. 셀프 어텐션

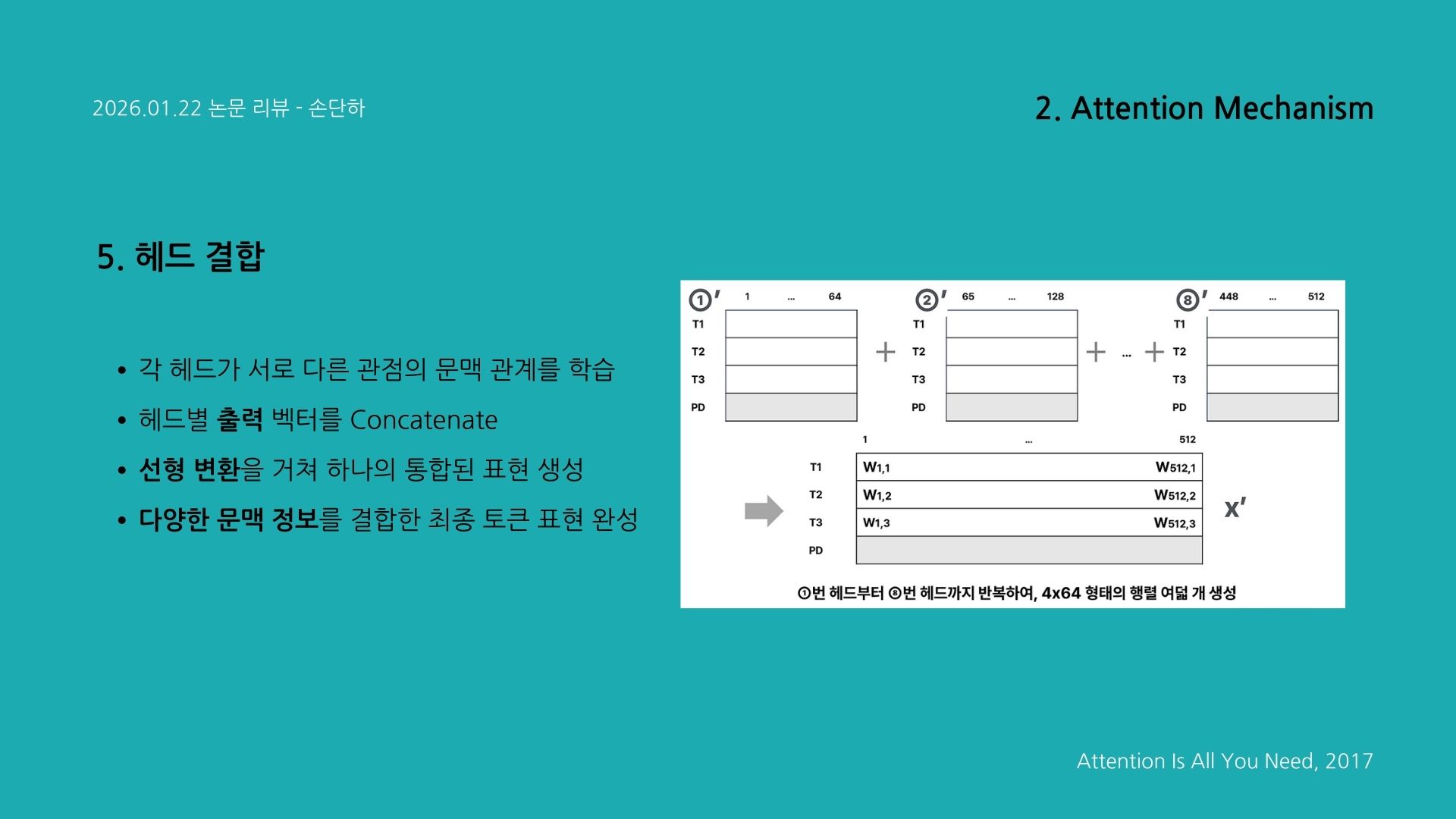

2-5. 헤드 결합

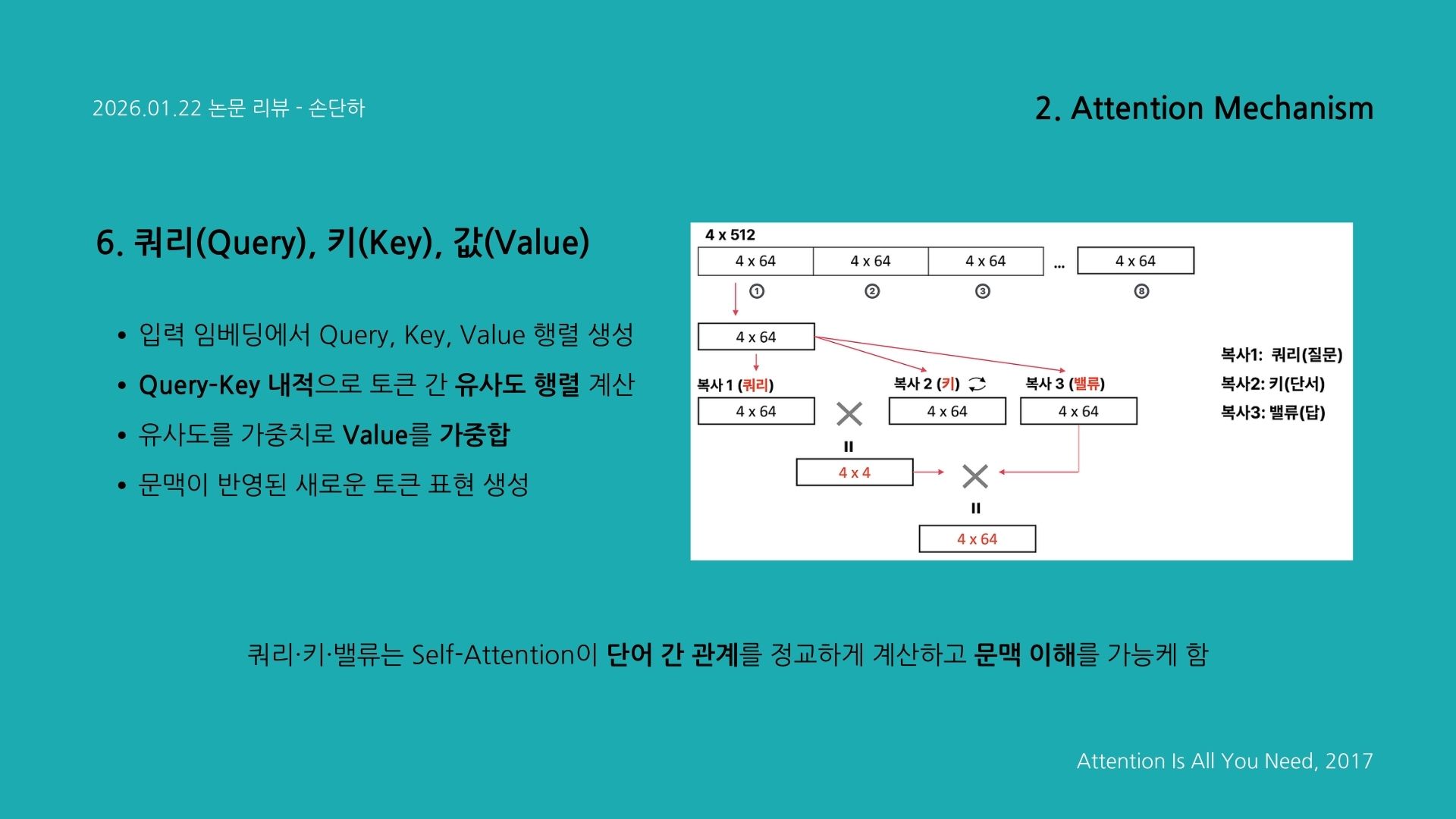

2-6. 쿼리, 키, 값

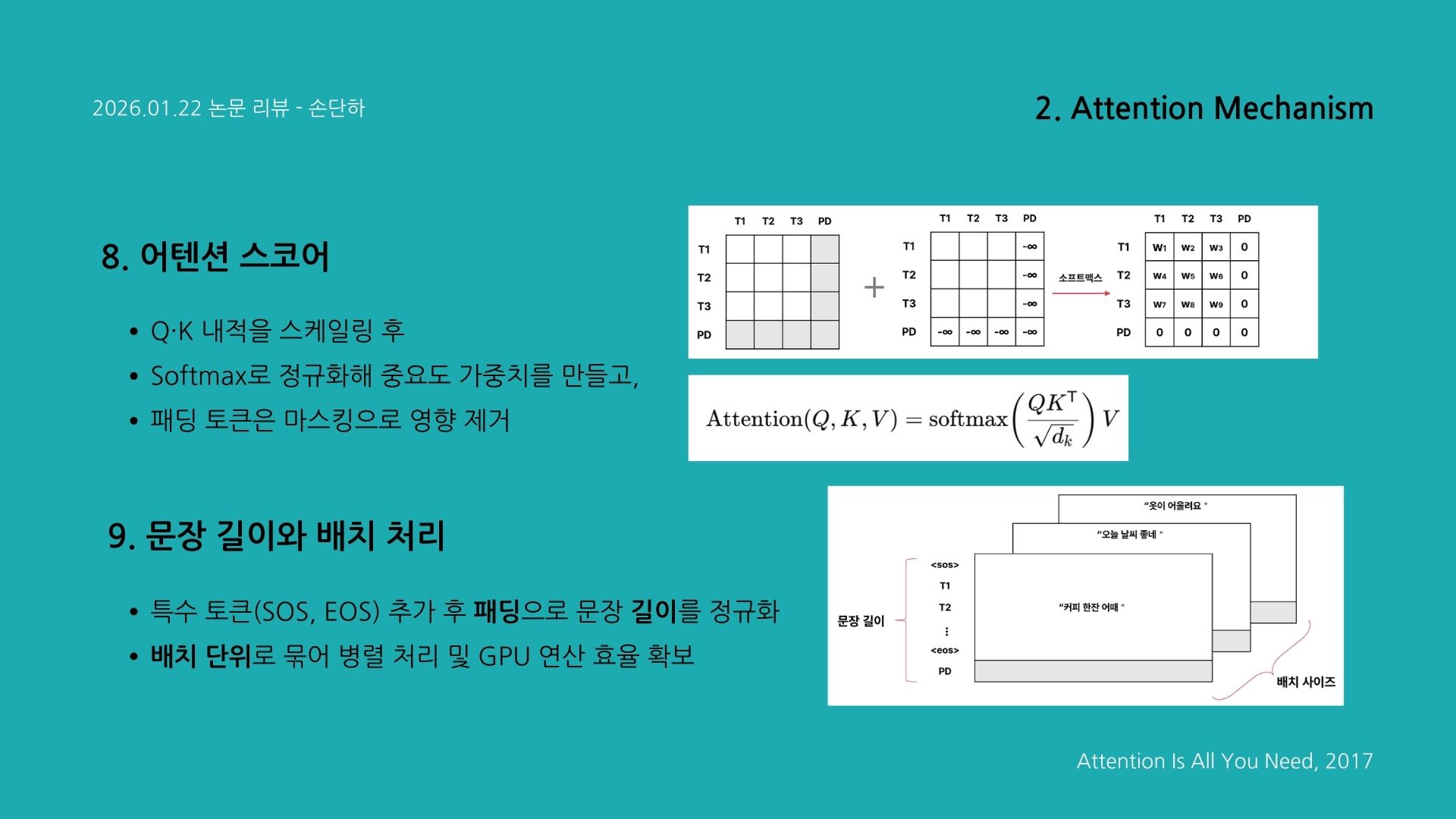

2-7. 어텐션 스코어

2-8. 문장 길이와 배치 처리

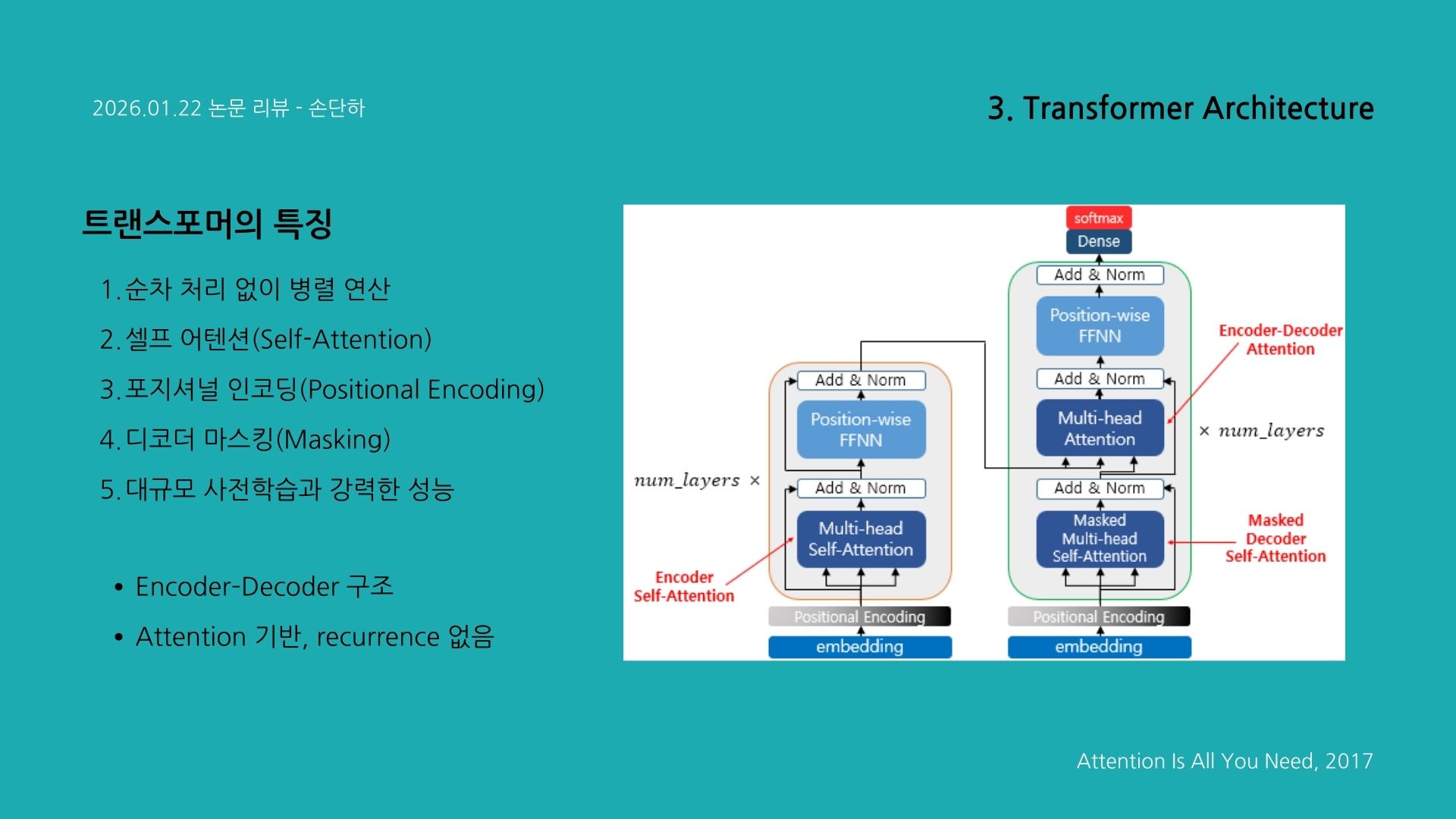

3. 트랜스포머 아키텍쳐

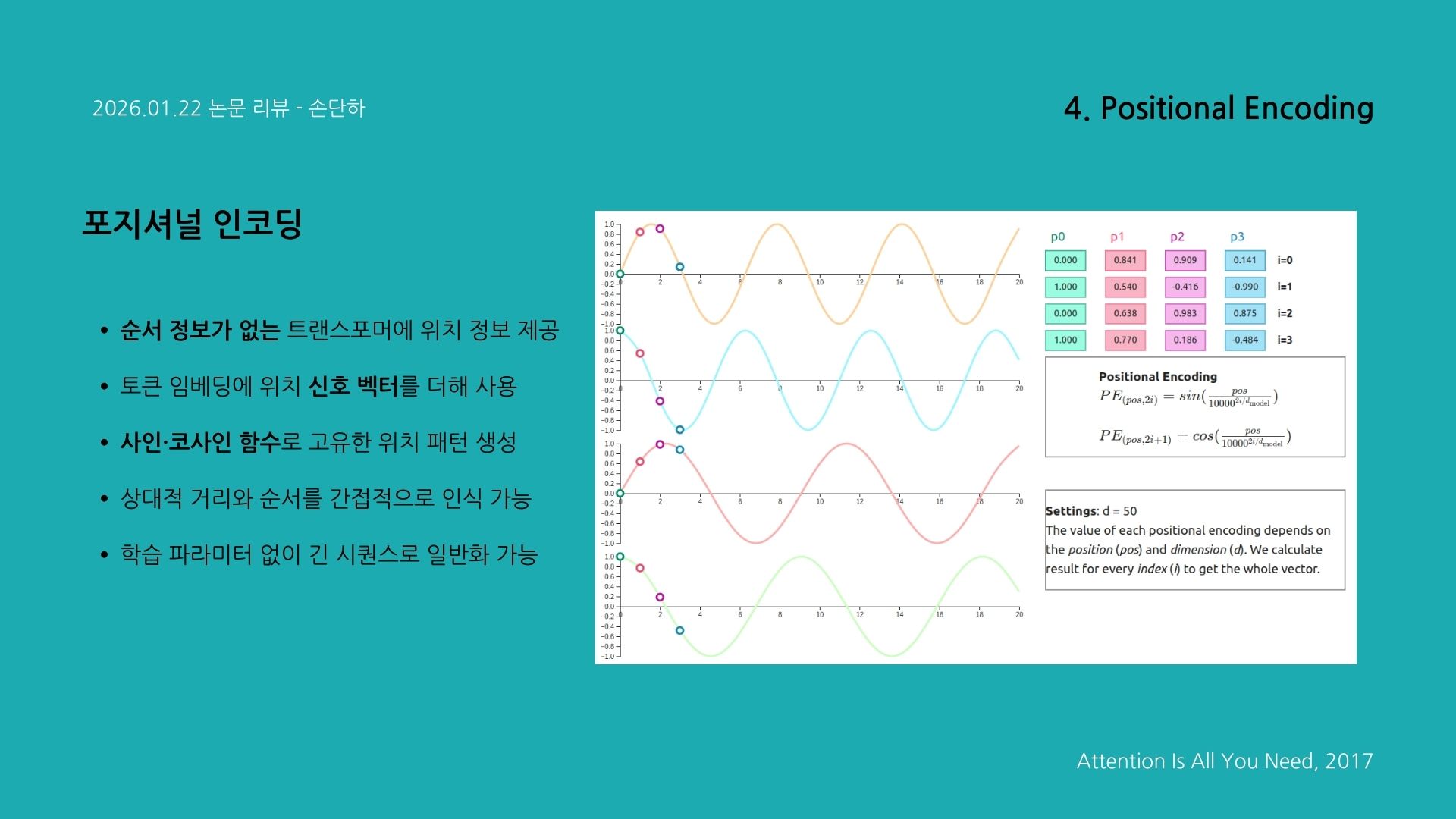

4. 포지셔널 인코딩

5. 잔차연결과 레이어 정규화

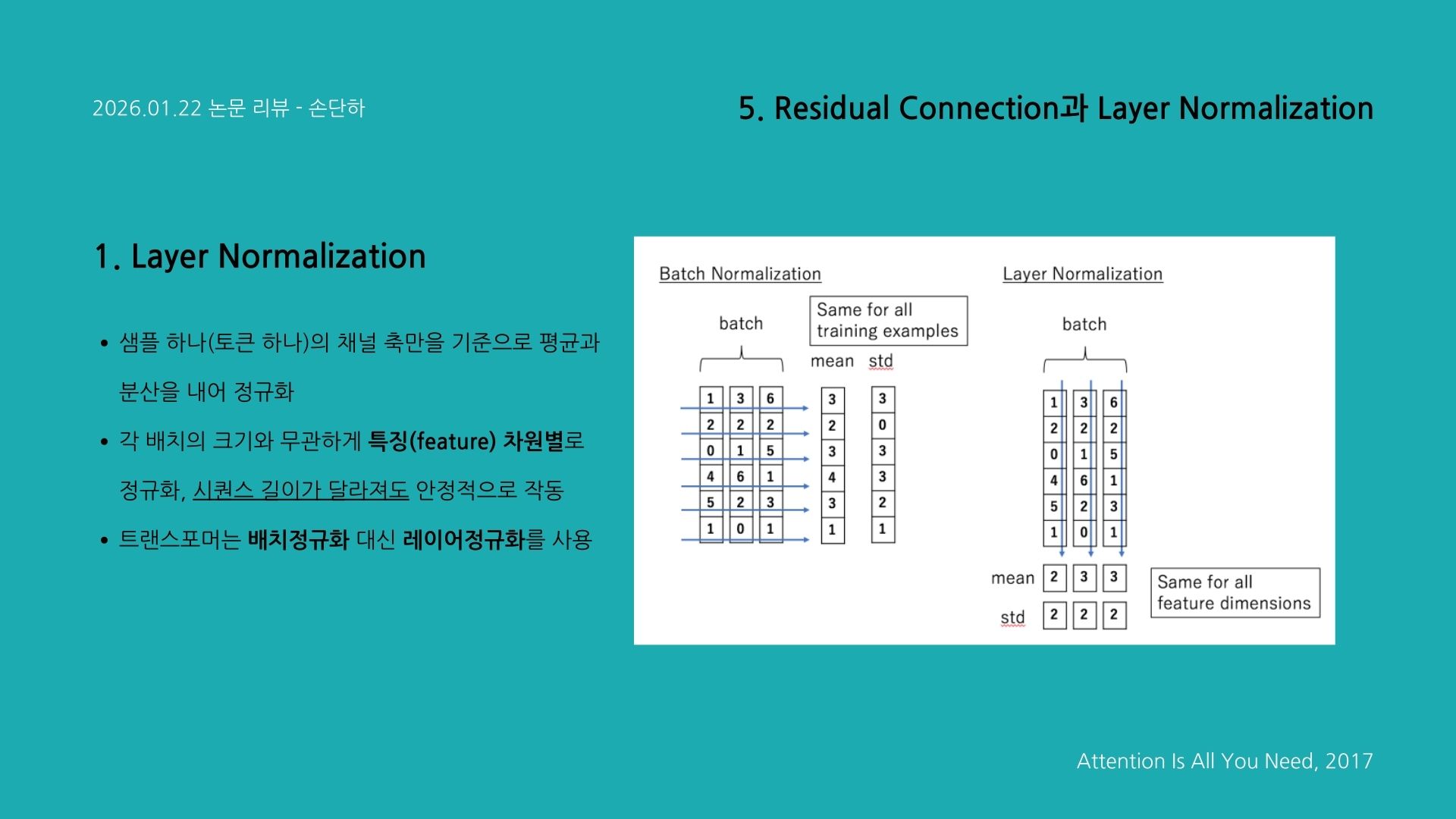

5-1. 레이어 정규화

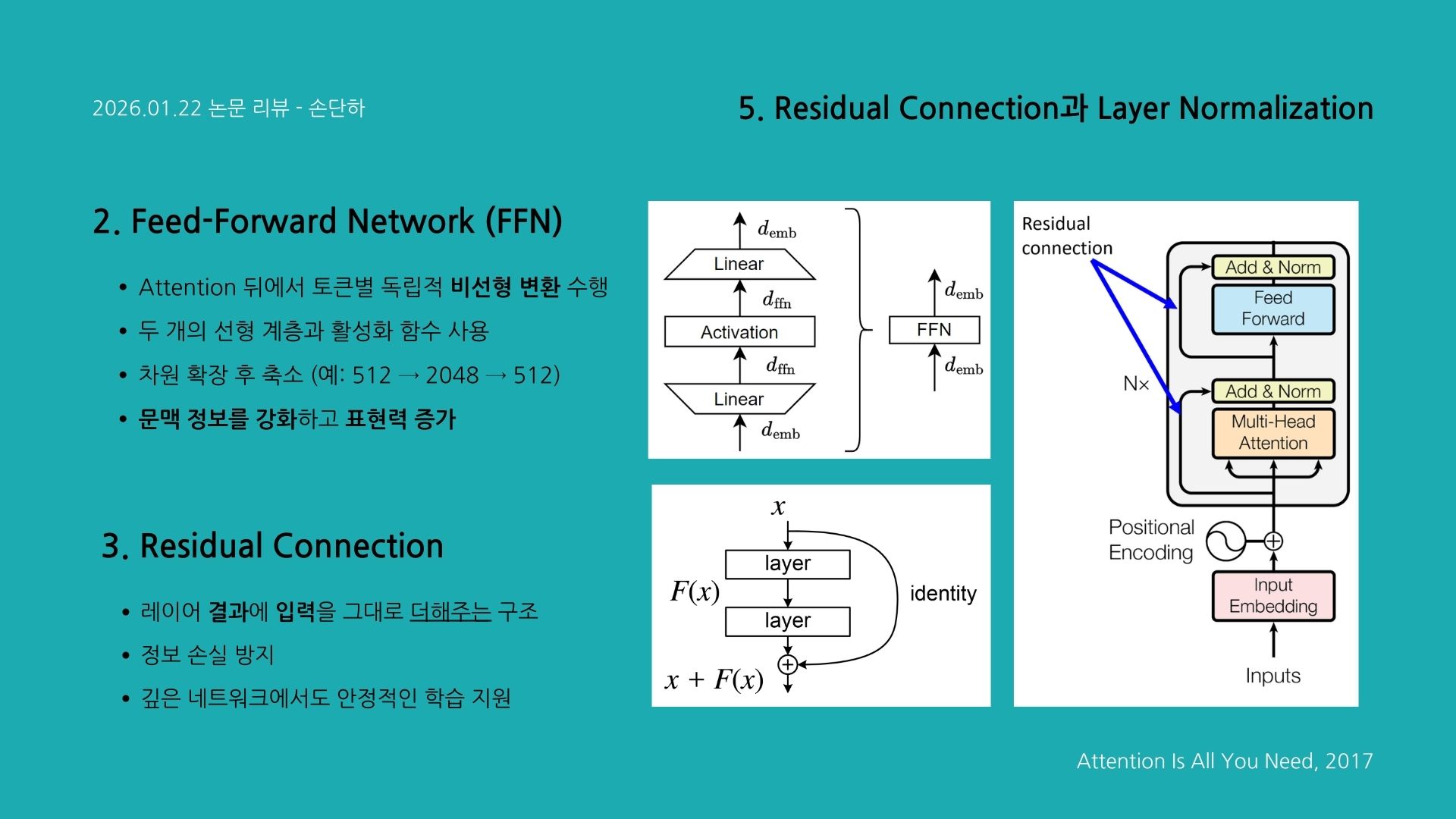

5-2. 피드포워드 네트워크

5-3. 잔차 연결

마치며...