1. 활성화 함수

★ 활성화 함수 (중요)

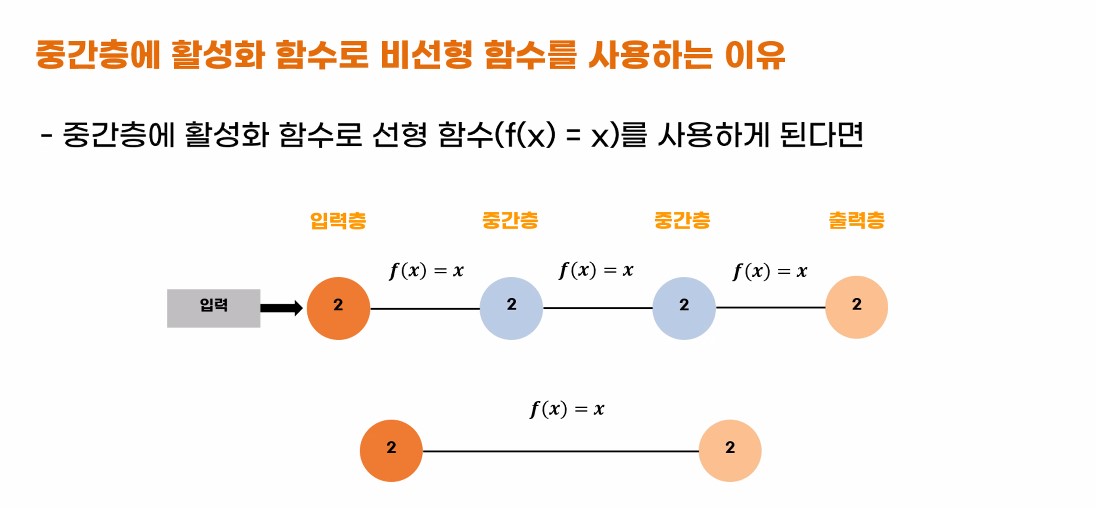

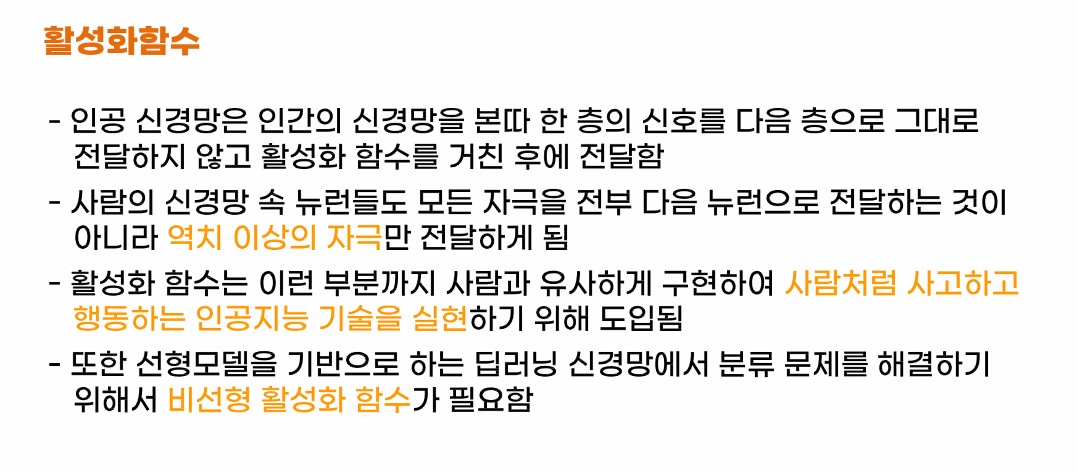

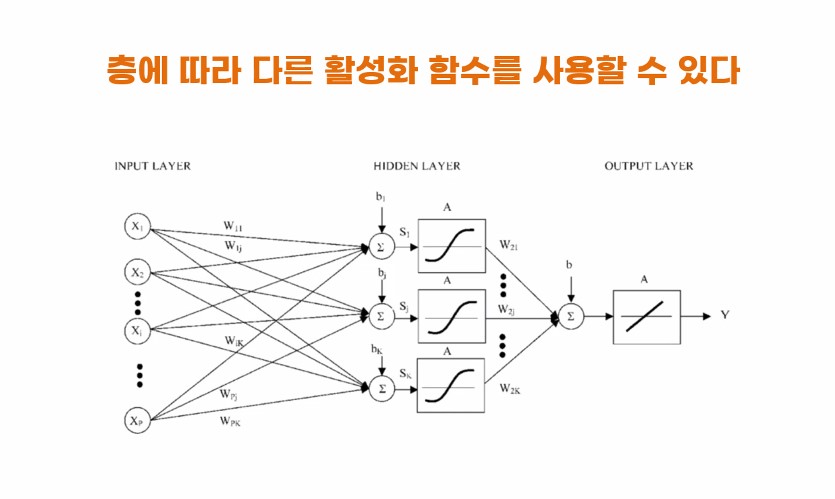

-> 입력층 / 중간층 활성화 함수는 자유롭게 설정할 수 있다.

-> 출력층의 활성화 함수는 사용방법이 정해져 있다.

-

출력층의 활성화 함수 / 뉴런의 갯수 / 손실 함수

-

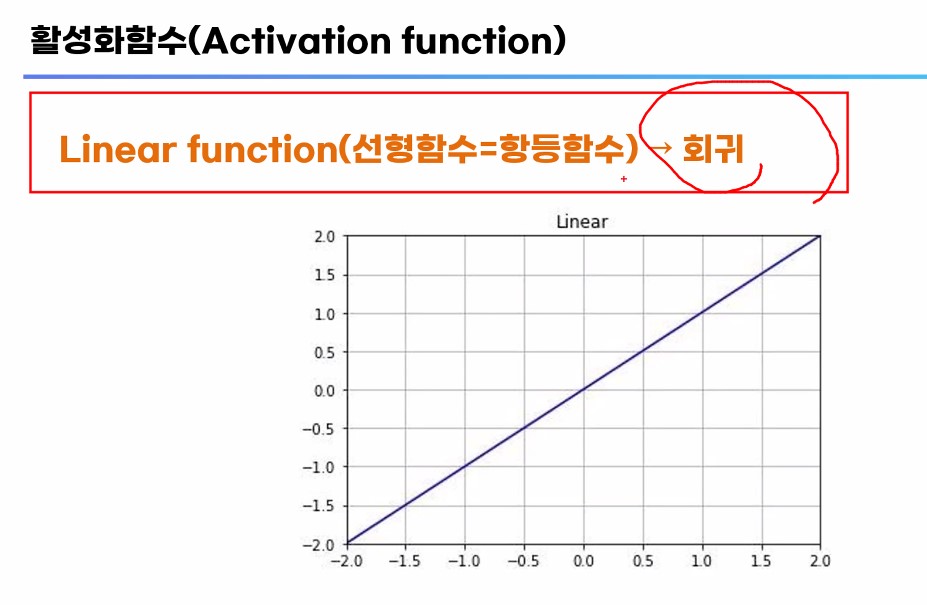

회귀

- 활성화 함수 : 생략 -> 뉴런(y=wx+b)에서 예측된 연속된 실수 값을 그대로 사용하기 때문

- 출력층의 뉴련 갯수 : 1개

- 손실함수(loss) : MSE(평균제곱오차)

-

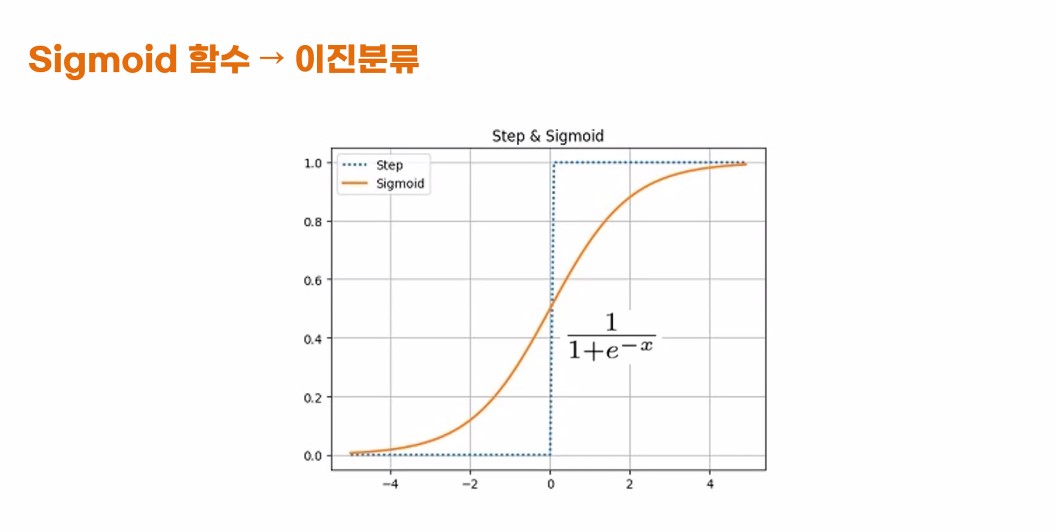

이진 분류

- 활성화 함수 : sigmoid

- 출력층의 뉴련 갯수 : 1개

- 손실함수(loss) : binary_crossentropy

-

다중 분류 -> 이후 수업예정

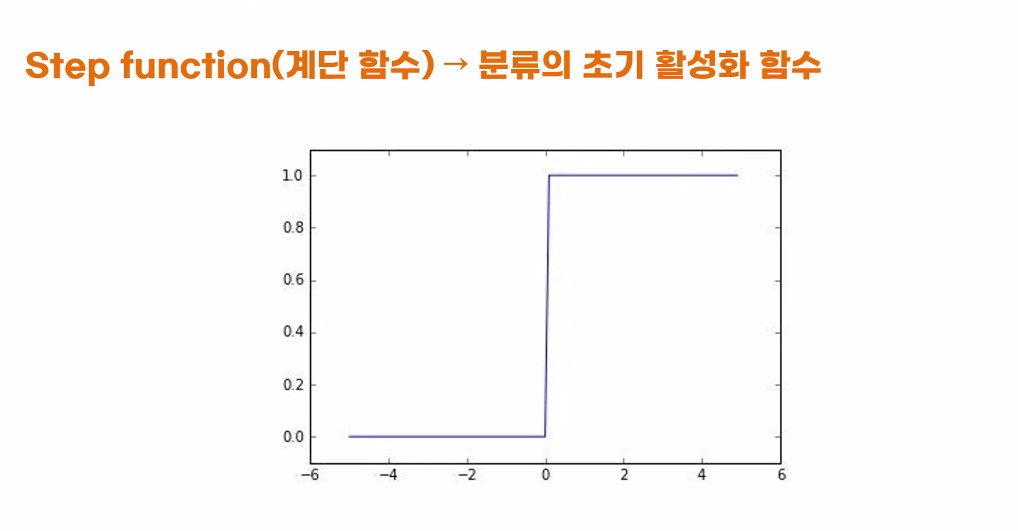

- 계단 함수는 0, 1 뿐인 경직적인 구조(유연한 구조x)

- 시그모이드는 유연하게 판단하기 위해 이진 분류 형으로 계단형의 업그레이드 버전