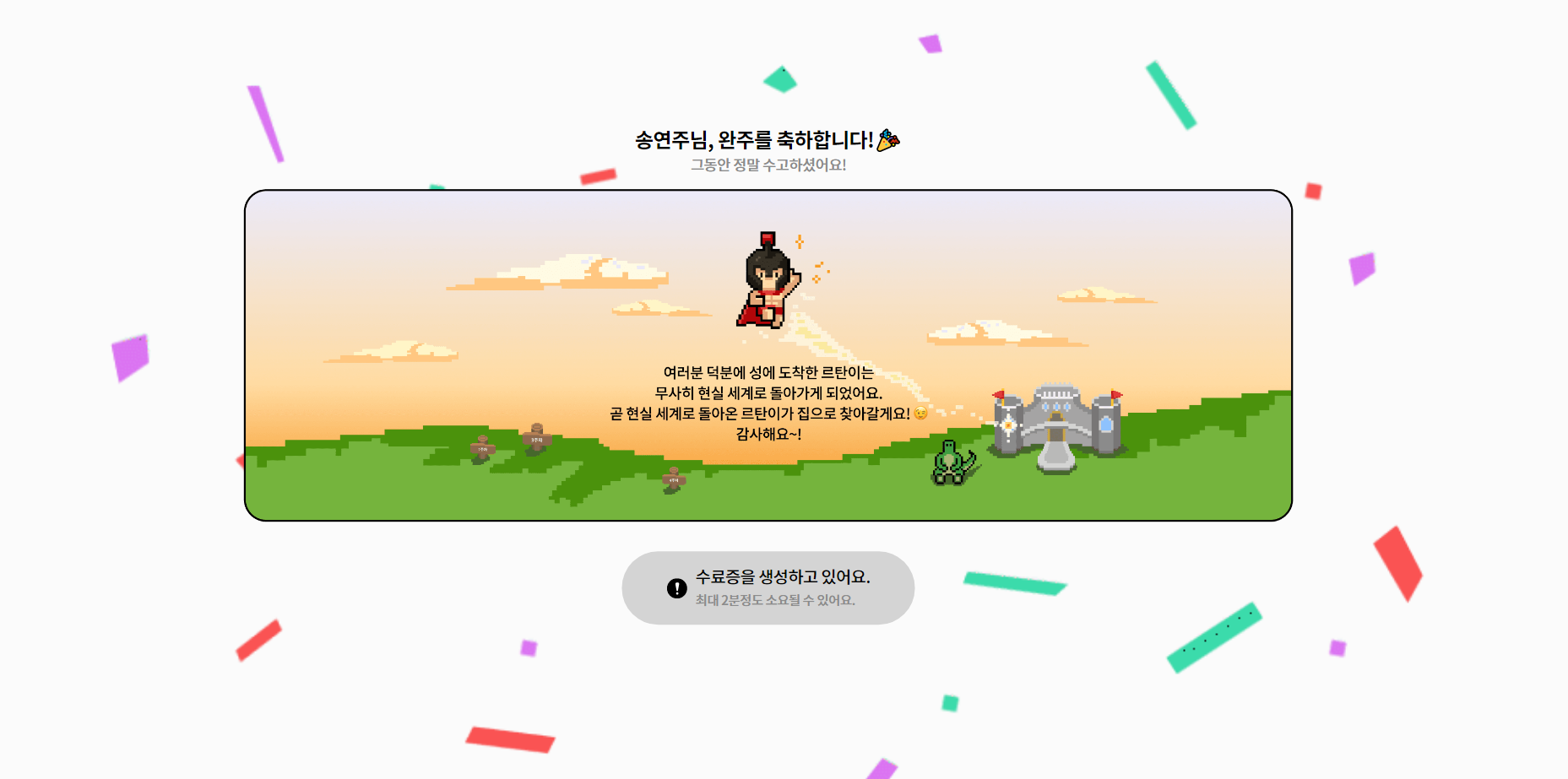

😎다양한 신경망 구조

출처: https://www.cnblogs.com/wangxiaocvpr/p/6247424.html

출처: https://www.cnblogs.com/wangxiaocvpr/p/6247424.html

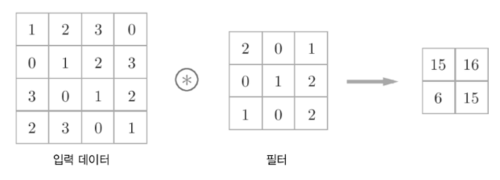

CNN (Convolutional Neural Networks, 합성곱 신경망)

합성곱과 합성곱 신경망

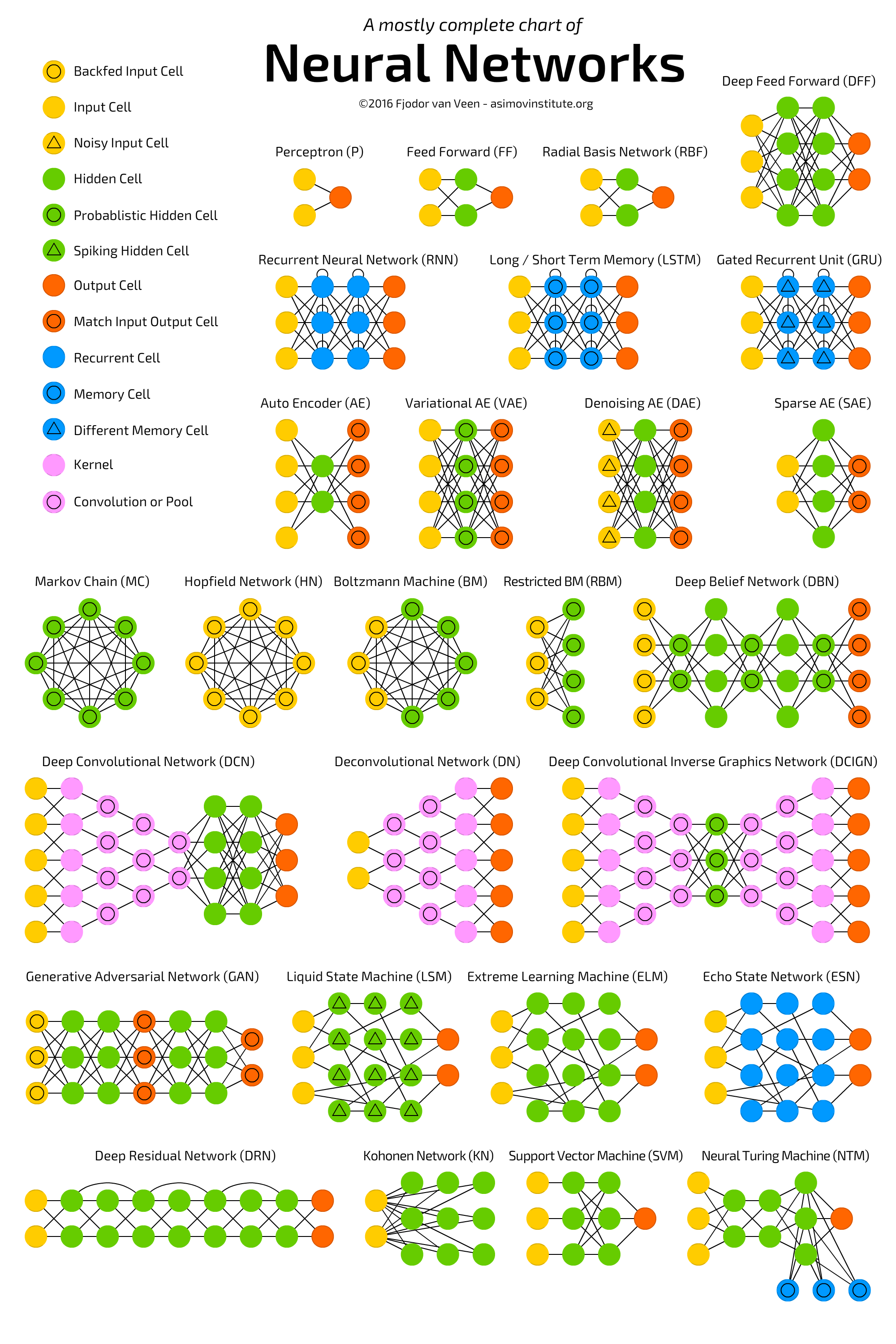

- 합성곱(Convolution)은 예전부터 컴퓨터 비전(CV) 분야에서 많이 쓰이는 이미지 처리 방식으로 계산하는 방식은 아래와 같다. 입력 데이터와 필터의 각각의 요소를 서로 곱한 수 다 더하면 출력값이 된다.

출처 : https://ce-notepad.tistory.com/14

출처 : https://ce-notepad.tistory.com/14 - 이 합성곱을 딥러닝에 활용한 것이 CNN이다. CNN의 발견 이후 딥러닝은 전성기를 이루었고, 이후 얼굴 인식, 사물 인식 등에 널리 사용되며 현재도 이미지 처리에서 가장 보편적으로 사용되는 네트워크 구조이다.

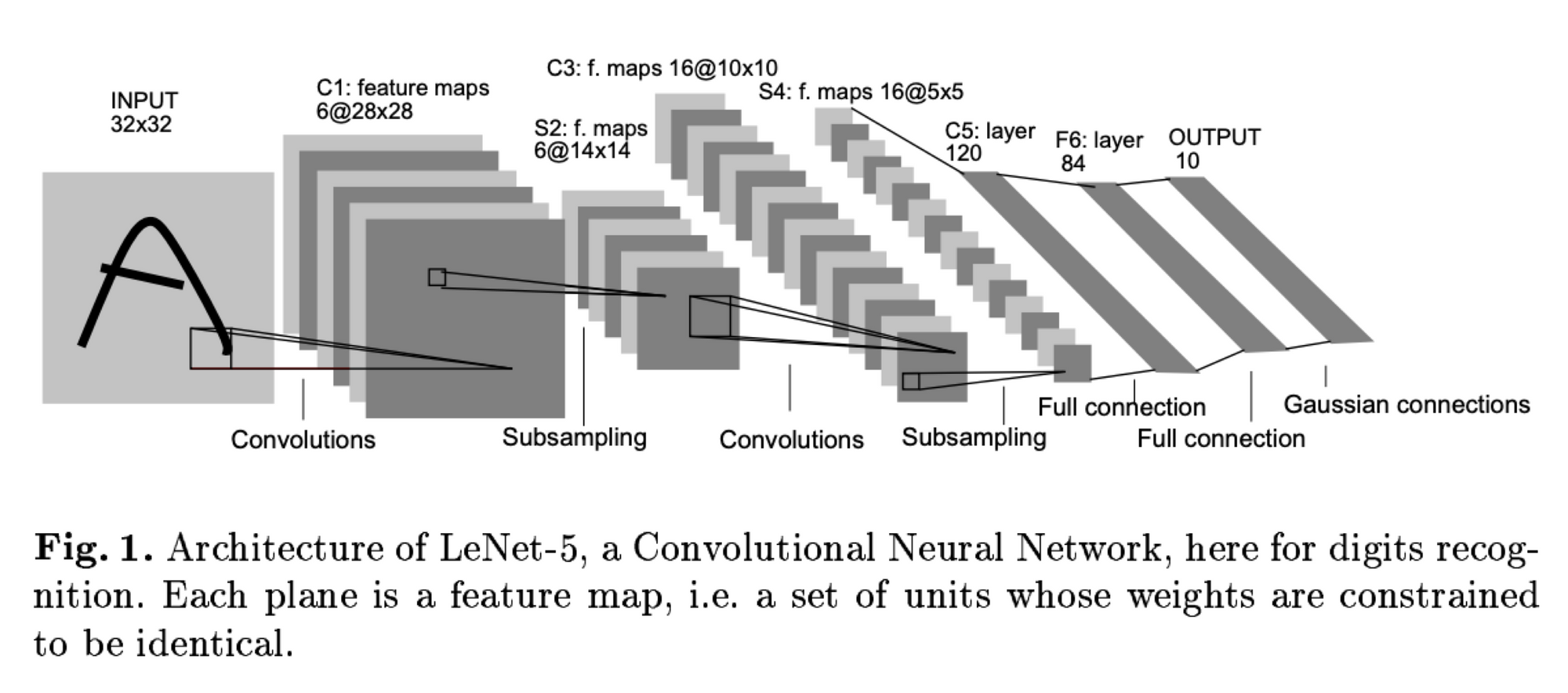

Yann LeCun 교수님의 논문

Yann LeCun 교수님의 논문

Filter, Strides and Padding

🌞 Convolution layer에 대해 알아보자

-

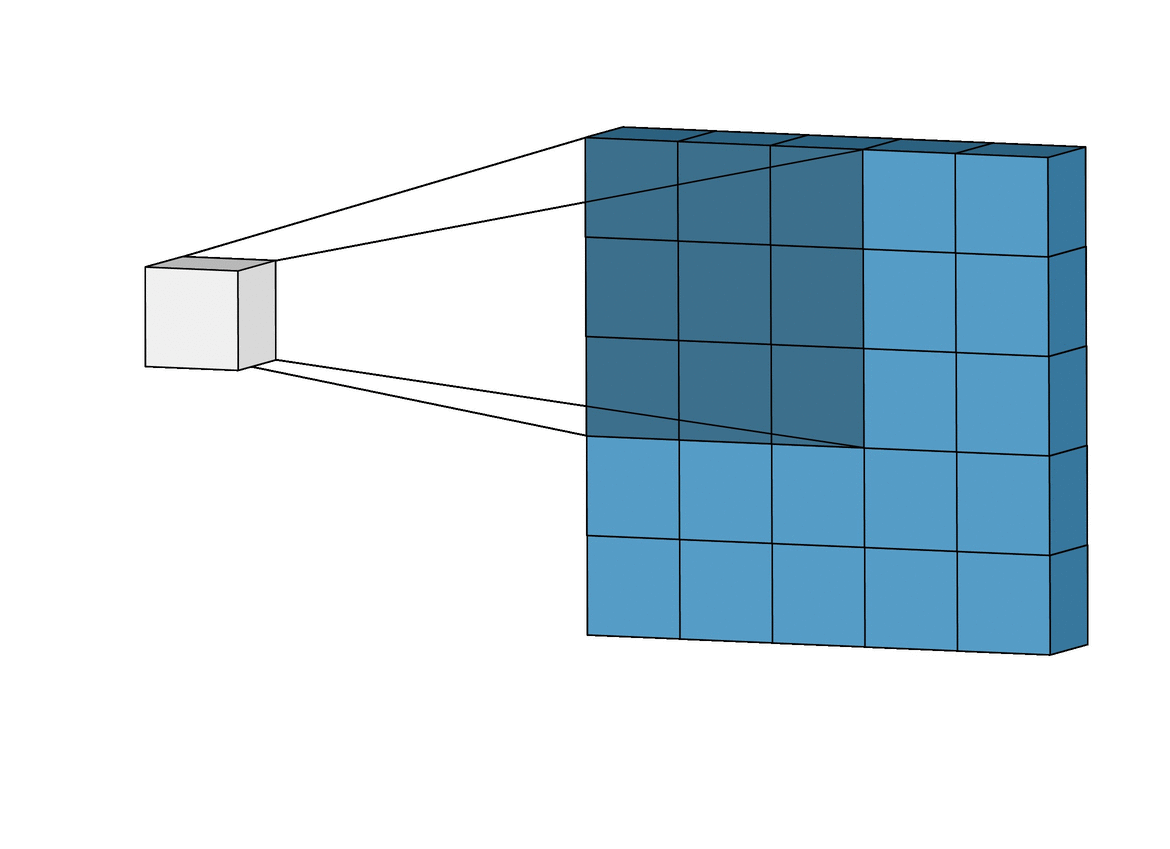

아래와 같이 5x5 크기의 입력이 주어졌을 때, 3x3 짜리 필터를 사용하여 합성곱을 하면 3x3 크기의 Feature map을 뽑아낼 수 잇다. Filter(또는 Kernel)를 한 칸씩 오른쪽으로 움직이며 합성곱 연산을 하는데, 이 때 이동하는 간격을 Stride라고 한다.

출처: https://towardsdatascience.com/intuitively-understanding-convolutions-for-deep-learning-1f6f42faee1

출처: https://towardsdatascience.com/intuitively-understanding-convolutions-for-deep-learning-1f6f42faee1 -

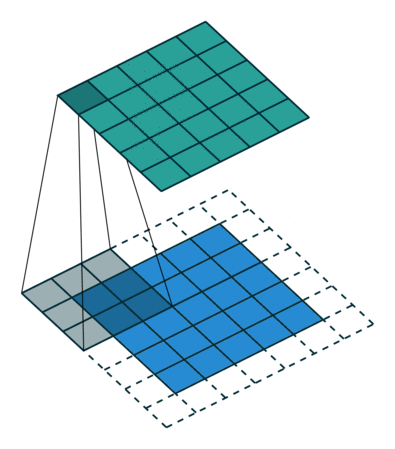

그런데 이렇게 연산을 하게되면 합성곱 연산의 특성상 출력값인 특성 맵의 크기가 줄어든다. 이런 현상을 방지하기 위해서는 Padding(또는 Margin)을 주어, Stride가 1일 때 입력값과 특성 맵의 크기를 같게 만들 수 있다.

출처: https://towardsdatascience.com/intuitively-understanding-convolutions-for-deep-learning-1f6f42faee1

출처: https://towardsdatascience.com/intuitively-understanding-convolutions-for-deep-learning-1f6f42faee1 -

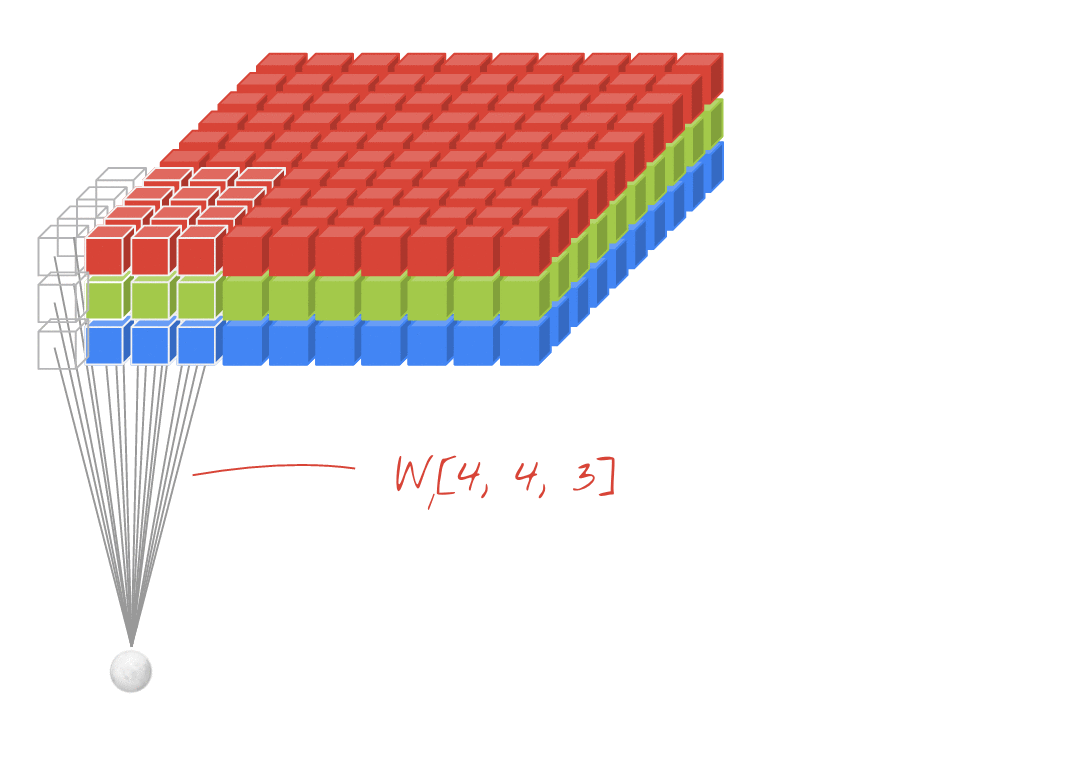

위에서는 1개의 필터를 사용하여 연산을 하였지만 여러개의 필터를 이용하여 합성곱 신경망의 성능을 높일 수 있다. 그리고 이미지는 3차원(가로, 세로, 채널)이므로 아래와 같은 모양이 된다. 이 그림에서 각각의 입력과 출력은 다음과 같다.

- 입력 이미지 크기 : (10, 10, 3)

- 필터의 크기 : (4, 4, 3)

- 필터의 개수 : 2

- 출력 특성 맵의 크기 : (10, 10, 2)

출처: https://stackoverflow.com/questions/42883547/intuitive-understanding-of-1d-2d-and-3d-convolutions-in-convolutional-neural-n

출처: https://stackoverflow.com/questions/42883547/intuitive-understanding-of-1d-2d-and-3d-convolutions-in-convolutional-neural-n

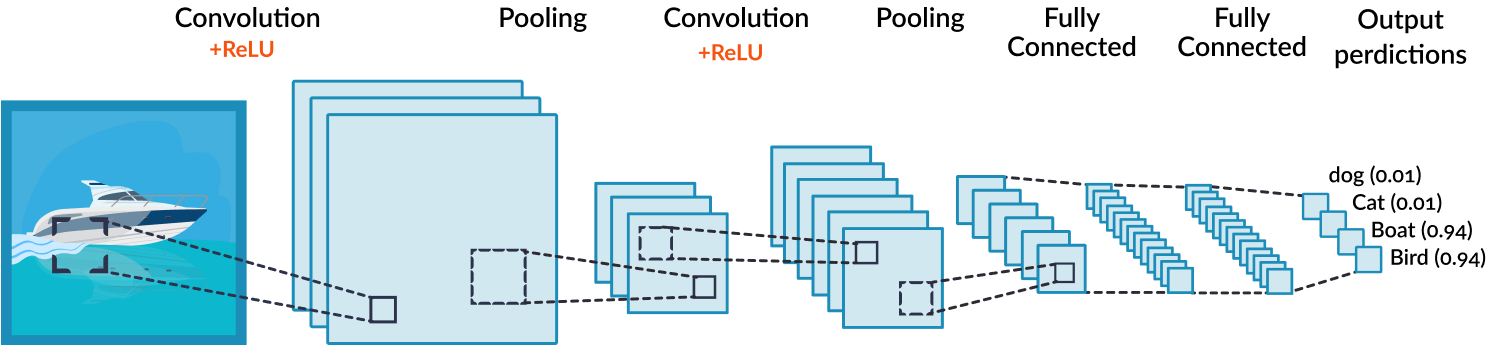

CNN의 구성

CNN의 구성

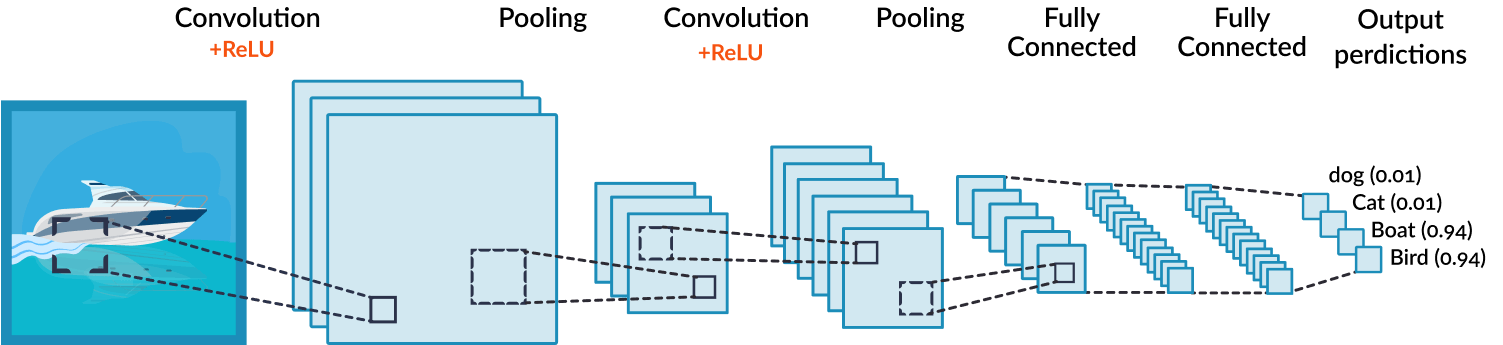

- CNN은 Convolution layer와 Dense layer을 함께 사용한다.

출처: https://teknoloji.org/cnn-convolutional-neural-networks-nedir/

출처: https://teknoloji.org/cnn-convolutional-neural-networks-nedir/ - Convolution layer + 활성화 함수 + 풀링을 반복하며 점점 작아지지만 핵심적인 특성들을 뽑아낸다. 여기서 Pooling layer는 특성 맵의 중요 부분을 추출하여 저장하는 역할을 한다.

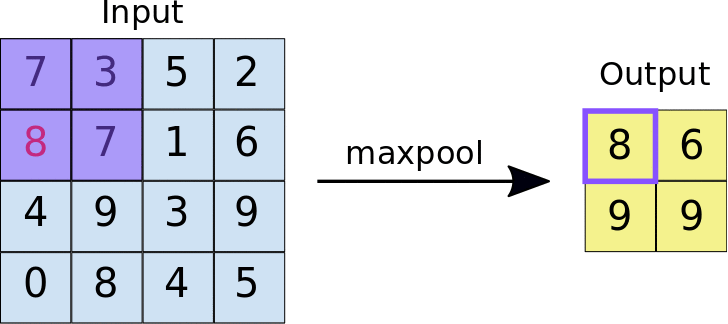

- 아래의 이미지는 Max pooling의 예시이다. 2x2 크기의 Pool size로 stride 2의 Max pooling 계층을 통과할 경우 2x2 크기의 feature map에서 가장 큰 값들을 추출한다.

출처: https://developers.google.com/machine-learning/practica/image-classification/convolutional-neural-networks

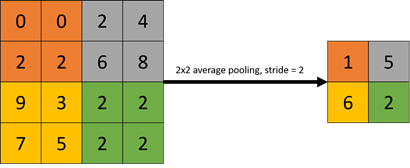

출처: https://developers.google.com/machine-learning/practica/image-classification/convolutional-neural-networks - 아래는 Average pooling의 예시이다. Max pooling에서는 2x2 크기의 feature map에서 최대값을 추출했다면, Average pooling은 평균 값을 추출하는 방식이다.

출처: https://www.kaggle.com/questions-and-answers/59502

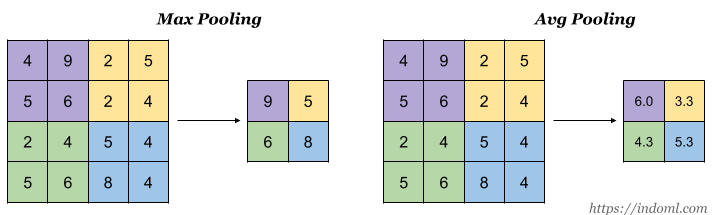

출처: https://www.kaggle.com/questions-and-answers/59502 - Max pooling vs Average pooling

출처: https://towardsdatascience.com/beginners-guide-to-understanding-convolutional-neural-networks-ae9ed58bb17d

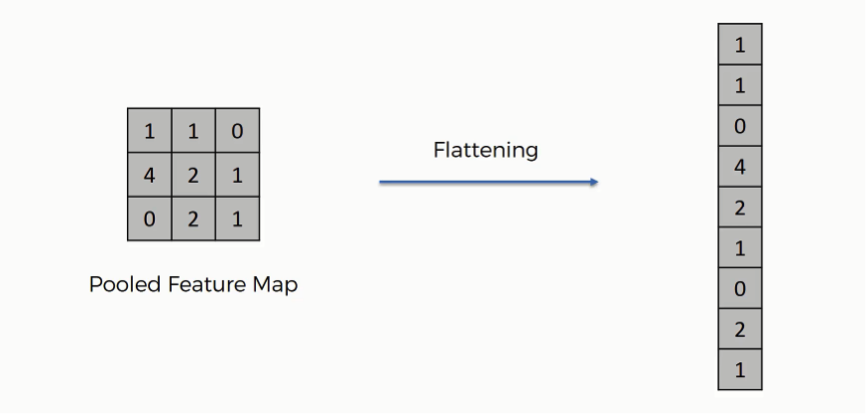

출처: https://towardsdatascience.com/beginners-guide-to-understanding-convolutional-neural-networks-ae9ed58bb17d - 두번째 Pooling layer를 지나면 dense layer와 연결이 되어야 하는데 pooling을 통과한 feature map은 2차원이고 dense layer는 1차원이므로 연산이 불가능하다.

출처: https://teknoloji.org/cnn-convolutional-neural-networks-nedir/

출처: https://teknoloji.org/cnn-convolutional-neural-networks-nedir/ - 따라서 우리는 Flatten layer를 사용해서 2차원을 1차원으로 펼치는 작업을 하게된다.

출처:https://www.superdatascience.com/blogs/convolutional-neural-networks-cnn-step-3-flattening

출처:https://www.superdatascience.com/blogs/convolutional-neural-networks-cnn-step-3-flattening - Flatten layer를 통과하게 되면 우리는 Dense layer에서 행렬 곱셈을 할 수 있게 되고 마찬가지로 Dense layer + 활성화함수의 반복을 통해 점점 노드의 개수를 축소시키다가 마지막에 Softmax 활성화 함수를 통과하고 출력층으로 결과를 출력하게 된다.

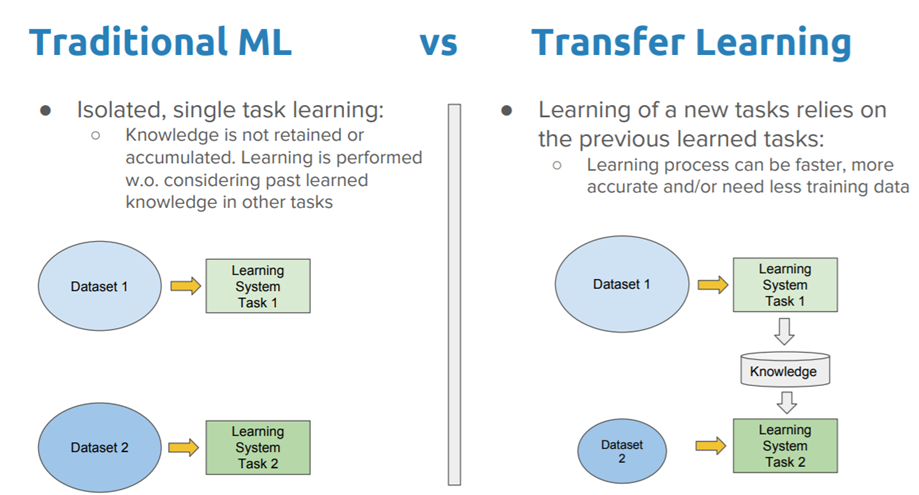

Transfer Learning (전이 학습)

전이 학습

- 과거에 문제를 해결하면서 축적된 경험을 토대로 그것과 유사한 문제를 해결하도록 신경망을 학습시키는 방법을 전이 학습이라고 한다. 전이 학습은 비교적 학습 속도가 빠르고(빠른 수렴), 더 정확하고, 상대적으로 적은 데이터셋으로 좋은 결과를 낼 수 있기 때문에 실무에서도 자주 사용하는 방법이다.

출처: https://towardsdatascience.com/a-comprehensive-hands-on-guide-to-transfer-learning-with-real-world-applications-in-deep-learning-212bf3b2f27a

출처: https://towardsdatascience.com/a-comprehensive-hands-on-guide-to-transfer-learning-with-real-world-applications-in-deep-learning-212bf3b2f27a - 전이 학습은 미리 학습시킨 모델(pretrained models)을 가져와 새로운 데이터셋에 대해 다시 학습시키는 방법이다. 꽤나 다른 형태의 데이터셋에 대해서도 효과를 보인다고 한다.

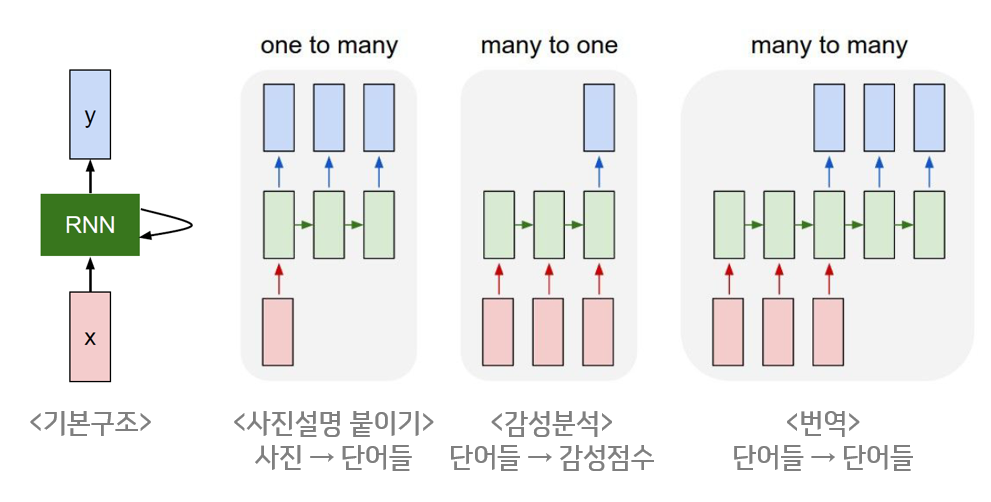

RNN (Recurrent Neural Networks, 순환 신경망)

RNN

은닉층이 순차적으로 연결되어 순환구조를 이루는 인공 신경망의 한 종류

- 음성, 문자 등 순차적으로 등장하는 데이터 처리에 적합한 모델

- 길이에 관계없이 입력과 출력을 받아들일 수 있는 구조이기 때문에, 필요에 따라 다양하고 유연하게 구조를 만들 수 있다.

출처: https://ratsgo.github.io/natural language processing/2017/03/09/rnnlstm/

출처: https://ratsgo.github.io/natural language processing/2017/03/09/rnnlstm/

GAN (Generative Adversarial Network, 생성적 적대 신경망)

GAN

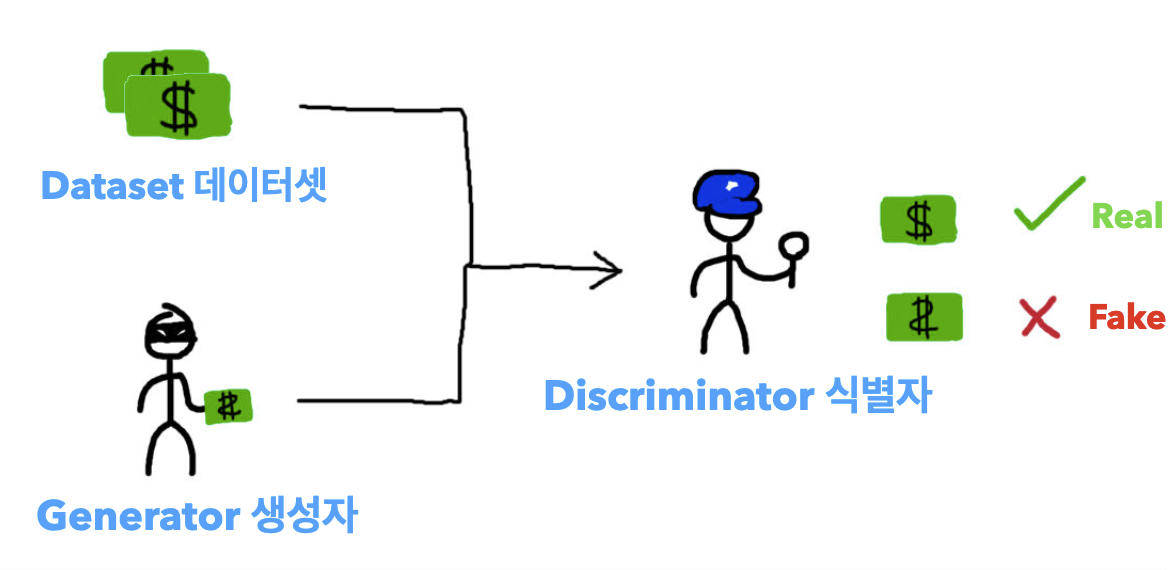

서로 적대(Adversarial)하는 관계의 2가지 모델(생성 모델과 판별 모델)을 동시에 사용하는 기술

GAN은 위조지폐범과 이를 보고 적발하는 경찰의 관계로 설명할 수 있다.

GAN은 위조지폐범과 이를 보고 적발하는 경찰의 관계로 설명할 수 있다.

- 생성 모델 (위조지폐범) : 경찰도 구분 못하는 진짜같은 위조지폐를 만들자!

- 판별 모델 (경찰) : 진짜 지폐와 위조 지폐를 잘 구분해내자!

이와 같이 계속 진행되면 위조지폐범은 더욱 정교하게, 경찰은 더욱 판별을 잘 하면서 서로 발전의 관계가 되어 원본과 구별이 어려운 가짜 이미지가 만들어지게 된다.