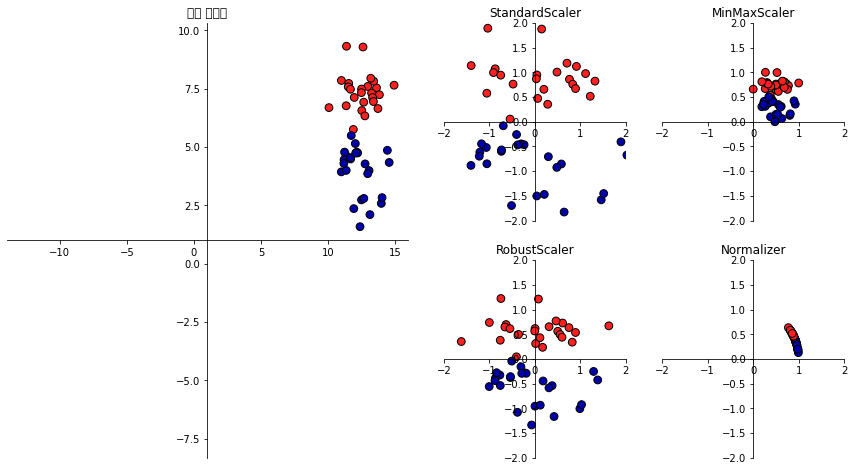

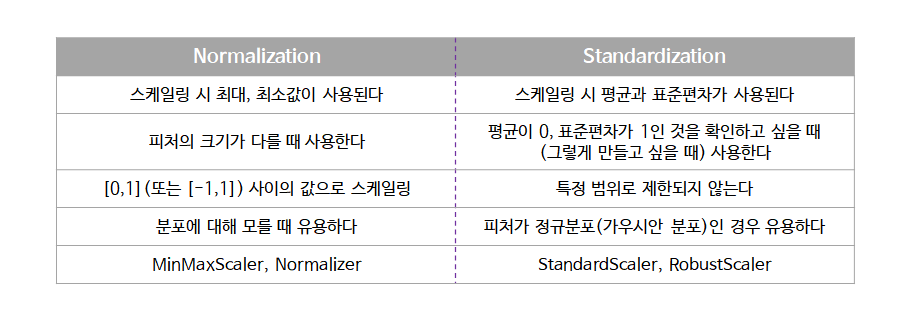

정규화(Normalization) : MinMaxScaler, Normalizer

표준화(Standardization) : StandardScaler, RobustScaler

1. StandardScaler

- 각 특성의 평균을 0, 분산을 1로 변경하여 모든 특성이 같은 크기를 가지게 한다(표준정규분포)

- 특성의 최솟값과 최댓값 크기를 제한하지 않는다

- 이상치가 있다면 평균과 표준편차에 영향을 미쳐 변환된 데이터의 확산은 매우 달라지게 된다

2. MinMaxScaler

- 모든 특성이 정확하게 0과 1 사이에 위치하도록 데이터를 변경한다

- 이상치가 있다면 평균과 표준편차에 영향을 미쳐 변환된 데이터의 확산은 매우 달라지게 된다

3. RobustScaler

- 특성들이 같은 스케일을 가지게 한다

- 평균과 분산 대신 중간값(median)과 사분위값(quantile)을 사용하고 outlier의 영향을 받지 않는다

4. Normalizer

- 특성 벡터의 유클리디안 길이가 1이 되도록 데이터 포인트를 조정한다

(지름이 1인 원에 데이터 포인트 투영) - 데이터의 방향 또는 각도가 중요할 때 많이 사용한다

5. QuantileTransformer

- 1000개의 quantile을 이용해서 데이터를 균등하게 분포시킨다

- 이상치에 민감하지 않고 0~1사이로 압축한다

6. PowerTransformer

- 데이터의 특성별로 정규분포형태에 가깝도록 변환

- 특성별 히스토그램을 확인해야함