✅ 혼자 공부하는 머신러닝+딥러닝

진도: Chapter 07

기본 미션: Ch.07-1 확인 문제 풀고, 풀이 과정 정리하기

선택 미션: Ch.07-2 확인 문제 풀고, 풀이 과정 정리하기

기본 미션: Ch.07-1 확인 문제 풀고, 풀이 과정 정리하기

-

3번. 총 1010개의 모델 파라미터: 10개 절편 (10개 뉴런 x 1개 절편) + 1000개 가중치 (100개의 입력 특성 x 밀집층 10개 뉴런).

-

2번. 시그모이드 sigmoid 함수 사용.

케라스의 Dense 클래스 사용해서 신경망의 출력층을 만들 때, 이진 분류 모델이면 activation 매개변수 활성화 함수는 시그모이드. 뉴런 1개, 선형 방정식 결과를 확률로 바꿈. 시그모이드 함수는 층이 많을수록 활성화 함수의 양쪽 끝에서 변화가 작기 때문에 학습이 어려워짐. -

4번. compile() 매서드는 모델 객체를 만든 후 훈련하기 전에 사용할 손실함수와 측정 지표를 지정. loss 매개변수에 손실함수 지정. 이진 분류일 경우 binary_crossentropy, 다중 분류일 경우 categorical_crossentropy로 지정. 회귀 모델의 경우 mean_square_error 지정. metrics 매개변수에 훈련 과정에서 측정하고 싶은 지표 지정 가능. 측정 지표가 1개 이상일 경우 리스트로 전달.

-

1번. compile() 매서드의 loss 매개변수에 sparse categorical_crossentropy를 지정하면 정수 레이블을 타깃으로 가지는 다중 분류 문제 풀기 가능.

마지막 6주차~ 아쉬움이 커지는 소리

선택 미션: Ch.07-2 확인 문제 풀고, 풀이 과정 정리하기

-

add() 매서드 사용법 올바른 것은? 2번

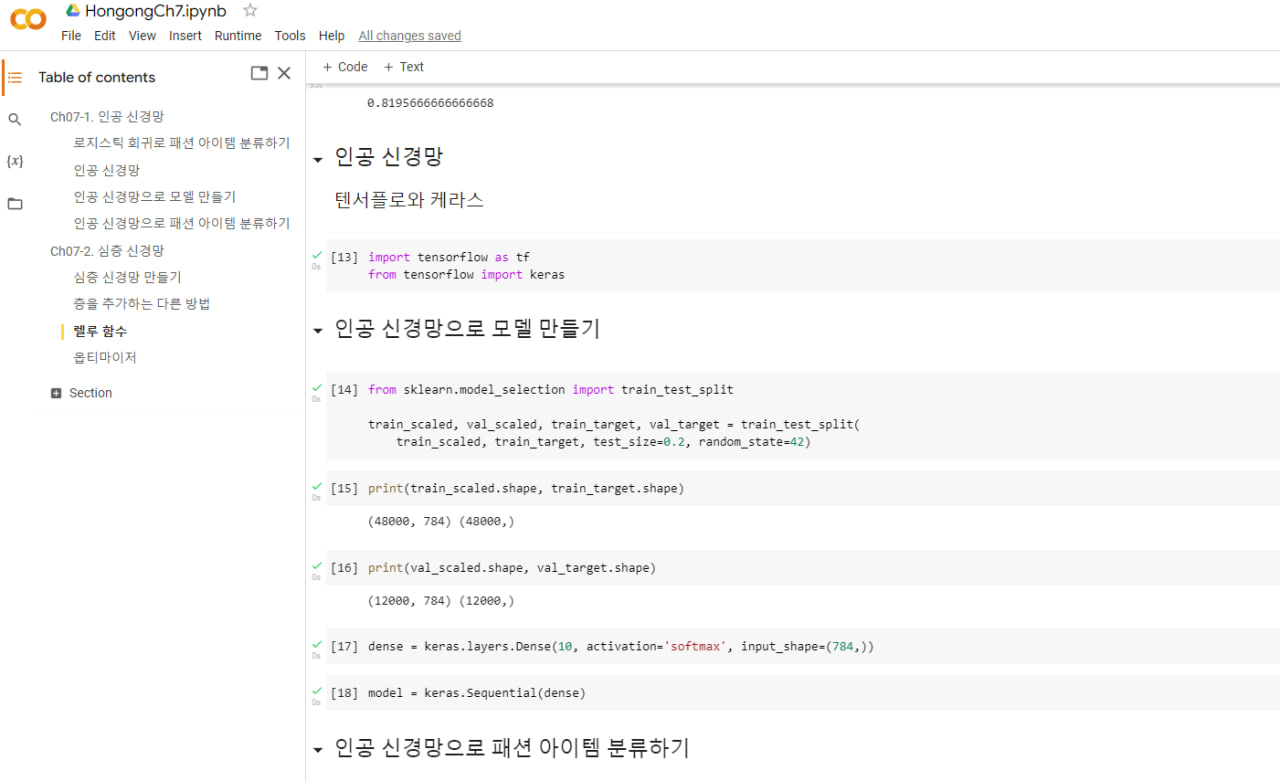

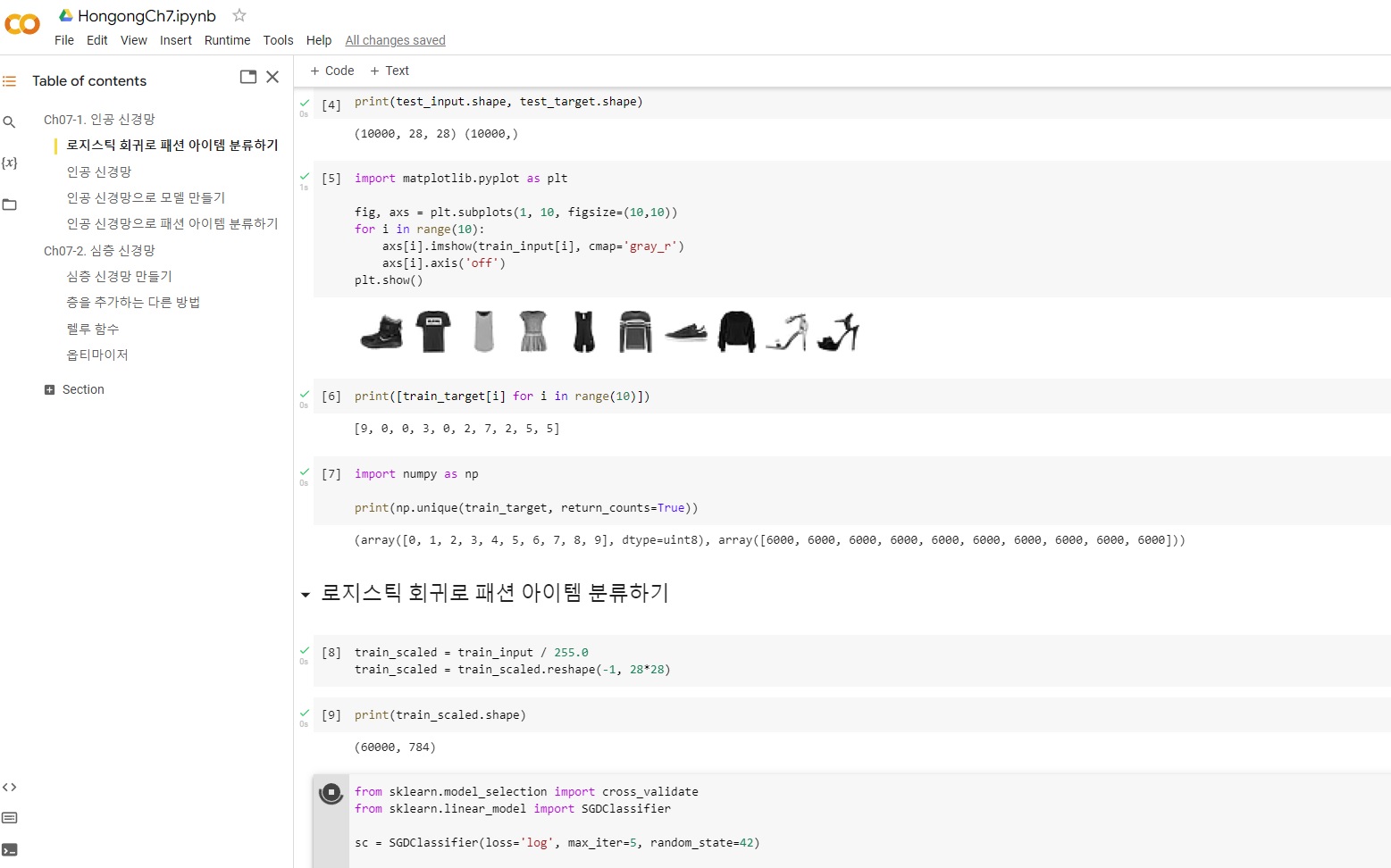

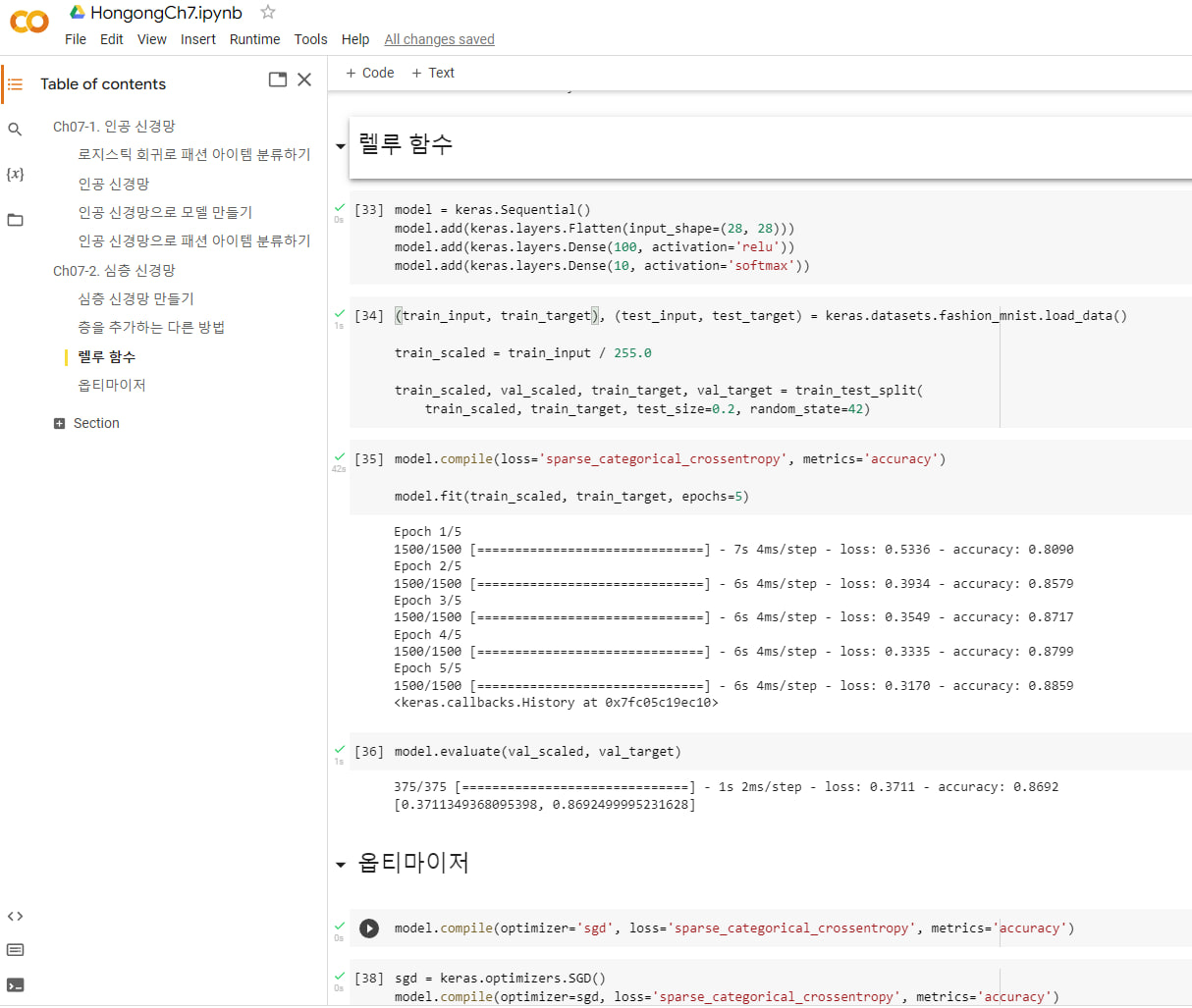

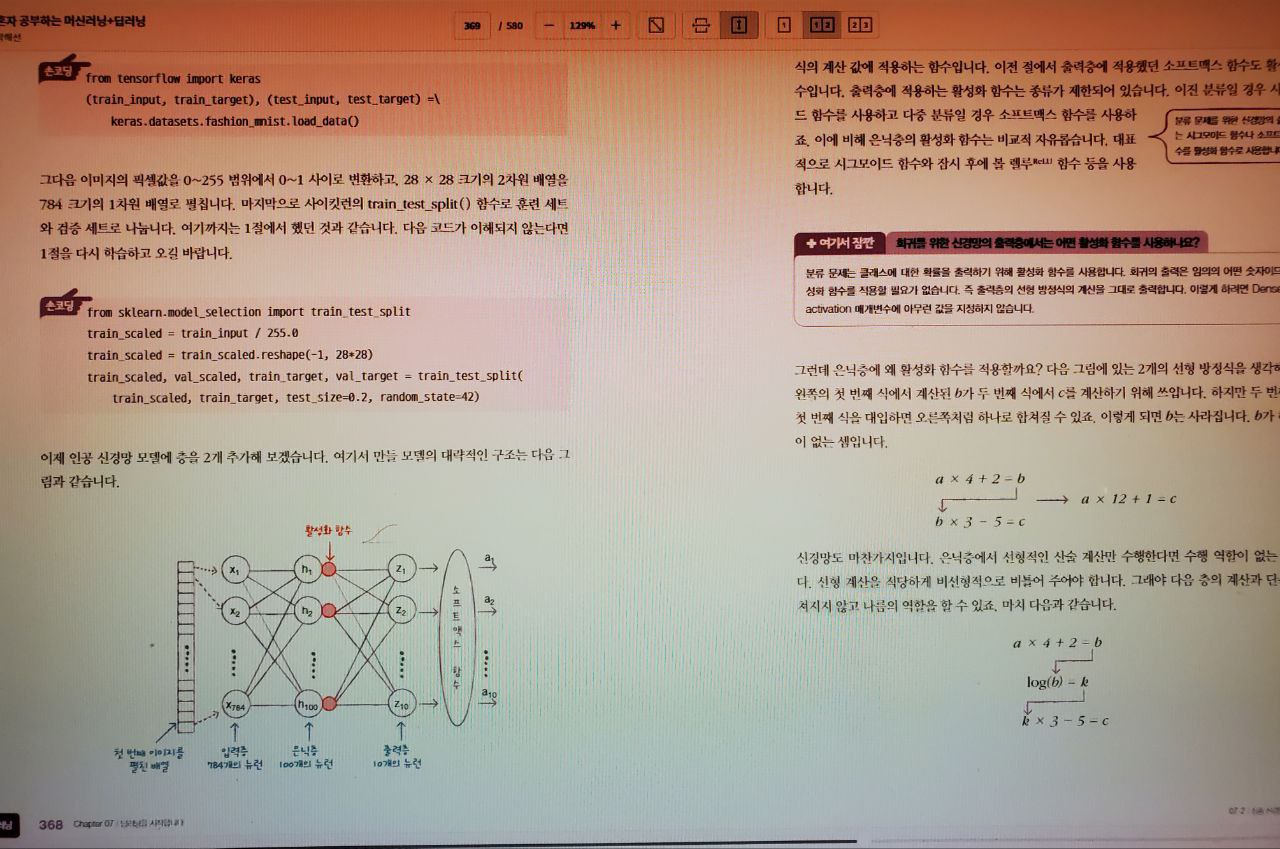

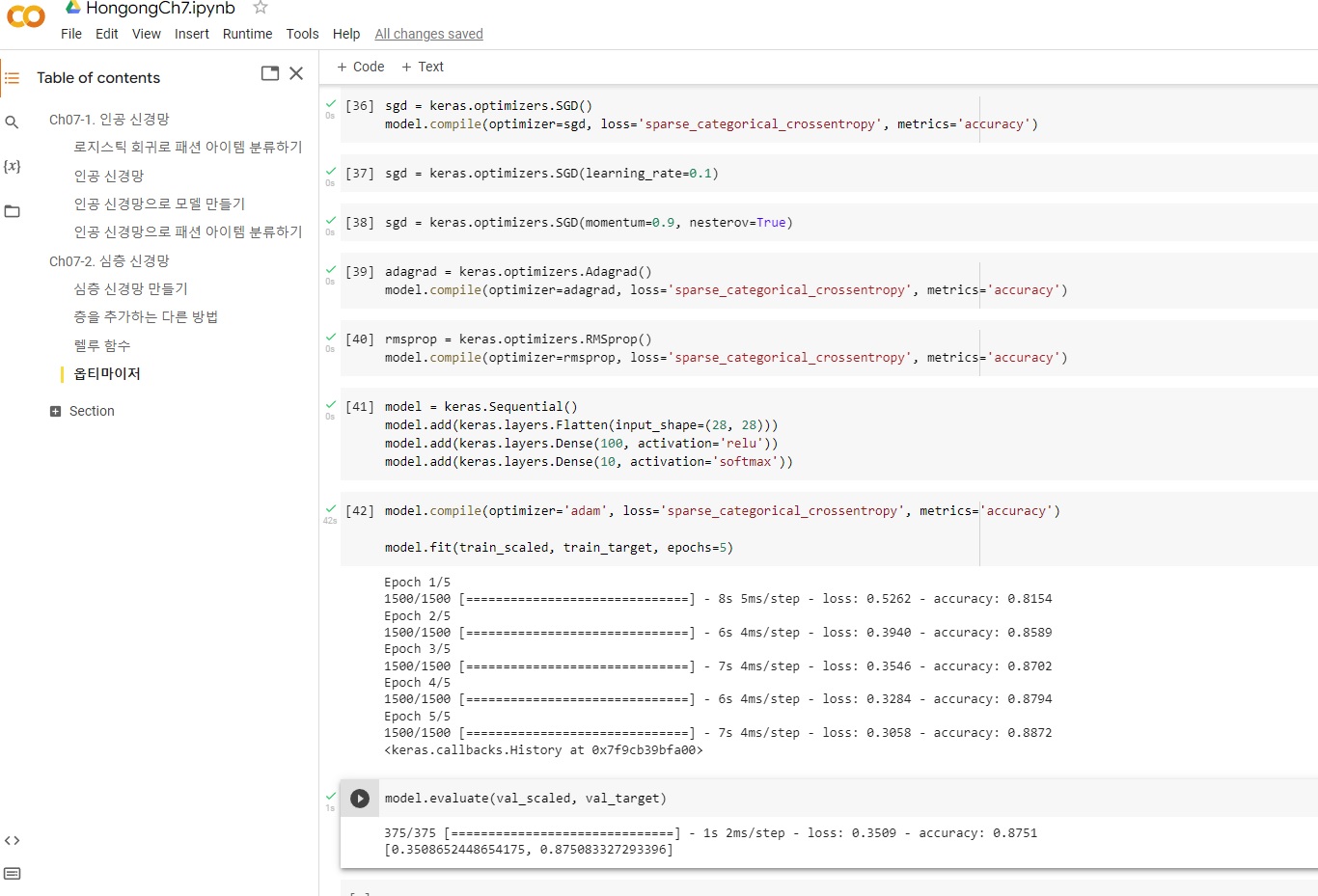

model.add(keras.layers.Dense(10, activation='relu'))가 맞다. add()는 케라스 모델에 층을 추가하는 매서드. 층의 객체를 입력 받아 신경망 모델에 추가. add() 매서드를 호출하여 전달한 순서대로 층이 차례로 늘어남.코렙 예제

model = keras.Sequential()

model.add(keras.layers.Flatten(input_shape=(28, 28)))

model.add(keras.layers.Dense(100, activation='relu'))

model.add(keras.layers.Dense(10, activation='softmax'))

-

2번. Flatten 클래스 사용해서 300x300 크기인 입력을 케라스 층으로 일렬로 펼친다. 이 클래스는 배치 차원을 제외하고 나머지 입력 차원을 모두 일렬로 펼침.

-

3번. relu 활성화 함수가 심층 신경망 이미지 처리 작업에 사용된다. 심층 신경망은 2개 이상의 층을 포함한 신경망으로 다중 인공 신경망, 심층 신경망, 딥러닝을 같은 의미로 사용. 렐루 함수는 이미지 분류 모델의 은닉층에 많이 사용하는 활성화 함수.

렐루함수는 이미지 분류 모델의 은닉층에 많이 사용하는 활성화 함수.

시그모이드 함수는 층이 많을수록 활성화 함수의 양쪽 끝에서 변화가 작기 때문에 학습이 어려워짐. 렐루함수는 이런 문제 없고 계산도 간단.

분류 문제는 클래스에 대한 확률 출력위해 활성화 함수 사용. 시그모이드나 소프트맥스 함수. 회귀를 위한 신경망 출력층에는 활성화 함수 적용 필요 없고 선형방정식 계산 그대로 출력.

- 1번. SGD 클래스는 기본 경사 하강법 옵티마이저 클래스. 모멘텀 매개변수에 0이상의 값을 지정하면 모멘텀 최적화를 수행. 네스테로프 nesterov 매개변수를 True로 설정하면 네스테로프 모멘텀 최적화를 수행. 일정한 학습률을 사용.

보너스

텐서플로우 옵티마이저

끝날 때까지 끝난 것이 아니다. 우리에게는 8장과 9장이 남아 있다.

__ 07-3 신경망 모델 훈련 ▶️인경 신경망 모델 훈련의 모범 사례 학습하기

____ 손실 곡선

____ 검증 손실

____ 드롭아웃

____ 모델 저장과 복원

____ 콜백

____ [문제해결 과정] 최상의 신경망 모델 얻기

____ 키워드로 끝내는 핵심 포인트

____ 핵심 패키지와 함수

____ 확인 문제

Chapter 08 이미지를 위한 인공 신경망 ▶️패션 럭키백의 정확도를 높입니다!

__ 08-1 합성곱 신경망의 구성 요소 ▶️합성곱 신경망의 개념과 동작 원리를 배우고 간단한 실습하기

____ 합성곱

____ 케라스 합성곱 층

____ 합성곱 신경망의 전체 구조

____ [문제해결 과정] 합성곱 층과 풀링 층 이해하기

____ 키워드로 끝내는 핵심 포인트

____ 확인 문제

__ 08-2 합성곱 신경망을 사용한 이미지 분류 ▶️케라스 API로 합성곱 신경망 모델 만들기

____ 패션 MNIST 데이터 불러오기

____ 합성곱 신경망 만들기

____ 모델 컴파일과 훈련

____ [문제해결 과정] 케라스 API로 합성곱 신경망 구현

____ 키워드로 끝내는 핵심 포인트

____ 핵심 패키지와 함수

____ 확인 문제

__ 08-3 합성곱 신경망의 시각화 ▶️신경망이 이미지에서 학습하는 게 무엇인지 이해하기

____ 가중치 시각화

____ 함수형 API

____ 특성 맵 시각화

____ [문제해결 과정]

____ 시각화로 이해하는 합성곱 신경망

____ 키워드로 끝내는 핵심 포인트

____ 핵심 패키지와 함수

____ 확인 문제

Chapter 09 텍스트를 위한 인공 신경망 ▶️한빛 마켓의 댓글을 분석하라!

__ 09-1 순차 데이터와 순환 신경망 ▶️순차 데이터의 특징과 개념 이해하기

____ 순차 데이터

____ 순환 신경망

____ 셀의 가중치와 입출력

____ [문제해결 과정] 순환 신경망으로 순환 데이터 처리

____ 키워드로 끝내는 핵심 포인트

____ 확인 문제

__ 09-2 순환 신경망으로 IMDB 리뷰 분류하기 ▶️텐서플로 순환 신경망으로 영화 리뷰 분류하기

____ IMDB 리뷰 데이터셋

____ 순환 신경망 만들기

____ 순환 신경망 훈련하기

____ 단어 임베딩을 사용하기

____ [문제해결 과정] 케라스 API로 순환 신경망 구현

____ 키워드로 끝내는 핵심 포인트

____ 핵심 패키지와 함수

____ 확인 문제

__ 09-3 LSTM과 GRU 셀 ▶️순환 신경망의 중요 기술을 사용해 모델 만들어 보기

____ LSTM 구조

____ LSTM 신경망 훈련하기

____ 순환층에 드롭아웃 적용하기

____ 2개의 층을 연결하기

____ GRU 구조

____ GRU 신경망 훈련하기

____ [문제해결 과정] LSTM과 GRU 셀로 훈련

____ 키워드로 끝내는 핵심 포인트

____ 핵심 패키지와 함수

____ 확인 문제

__ 부록 A 한발 더 나아가기

__ 부록 B 에필로그

____ 정답 및 해설

____ 찾아보기

🙋♂️Q&A: 박해선 저자님의 github

💻유튜브 강의: 👉전체 강의 목록

재미 있었습니다.