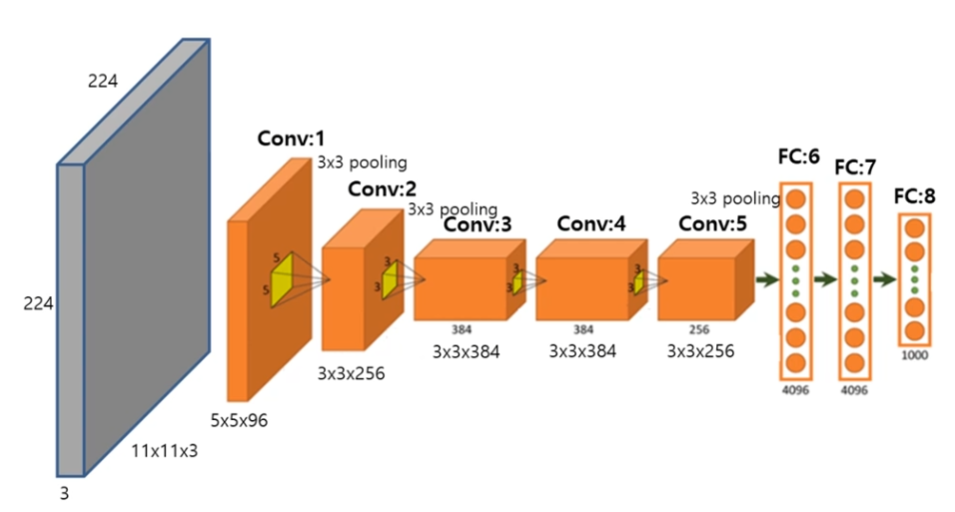

컨볼루션 신경망의 구조

- 특징 추출을 위한 컨볼루션 부분

- 컨볼루션 연산을 하는 Conv층

- ReLU 연산을 하는 ReLU

- 풀링 연산 Pool

- 추출된 특징을 사용하여 분류 또는 회귀를 수행하는 다층 퍼셉트론 부분

- 전방향으로 전체 연결된 FC층 반복

- 분류의 경우 마지막 층에 소프트맥스를 하는 SM연산 추가

- 소프트맥스 연산: 출력의 값이 0이상이면서 합은 1로 만듦

- 컨볼로수녀 신경망 구조의 예

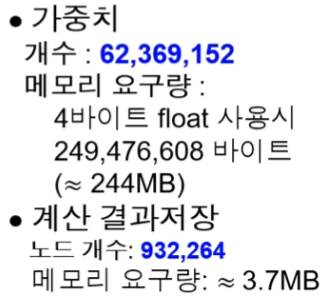

- 컨볼루션 신경망의 학습대상 가중치 개수와 메모리 요구량

- 전체 연산량

컨볼루션 신경망의 학습

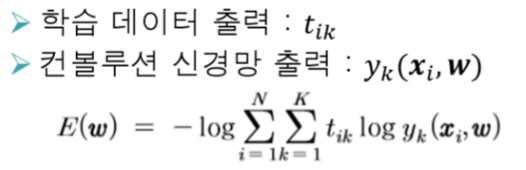

- 분류 문제

- 교차 엔트로피

- 교차 엔트로피

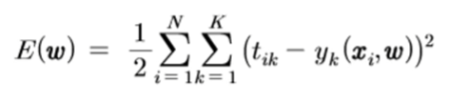

- 회귀 문제

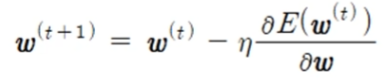

경사 하강법

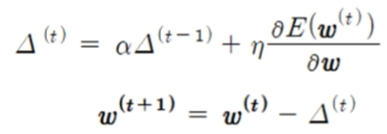

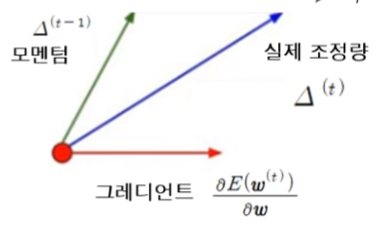

모멘텀을 고려한 경사 하강법

NAG(Nesterov accelerated gradient) 방법

AdaGrad 방법

- 가중치별로 별도의 학습율 사용

- 이미 많이 움직였던 가중치에는 작은 학습율 사용

AdaDelta 방법

- Adagrad의 변형

- 과거 그레디언트의 영향을 점점 축소

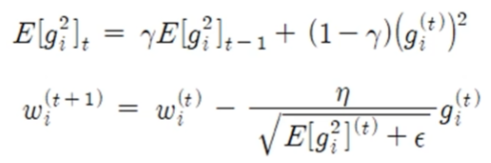

RMSprop 방법

- 가중치별로 별도의 학습율 사용

- 학습율을 가중치별 누적합의 제곱근으로 나누어서 조정

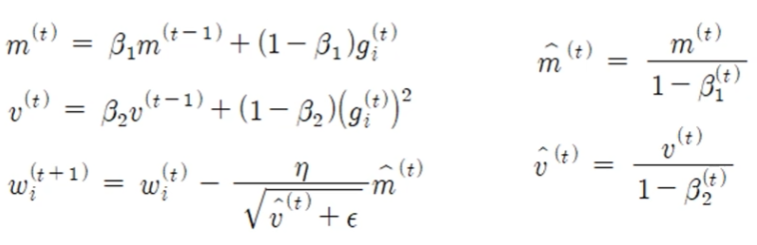

ADAM 방법

- 가중치별로 별도의 학습율 사용

- 그레디언트의 1차 및 2차 모멘텀 사용