Deep Neural Nets

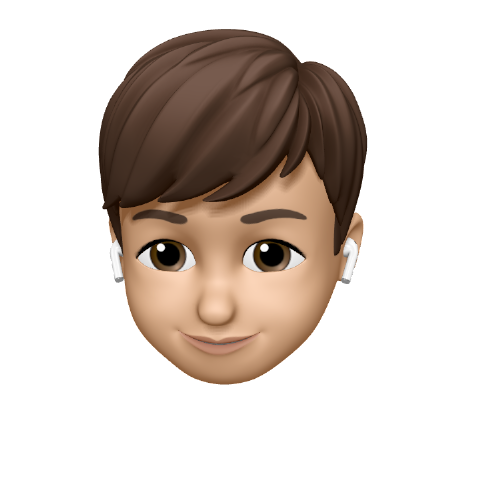

- 최종 목표 : 우리가 수행해야 하는 일들 중 복잡한 일들, 생각이 많이 필요한 일들을 처리하기 위해 인공지능을 개발. 인간의 뇌구조를 이용한 Deep Neural Net을 만들려고 함

- 문제점: 뇌가 매우 복잡하게 연결되어있음, 연결된 부분들을 보면 Neuron이라고 불리는 유닛이 너무나도 단순하게 연결되어 있었음. 따라서 어떻게 사고 하는지 밝혀 내는 것이 힘들 었음.

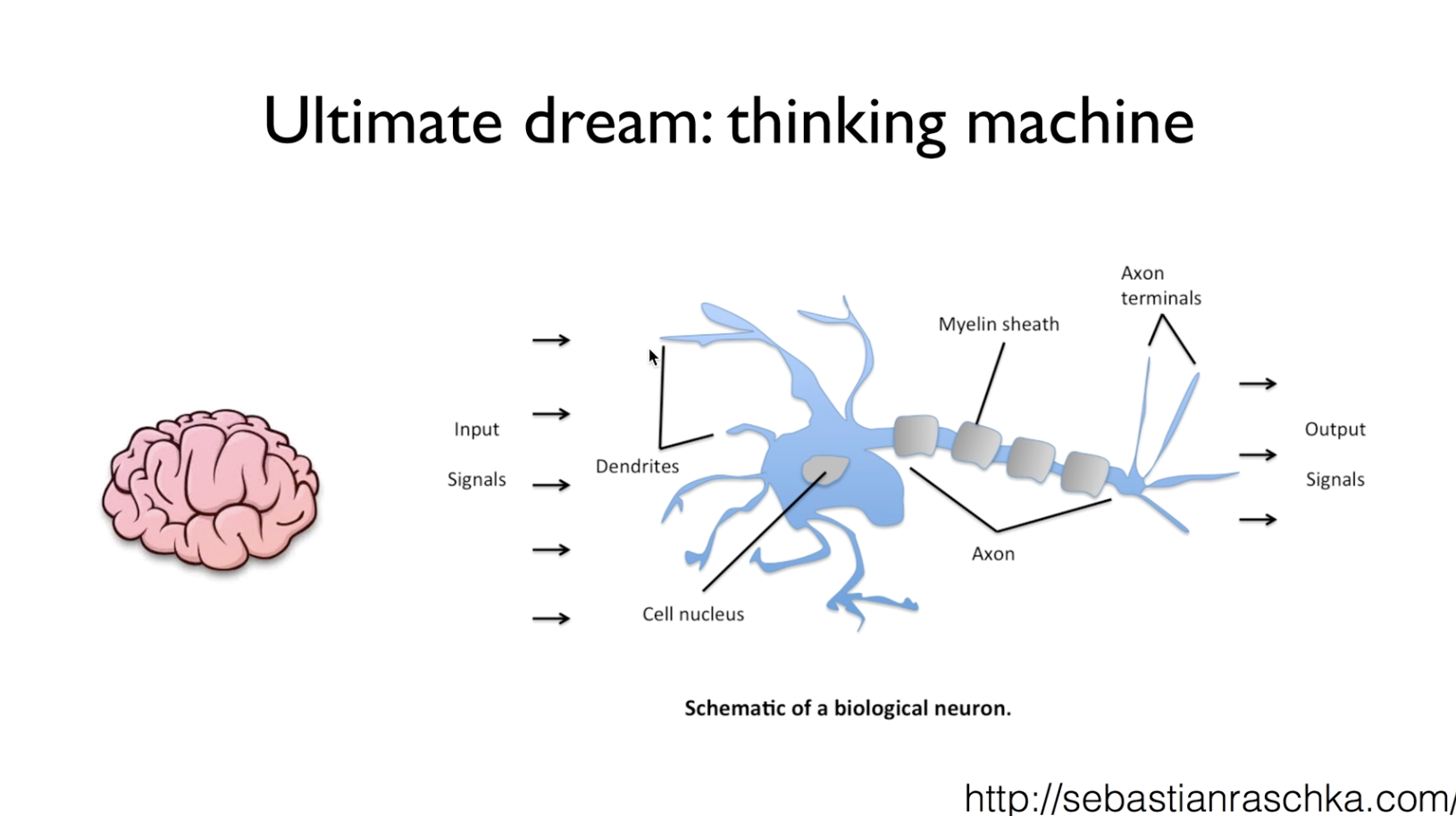

- 뉴런 모델 : Input 값을 Weight으로 연결되고, bias값과 합쳐서 들어옴. 기준 이상의 값이 들어오면 1 또는 0을 선택해서 값을 보내도록 Activation function을 만듦.

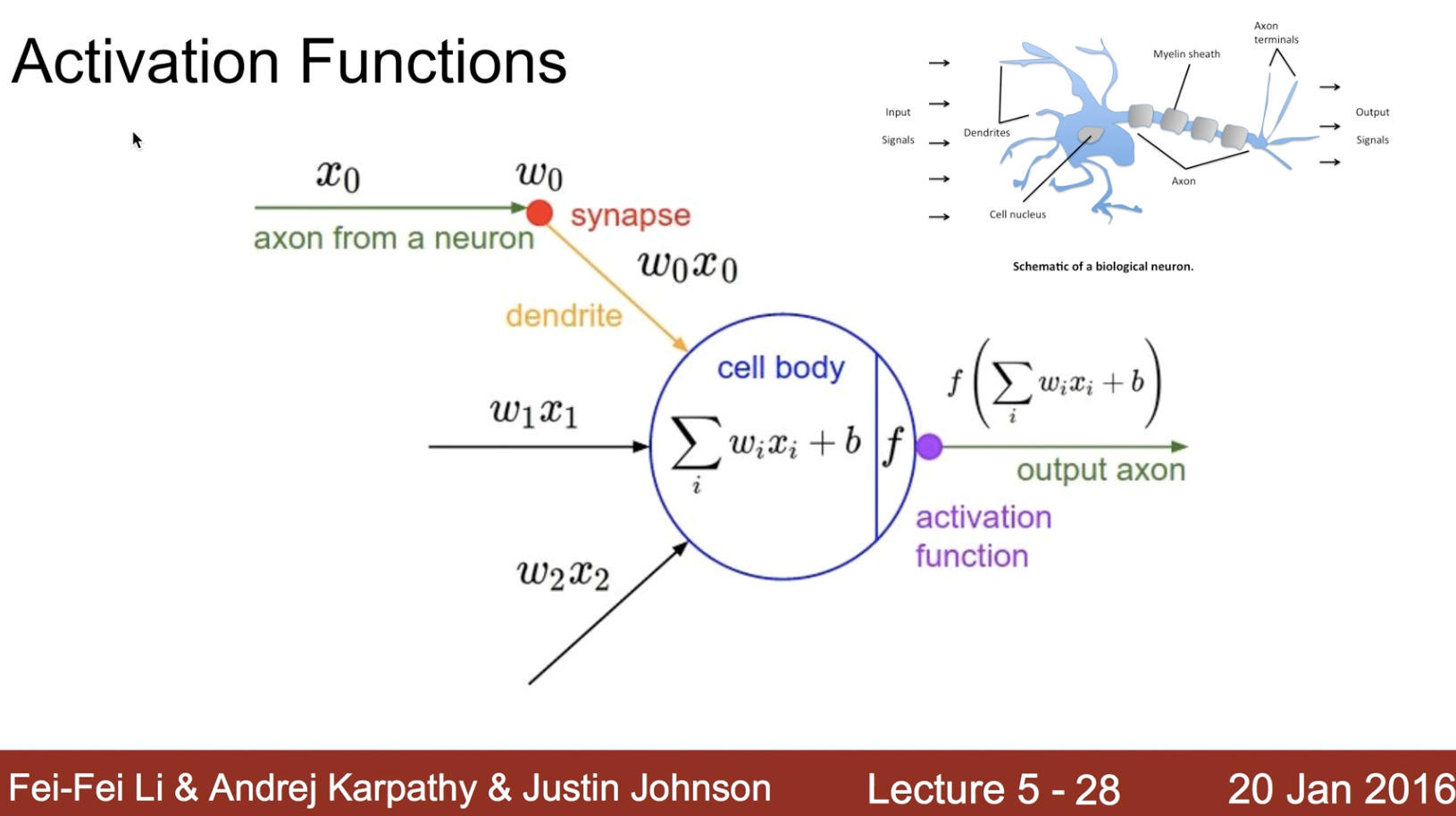

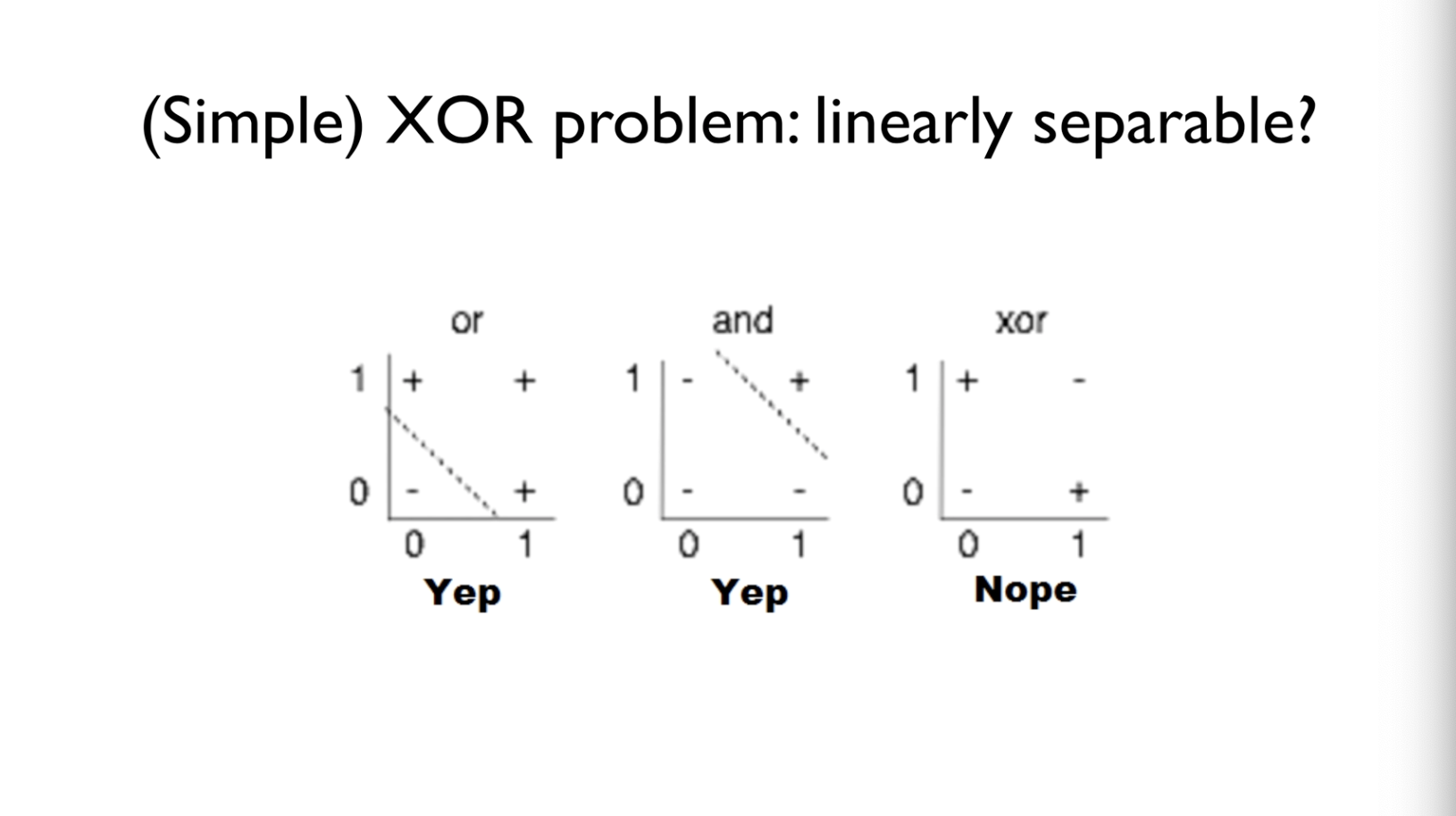

- AND/OR 문제 :당시에는 이 AND/OR 문제를 풀어 낸다면, 인공지능 문제를 해결 할 수 있다고 판단했었음. 선을 그어서 분류하는 모델로 해결할 수 있었음

- XOR 문제 : XOR 문제를 풀 수 없었음 Marvin Minsky라는 사람이 한가지 선으로 문제를 풀 수 없다는 것을 증명하고, W, B의 값을 학습할 수 없다는 사실을 증명함. Neural Network 발전이 느려지게 된 계기.

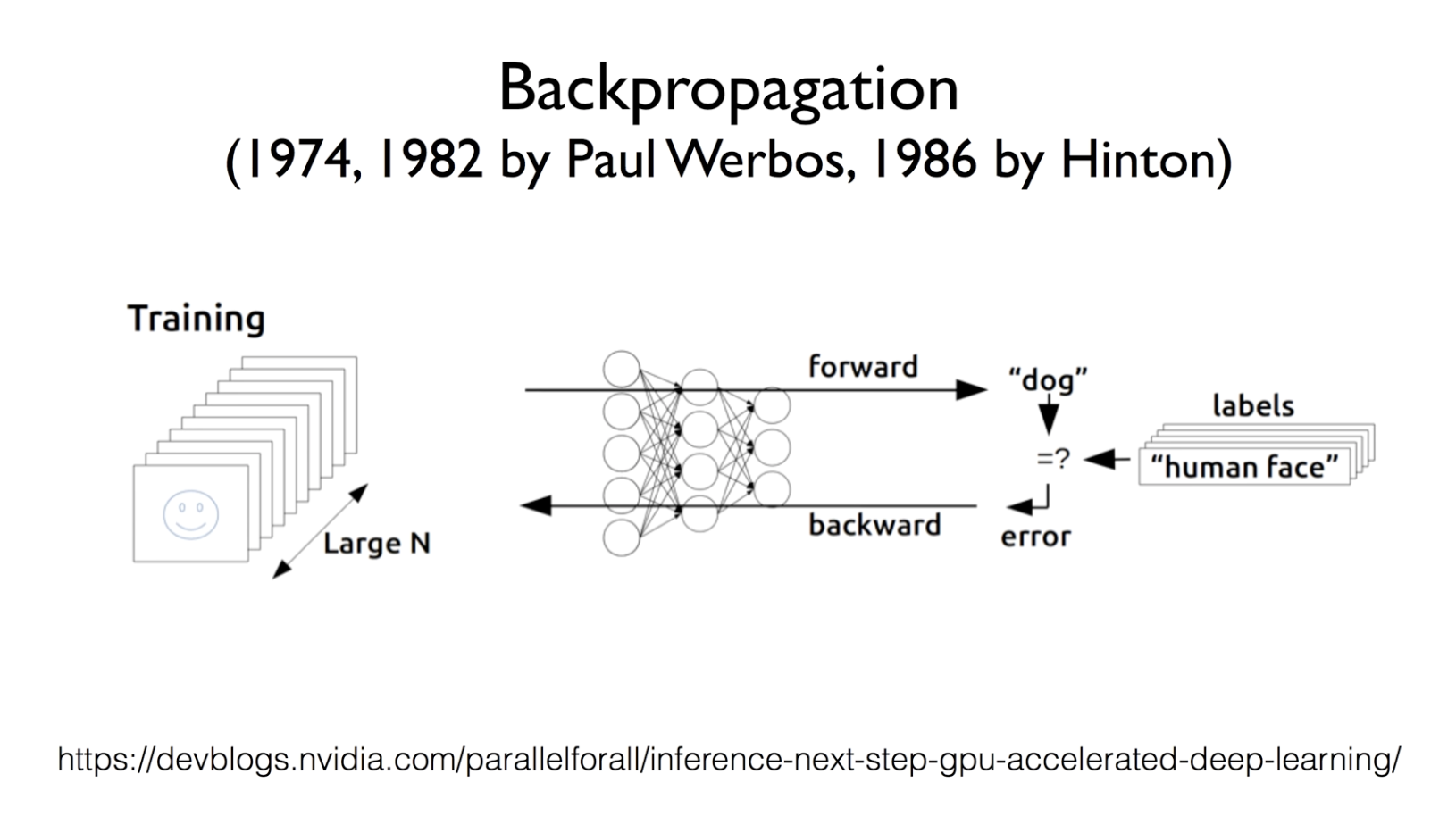

- BackPropagation(1986년) : Back Propagation으로 문제를 해결하였음. 학습이후 만들어진 Error 값을 앞으로 보내서 다시 문제를 해결하는 방법인데 1974년,1982년 Paul Werbos라는 문제를 해결하였음을 알리는 논문 발표, 즉 Back Propagation이라는 논문을 만들어냄. 하지만 그 당시에 분위기는 냉랭하였음. 1986년 Hinton에의해 재조명이 되었음.

Convolutional Neural Network : LeCun 교수님 고양이가 그림의 형태에 따라 일부의 다른 신경망들이 이용됨을 알아냄. 이를 이용해서 Convolutional Neural Network를 만들어 냈는데, 글자와 같은 사진을 쪼개서 layer에 전달하는 방식으로 학습을 하였는데, 90퍼센트 이상의 정확도를 보임

-A BIG PROBLEM : Back Propagation이 적은 수의 Layer에서 학습 시키는데 문제가 없으나, 많은 Layer에서 Back Propagation을 수행할 수 없었음. (Layer가 넘어갈 수록 BackPropagation으로 이용해서 전달된 값이 사라짐)

다른 Machine Learning 방 : SVM, Random Forest의 문제 해결력이 높음