내용출처 : 이수안컴퓨터연구소 Youtube

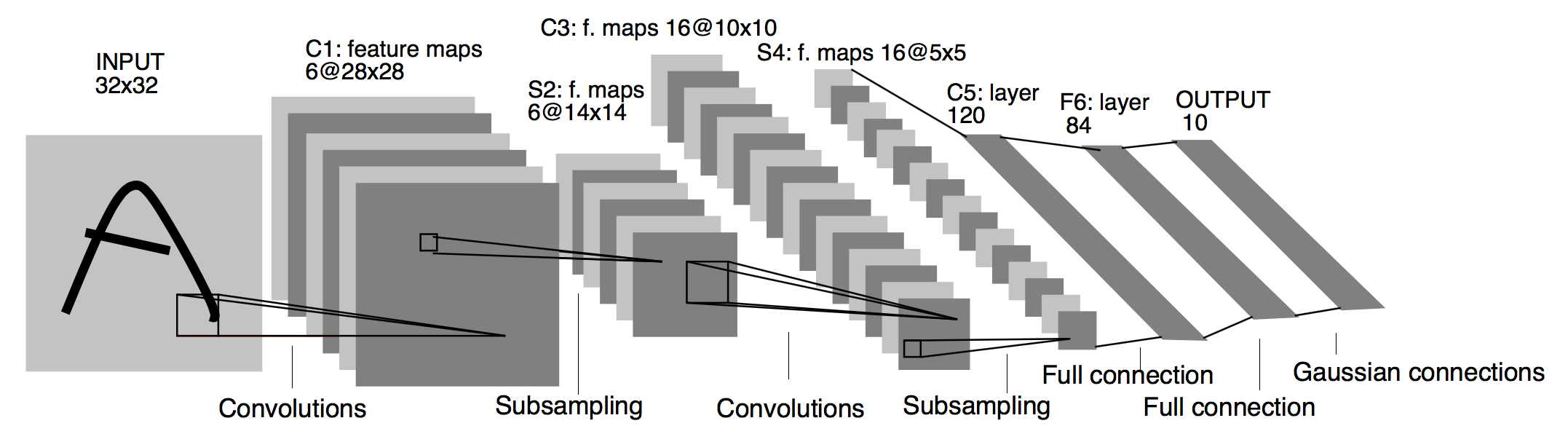

LeNet - 5

[LeNet-5 구조]

[LeNet-5 구조]

출처: https://medium.com/@pechyonkin/key-deep-learning-architectures-lenet-5-6fc3c59e6f4

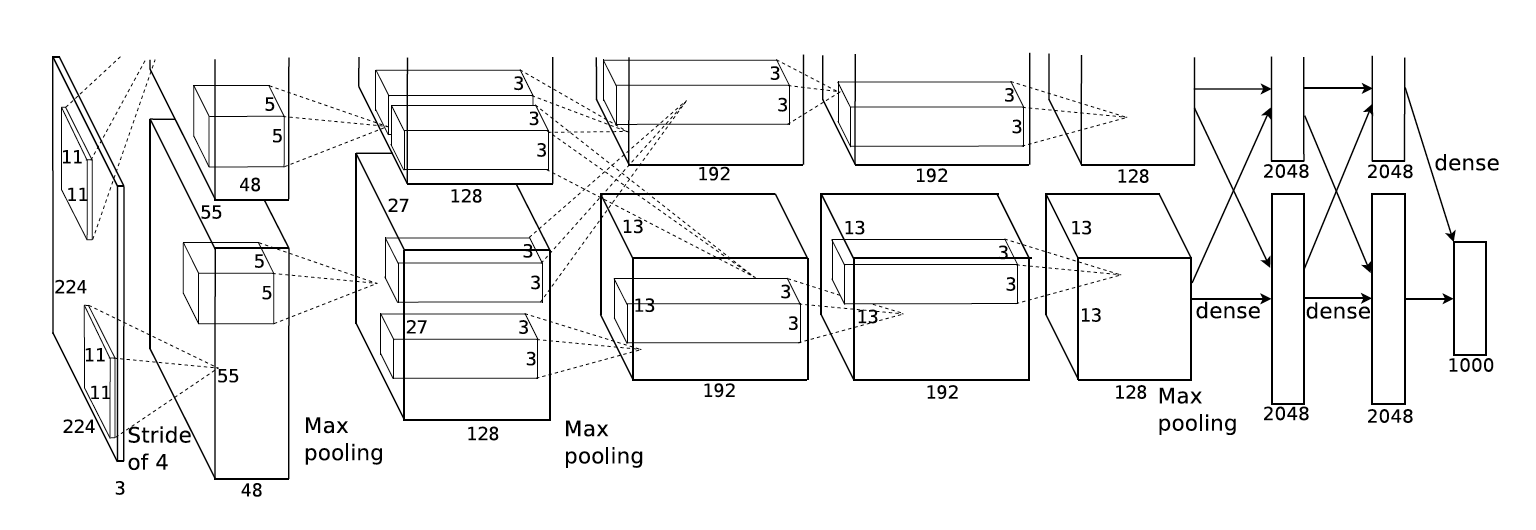

AlexNet

-

활성화 함수로 ReLU 사용

-

국소적 정규화(Local Response normalization, LRN) 실시하는 계층 사용

-

드롭아웃

[AlexNet 구조]

[AlexNet 구조]

VGG - 16

-

모든 컨볼루션 레이어에서의 필터(커널) 사이즈를 3x3으로 설정

-

2x2 MaxPooling

-

필터의 개수는 Conv Block을 지나가면서 2배씩 증가

32 -> 64 -> 128

[VGG-16 구조]

[VGG-16 구조]

출처: Very Deep Convolutional Networks for Large-Scale Image Recognition