1. What is Memory?

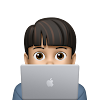

Conversation task

에이전트(챗봇)은 사용자 또는 환경과 상호작용해야 합니다.

주어진 task를 한번에 해낼 수도 있지만, 여러 step에 걸쳐 완료되는 task의 경우에는 각 단계(step) t에서 여러번 시행(trail)되어야 합니다.

이러한 종류의 task를 진행할 때, 각단계 t에서의 trail에 대한 historical 정보를 담고 있는 저장소를 memory라고 합니다.

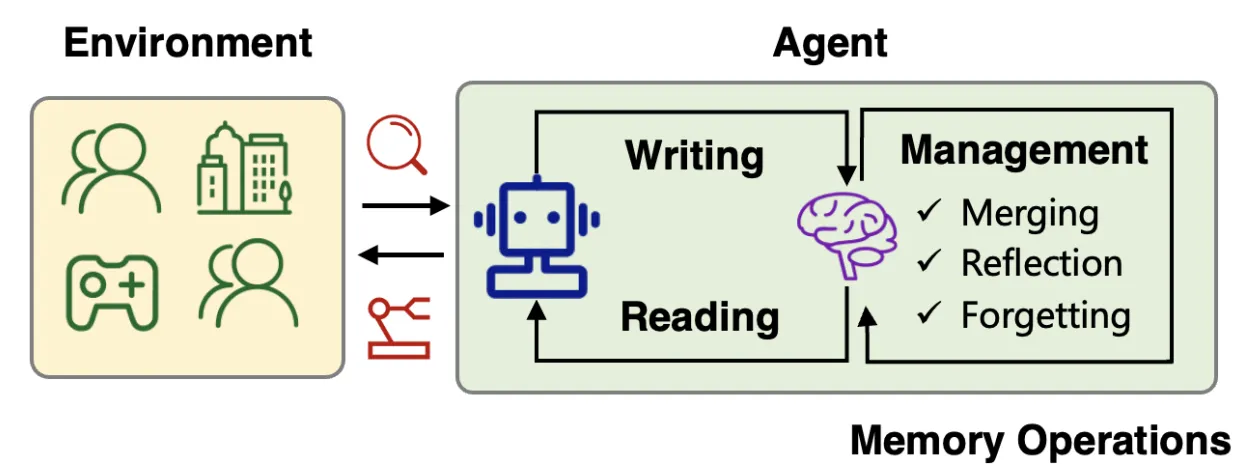

Memory Interaction

메모리는 크게 write, management, read 총 세 단계로 수행됩니다.

Write: 정보를 인코딩하여 메모리에 저장하는 방법.

Management: LLM이 더욱 잘 이해할 수 있도록 정보를 요약하거나, 용량을 줄이는 것.

Read: 메모리를 참고하여 다음 action을 결정하는 과정.

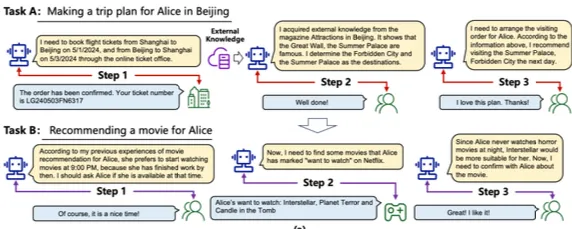

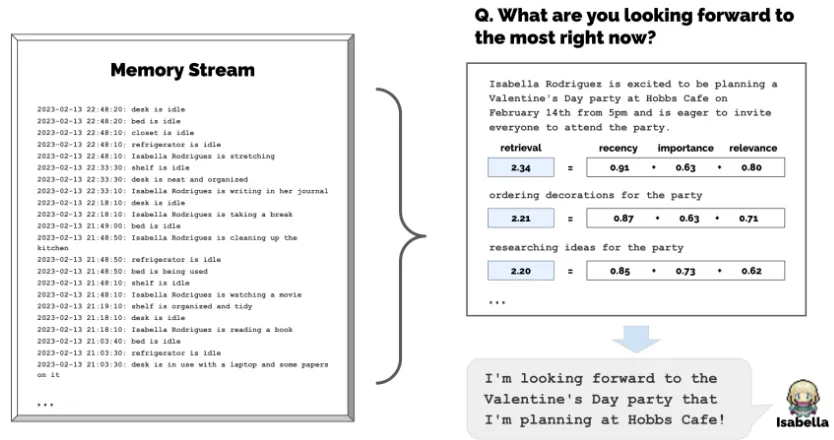

Park et al., Generative Agents, 2023

Park et al., Generative Agents, 2023

위 예시의 경우에는 Memory Stream에 Write를 하고, Plan, Retrieve, Reflect로 Management를 진행한 뒤, Read하여 Act를 뽑아낸다고 할 수 있습니다.

2. Reason for need

논문에서는 3가지 관점에서 Memory가 필요하다고 합니다.

Perspective of Cognitive Psychology

사람의 학습, 문제해결, 사회적 상호작용에 있어 메모리는 필수요소입니다.

사람은 중요한 정보를 축적하고, 고차원 개념을 추상화하여 지식을 학습하기 때문입니다.

LLM 기반 에이전트의 주요한 목표는 다양한 작업을 수행하여 사람을 대체하는 것이기 때문에 사람의 작동 메커니즘을 따라 설계되는 것이 자연스럽다고 합니다.

Perspective of Self-Evolution

Experience accumulation

과거의 오류, 부적절한 행동 또는 실패한 경험을 기억하여 미래에 유사한 작업을 효과적으로 처리할 수 있도록 하는 것이 메모리의 중요한 기능입니다.

Environment exploration

환경에서 자율적으로 진화하기 위해 다양한 행동을 탐색하고 피드백을 통해 학습이 되어야 합니다.

Knowledge abstraction

메모리의 또다른 중요한 기능은 고수준의 정보를 요약하고 추상화하는 것 입니다.

Perspective of Agent Applications

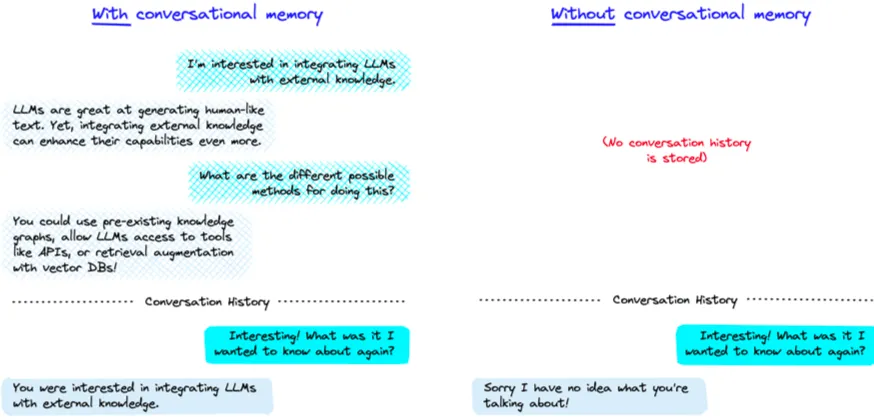

GPT, Gemini, Simulation등 많은 분야에서 에이전트는 필수적인 구성요소입니다. 하지만 에이전트는 메모리가 없으면 맥락을 알 수 없고, 대화를 계속할 수 없습니다.

3. Current of Memory

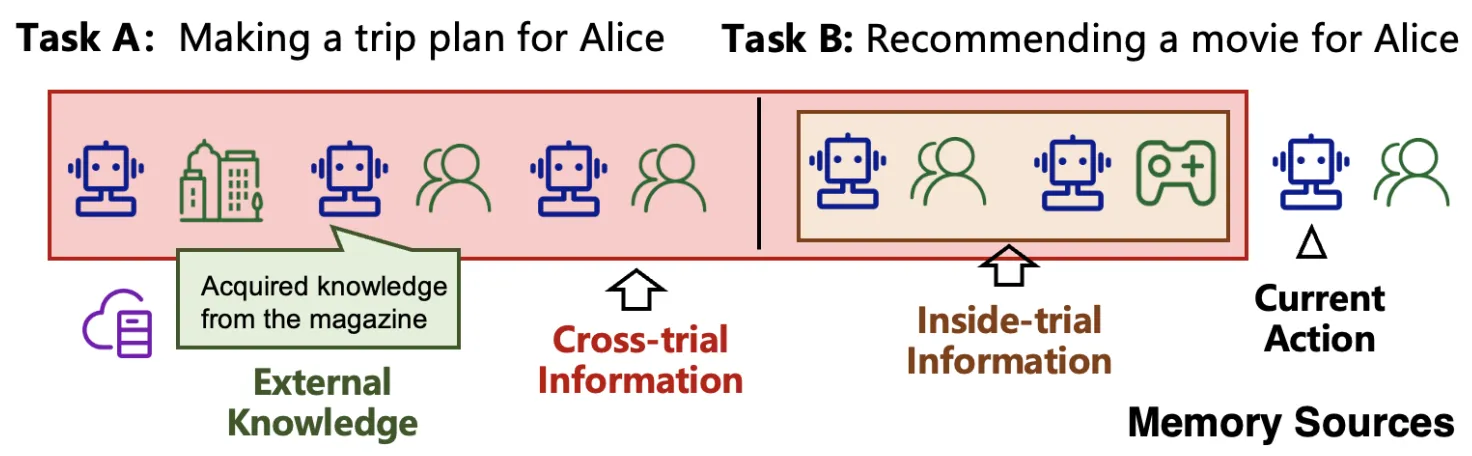

Source

Inside-trail: 현재 trail 내 대화, 행동

Cross-trail: 과거 trail 전반적인 경험

External: 웹, API, 외부지식

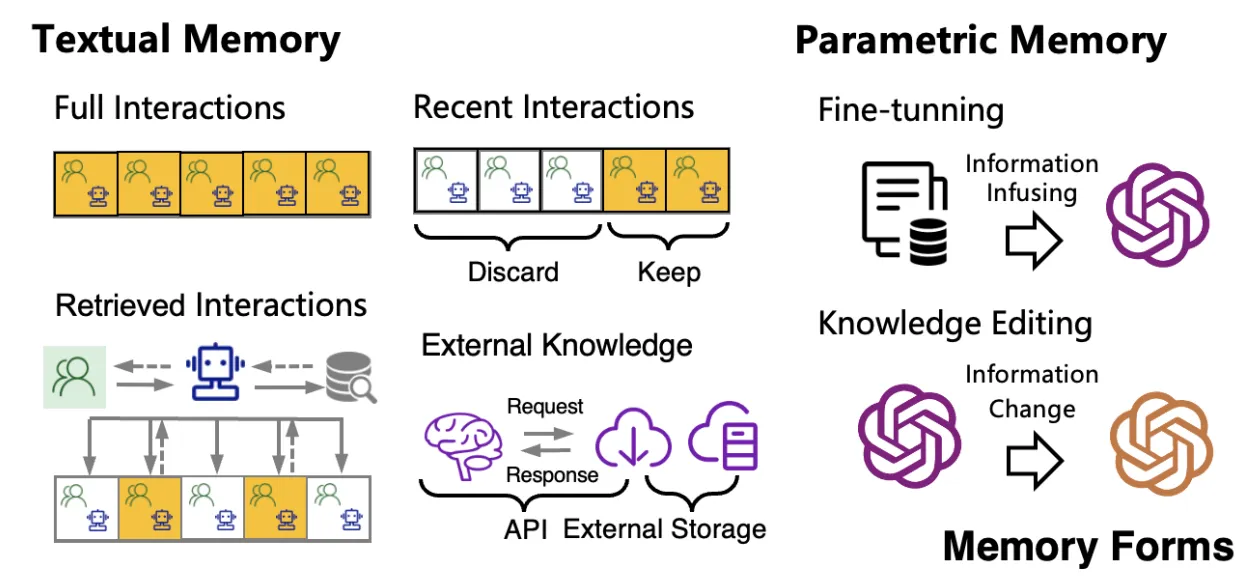

Forms

Textual Memory: 전체 또는 최근에 대한 자연어로 기록된 외부 지식

Parametric: 파라미터 내 지식 저장(파인튜닝, 정보 편집)

Operations

Writing: 입력된 정보를 메모리에 투영

Management: 메모리 내 정보를 요약, 통합, 망각 등으로 정제

Reading: 유사도 기반 검색 등으로 행동 계획 지원

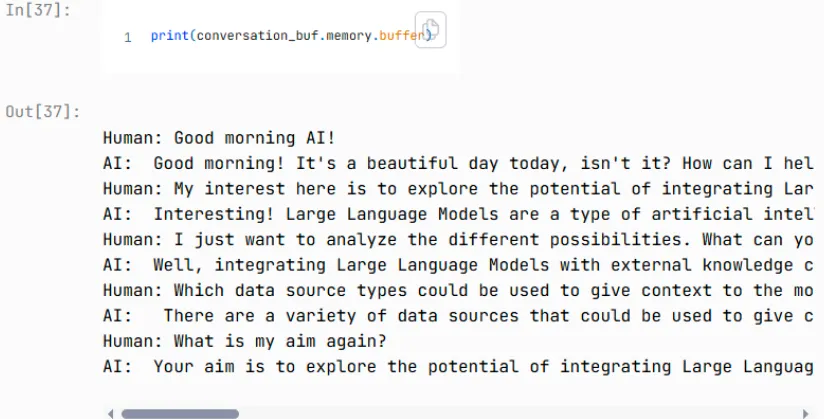

Memory Implement

많은 memory tool이 prompt context에 그대로 history를 붙여넣는 방식으로 구현되어 있습니다.

Langchain의 conversation.memory

Langchain의 conversation.memory

Langchain의 conversation.memory

memory가 있어야 대화의 맥락을 이해할 수 있습니다.

Memory in Generative Agent

Park et al., Generative Agent, 2023 에서는 방대한 memory 정보 중에서 최근성, 중요성, 관련성 세가지 항목을 scoring하여 retriever 하는 방식을 제안했습니다.

Recency: exponential decay를 이용해 최근 정보일수록 높은 점수

Importance: LLM에게 직접 질문하여 스코어 측정

Relevance: cosine similarity 측정

4. Future

Episodic Memory

저는 개인적인 연구에서 텍스트만이 아닌 소리, 이미지, 깊이 등 여러 요소가 임베딩되어 하나의 경험으로써 메모리 설계를 구상하고 있습니다. 앞으로는 더 사람과 같은 구조의 기억 프레임워크 연구가 활발히 진행될 것 같습니다.