주원언니 논문리뷰 들은것도 쳐주나요 (?)

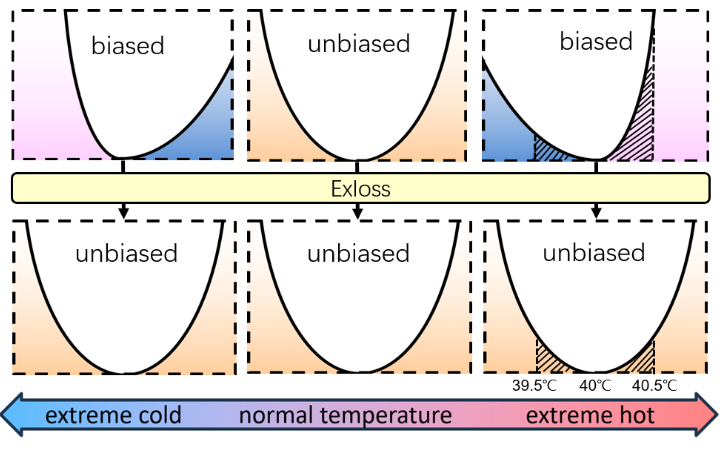

extreme value로 갈 수록

loss function에 돌리면 값이 뭉개지는 현상을 해결하는 Exloss

Exloss

이렇게 모델에 넣는다.

두개의 모델이 있는데 하나 학습해놓고 얼리고 나머지 학습하는 방식이다.

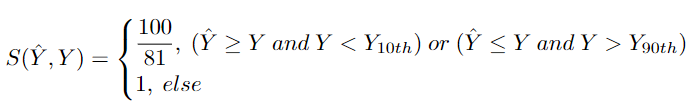

이거처럼 본인들이 어떤 threshold를 정해두고 그걸 예측값에다가 적용해서 사용한다.

아무래도 그 가운데에 normal value들은 살려두어야 하니까 S함수에서처럼 구간을 나눠서 가중치를 주는 듯.

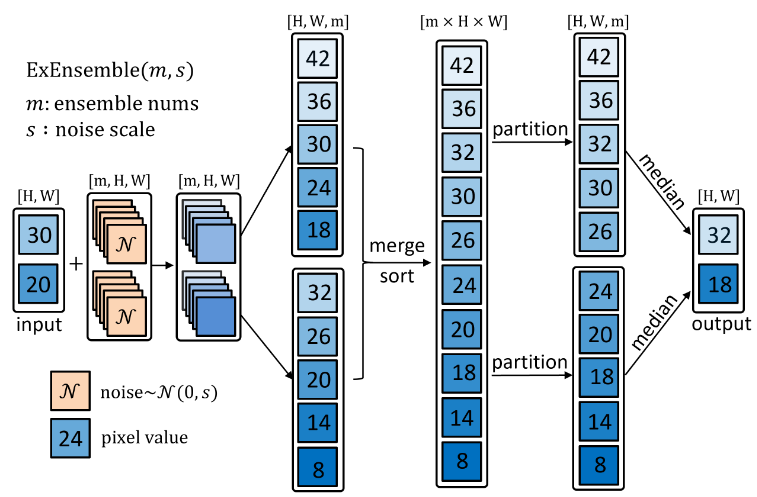

ExEnsemble

입력값이 아니라 출력값에 앙상블을 주는 알고리즘인데

학습이 따로 필요없고

출력값에 앙상블을 주고 얘네들이 좀 더 extreme value를 잘 반영하도록 하는 방법이다.

노이즈 주는 방법을 우리가 바꿀 수 있으니까 이 방법도 충분히 적용해볼 만 한듯!

그리고 마지막에 평균으로 값을 구하면 값이 뭉개지니까 median으로 주는 것 같다.

마지막으로 어떤 디퓨전 방법도 있었는데 이건 학습해야하니까... 근데 학습이 A100 몇십장으로 2주니까 이건 패스 ...

우리 모델에 적용할 부분이 많은 내용이어서 흥미로웠다.