3주차 화요일

- 최적화 기법

- 정규화 기법

📌[들어가기 전에]

-

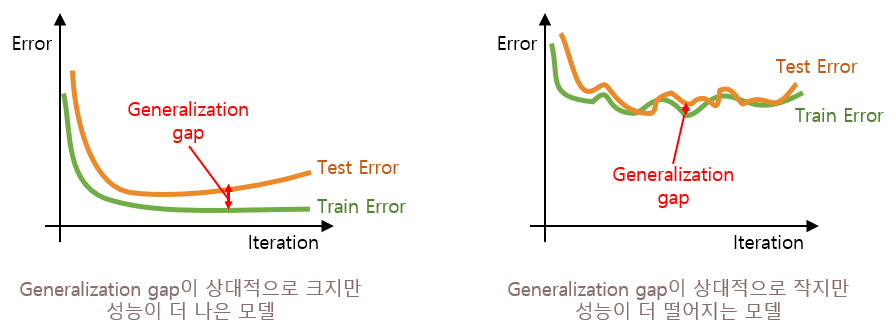

일반화 성능 : 학습 결과와 테스트 결과 사이의 차이 (Generalization gap)

보통 일반화 성능이 높을 수록 좋지만 아래 그림처럼 모델 자체가 학습 데이터에서도 엉망인 경우에는 generalization gap이 작지만 결과적으로는 성능이 더 떨어지는 모델일 수도 있다.

일반화 성능이 다가 아니다!

-

Underfitting (과소적합) : 학습을 충분히 하지 못했거나 잘못된 설계 등으로 모델이 데이터로부터 특성을 다 뽑아내지 못한 상태

-

Overfitting (과대적합) : 모델이 주어진 데이터셋을 지나치게 많이 학습해서 입력 데이터에 딱 맞게 유착되어 버린 상태 골라보라고 데이터 건네주는 순서를 외워 버렸다

과대적합을 방지하기 위해서는 학습셋과 테스트셋을 철저히 분리하고, 여러 가지 정규화(regularization) 방법을 사용하거나 k겹 교차 검증을 실행한다. -

Batch size : 가중치와 바이어스를 1회 업데이트할 때마다 모든 데이터를 다 사용하려면 연산량이 너무 많고 비효율적이라 경사 하강법의 변종인 SGD나 mini-batch SGD이 등장했다. 이들 알고리즘에서는 가중치를 1회 업데이트할 때 입력 데이터의 일부만 사용한다. 이 때 '일부 데이터'의 크기를 결정하는 것이 batch size다.

📝[최적화 기법]

모델을 학습시킬 때는 경사 하강법을 이용해서 손실 함수가 작아지는 방향으로 가중치와 바이어스를 업데이트한다(최적의 가중치와 바이어스를 찾는 것).

하지만 경사 하강법은 큰 규모의 모델에서는 수렴 속도가 느리고 극소(local minima)에 빠질 위험이 있어서 이를 보완하기 위한 여러 가지 최적화 기법들이 등장했다.

-

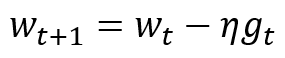

GD, SGD

새로운 가중치 W_t+1은 이전 가중치 W_t에서 gradient에 𝜂(학습율)을 곱해 빼 준 것과 같다.

(함수값에서 미분값을 빼 주면 값이 무조건 감소한다. 이거 참고.)

-

Momentum

local minima에 빠지는 문제를 해결하기 위해 gradient가 감소하던 방향을 유지한다. a 항이 마치 관성처럼 작용해서 극소값에 도달하더라도 다음 스텝에서는 이동하던 방향을 유지하며 극소를 지나쳐서 조금 더 가게 된다. 이것이 장점이자 단점으로 작용하는데, 극소에 덜 빠지지만 수렴이 느리다.

-

Nesterov Accelerated Momentum

Momentum을 조금 더 개선한 방법으로, 아직 가 보지 않은 다음 스텝 방향으로 미리 가 보고 그 지점에서 기울기를 계산한 다음 가중치 업데이트에 반영한다. Momentum보다 수렴이 빠르다.

-

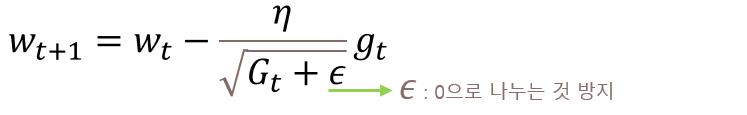

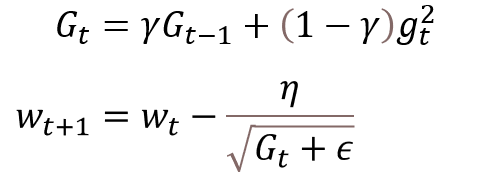

Adagrad

Adaptive gradient 방식으로, 학습 결과에 따라 파라미터를 업데이트할 때의 스텝(학습율)이 달라진다. G_t는 모든 gradient 제곱의 누적합으로, G_t가 분모에 있기 때문에 gradient가 처음 값에 비해 많이 변했으면 그에 반비례해서 학습 스텝이 작아진다.

문제는 학습 횟수가 아주 많아서 G_t가 분자 𝜂에 비해 무한대에 가깝게 커질 경우

상수/무한대 꼴이 되어 더이상 가중치가 업데이트되지 않는다는 것이다.

-

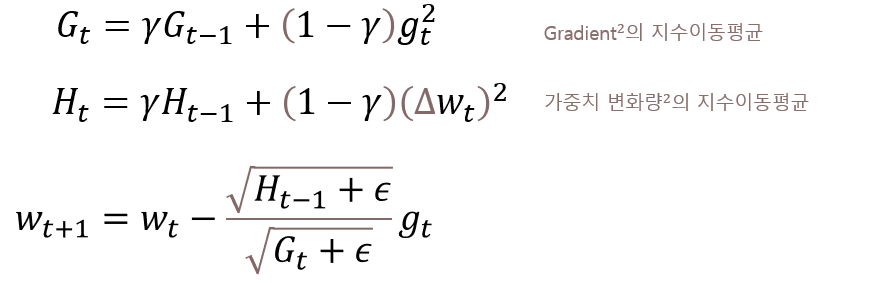

Adadelta

Adagrad의 문제점을 개선한 방식으로, G_t가 무한히 커지는 것을 막기 위해 지수 이동 평균을 사용하여 accumulation window를 제한한다. 따라서 Adadelta에서의 G_t는 window 범위 안에서 계산된 n개의 gradient 제곱의 누적합이라고 볼 수 있다.

Adadelta의 식을 살펴보면 학습율 𝜂가 없는데, 분자의 H_t term이 학습율 역할을 한다. G_t가 gradient의 변화율에 대한 정보였다면 H_t는 가중치 W의 변화율에 대한 정보다. 학습 초기에는 가중치가 많이 변하고 학습이 진행될수록 가중치가 최적화되어 변화량이 작을 것이다. 가중치가 최적화되어갈 때 학습 스텝이 크면 오히려 이상한 방향으로 가서 수렴이 느려질 수 있기 때문에 가중치의 변화량(H term)에 비례하여 학습 스텝을 Adaptive하게 설정하는 것이다.

Adadelta의 문제는 GPT-3처럼 아주아주아주아주 큰 모델을 처리하기 힘들다는 것이다. 수십억 개의 파라미터를 갖는 모델인 경우 엄청난 수의 파라미터를 window 크기만큼 들고 다녀야 한다. 지수이동평균을 취하는 이유가 이 부담을 좀 덜기 위해서라고 한다.

이 부분은 논문을 읽어 봐야 할 것 같다.

-

RMSProp

제프리 힌튼의 강의에서 나온 방법으로, Adagrad에 지수이동평균을 적용하여 개선한 방식이다.

-

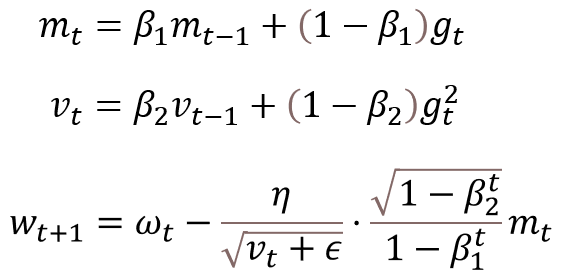

Adam

Adaptive Momentum Estimation의 약어로, 얘도 Ada~ 시리즈다. Adaptive 계열의 Gradient 제곱에 지수이동평균 취하기 방식과 Momentum을 결합한 알고리즘이다. Gradient^2의 크기에 따라 학습율을 adaptive하게 바꾸며 이전의 Gradient 정보(momentum)도 사용한다. 학습 속도도 빠르고 수렴도 잘 된다! 요즘은 웬만하면 이걸 쓴다.

📝[정규화 기법]

모델이 입력 데이터에 과적합(overfitting)되지 않도록 해 주는 다양한 방법이 있다.

- Early stopping

학습을 아주 많이 하면 학습 데이터셋을 달달 외워서 학습 데이터셋에 대한 모델 성능은 점점 좋아지지만 모델이 학습 데이터셋에 완벽하게 유착되어 처음 보는 데이터인 테스트 데이터셋에 대한 성능은 점점 나빠진다. 이를 방지하기 위해 적당한 위치에서 학습을 중단하는 방법을 사용한다. 보통 loss의 변화량이 일정 값 이하가 되면 중단한다.

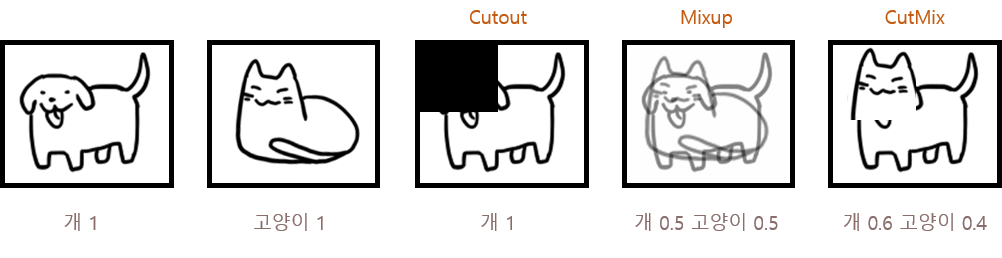

- Data augmentation

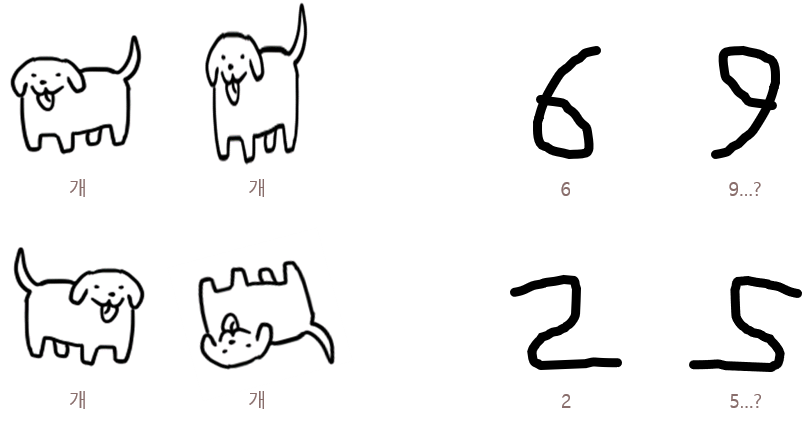

이미지 등의 데이터 수를 늘리기 위해서, 레이블이 바뀌지 않는 선에서 뒤집거나 회전시키거나 늘리거나 줄이는 등 약간의 조작을 가하는 것을 말한다.

주의) MNIST 데이터같은 경우에는 조작을 가하면 레이블이 바뀔 수도 있기 때문에 이거 하기 전에 잘 확인해야 한다.

-

Noise robustness

입력 데이터와 가중치에 랜덤하게 노이즈를 약간 섞는 것. 수학적으로는 아직 증명되지 않은 것 같은데 실험적으로 잘 된다고 한다...

-

Lable smoothing

분류 문제 등에서 레이블을 0/1로 나누는 게 아니라 좀더 부드럽게 만드는 것을 말한다. 신기하게도 성능이 잘 나온다.

-

Dropout

학습 과정에서 일부 노드의 출력을 0으로 만든다. Noise robustness 방법과 비슷하게 노이즈 있는 환경에서 학습해서 과적합을 방지한다.

강하게 키우나...?

👨👩👧👦[피어 세션]

가능하면 지정된 피어 세션 시간을 유지하는 방향으로 2시에 모이기로 했다. 2시에 만나면 당일 강의는 다 소화하지 못한 상태기 때문에, 2시에 모이되 모여서 전날 공부한 내용에 대해 이야기하기로 했다. 팀원 중 한 분이 어제 강의에 포함되어 있던 베이즈 정리에 대한 세미나를 간단히 해 주셨는데, 딱 조건부 확률까지만 알아들었다. 너무 기초적인 질문이라 질문 안 하고 있었는데 세미나 끝나고 나서 팀원들이 정말 쉬운 질문이라도 얼마든지 물어봐도 된다고 격려해 줘서 내일부터는 세미나에서 막히는 부분이 있으면 바로 물어보기로 했다.

약식 세미나가 끝나고 나서 오늘 강의 이야기도 좀 했는데, 주제가 MLP에서 한 레이어의 출력은 어떤 의미를 갖는가? 로 흘러갔다. 내가 설명할 수 있는 부분은 설명하고 다른 팀원의 부연 설명을 듣기도 하면서 생각이 정리되는 것을 느꼈다.

해당 내용을 정리하자면,

- 선형 변환은 하나의 벡터를 다른 공간으로 옮기는 연산으로 볼 수 있다.

- MLP에서 한 레이어를 거쳐서 나온 출력은 선형 변환의 결과물이다.

- 다시 말해, 한 레이어는 입력 벡터 (n차원 공간 상의 점)를 새로운 공간으로 옮기는 것이다.

이 때 차원은 축소될 수도 있고 그대로 유지될 수도 있다. (보통 확장하지는 않음)

공간을 왜곡시킨다고 할 수도 있을 것이다. - 그렇게 레이어를 계속 거치면서 입력된 데이터 점들을 새로운 공간으로 보내다가, 최종적으로 출력 레이어에서는 활성화 함수를 통해 차원이 많이 줄어든 데이터 공간의 점들을 그룹으로 나누거나(분류) 점들을 대표하는 함수를 얻을 수 있다 (회귀).

알고는 있었지만 하나로 모으지 못하고 여기저기 흩어져 있던 사실들이 연결되는 느낌이 좋았다.