🌟 나름의 요약

실제로 학습하고 있는 정보, 두 가지: pre-trained weight(W0)와 A*B

LoRA: pre-trained는 고정시키고, 여기서 전체 정보 말고, 좀 더 적은 정보를 A,B에 옮겨 담아서 A*B만 업데이트(adaptation)시키겠다!

pre-trained의 전체 정보 말고, 좀 더 적은 정보로 task에 적응시키겠다!

ABSTRACT

- 배경

- 자연어 처리 과정:

먼저 방대한 양의 일반 데이터를 이용해 모델을 훈련 → 이후에 특정한 작업이나 주제에 맞춰 모델을 조정 - 모델이 커질수록 full fine-tuning(모든 파라미터를 다시 훈련시키는 것)은 현실적으로 어려움

- 자연어 처리 과정:

제안

- Low-Rank Adaptation, LoRA를 제안

- 사전 훈련된 모델의 대부분을 고정(freeze)하고,

- Transformer 아키텍처의 각 레이어에 일부 학습 가능한 랭크 분해 행렬(rank decomposition matrices)을 삽입힘으로써, 일부 파라미터만 추가

- 다운스트림 작업의 학습 가능한 파라미터 수를 크게 줄임

효과

- downstream task를 위해 필요한 파라미터 수를 크게 줄임

- 학습 파라미터는 더 적고 훈련 속도가 더 빠르지만,

성능 면에서는 기존 파인튜닝 방법과 비슷하거나 더 좋음.- adapters처럼 추론 속도가 느려지지 않아서 효율적임

- Rank-deficiency이 언어 모델 적응에 어떤 영향을 바탕으로, LoRA가 왜 효율적인지 설명

- https://github.com/microsoft/LoRA

- LoRA와 PyTorch 모델의 통합을 용이하게 하는 패키지를 출시하고, RoBERTa, DeBERTa, GPT-2에 대한 구현 및 모델 체크포인트를 제공

- 기존 모델을 새로운 작업이나 데이터셋에 맞게 조정하는 과정

- 예를 들어, 사전 학습된 모델을 특정 태스크에 맞게 fine-tuning 하는 작업이 포함됨.

기존 모델 파라미터를 그대로 두고,

새로운 작업에 맞는 작은 모듈만 추가하여 데이터셋에 맞게 조정하는 방법. 이렇게 추가된 작은 모듈이 모델을 빠르게 최적화할 수 있도록 도움.

행렬에서 선형 독립적인 행 또는 열의 개수. 행렬의 랭크는 그 행렬이 담고 있는 정보의 차원을 나타냅니다.

A = [1 2]

[2 4]행렬 A는 두 번째 행이 첫 번째 행의 2배이므로 Rank는 1.

즉, 독립적인 정보는 하나만 있음.

Rank-deficiency(랭크 결핍)은 행렬의 Rank가 최대 가능한 값보다 낮은 상태. 즉, 행렬이 충분한 독립적인 정보를 담지 못하거나 중복된 데이터를 포함하는 상황을 의미.

최대 랭크는 행렬의 column 수와 row 수 중 작은 값에 해당함.

따라서, Rank가 열 수나 행 수보다 적으면 랭크 결핍 상태가 됩니다.

B = [1 2 3]

[2 4 6]

[3 6 9]행렬 B의 최대 랭크는 3이어야 하지만,

세 개의 행이 모두 선형적으로 종속적이므로, 랭크는 1.

따라서, Rank-deficiency 상태입니다.

1. INTRODUCTION

배경

- 기존의 ‘자연어 처리’에서의 특정 task 학습 방법

- 보통 pre-trained 모델의 모든 파라미터를 조정하는 fine-tuning

- 문제점:

- 새로운 모델도 원래 모델과 같은 수의 파라미터를 가짐.

- 특히, 모델이 커질수록 큰 문제 (e.g. GPT-3)

- 기존 연구와 문제점

- 기존의 한계, 즉 파라미터 수가 너무 많아지는 문제를 완화하고자 했던 연구들

- 일부 파라미터만 조정하거나 외부 모듈을 추가하여 소수의 파라미터만 추가로 저장

- 한계

- 모델의 깊이를 늘려 추론 속도가 느려지거나,

- 사용할 수 있는 시퀀스 길이가 줄어듦 = 모델이 처리할 수 있는 데이터의 길이가 줄어듦.

- 효율성과 모델 품질 사이의 trade-off

- 기존의 한계, 즉 파라미터 수가 너무 많아지는 문제를 완화하고자 했던 연구들

LoRA의 제안 및 영감

- 기존 연구 "과매개변수화 모델(over-parameterized model)이 사실 낮은 차원(low intrinsic dimension)에 존재한다"에서 영감

- over-parameterized model: 언어모델이 커지면서, 커진만큼 몸값을 하는지.

e.g) GPT-3 ⇒ 175B개의 파라미터들이 다 제 역할을 하고 있는지

- over-parameterized model: 언어모델이 커지면서, 커진만큼 몸값을 하는지.

⇒ 엄청나게 많은 수의 파라미터들이 전부 필요한 것인가?

실제로는 낮은 내재 차원에 있지 않을까? 라는 가정을 바탕으로 함

= 내부에 침투해 있는 정보 = 진짜 필요한 일부의 정보

⇒ 이를 찾아서 요것만 학습시키자!

(너무 큰 모델 → 효율적인 학습을 위해)

⇒ 모델의 가중치 변화도 low-rank를 가진다고 가정하여, LoRA 방법을 제안

- rank : 행렬에서 핵심적인 정보가 담겨 있는 것

- low-rank : 핵심 정보 중에 적은, 정말 핵심인 정보

e.g) GPT-3 175B - 전체 랭크가 매우 높아도 매우 낮은 랭크(1 또는 2)로도 충분히 작동하므로, LoRA는 저장 및 계산 측면에서 매우 효율적

LoRA의 효율성 및 장점

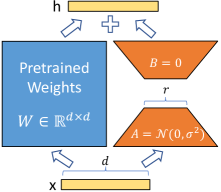

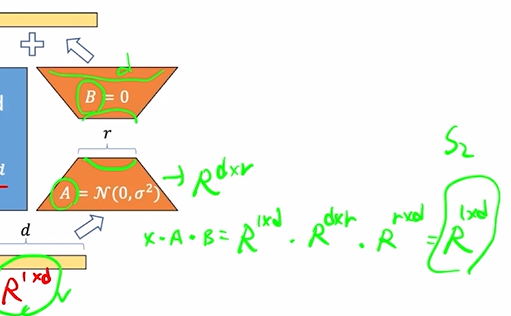

- Pretrained Weights (파란색 블록) : 이미 훈련된 모델의 가중치 W를 나타냄. 이 가중치들은 고정되어 있으며, 바꾸지 않음.

- x: 입력 데이터 벡터로, 모델에 입력되는 정보 (d차원)

- h: 출력 데이터 벡터로, 모델이 생성하는 결과

- A와 B 행렬: 이 두 오렌지색 삼각형은 학습 가능한 저랭크 행렬

⇒ LoRA는 이 두 행렬을 최적화하여 모델이 새로운 task에 적응하도록 도움A: 평균이 0이고 분산이 σ^2인 정규 분포를 따르는 학습 가능한 저랭크 행렬. (d * r)B: 초기 값이 0인 저랭크 행렬. (r * d)

-r: r는 A와 B 행렬의 차원 수 (hidden layer의 노드 개수), low-rank

1. pre-trained 모델을 고정한 채로, 특정 task를 위한 작은 LoRA 모듈만 바꾸면 됨 ([그림 1]의 A와 B 행렬만 교체하면 됨)

→ 효율적인 작업 전환, 저장 공간 절약

2. 대부분의 파라미터를 고정하고, 작은 저랭크 행렬만 최적화

→ 효율적인 학습, 필요한 하드웨어 자원 감소

→ 하드웨어 진입 장벽을 최대 3배 낮춤

3. 단순한 선형 설계로, 배포 시 학습 가능한 행렬을 고정된 가중치와 결합할 수 있게 함

→ fine-tuning에 비해 inference(추가 학습)이 없도록 함

4. 다른 기존 방법(e.g. prefix-tuning )과 함께 사용할 수 있음

→ 예시는 논문 부록E에 제공

Terminologies and Conventions (용어 및 규칙)

이 논문에서는 Transformer 아키텍처와 관련된 기존 용어들을 사용

- dmodel: 모델의 입력 및 출력 차원

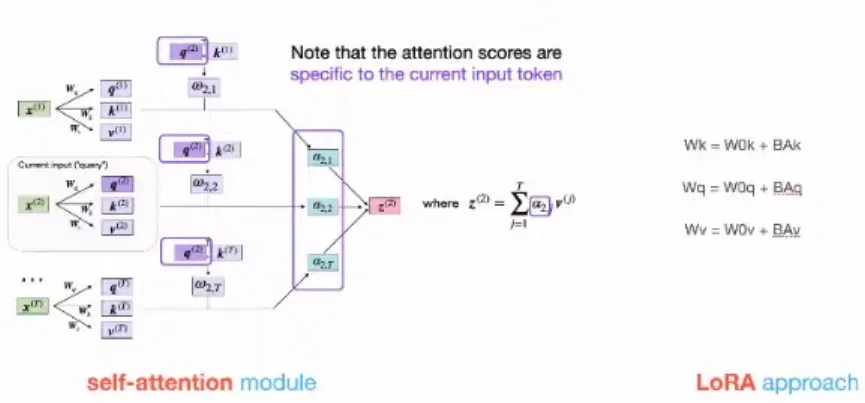

- Wq, Wk, Wv, Wo:

self-attention 모듈에서의 query/key/value/output projection 행렬 - W 또는 W0 : original 사전 훈련된 가중치 행렬 (GPT-3에서의 175B 파라미터 전체)

- ∆W는 적응 중 누적된 그래디언트 업데이트

- r: LoRA 모듈의 랭크 (low-rank)

- Adam 최적화 알고리즘 사용

- Transformer MLP feedforward 차원을 d_f fn = 4 × dmodel로 사용.

2. PROBLEM STATEMENT

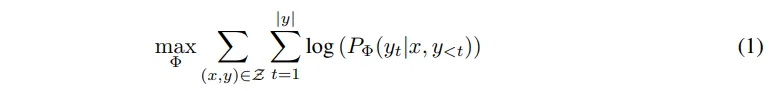

주요 사례로서 “언어 모델링 문제”를 설명

-

언어 모델링 문제 개요

- 사전 훈련된 모델: autoregressive language model = P_Φ(y|x)

- PΦ(y|x)는 입력 x를 기반으로 출력 y를 예측하는 모델

- 이 모델은 여러 작업을 처리 가능, e.g) GPT

- Φ로 매개변수화

- 이 모델을 하위 작업에 적응시키는 것을 고려

- 하위 작업: 요약, 기계 독해(MRC), 자연어에서 SQL(NL2SQL)

- 사전 훈련된 모델: autoregressive language model = P_Φ(y|x)

-

훈련 데이터셋

- 각 하위 작업은 context-target 쌍의 훈련 데이터셋으로 표현:

Z = {(xi, yi)}i=1,..,N에서 xi와 yi는 모두 토큰의 시퀀스

-

작업 예시

- NL2SQL ⇒ xi : 자연어 쿼리, yi: SQL 명령어

- 요약 ⇒ xi: 기사 내용, yi: 요약

-

full fine-tuning

- 모델을 사전 훈련된 가중치로 Φ0로 초기화하고, 조건부 언어 모델링 목표를 최대화하기 위해 가중치를 Φ0 + ∆Φ로 업데이트합니다.

- 모델을 사전 훈련된 가중치로 Φ0로 초기화하고, 조건부 언어 모델링 목표를 최대화하기 위해 가중치를 Φ0 + ∆Φ로 업데이트합니다.

-

full fine-tuning의 문제점

- 각 하위 작업마다 ∣Φ0|와 동일한 차원의 다른 파라미터 집합 ΔΦ를 학습해야 한다는 것.

- 따라서 사전 훈련된 모델이 매우 큰 경우, 미세 조정된 모델의 여러 독립적인 인스턴스를 저장하고 배포하는 것이 어렵거나 불가능할 수 있음.

-

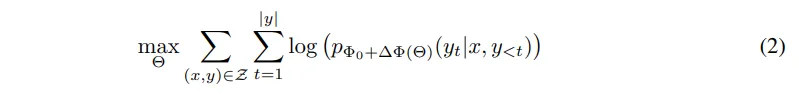

parameter-efficient approach (LoRA?)

- 효율적인 접근법: 더 작은 파라미터 Θ를 사용하여 모델을 효율적으로.

- 작은 파라미터 최적화: 큰 파라미터 집합 대신 작은 파라미터 집합 Θ를 최적화하여 모델을 조정합니다.

-

저랭크 표현 사용 제안:

- 계산 및 메모리 효율적인 방법으로 ∆Φ를 인코딩하기 위해 low-rank표현을 사용하는 것을 제안

- e.g) 사전 훈련된 GPT-3 175B의 경우, 파라미터 ∣Θ∣의 수는 ∣Φ0∣의 0.01%만큼 매우 작아질 수 있음

3. AREN’T EXISTING SOLUTIONS GOOD ENOUGH

기존 솔루션으로는 충분하지 않음

기존 솔루션

- transfer learning이 등장한 이후, 파라미터와 계산을 효율적으로 adaptation(적응)하고자하는 연구 많음

- transfer learning(전이 학습) : 이미 학습된 모델을 새로운 관련 작업에 적용하여 학습 효율성과 성능을 향상시키는 기법 (더 많은 연구 내용은 6장 참고)

- 언어 모델링의 경우 주로 두 가지 주요 전략

- 어댑터 레이어 추가: 어뎁터 레이어를 각각의 레이어에 삽입

- 입력 레이어 활성화 최적화: 입력 레이어의 활성화를 조정하여 모델을 적응시키는 방법.

⇒ 그러나 두 가지 전략 모두, 대규모 시스템 or 지연 시간이 중요한 경우 → 한계

기존 솔루션의 한계

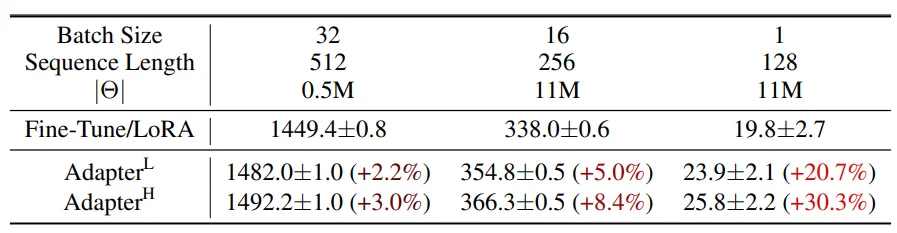

Adapter Layers Introduce Inference Latency

어댑터 레이어는 추론 지연을 유발합니다.

⇒ sequentially 한 계산으로 인해 추론에 지연(Inference Latency)을 유발한다

주요 설계 : 두 가지 주요 설계가 있습니다:

- Houlsby et al. (2019): Transformer 블록마다 두 개의 어댑터 레이어.

- Lin et al. (2020): Transformer 블록마다 하나의 어댑터 레이어와 추가 LayerNorm.

- 효과

- 지연 시간 감소 방법: 레이어를 줄이거나 다중 작업을 사용하여 지연 시간을 줄일 수 있습니다.

- 추가 계산 문제: 어댑터 레이어에서 발생하는 추가 계산을 완전히 피할 방법은 없습니다.

- 어댑터 레이어는 작은 병목 차원을 가지기 때문에 파라미터 수가 적습니다.

- 따라서 어댑터 레이어가 추가하는 계산량이 제한적이므로 큰 문제가 없는 것처럼 보입니다.

- 한계

- 대규모 신경망은 지연 시간을 낮추기 위해 하드웨어 병렬 처리를 사용하며, 어댑터 레이어는 순차적으로 처리되어야 함. → 배치 크기가 작은 온라인 환경에서 더 두드러짐.

- 모델 병렬 처리가 없는 일반적인 시나리오, (단일 GPU에서 GPT-2 중간 크기 모델로 추론을 실행하는 경우, 매우 작은 병목 차원에서도 어댑터를 사용할 때 지연 시간이 눈에 띄게 증가하는 것을 볼 수 있습니다(표 1).

- 대규모 신경망은 지연 시간을 낮추기 위해 하드웨어 병렬 처리를 사용하며, 어댑터 레이어는 순차적으로 처리되어야 함. → 배치 크기가 작은 온라인 환경에서 더 두드러짐.

- 모델 샤딩 문제: 모델을 여러 조각으로 나눌 때 문제가 더 심해집니다.

- 추가 동기 GPU 작업: 더 많은 동기화 작업이 필요해지기 때문입니다.

- 중복 저장 필요: 어댑터 파라미터를 여러 번 중복 저장하지 않으면 문제를 해결하기 어렵습니다.

Diretly Optimizing the Prompt is Hard

프롬프트(prefix 튜닝)를 직접 최적화하는 것은 어렵다

-

Prefix Tuning과 같은 다른 방법들도 해결해야 하는 문제가 있음

- 최적화가 어렵고, 학습 가능한 파라미터에 따라 성능이 일정하지 않음

- 적응을 위해 텍스트 길이의 일부를 사용하면, 실제 작업에 사용할 수 있는 텍스트 길이가 줄어듦

- 이로 인해 프롬프트 튜닝의 성능이 떨어질 수 있음Prefix Tuning

모델이 주어진 작업에 맞게 응답하도록, 입력 텍스트 앞에 짧은 프리픽스를 추가하여 모델을 조정하는 방법.-

예시

- 기본 입력: "날씨가 어때?"

- 프리픽스 추가 후 입력: "질문: 날씨가 어때?"

- 프리픽스 튜닝: 모델이 "질문:"이라는 프리픽스를 보고, 이 입력이 질문에 대한 답을 요구한다는 것을 알게 됩니다.

-

문제점

- 프리픽스를 추가하면, 실제로 작업을 처리할 수 있는 텍스트 길이가 줄어

-

문제점 예시

- 모델의 한계: 모델이 한 번에 100자의 텍스트만 처리할 수 있다고 가정합니다.

- 프리픽스 추가 전: "이 계약은…”

- 프리픽스 추가 후: "다음 텍스트를 법적 문서 형식으로 작성해 주세요: 이 계약은...”⇒ 사용 가능한 텍스트 길이 감소: 프리픽스를 추가하면, 실제 중요한 정보가 차지할 수 있는 공간이 줄어듦

-

4. OUR METHOD

- LoRA의 간단한 설계와 실용적인 장점을 설명합니다.

- 적용 범위: LoRA는 딥러닝 모델의 모든 밀집 층에 적용할 수 있지만, 우리는 실험에서 Transformer 언어 모델의 특정 가중치에 집중

4.1 LOW-RANK-PARAMETRIZED UPDATE MATRICES

- 영감

- 신경망은 행렬 곱셈을 수행하는 많은 밀집 층을 포함합니다. 이러한 층의 가중치 행렬은 일반적으로 풀랭크를 가지고 있습니다.

- 특정 작업에 적응할 때, 사전 훈련된 언어 모델이 낮은 내재적 차원을 가지며, 작은 공간으로 투영되어도 여전히 효율적으로 학습할 수 있다.

- 가정

- 가중치 업데이트도 적응(adaptation) 중 “intrinsic dimension”가 낮다고 가정

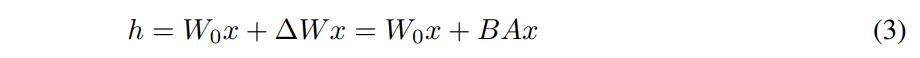

- 사전 훈련된 가중치 행렬 W0를 낮은 랭크 분해 W0+ΔW=W0+BA로 표현하여 업데이트

- W0∈Rd×k

- B와 A는 작은 랭크를 가짐, W0를 업데이트하는 데 사용

- B∈R^(d×r), A∈R^(r×k)

- 랭크 r ≪ min(d,k)

- 훈련 중 W0는 고정

- A와 B는 학습 가능한 파라미터

- ΔW=BA는 동일한 입력과 곱해지고, 결과는 합산됩니다.

- h=W_0x에 대해 수정된 순전파는 다음과 같은 결과(3)를 생성

재매개변수화 설명: 그림 1에서 우리가 사용한 방법을 설명합니다.

A는 랜덤 가우시안 값으로, B는 0으로 초기화하여 훈련 시작 시 ∆W = BA가 0이 되도록 합니다.

그 다음 ∆W x를 α/r로 스케일링합니다. 여기서 α는 r 내의 상수입니다. Adam을 사용하여 최적화할 때, 초기화를 적절히 스케일링하면 α를 조정하는 것이 학습률을 조정하는 것과 거의 동일합니다. 결론적으로, 우리는 α를 처음 선택한 r 값으로 설정하고 따로 조정하지 않습니다. 이렇게 하면 r 값을 바꿀 때마다 하이퍼파라미터를 다시 조정할 필요가 줄어듦.

A Generalization of Full Fine-tuning.

- 더 일반적인 형태의Fine-tuning : 사전 훈련된 파라미터 중 일부만 학습할 수 있도록 함.

- LoRA는 한 단계 더 나아가 가중치 행렬(W0)에 대한 업데이트가 풀랭크가 아니어도 됨.

= 모델의 모든 파라미터를 업데이트하지 않고, 일부 작은 행렬만 업데이트 - W0를 업데이트할 때, 저랭크 행렬 B와A로 나누어 업데이트

- 여기서 랭크 r은 B와 A의 차원

- LoRA의 랭크 r을 사전 훈련된 가중치의 랭크로 설정하면

= W0의 풀랭크와 동일하게 설정하면,⇒ Full Fine-tuning했을 때와 거의 동일한 성능 - 학습 가능한 파라미터 (B와 A의)수를 늘리면?

- LoRA 학습 : 원래 모델을 학습하는 것과 비슷해짐.

- 어댑터 기반 방법 : 단순히 MLP처럼 작동

- 프리픽스 기반 방법 : 긴 입력을 처리할 수 없는 모델로 변하게 됩니다.

No Additional Inference Latency

추가적인 추론 지연 없음.

- 실제 사용 환경에 배포할 때, W=W0+BA를 미리 계산하고 저장하여, 일반적인 방법으로 추론을 수행할 수 있음

- W0와 BA는 모두 R^(d×k) 차원을 가짐

- 다른 작업으로 전환할 때, BA를 빼고 새로운 B0A0를 추가하여 원래의

W0를 빠르게 복구할 수 있음

- 이는 메모리 오버헤드가 거의 없는 빠른 작업 = 메모리를 거의 사용하지 않음(?)

- 이 과정은 추론 시 미세 조정된 모델과 비교하여 추가적인 지연을 발생시키지 않는다는 것을 보장

4.2 APPLYING LORA TO TRANSFORMER

- 원칙적으로 LoRA 적용

- 파라미터 수를 줄이기 위해 신경망의 가중치 행렬의 임의의 부분 집합에 LoRA를 적용할 수 있다.

- LoRA를 사용해서 신경망의 가중치 중 일부만 업데이트하여 학습할 수 있다.

- Transformer 구조에 LoRA 적용

-

self-attention 모듈에 4개의 가중치 행렬(Wq, Wk, Wv, Wo) ⇒ LoRA적용

-

MLP 모듈에 2개의 가중치 행렬

-

출력 차원이 보통 어텐션 헤드로 나뉘지만, 우리는 Wq (또는 Wk, Wv)를 dmodel × dmodel 크기의 단일 행렬로 간주

-

간편성과 파라미터 효율성을 위해, 우리는 하위 작업에 대해 attention layer에서만 가중치 조정하고 MLP 모듈은 고정 (따라서 하위 작업에서 훈련되지 않습니다).

-

- 7.1장) Transformer에서 다양한 유형의 어텐션 가중치 행렬을 조정하는 효과 연구

- 향후 연구 시사점) MLP 층, LayerNorm 층, 그리고 바이어스를 조정하는 실증적 조사는 향후 연구로 남겨 둡니다.

Practical Benefits and Limitations.

실제적인 이점과 한계.

- 실제적인 이점

- 메모리 및 저장 공간 감소

- LoRA를 사용하면 VRAM 사용량을 크게 줄일 수 있습니다. VRAM: GPU가 데이터와 이미지를 신속하게 처리하고 화면에 표시하기 위한 메모리

- GPT-3 175B에서는 훈련 중 VRAM 사용량을 1.2TB에서 350GB로 줄일 수 있습니다.

- LoRA를 사용하면 VRAM 사용량을 크게 줄일 수 있습니다. VRAM: GPU가 데이터와 이미지를 신속하게 처리하고 화면에 표시하기 위한 메모리

- 여러 맞춤형 모델을 쉽게 만들고 교체할 수 있습니다.

- GPU 사용 감소 : 훨씬 적은 수의 GPU로 훈련할 수 있으며, I/O 병목 현상을 피할 수 있음.

- 작업 전환 비용 감소 : LoRA 가중치만 교체하여 작업을 전환함으로써 작업 전환 비용을 절감할 수 있음.

- 훈련 속도 향상 : Full Fine-tuning했을 때와 비교하여 훈련 속도가 25% 빨라짐.

- 메모리 및 저장 공간 감소

- 한계점

- 서로 다른 A와 B를 사용하는 작업을 동시에 처리하는 것.

= 서로 다른 작업의 입력을 단일 순전파에서 처리하는 것. - 따라서, 지연 시간이 중요하지 않은 경우, 가중치를 병합하지 않고 LoRA 모듈을 동적으로 선택하여 사용할 수 있음.

- 서로 다른 A와 B를 사용하는 작업을 동시에 처리하는 것.

5. EMPIRICAL EXPERIMENTS

- LoRA의 성능을 RoBERTa, DeBERTa, GPT-2에서 평가한 후, GPT-3 175B로 확장

- RoBERTa와 DeBERTa는 GLUE 벤치마크로 평가했고, GPT-2는 이전 연구와 비교

- GPT-3에서는 대규모 실험을 위해 WikiSQL과 SAMSum 데이터셋 사용

- 실험 task: 자연어 이해(NLU)와 생성(NLG)

- 실험에 사용된 데이터셋 상세 내용 - 부록 C 참조, 모든 실험은 NVIDIA Tesla V100 사용

5.1 BASELINES

- 다양한 기준선과 비교하기 위해, 우리는 이전 연구에서 사용된 설정 및 설정값 재사용.

- 그러나 이는 일부 기준선이 특정 실험에서만 나타날 수 있음.

Fine-Tuning (FT)

다양한 기준선과 비교하기 위해, 우리는 이전 연구에서 사용된 설정을 복제, 가능한 경우 보고된 숫자를 재사용

Bias-only or BitFit

Bias-only 또는 BitFit은 다른 모든 것을 고정한 채 바이어스 벡터만 훈련하는 기준선

Prefix-embedding tuning (PreEmbed)

- Prefix임베딩 튜닝(PreEmbed)은 입력 토큰 사이에 특별한 토큰을 삽입

- 특별한 토큰: 학습 가능한 단어 임베딩을 가지며 일반적으로 모델의 어휘에 포함되지 않음

- 이를 어디에 배치하는지가 성능에 영향

- 프롬프트 앞에 붙이는 "프리픽싱"과 뒤에 붙이는 "인픽싱"

- lp (프리픽스 토큰 수)와 li (인픽스 토큰 수)로 나타냅니다. 학습 가능한 매개변수의 수는 |Θ| = dmodel × (lp + li)입니다.

Prefix-layer tuning (PreLayer)

- 프리픽스 레이어 튜닝(PreLayer)은 프리픽스 임베딩 튜닝의 확장

- 일부 특별한 토큰에 대해 단어 임베딩(또는 임베딩 층 후 활성화)을 학습하는 대신, 모든 Transformer 층 후 활성화를 학습

- 이전 층에서 계산된 활성화는 단순히 학습 가능한 것으로 대체

- 학습 가능한 매개변수의 수는 |Θ| = L × dmodel × (lp + li)

- L은 Transformer 층의 수입니다.

Adapter tuning

- self-attention 모듈(MLP 모듈)과 이후 잔차 연결 사이에 어댑터 층을 삽입

- 어댑터 층에는 비선형성을 가진 두 개의 완전 연결 층⇒ AdapterH라고 부fms

- 더 효율적인 디자인

- MLP 모듈 이후와 LayerNorm 이후에만 어댑터 층을 적용 ⇒ AdapterL라고 부름

- 이는 Pfeiffer et al. (2021)이 제안한 또 다른 디자인과 매우 유사 ⇒ AdapterP라고 부름

- AdapterDrop (Rucklé et al., 2020)이라는 또 다른 베이스라인을 포함합니다.

- 더 큰 효율성을 위해 일부 어댑터 층을 제거합니다 (AdapterD).

- |Θ| = LˆAdpt ×(2×dmodel ×r+r+dmodel)+ 2×LˆLN ×dmodel

- LˆAdpt: 어댑터 층의 수

- LˆLN: 학습 가능한 LayerNorm의 수

LoRA

- LoRA는 기존 가중치 매트릭스에 병렬로 학습 가능한 랭크 분해 매트릭스 쌍을 추가

- 단순화를 위해 Wq와 Wv에만 LoRA 적용

- 학습 가능한 매개변수의 수는 랭크 r과 원래 가중치의 형태에 의해 결정됩니다: |Θ| = 2 × LˆLoRA × dmodel × r,

- LˆLoRA: LoRA를 적용하는 가중치 매트릭스의 수

5.2 ROBERTA BASE/LARGE

RoBERTa (Liu et al., 2019)은 BERT (Devlin et al., 2019a)에서 처음 제안된 사전 훈련 레시피를 최적화하여 더 많은 학습 가능한 파라미터를 추가하지 않고도 성능을 향상시켰습니다.

최근 더 큰 모델들이 등장했지만, RoBERTa는 여전히 크기에 비해 실무자들 사이에서 인기 있고 경쟁력 있는 모델

- HuggingFace 라이브러리에서 사전 훈련된 RoBERTa base와 large 모델을 사용하여, GLUE 벤치마크 작업에서 다양한 적응 방법의 성능을 평가

- 이전 연구의 설정에 따라 실험을 재현

- 공정한 비교를 위해, 어댑터와 비교할 때 LoRA를 평가 방법에 두 가지 중요한 변경

- 모든 작업에 대해 동일한 배치 크기를 사용, 어댑터 기준선과 맞추기 위해 시퀀스 길이를 128로 설정

- MRPC, RTE, STS-B 작업을 위해 사전 훈련된 모델로 초기화하고, 이미 다른 작업에 적응된 모델을 사용하지 않음

5.3 DEBERTA XXL

- DeBERTa (He et al., 2021)

- BERT의 최신 변형 모델로, 훨씬 더 큰 규모로 훈련

- GLUE (Wang et al., 2019)와 SuperGLUE (Wang et al., 2020)와 같은 벤치마크에서 매우 경쟁력 있는 성능

- LoRA가 GLUE에서 완전히 미세 조정된 DeBERTa XXL (1.5B)의 성능과 비슷한지 평가

- 결과는 표 2의 하단 섹션에/사용된 하이퍼파라미터에 대한 자세한 내용은 D.2 절을 참조

5.4 GPT-2 MEDIUM/LARGE

LoRA가 NLU(자연어 이해) 작업에서 전체 미세 조정에 대한 경쟁력 있는 대안이 될 수 있음을 보여줌.

그 후, LoRA가 GPT-2 중간 및 대형 모델과 같은 NLG(자연어 생성) 모델에서도 좋은 성능을 보이는지 확인하고자 함.

- 공정한 비교를 위해 Li & Liang (2021)의 실험 설정을 최대한 비슷하게 유지

- 공간 제약으로 인해, 이 섹션에서는 E2E NLG 챌린지(Table 3) 결과만 제시합니다.

- WebNLG와 DART 결과는 F.1 절에서 확인 / 사용된 하이퍼파라미터 목록은 D.3 절

5.5 SCALING UP TO GPT-3 175B

GPT-3로 확장 (1750억 개의 파라미터를 가진 모델)

- 높은 훈련 비용 때문에 모든 항목에 대해 결과를 제공하지 않고, 주어진 작업에 대한 전형적인 표준 편차만 보고 / 사용된 하이퍼파라미터에 대한 자세한 내용은 D.4 절에서 확인

- 표 4

- LoRA는 세 가지 데이터셋 모두에서 미세 조정 기준선과 일치하거나 이를 초과

- 도표 2

- 모든 방법이 학습 가능한 파라미터를 더 많이 가짐으로써 항상 이득을 보는 것은 아님

- 프리픽스 임베딩 튜닝에서 256개 이상의 특수 토큰을 사용하거나 프리픽스 레이어 튜닝에서 32개 이상의 특수 토큰을 사용하면 성능이 크게 떨어집니다.

- 원인 추측: 더 많은 특수 토큰이 입력 분포를 사전 훈련 데이터 분포에서 더 멀어지게 하는 원인이 될 수 있습니다.

- 추가 연구

- 섹션 F.3에서 데이터가 적은 환경에서 다양한 적응 접근법의 성능을 조사합니다.

6. RELATED WORKS

Transformer Language Models.

self-attention을 많이 사용하는 sequence-to-sequence 모델

Transformer 기반 언어 모델은 많은 NLP 작업에서 최고 성능

- 새로운 패러다임

- BERT와 GPT-2 같은 큰 모델

- 대량의 텍스트로 훈련된 큰 Transformer 언어 모델

- 일반 데이터로 먼저 훈련하고, 작업별 데이터로 미세 조정하면 성능이 크게 향상

- 더 큰 Transformer를 훈련하는 것이 일반적으로 더 나은 성능

→ (논문 발표 시점 기준) GPT-3가 현재까지 훈련된 가장 큰 단일 Transformer 언어 모델로, 1750억 개의 파라미터

Prompt Engineering and Fine-Tuning.

- GPT-3는 몇 가지 예제로도 동작을 조정할 수 있지만, 입력 프롬프트에 크게 의존 → 이를 위해 프롬프트를 구성하고 형식화하는 기술이 필요함

- 미세 조정은 일반 도메인에서 사전 훈련된 모델을 특정 작업에 맞게 다시 훈련시키는 것 → GPT-3는 크기가 너무 커서 일반적인 방식의 fine-tuning 어려움. (큰 체크포인트와 많은 메모리가 필요)

Parameter-Efficient Adaptation.

- 어댑터 레이어:신경망의 기존 층 사이에 어댑터 레이어를 삽입하는 것을 제안

- 해당 논문 방법: 가중치 업데이트에 저랭크 제약을 사용하여 지연 없이 주 가중치와 병합

- COMPACTER는 Kronecker 곱을 사용하여 어댑터 층을 효율적으로 만드는 최신 방법

- LoRA: 어댑터 층과 달리 추론 시 지연 시간을 추가하지 않dma

⇒ LoRA를 다른 방법들과 결합하여 더 효율적으로 만들 가능성

(입력 단어 임베딩을 최적화하는 방법 등)

Low-Rank Structures in Deep Learning.

- low-rank 구조는 머신러닝에서 흔합니다.

- 많은 문제들이 low-rank 구조를 가지고 있음, 특히 과매개변수화된 신경망에서.

- 이전 연구들은 신경망 훈련 시 low-rank 제약을 추가했지만, 동결된 모델에 저순위 업데이트를 적용하는 연구는 없었음

- 이론적으로, low-rank구조를 가진 개념 클래스에서는 신경망이 다른 고전적 방법보다 더 잘 작동, low-rank적응이 적대적 훈련에 유용하다는 연구도 존재

⇒ low-rank 적응 업데이트의 효율성 근거

7. UNDERSTANDING THE LOW-RANK UPDATES

LoRA의 실질적인 장점을 바탕으로, 하위 작업에서 학습된 저랭크 적응의 특성을 더 설명

- 저랭크 구조의 이점: 저랭크 구조는 하드웨어 요구사항을 낮추고 여러 실험을 동시에 할 수 있게 합니다. 또한, 업데이트된 가중치가 사전 훈련된 가중치와 어떻게 관련되는지 이해하기 쉽게 만듭니다.

- GPT-3 175B 연구: GPT-3 175B에서 학습 가능한 파라미터를 최대 10,000배 줄이면서도 성능을 유지했습니다.

- 우리는 다음 질문들에 답하기 위해 일련의 경험적 연구를 수행합니다:

- 연구 질문 1: 파라미터 제한이 있을 때, 어떤 가중치를 조정해야 성능을 극대화할 수 있을까요?

- 연구 질문 2: 최적의 적응 행렬 ∆W는 정말로 낮은 랭크인가요? 그렇다면, 적절한 랭크는 무엇인가요?

- 연구 질문 3: ∆W와 W의 관계는 무엇인가요? ∆W는 W와 얼마나 관련이 있나요? ∆W는 W에 비해 얼마나 큰가요?

- 질문 (2)와 (3)에 대한 답변이 하위 작업에 사전 훈련된 언어 모델을 사용하는 기본 원리를 밝혀줄 것

7.1 WHICH WEIGHT MATRICES IN TRANSFORMER SHOULD WE APPLY LORA TO?

제한된 파라미터 예산 내에서, 하위 작업에서 최고의 성능을 얻기 위해 LoRA를 어떤 가중치에 적용해야 할까요?

4.2절에서 언급했듯이, 우리는 자기 주의 모듈의 가중치 행렬만을 고려합니다.

- 파라미터 예산 설정 : 우리는 GPT-3 175B에서 1800만 개의 파라미터 예산을 설정했으며, 이는 주의 가중치 한 종류를 적응시키면

- 모든 파라미터를 ΔWq 또는 ΔWk에만 할당하면 성능이 낮아지지만, Wq와 Wv를 모두 적응시키면 최고의 성능을 얻을 수 있습니다.

- 랭크 4라도 ΔW에서 충분한 정보를 포착할 수 있음을 시사하며, 더 큰 랭크로 단일 유형의 가중치를 적응시키는 것보다 여러 가중치 행렬을 적응시키는 것이 더 바람직하다는 것을 의미

8. CONCLUSION AND FUTURE WORK

(13쪽까지)

거대한 언어 모델을 미세 조정하는 데는 많은 비용이 듭니다.

LoRA는 추론 지연 없이 모델 품질을 유지하면서 효율적으로 적응하는 방법

델 파라미터의 대부분을 공유하여 서비스로 배포할 때 빠른 작업 전환을 가능하게

LoRA의 원칙은 Transformer 외 다른 신경망에도 적용될 수 있습니다.

- 미래 연구 1: LoRA를 다른 방법과 결합하여 개선할 수 있음

- 미래 연구 2: LoRA가 미세 조정보다 사전 훈련된 특징이 어떻게 하위 작업에 적용되는지 연구

- 미래 연구 3; 현재는 주로 직관에 의존하여 LoRA를 적용할 가중치 행렬을 선택. 이를 위한 더 원칙적인 방법이 있을까요?

- 미래 연구 4 : ΔW의 랭크 결핍을 통해 W도 연구할 수 있습니다.