순환 신경망은 인공 신경망의 한 종류로, 유닛간의 연결이 순환적 구조를 갖는 특징을 갖고 있다. 이러한 구조는 시변적 동적 특징을 모델링 할 수 있도록 신경망 내부에 상태를 저장할 수 있게 해주므로, 순방향 신경망과 달리 내부의 메모리를 이용해 시퀀스 형태의 입력을 처리할 수 있다.

[Recurrent]

sequential 데이터 처리를 위해 설계된 신경망의 한 종류

시간에 따른 데이터를 모델링해 시계열, 자연어, 음성 등 분야에서 사용됨

[매커니즘]

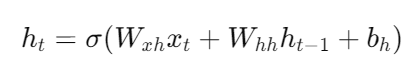

각 시점의 입력과 이전 시점의 은닉 상태를 결합해 새로운 은닉상태 ht 생성

- Wxh: 입력->은닉상태 가중치

- xt: t시점 입력

- Whh: 이전 은닉->현재 은닉 가중치

- ht-1: t-1시점 은닉상태

- bh: bias

- 시그마: 활성화 함수

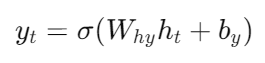

시점t에서의 출력 yt 생성

- Why: 은닉상태->출력 가중치

- by: bias

- 시그마: 활성화 함수

[은닉층]

이전 단계의 정보를 현재 단계로 전달하며 전체 맥락을 이해할 수 있음

누적된 정보를 포함하고 있으므로 현재 시점에서 예측에 필요한 partial정보 제공

[한계]

sequence가 길어지면 Vanishing gradient 문제와 Exploding Gradient 문제 발생

Long Short-Term Memory와 GRU 같은 변형 구조 개발

결국 Transformer가 전부 압도한 듯 하다.