[간단 논문 리뷰] Does Fine-Tuning LLMs on New Knowledge Encourage Hallucinations?

Abstract

- 대형 언어 모델이 Supervised Fine-Tuning을 통해 정렬될 때, 이들은 이전훈련을 통해 획득하지 않은 새로운 사실 정보를 접할 수 있습니다.

- 이는 모델이 기존 지식에 기반하지 않은 사실을 생성하도록 훈련하여, 모델이 부정확한 응답을 환각하는 행동을 배우게 될 수 있다고 한다.

- 해당 논문에서는 LLM에서 미세조정을 통해 새로운 지식을 습득하는데 어려움을 겪고 있다는 것을 입증하며, 새로운 지식을 도입하는 미세 조정 예제가 모델의 지식과 일치하는 예제보다 상당히 느리게 학습됨을 보여줍니다.

- 그리고 또한, 새로운 지식을 포함한 예제가 궁극적으로 학슴됨에 따라, 모델의 환각경향이 선형적으로 증가함을 발견하였습니다.

- 대형 언어 모델은 주로 사전학습을 통해 사실지식을 획득하고, 미세조정은 이를 효율적으로 사용하는 방법을 가르친다는 견해를 뒷받침합니다.

사전 훈련의 중요성

- LLM은 텍스트 코퍼스에서 사전 훈련하며, 그들의 매개변수에 상당한 지식을 내장합니다.

- 이후에는 원하는 행동으로 추가정렬하기 위해, SFT, PPO, RLHF등 Instruction-Tuning을 통해 이루어집니다.

- 미세 조정 단계에서 LLM은 Output을 기반으로 훈련이 되는데, 그 결과 모델은 사전 훈련에서 습득한 지식을 넘어서는 새로운 사실 정보를 접할 수 있습니다.

- 하지만, 이 새로운 사실 정보를 배우는데 단순히 적응하여, 새로운 지식이 노출된 모델이 부정확한 응답을 환각하도록 유도할 수 있습니다.

- 이는 모델이 본질적으로 기존 지식에 기반하지 않은 사실을 생성하도록 훈련을 받았기 때문입니다.

- 해당 논문에서는 사전학습을 통해 학습한 지식이 아닌 새로운 지식이 포함된 미세조정 데이터가 모델의 기존 지식에 대한 환각 경향과 선형적으로 상관관계가 있음을 보여줍니다.

- 훈련 역학 분석을 통해 LLM이 알려지지 않은 사례를 적합하는 속도가 상당히 느리다는 것을 발견하였고, 이는 미세 조정 동안 LLM이 새로운 사실적 지식을 통합하는 데, 어려움을 겪고 있음을 나타냅니다.

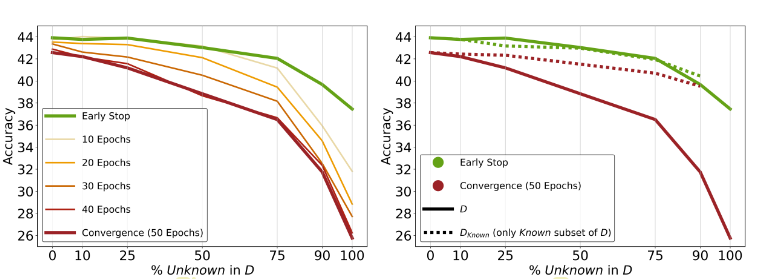

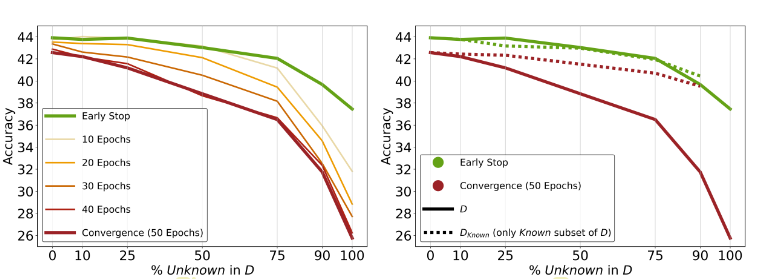

How Harmful are Unknown Examples?

- 아래 그림을 통해, Unknown 예제 비율에 따른 성능을 나타내는데, 새로운 지식이 많은 데이터셋의 경우, 미세 조정과 관계없이 성능 저하를 초래하며, 이는 새로운 지식이 기존 지식보다 덜 유용하다는 것을 나타냅니다.

- 더 많은 에포크로 훈련하는 것이 대개 성능을 감소시키며, 이는 과적합으로 설명이 될 수 있습니다.

- 아래 그래프를 보시면, 새로운 지식에 대해 LLM은 기존 학습된 지식보다 지식을 습득하는데 어려움을 겪고 있고, 이로 인해 학습 시간이 증가함을 볼 수 있습니다.

Understanding Knowledge Types: Their Value and Impact

결론

- 해당 논문을 읽으면서, 기존 Task(번역, 요약, 기계독해) 특화 LLM을 개발하듯이, 도메인에 대한 지식을 Instruction-Tuning을 주입하는 것은 좋지 못하다는 것을 깨달았습니다

- 실제 저도, 도메인 데이터셋으로 LoRA & Full-Tuning을 진행했을 때, 모델이 잘 학습이 되지 않았는데, 그 이유가 사전학습을 통해 얻은 지식을 기반으로 Instruction-Tuning을 통해 인간의 선호도에 맞게 답변을 출력하기에, Instruction-Tuning은 기존 지식을 활용하여, 답변을 한다는 것을 다시 깨닫게 되었습니다.

- 그래서 Physics of Language Model 논문에서처럼 좀 더 도메인에 특화된 지식을 주입하기 위해, Continual Pretrain 단계에서 Instruction-Pretrain 방식으로 text 컬럼을 QA 데이터셋으로 구축하여 도메인 모델을 만들고자 합니다.

- 추후에 이 부분 실험을 진행하고, 성공하게 된다면 따로 Velog에 리뷰하는 시간을 가지도록 하겠습니다.