딥러닝의 주요 스킬

Data augmentation( 데이터 증강기법 )

과적합을 해결할 가장 좋은 방법으로, 데이터의 개수를 늘리는 방법.

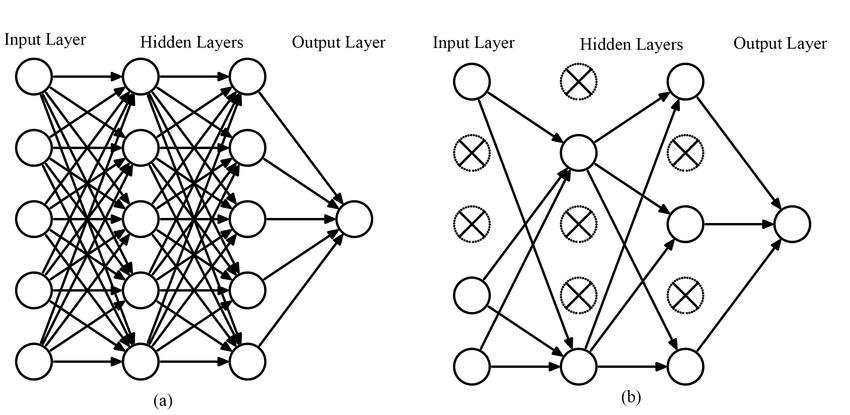

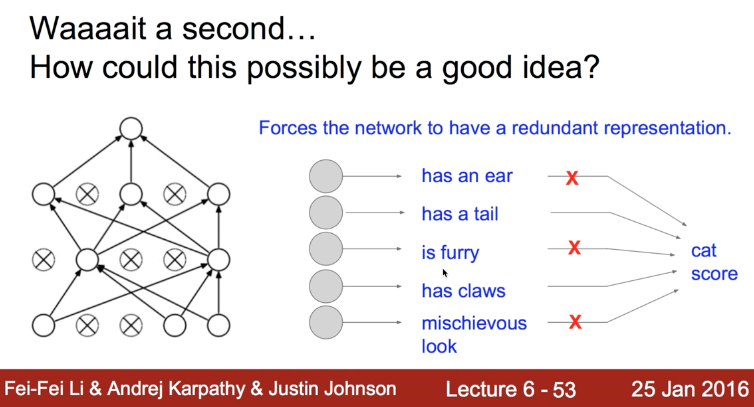

Dropout (드랍아웃)

과적합을 해결할 수 있는 가장 간단한 방법, 각 노드들이 이어진 선을 빼서 없애버리는 방식.

위와 같이 많은 노드들이 있다고 가정했을 때, 이들 중 일부만 사용해도 충분히 결과를 낼 수 있고, 이들 중에서 충분할만큼의 전문가만 선출해서 반복적으로 결과를 낸다면, 오히려 균형잡힌 결과가 나올 가능성이 높다.

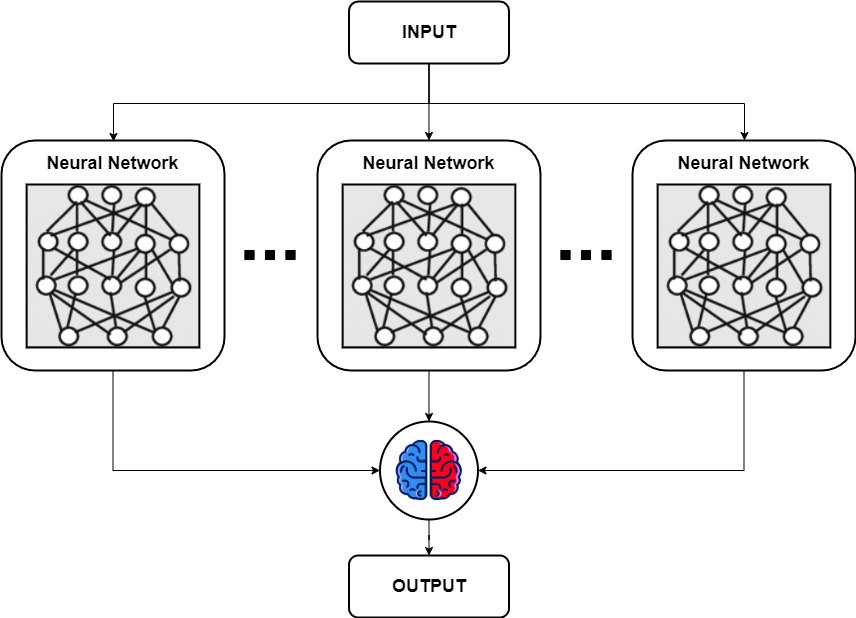

Ensemble (앙상블)

- 앙상블 기법은 컴퓨팅 파워만 충분하다면 가장 시도해보기 쉬운 방법.

- 여러개의 딥러닝 모델을 만들어 각각 학습시킨 후 각각의 모델에서 나온 출력을 기반으로 투표를 하는 방법.

- 랜덤 포레스트의 기법과 비슷하다.

여러개의 모델에서 나온 출력에서 다수결로 투표(Majority voting)를 하는 방법도 있고, 평균값을 구하는 방법도 있고, 마지막에 결정하는 레이어를 붙이는 경우 등 다양한 방법으로 응용이 가능하다.

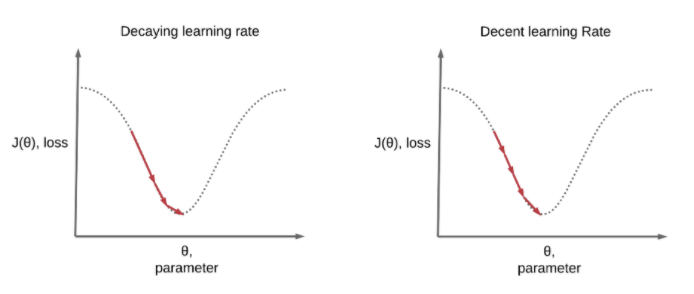

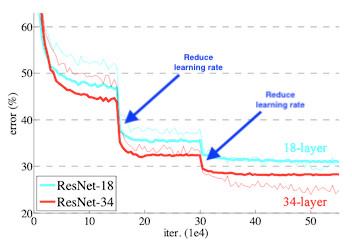

Learning rate decay (Learning rate schedules)

Local minimum에 빠르게 도달하고 싶을 때 사용.

효과적으로 Local minimum에 접근을 할 수있게 한다.