이번 포스팅에서는 Pacific Graphics 2025에 발표된 3D 의상 복원 관련 논문을 리뷰한다. 기존 3DGS(3D Gaussian Splatting) 연구들이 겉면 복원에 치중했다면, 이 논문은 의상의 안감(Inner Layer)까지 완벽하게 복원하는 파이프라인을 제안한다.

논문 정보

Title: Clothing Twin: Reconstructing Inner and Outer Layers of Clothing Using 3D Gaussian Splatting

Authors: Munkyung Jung, Dohae Lee, In-Kwon Lee (Yonsei Univ. & MeTown Inc.)

Conference: Pacific Graphics 2025 (Computer Graphics Forum)

1. Abstract: 핵심 요약

1.1 문제 (Problem):

기존 3D 의상 복원은 마네킹에 입힌 상태로 촬영하므로 마네킹에 가려진 안감(Inner layer)을 복원할 수 없다. 단순히 겉면과 안면을 따로 찍어 합치는(Naive merging) 방식은 기하학적 불일치와 Gaussian Splat 간의 충돌(Artifact)로 인해 시각적 품질이 매우 떨어진다 .

1.2 해결책 (Method):

Clothing Twin이라는 새로운 프레임워크를 제안한다.

Data Acquisition: 의상을 똑바로 입혀서 한 번, 뒤집어 입혀서(Inside-out) 한 번 촬영하여 가려진 부분이 없도록 한다.

Geometric Alignment: 겉감과 안감의 메쉬를 추출한 뒤, Non-Rigid ICP를 통해 안감을 겉감 내부로 정교하게 밀어 넣는다.

Specialized Rendering: 겹쳐진 Gaussian들을 구분하기 위해 Mesh-Guided Back-face Culling과 Back-to-Front Alpha Blending이 적용된 특수 렌더러를 사용한다 .

1.3 결과 (Result):

안감과 겉감이 시각적 아티팩트 없이 자연스럽게 렌더링되며, 기존 방식 대비 PSNR, SSIM, LPIPS 등 모든 지표에서 우수한 성능을 달성했다.

2. Prerequisites: 이론적 배경

이 논문을 깊게 이해하기 위해서는 Ghost Mannequin 기법의 한계와 3DGS의 렌더링 특성을 먼저 짚고 넘어가야 한다.

2.1. Ghost Mannequin & The Challenge

E-커머스에서는 옷이 마치 투명 인간에 입혀진 것처럼 목 부분 안쪽이 보이는 '고스트 마네킹' 사진을 많이 쓴다. 2D 이미지에서는 포토샵으로 마네킹을 지우고 다른 사진에서 안감을 떼어와 합성하면 그만이지만, 3D 복원에서는 이것이 매우 어렵다. 수백 장의 다각도 이미지에서 마네킹을 일관되게 지우고 안감을 채워 넣는 것은 수작업으로 불가능에 가깝기 때문이다.

2.2. 3D Gaussian Splatting의 한계

3DGS는 공간 상에 타원체(Gaussian)를 뿌려서 장면을 표현한다. 문제는 이것이 명시적인 표면(Mesh)이 없는 Point Cloud 기반이라는 점이다. 얇은 천의 앞면(Outer)과 뒷면(Inner)이 아주 가깝게 붙어 있으면, 렌더링 시 Gaussian들이 서로 겹치거나 순서가 뒤바뀌는 아티팩트가 발생한다 . 이를 해결하려면 렌더링 단계에서 어떤 Gaussian이 겉감이고 안감인지 명확히 구분해 줄 강력한 기하학적 가이드(Geometric Prior)가 필요하다.

3. Method: Clothing Twin Pipeline

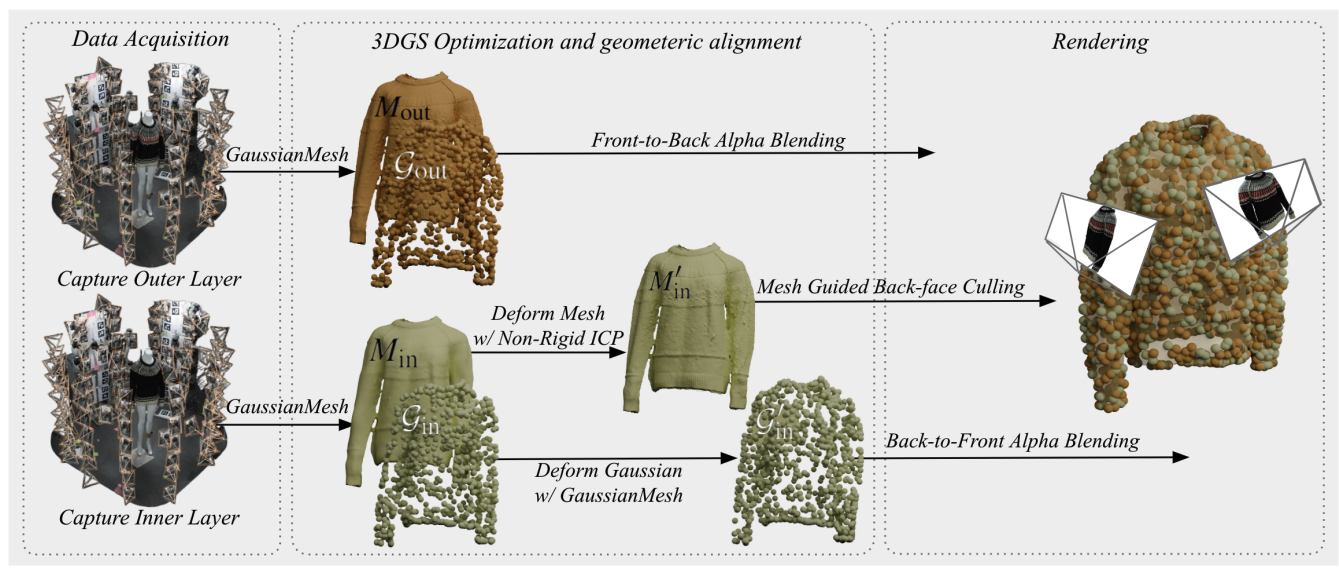

이 논문의 파이프라인은 크게 데이터 획득, 기하학적 정렬, 그리고 렌더링의 3단계로 나뉜다.

3.1. Data Acquisition Protocol (데이터 획득)

가장 직관적인 해결책이다. 물리적으로 안감을 찍을 수 없다면, 옷을 뒤집어서(Inside-out) 찍으면 된다.

-Protocol: 의상을 똑바로 입혀서 겉감 데이터셋(Outer)을 얻고, 옷을 뒤집어 입혀서 안감 데이터셋(Inner)을 얻는다.

-Preprocessing: 뒤집어 찍은 안감 이미지는 겉감과 정합하기 위해 좌우 반전(Horizontal Flip)을 시킨다. 또한, 안감은 보통 겉감보다 빛을 덜 받아 어둡게 찍히므로, 겉감과의 컬러 일관성을 위해 톤 매핑(Tone Mapping)을 수행하여 밝기를 보정한다 .

3.2. 3DGS Optimization & Geometric Alignment

단순히 두 데이터셋으로 3DGS를 각각 학습시키면 옷의 주름이나 형태가 미세하게 달라서 겹쳐지지 않는다. Mesh를 가이드로 사용하여 이 문제를 푼다.

1.Mesh Reconstruction: NeuS2 같은 기법으로 겉감()과 안감()의 메쉬를 각각 추출한다.

2.GaussianMesh: 각 메쉬 표면에 Gaussian을 바인딩하여 학습시킨다. 이렇게 하면 Gaussian들이 메쉬 표면 근처에 위치하게 되어 제어가 쉬워진다.

3.Non-Rigid ICP: 안감 메쉬()를 겉감 메쉬() 내부로 밀어 넣기 위해 비강체(Non-Rigid) ICP 알고리즘을 사용한다. 강체 변환(Rigid)만으로는 옷의 주름 차이를 극복할 수 없기 때문에, 메쉬를 변형(Deformation)시켜 겉감 안쪽에 딱 맞게 정렬한다.

4.Gaussian Deformation: 메쉬가 변형된 위치 정보를 바탕으로, 거기에 붙어있는 안감 Gaussian()들도 같이 이동시킨다.

3.3 Specialized Rendering Pipeline (Core Contribution)

기하학적으로 정렬했더라도, 렌더링 시 Gaussian이 뭉개져 보일 수 있다. 이를 해결하기 위한 3가지 핵심 렌더링 기법을 제안한다.

1) Mesh-Guided Back-face Culling

Gaussian의 위치만으로는 앞/뒤를 구분하기 힘들다. 따라서 카메라에서 픽셀로 Ray를 쏘아 가장 먼저 만나는 메쉬 면(Face)을 찾는다.

- Ray와 메쉬 Normal의 내적()을 계산하여, 양수면 안감(Inner), 음수면 겉감(Outer)을 렌더링하도록 픽셀별로 결정한다.

- 이로써 주름진 곳에서도 안감과 겉감이 섞이지 않는다.

2) Back-to-Front Alpha Blending

일반적인 3DGS는 카메라 가까운 것부터 먼 순서대로(Front-to-Back) -blending을 한다. 하지만 안감(Inner Layer)은 옷의 안쪽에서 바깥을 보는 시점(Inside-out)으로 촬영되었지만, 실제 렌더링은 바깥에서 안을 들여다보는 시점이다.

- 따라서 안감을 렌더링할 때는 정렬 순서를 반대로(Back-to-Front) 하여 블렌딩해야 올바른 투명도와 색상이 나온다.

3) SH Incident Angle Recalculation

Spherical Harmonics(SH)로 색을 계산할 때도 시점이 반전된 것을 고려해야 한다.

-

기존 View Direction()을 반사 평면(Reflection Plane) 기준으로 반사시킨 벡터()를 사용하여 SH를 계산해야, 뒤집힌 면에 대해서도 정확한 조명 효과를 얻을 수 있다.

4. Experiments: 성능 검증

4.1 Quantitative Results (정량 평가)

합성 데이터셋(Synthetic)을 사용하여 Ground Truth와 비교했다.

| Method | PSNR | SSIM | LPIPS |

|---|---|---|---|

| Outer only (기존 3DGS) | 31.89 | 0.9808 | 0.0099 |

| Outer + Inner (Naive) | 30.28 | 0.9789 | 0.0176 |

| Ours (Clothing Twin) | 32.03 | 0.9887 | 0.0091 |

- 해석: 단순히 합친 것(Naive)보다 훨씬 높은 성능을 보이며, 겉감만 있는 경우보다도 수치가 높다. 이는 안감이 보이는 넥라인이나 소매 부분의 퀄리티 차이 때문이다.

4.2 Ablation Study (구성 요소 검증)

저자들은 제안한 3가지 렌더링 기법의 유효성을 검증했다.

1. w/o Mesh Guidance: 주름진 부분에서 안감이 겉감을 뚫고 나오는 아티팩트 발생.

2. w/o Back-to-Front Blending: 안감의 색상이 탁해지고 불투명하게 렌더링됨.

3. w/o Angle Recalculation: 조명이 어색하고 색상 왜곡 발생.

5. Conclusion

Clothing Twin은 "어떻게 안감을 찍을 것인가?"라는 물리적 문제와 "어떻게 3DGS로 얇은 두 겹을 표현할 것인가?"라는 렌더링 문제를 동시에 해결했다.

Contribution: 안/겉감 동시 복원 파이프라인 정립, Inter-layer artifact를 제거하는 특수 렌더러 개발.

Future Work: 물리 시뮬레이션(Physics-based simulation)과 연동하여 실제로 입어볼 수 있는(Try-on) 모델로 확장 가능성 제시.

🎓 Graduate Student's Insight (Critical Thinking)

이 논문을 보면서 느낀 점과 연구자로서 가져갈 만한 인사이트를 정리한다.

-

Mesh Dependency의 귀환: 3DGS가 각광받은 이유는 "Mesh 없이도" 고퀄리티 렌더링이 가능했기 때문이다. 하지만 이 논문은 역설적으로 "정교한 제어를 위해서는 다시 Mesh가 필요하다"는 것을 보여준다. GaussianMesh를 사용하여 메쉬 표면에 Gaussian을 바인딩하는 전략은 Deformation이나 Collision 처리가 필요한 응용 분야(Physics-aware 3DGS)에서 필수가 될 것이다.

-

Data Acquisition의 현실성: 옷을 뒤집어서(Inside-out) 촬영하는 아이디어는 훌륭하지만, 물리적 한계가 있다. 두꺼운 코트나 가죽 재킷은 뒤집으면 주름의 형태가 완전히 달라진다(Deformation). 논문에서는 Non-Rigid ICP로 이를 보정한다고 했지만, 재질이 뻣뻣할수록 정합 오차가 커질 위험이 있다.

-

Rendering Overhead: 제안된 Mesh-Guided Culling은 픽셀마다 Ray-Mesh Intersection을 계산해야 한다. 논문에 따르면 RTX 4080 기준으로 약 10~20%의 렌더링 오버헤드가 발생한다. 실시간성이 중요한 VR/AR 환경에서는 이 비용을 줄이기 위한 가속화 연구(예: BVH 최적화)가 추가로 필요해 보인다.