CS231. Convolutional Neural Networks for Visual Recognition (Stanford Lecture)

1.CS231. Non-linear function (비선형

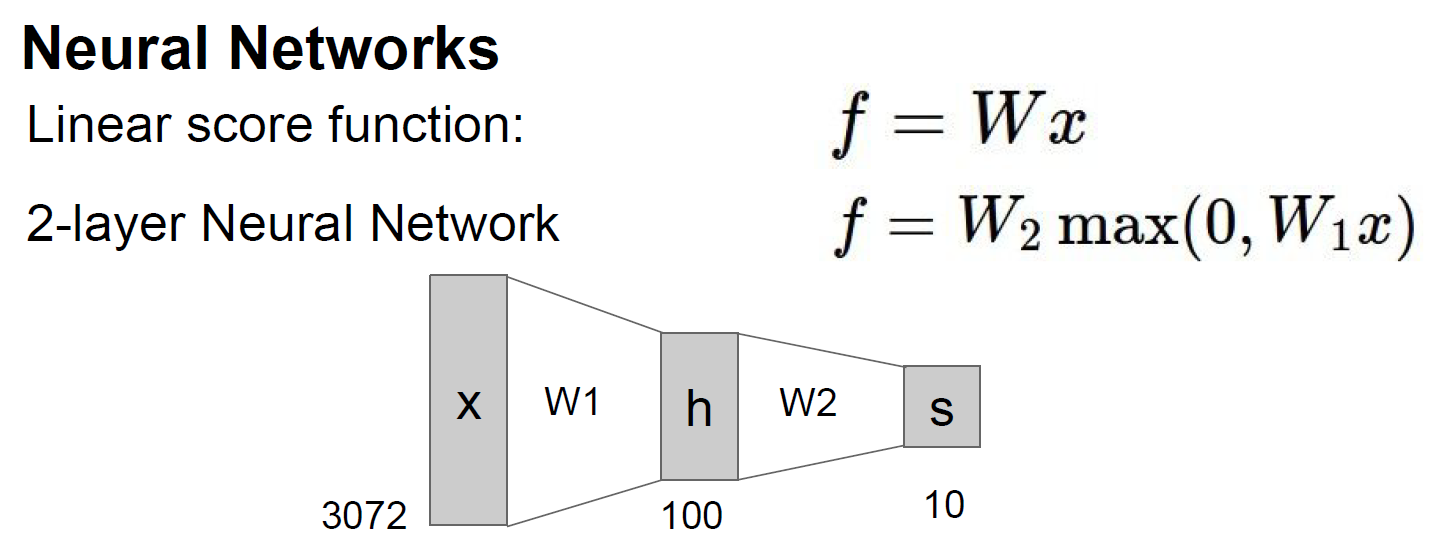

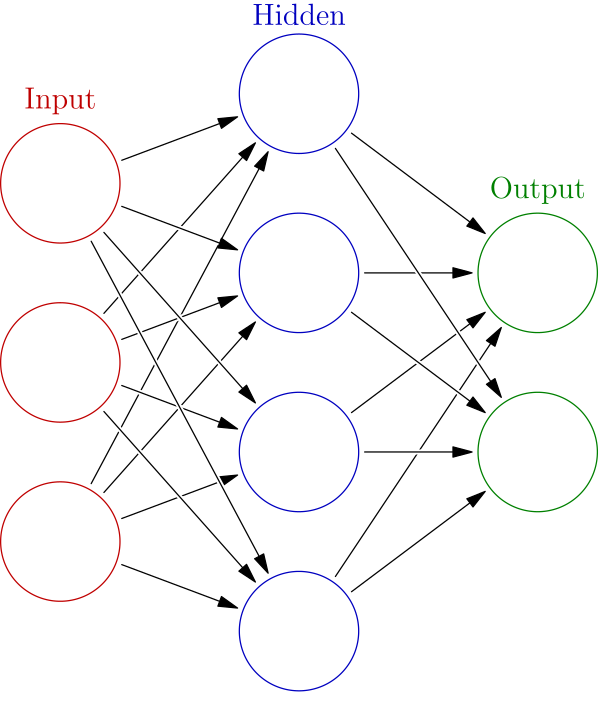

저번 글에서 언급했듯이 인공 신경망은 선형함수와 비선형 함수로 층을 쌓고 있다. 아래의 그림과 같이 입력 이미지가 선형함수(f1 = W1x)를 지나가고 비선형 함수 (f2 = max(0, f1))를 지난다. 마지막으로 선형(W2xf2)를 거쳐서 output 10개의 숫

2021년 8월 28일

2.CS231. Linear Regression, Linear Classifier

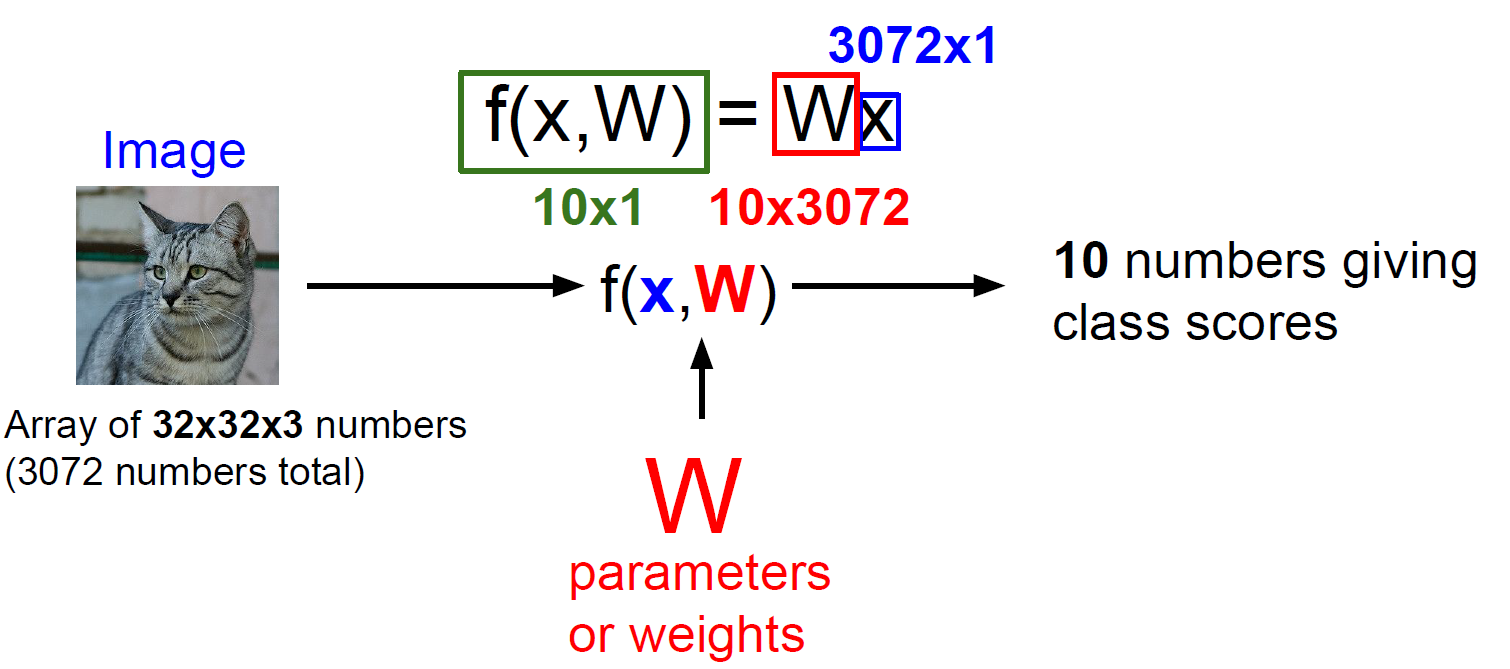

CNN에 관한 블로그에서 activation map의 계산이 어떻게 되는지 간단히 살펴봤다. filter의 parameter들과 이미지의 pixel값들의 dot product(내적)을 한 후 bias를 더해준 하나의 값이 activation map에 기록된다고 배웠다.

2021년 8월 28일

3.CS231. CNN (part 1)

지난 몇달 Stanford 강의 S231을 일주일에 한개씩 듣고 공부한 내용을 정리해 보려 한다. CS231강의의 이름은 Convolutional Neural Networks for Visual Recognition. Convolutional Neural Networ

2021년 8월 27일