On Transferability of Prompt Tuning for Natural Language Processing (NACCL, 2022) 찍먹 리뷰

paper-small-review

Abstract

Prompt tuning은 PLM을 활용하기 위한 매개변수의 효율적인 방법으로, soft prompt만 조정하여 hyperparameter 조정과 유사한 성능을 달성할 수 있음

하지만, PT는 parameter조정보다 더 많은 교육 시간이 필요함

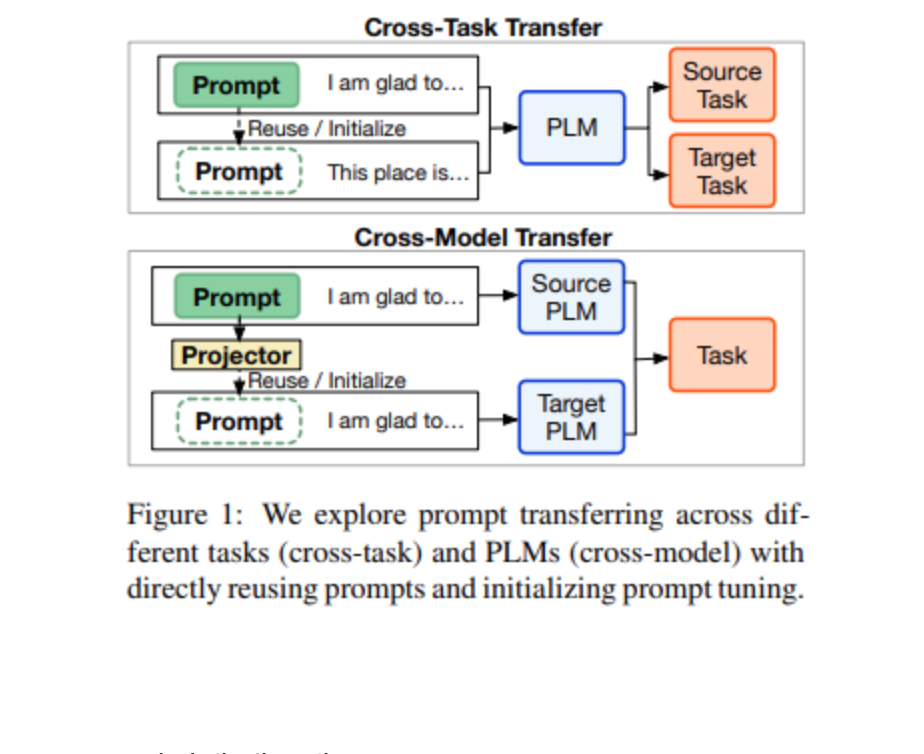

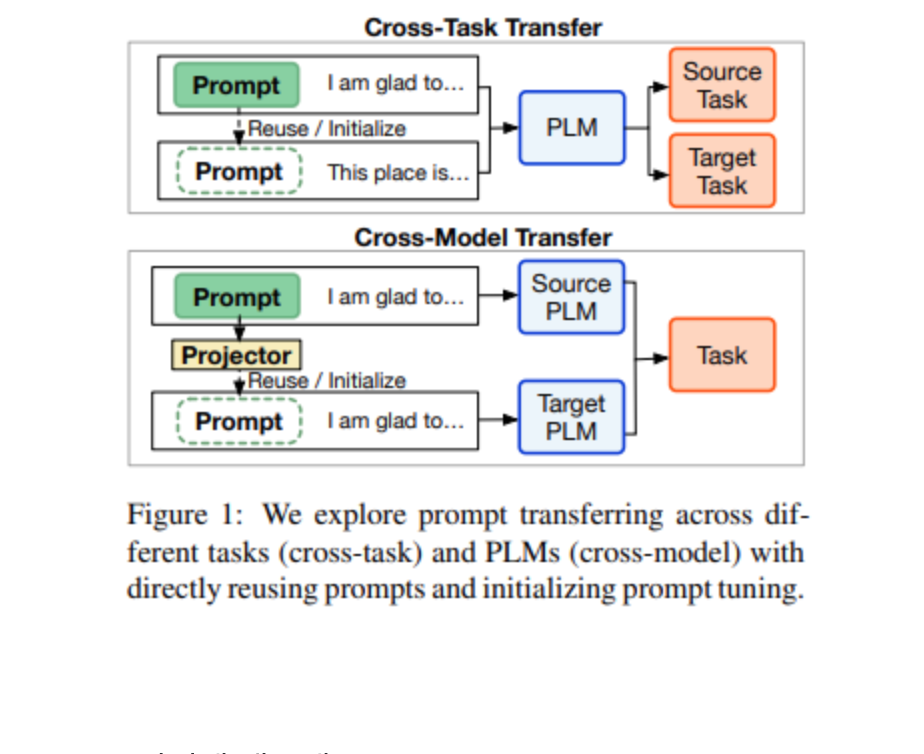

-> soft prompt transfer을 통해 Prompt Tuning을 개선할 수 있는지 여부를 탐구하기 위해 다양한 downstream task 및 PLM 간의 transfer 가능성을 경험적으로 조사함

(1) zero-shot에서, trained soft prompt는 같은 PLM의 유사한 작업뿐만 아니라 비슷한 작업에서 훈련 된 교차 모델 프로젝터를 사용하여 다른 PLM으로 효과적으로 전이 할 수 있다는 것을 발견함

(2) 초기화로 사용될 때, 유사한 작업의 훈련 된 소프트 프롬프트 및 다른 PLM의 프로젝트된 프롬프트는 교육을 크게 가속화하고 PT의 성능을 개선할 수 있음

-> 더 나아가, 프롬프트 transfer 가능성을 결정하는 요소를 탐구하기 위해 다양한 지표를 조사하였고, 활성화 된 뉴런의 중첩 비율이 transfer 가능성을 강하게 반영하는 것을 발견함

-> 이는 프롬프트가 PLM을 자극하는 방식이 중요하다는 것을 시사함

1 Introduction

Soft prompt 라고 하는 learnable virtual token을 input sequence 앞에 붙이는것

잘만 한다면, fine tuning 하는 것과 같은 성능을 낼 수 있음

-> 다만 convergence가 느림

-> knowledge transfer에 눈을 돌려볼까?

- 어차피 soft prompts만 학습됐으니까 tokens만 똑 떼다가 붙이면 knowledge transfer가 되지 않을까? == Prompt transfer

Contribution

- cross-task, cross-model의 soft prompts transferability 탐색

- soft prompts initialization 가능성 탐색: efficiency & effectiveness 확보

- metric을 만들어서 어떤 요소(결국에는 model stimulation)가 PLM의 soft prompts에 효과적인지