paper-small-review

1.How to Adapt Your Pretrained Multilingual Model to 1600 Languages 찍먹리뷰!

Abstract pretrained multilingual model은 transfer cross-lingual을 통해 zero-shot learning을 가능하게 하여 pretraining에 보이는 언어에 가장 적합한 성능을 발휘함 pretraining 시 보이지 않는 언어의 성능을 향상시키는 방법이 존재하지만, 세계 언어의 일부의 raw text를 ...

2023년 4월 12일

2.Training language models to follow instructions with human feedback 찍먹리뷰

Instruct GPT 찍먹리뷰

2023년 4월 10일

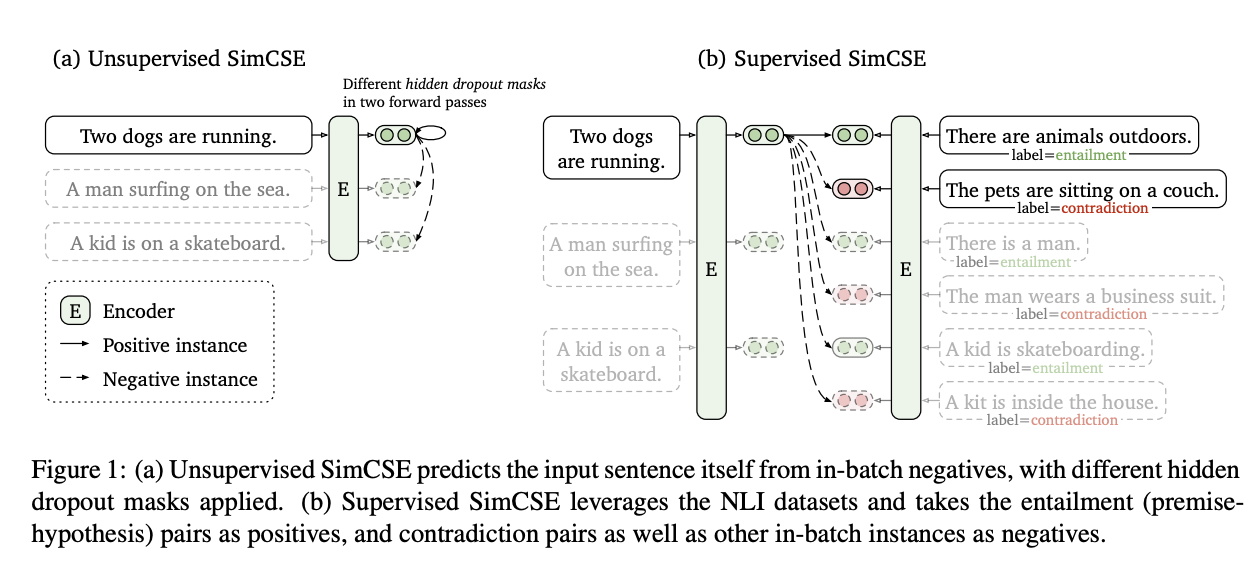

3.SimCSE: Simple Contrastive Learning of Sentence Embeddings

Abstract SOTA 문장 임베딩을 크게 발전시키는 간단한 contrastive learning framework인 SimCSE를 제시 먼저 입력 문장을 받고 standard dropout만 noise로 사용하여 contrastive objective로 스스로를 예측하는 unsupervised 접근법을 설명함 dropout이 최소한의 data aug...

2023년 3월 14일

4.When is BERT Multilingual? Isolating Crucial Ingredients for Cross-lingual Transfer (NACCL, 2022) 찍먹리뷰 !

다국어 언어 모델에 대한 최근 연구는, cross-lingual zero-shot transfer 능력을 입증했지만, 언어 간 공유속성이 downstream task에서 전송을 가능하게 하는 것이 무엇인지에 대한 입증이 부족함언어들은 많은 언어적 측면에서 다르기 때문에

2023년 4월 24일

5.Types of Out-of-Distribution Texts and How to Detect Them (ACL,2021) 찍먹 리뷰!

현재 OOD(out-of-distribution) 예제를 검출하는 것의 중요성에 대한 합의는 있지만, OOD 예제의 공식적인 정의와 가장 잘 검출하는 방법에 대해서는 합의가 없다. \-> background 변화와 semantic 변화에 따라 이러한 예제를 분류하고,

2023년 4월 26일

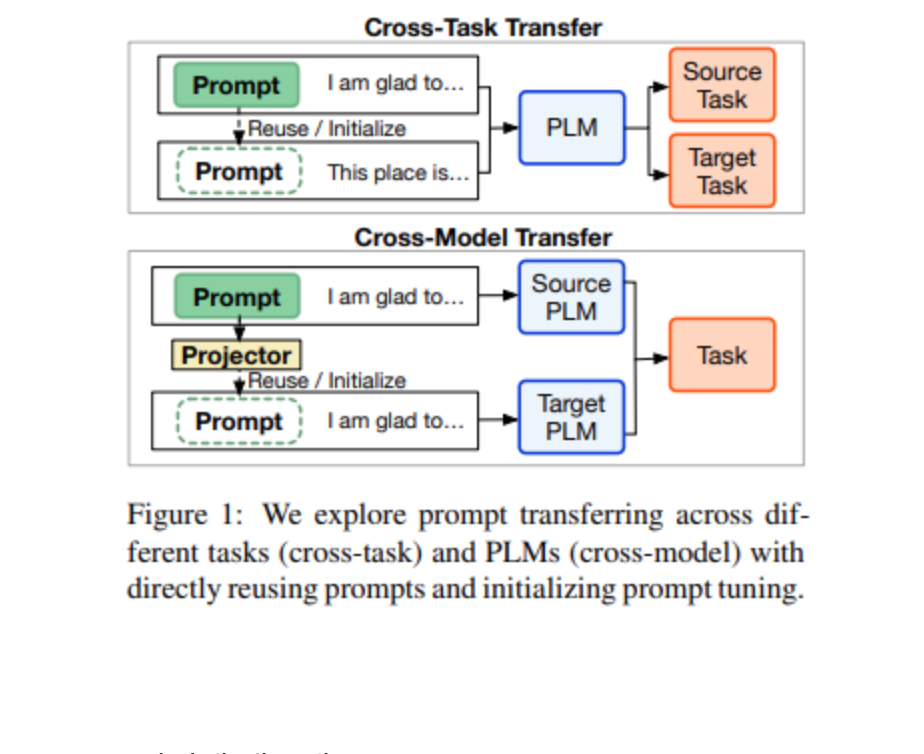

6.On Transferability of Prompt Tuning for Natural Language Processing (NACCL, 2022) 찍먹 리뷰

prompt transfer

2023년 5월 9일