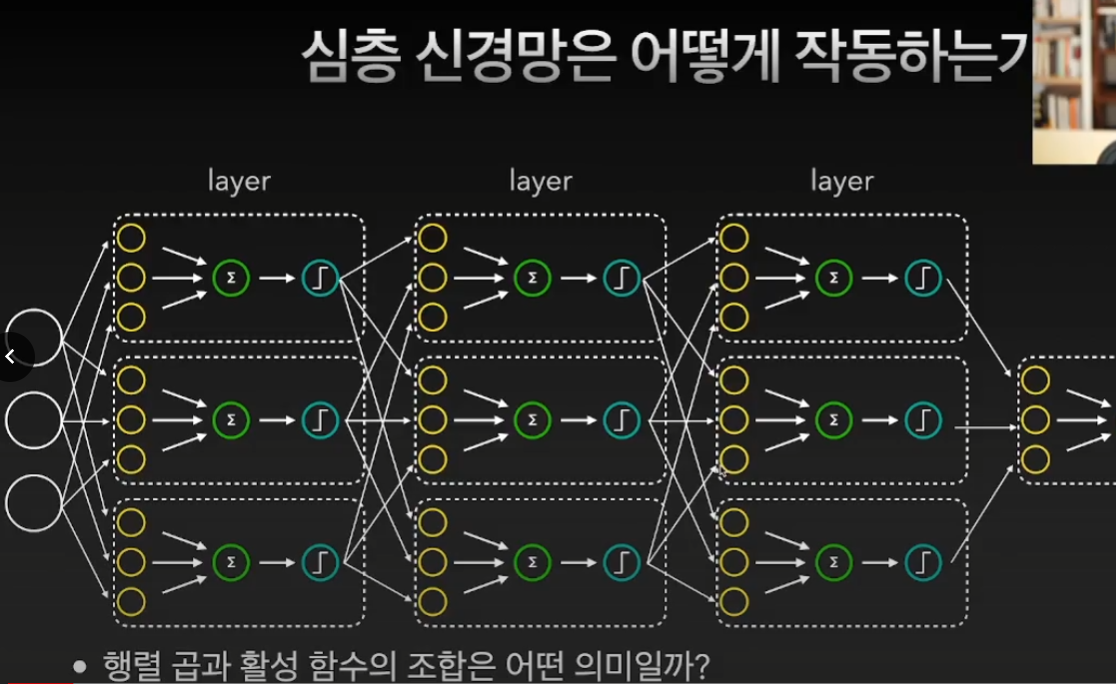

Deep learning

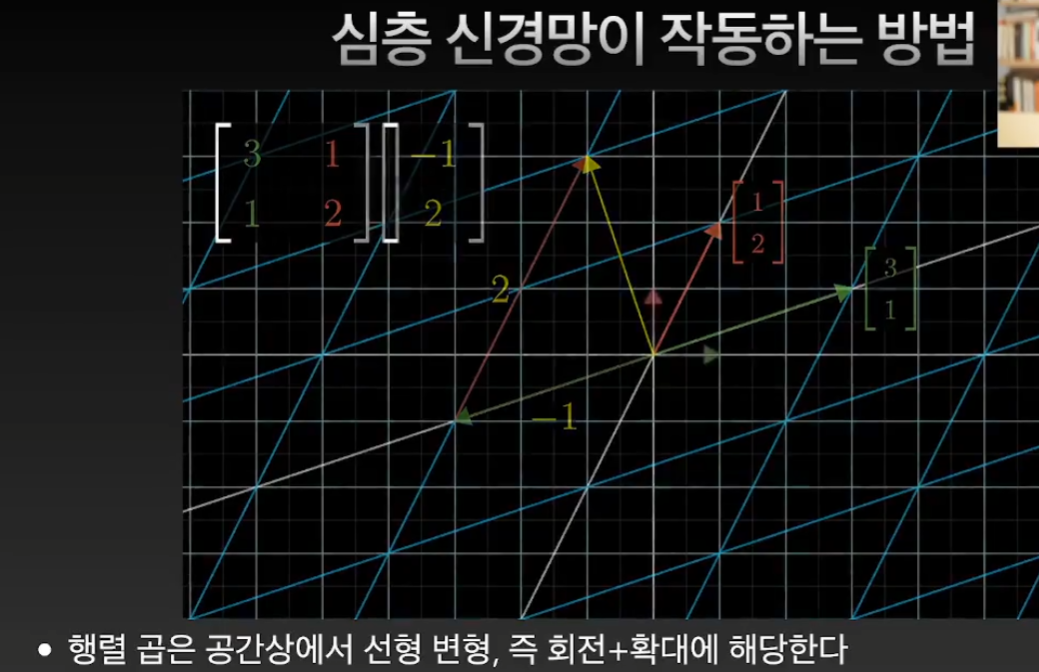

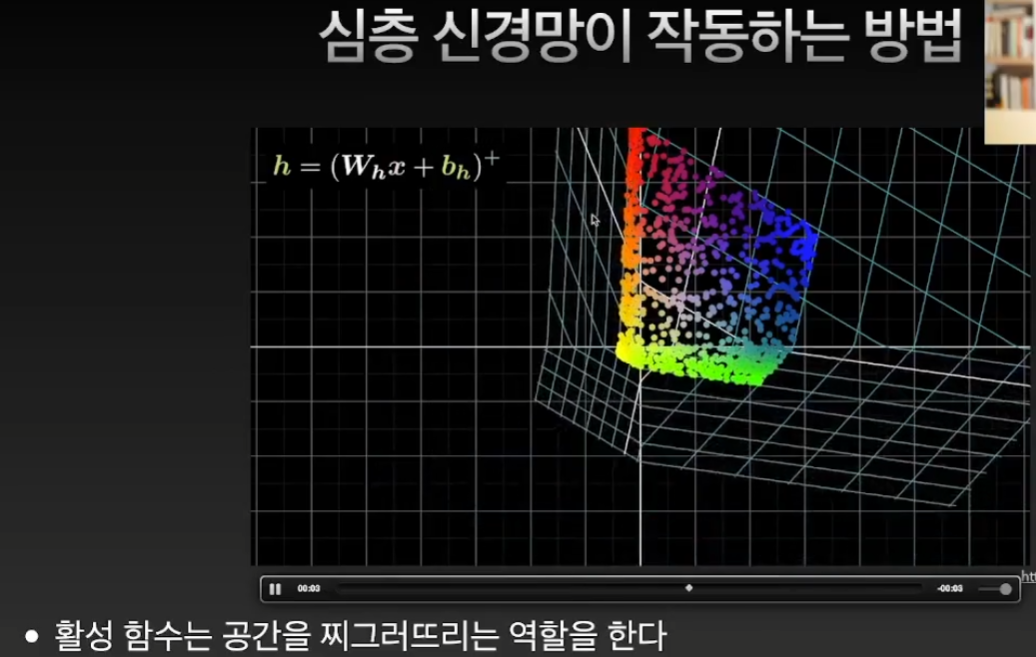

deep learning은 계산적으로 보면 인풋에 가중치를 곱한뒤 더한 값에 활성함수를 통과시키는 과정이다. 하지만 이 과정을 거치면 복잡한 수학적인 값을 좀더 이해하기 쉬운 값으로 변환하게 된다. Fracois Chollet는 이를 '딥러닝은 복잡한 공간을 펴는 것'이라고 했다.

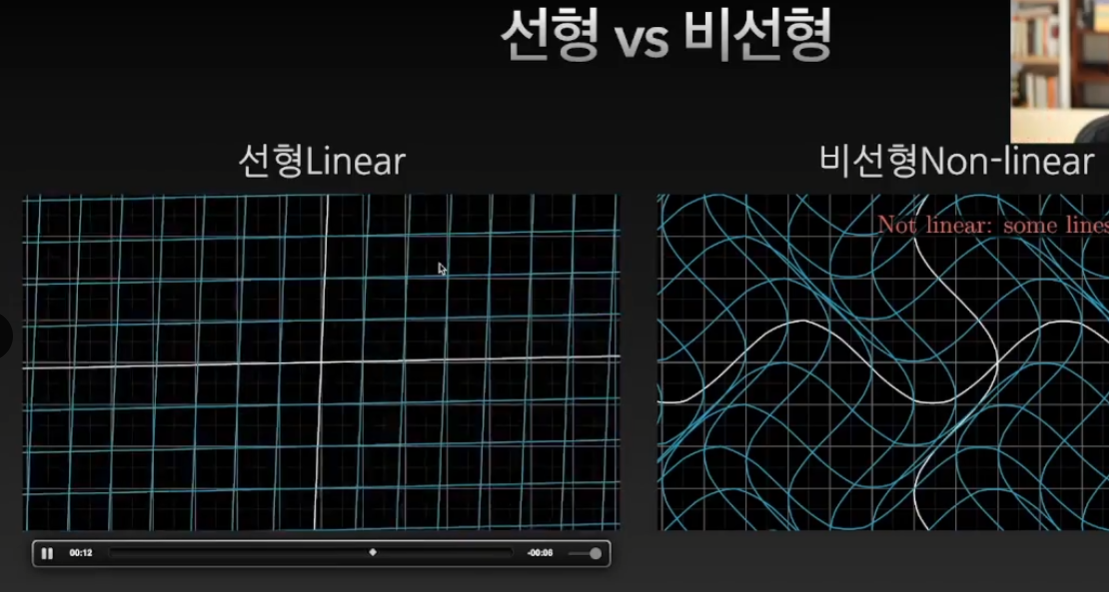

행렬곱은 선형 변환

활성함수는 비선형 변환

공간의 왜곡

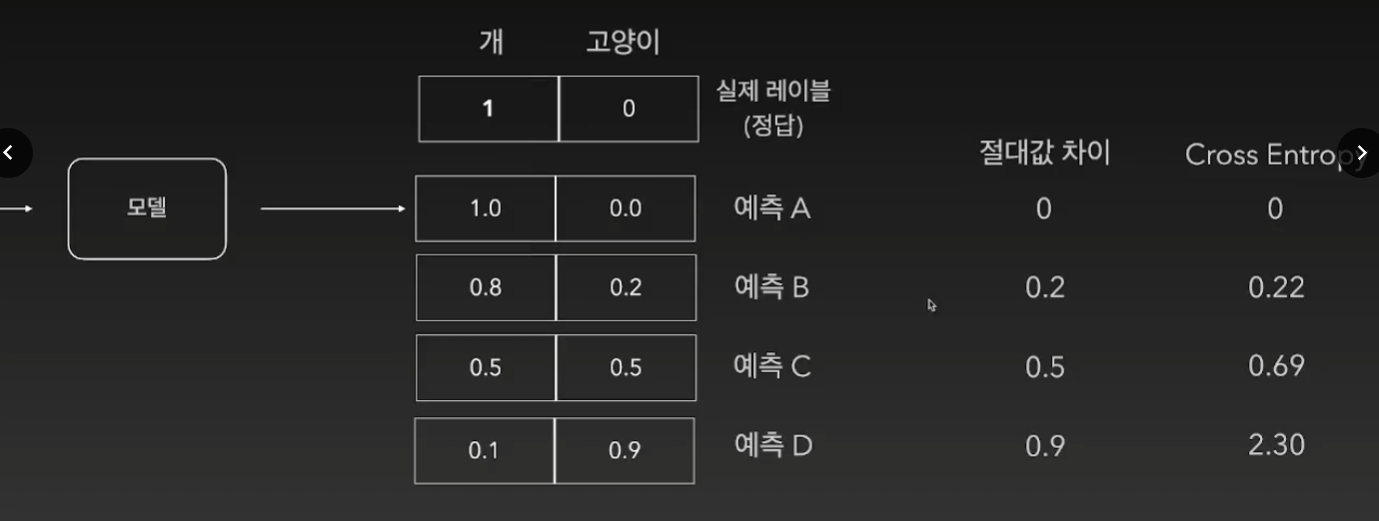

손실함수

학습에는 손실함수가 중요한 역할을 한다.

cross entropy는 log함수를 사용하기 때문에 예측값이 크게 틀릴수록 지수적으로 값이 커지게 된다.

경사하강법