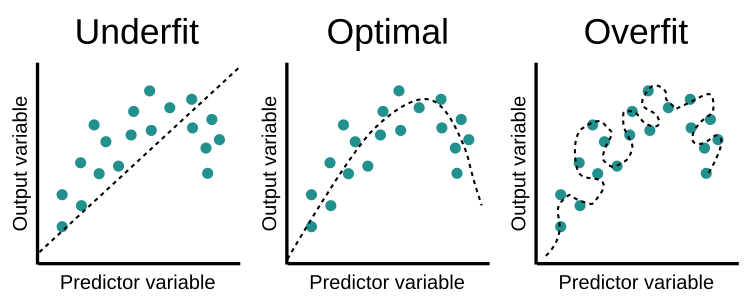

Overfitting은 학습 데이터(Training Set)에 대해 과하게 학습된 상황이다. 따라서 학습 데이터 이외의 데이터에 대해선 모델이 잘 동작하지 못하게 된다. 쉽게 말하면, Overfitting은 너무 세밀하게 학습 데이터 하나하나를 다 설명하려고 하다보니 정작 중요한 패턴을 설명할 수 없게 되는 현상을 말한다고 이해하면 된다.

해결책

Overfitting이 발생했을 때 사용할 수 있는 일반적인 해결책은 아래와 같다.

Model Capacity 낮추기: 모델이 학습 데이터에 비해 과하게 복잡하지 않도록, hidden layer 크기를 줄이거나 layer 개수를 줄이는 등 모델을 간단하게 만듭니다.

Dropout: 학습을 할 때 일부 뉴런을 끄고 학습합니다.

L1/L2 정규화(L1/L2 regularization)

학습 데이터 늘리기(data augmentation)

출처: https://22-22.tistory.com/35 [used to deeplearn]

https://yngie-c.github.io/machine%20learning/2020/04/30/training_test_reg/

https://22-22.tistory.com/35

https://wikidocs.net/61374

https://hleecaster.com/ml-overfitting/