문용혁, et al. "자동 기계학습(AutoML) 기술 동향" (2019)

AutoML이란

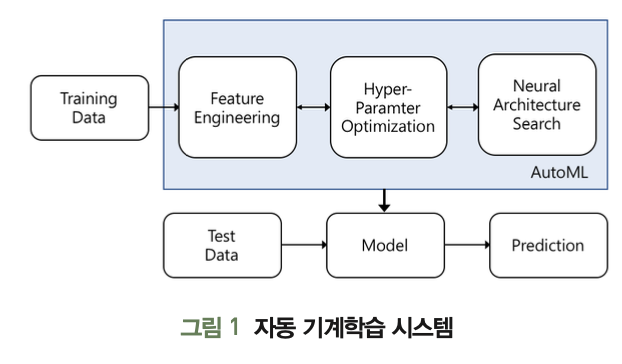

자동기계학습(Automated Machine Learning: AutoML)은

- 도메인 데이터 특징 추출 (Feature Engineering: AutoFE)

- 하이퍼 파라미터 최적화(Hyper-Parameter Optimization: HPO)

- 가장 우수한 성능을 도출할 수 있는 하이퍼 파라미터를 찾아내는 기술

- 신경망 아키텍처 탐색(Neural Architecture Search: NAS)

- 목표 데이터 및 태스크에 적합한 인공 신경망 구조 및 가중치를 자동 탐색

과 같은 파이프라인 자동화에 이용한다.

Neural Architecture Search: NAS

네트워크 구조(Architeture)를 학습을 통해 최적값으로 설계하는 방법

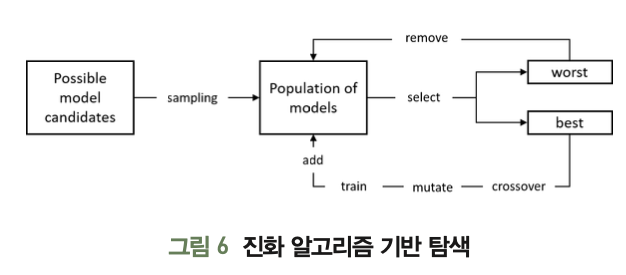

진화 알고리즘 기반 탐색

진화 알고리즘은 그림과 같이 임의 후보해 집합을 생성한 후 '선택-크로스오버-뮤테이션-평가'의 과정을 반복해 해당 집합을 업데이트함으로써 문제에 따라 정의된 적합성 지표 (Fitness)를 가장 잘 만족시키는 해를 탐색한다.

AmeobatNet

NAS-Net이 제안한 탐색 영역을 활용하여 후보해 집합 구성

- 탐색 효율화를 위해 특정 세대 이상 후보해 집합에 머물러 있는 해를 노후(Aging)의 관점에서 제거해 후보해 간의 불필요한 경쟁 확률을 감소

AmeobaNet. Real, Esteban, et al. "Regularized evolution for image classifier architecture search." arXiv preprint arXiv:1802.01548 (2018).

Hierarchical NAS

- 노드와 엣지로 구성된 계산 그래프를 계층화하여 반복적인 Motifs로 구성된 CNN 탐색 영역 생성

- 단순화된 뮤테이션을 통해 각 노드 간 엣지에 부여될 연산을 확률적으로 변경하므로 우수한 구조와 가중치의 신경망 획득이 가능

JASQNet

- 2019년 공개

- 신경망 아키텍처와 양자화 비트 수를 동시 탐색하여 최적 조합 결정 방법

- 추론 정확도 및 모델 경량화를 조율해 파레토 최적화(Pareto Optimality)

- AmeobatNet과 동일하게 NAS-Net의 셀 구조 이용

강화 학습 기반 탐색

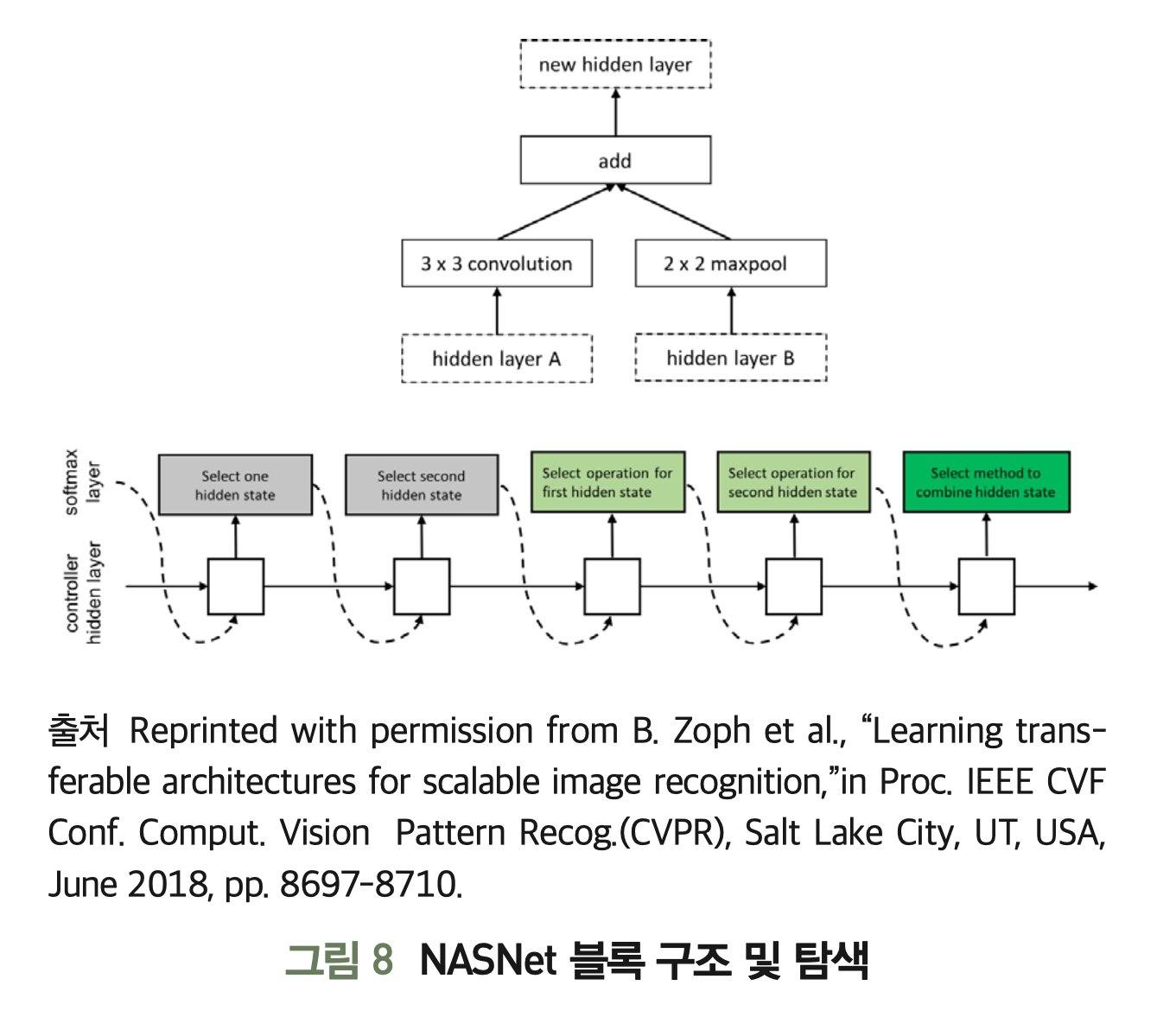

NASNet

- 2017년 구글 브레인이 제안

- NAS 기술의 탐색 복잡도를 축소하기 위해 신경망을 구성하는 단위 구조인 블록을 제시

- 블록에 제약조건을 두어 탐색 영역 한정

- 두 개의 입력으로 각 노드에서 연산을 진행하고, 처리 결과를 병합해 결괏값을 산출

- 선행연구 NAS보다 학습에 소요되는 시간 단축

Convolution Cell 단위를 사용

전체 구조 대신 cell을 탐색한 후, cell을 조합해 전체 구조를 설계한다.

경사 하강법 기반 탐색

진화 알고리즘 및 강화 학습 기반의 탐색 기법의 대안 연구

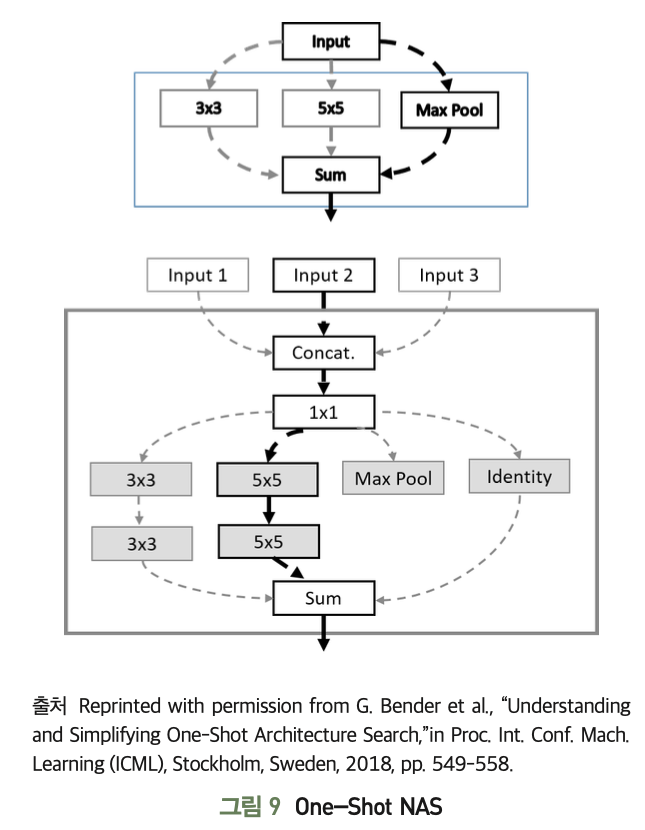

One-Shot NAS

- 가중치 공유 효과를 통해 탐색 복잡도를 낮추고자 단일 모델에서 적용 가능한 연산을 모두 고려해 훈련하는 모델