뀨?

[https://www.theguardian.com/media/2020/jun/10/fox-news-sesame-street-elmo-tucker-carlson]

- Elmo는 옛날 TV 캐릭터의 이름을 따서 지었다.

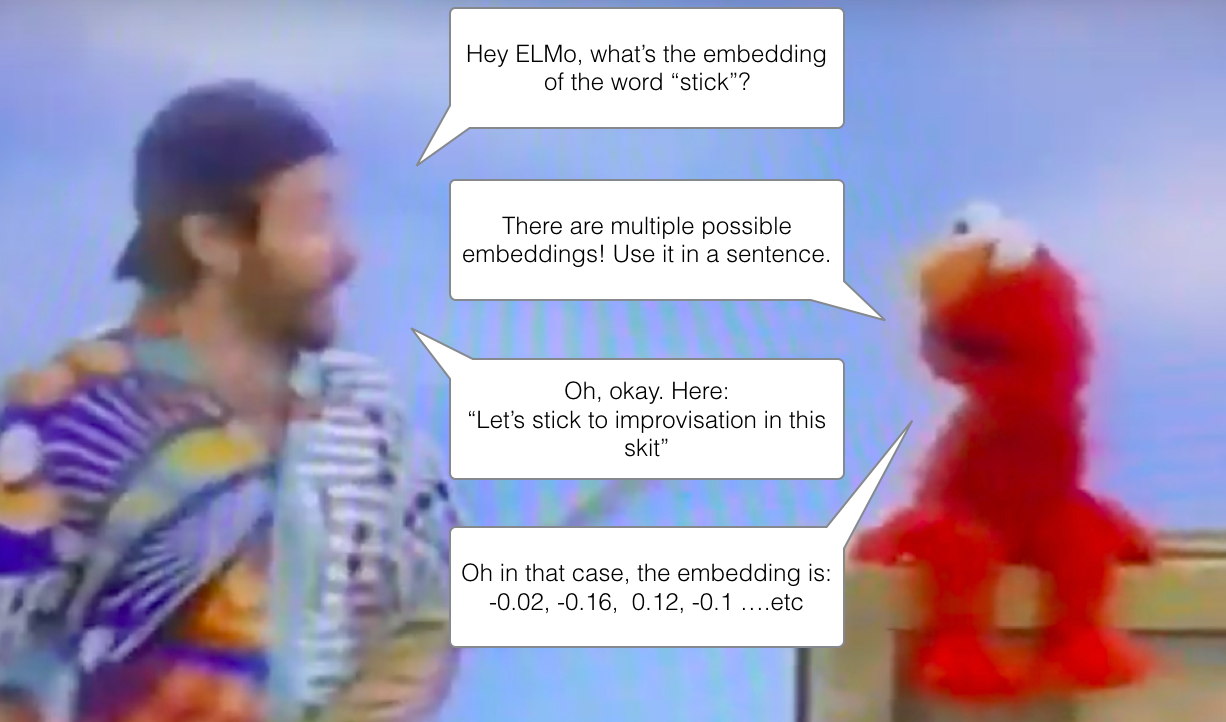

등장 배경

- 기존에는 단어 그 자체에 집중하여 word embedding 진행

-> 문장별로 단어의 의미가 다를 때 구분을 못함

ex) bank : 은행이든, 둑을 의미하든 bank라는 단어에 하나의 embedding vector가 대응됨

[http://jalammar.github.io]

ELMo(Embeddings from Language Models)

- 임베딩을 할 때 문장 전체의 context를 담아서 임베딩을 하려 시도

- 미리 학습된 (pretrain)LSTM 모델에 문장 전체를 넣어 각 단어의 임베딩 벡터를 구하는 방식.

- 전체 문장을 본 후에 문장을 구성하는 단어에 임베딩을 해줍