함수

함수는 무엇이며, 함수와 관련된 기울기, 일차방적정식, 2차방정식, 지수, 로그, 미분, 편미분의 개념에 대해서 간단하게 알아보려고 한다.

함수란?

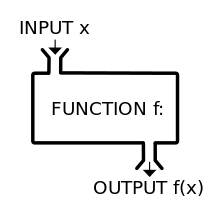

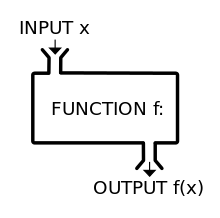

수학에서의 함수는 어떤 집합의 각 원소를 다른 어떤 집합의 유일한 원소에 대응시키는 이항 관계를 뜻하며,

인공지능에서 함수는 입출력이 있는 관계를 정의하는 수학적인 개념으로 사용됩니다.

예를 들자면, 인공신경망에서는 입력값이 네트워크를 통과하여 출력값을 예측하는 함수로 사용될 수 있다.

기울기?

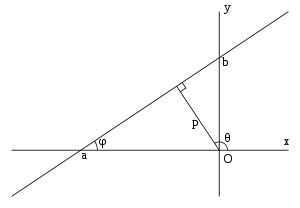

수학에서의 기울기는 직선이 기울어진 정도를 나타내는 수를 뜻한다.

인공지능에서 기울기는 함수의 경사를 나타내는 개념으로, 함수의 최적화와 관련이 있다.

예를 들자면, 인공신경망에서는 기울기를 이용하여 가중치와 편향을 업데이트하여 모델의 성능을 개선하는데 사용될 수 있다.

일차방정식

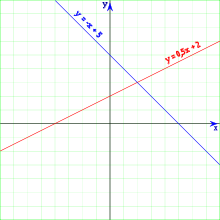

수학에서의 일차 방정식은 최고 차수의 항의 차수가 1을 넘지 않는 다항 방정식을 뜻한다.

인공지능에서 일차방정식은 하나의 변수에 대한 일차식이다.

예를 들어, 잠시 후 설명할 선형회귀에서 입력과 출력 사이의 일차방정식을 이용하여 데이터를 모델링 할 수 있다.

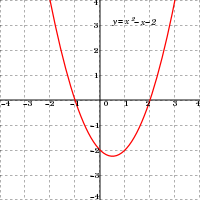

이차방정식

수학에서의 이차방정식은 최고차항의 차수가 2인 다항 방정식이다.

인공지능에서 2차방정식은 두 개의 변수에 대한 2차식이다.

예를 들어 다항회귀에서는 입력과 출력 사이의 2차방정식을 이용하여 데이터를 모델링 할 수 있다.

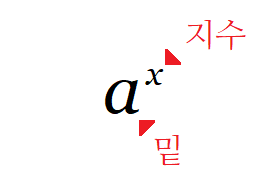

지수

수학에서의 지수는 같은 수를 여러 번 제곱하는 것을 표현하기 위해서 등장했다. 제곱하는 횟수를 "지수"라고 부른다.

인공지능에서 수학적인 개념과 같다.

예를 들어보자면, 로지스틱 회귀에서는 지수 함수를 이용하여 입력과 출력 사이의 확률을 모델링합니다.

로그

수학에서의 로그는 지수 함수의 역함수이다. 어떤 수를 나타내기 위해 고정된 밑을 몇 번 곱하여야 하는지를 나타낸다.

인공지능에서 로그는 로그 함수를 이용하여 데이터를 변환하는데 사용된다.

예를 들어, 데이터의 스케일을 조정하기 위해 로그 변환을 사용하거나, 손실 함수에서 로그 함수를 이용하여 모델의 성능을 평가하는데 사용된다.

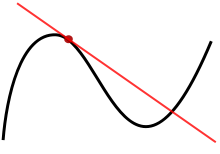

미분

수학에서의 미분은 어떤 함수의 정의역 속 각 점에서 함숫값의 변화량과 독립 변숫값의 변화량 비의 극한 혹은 극한들로 치역이 구성되는 새로운 함수다.

인공지능에서 미분은 함수의 변화율을 계산하는데 사용된다.

예를 들어, 함수의 최적화를 위해 기울기를 계산하기 위해 미분을 사용.

편미분

수학에서의 편미분은 다변수 함수의 특정 변수를 제외한 나머지 변수를 상수로 간주하여 미분하는 것이다.

인공지능에서 편미분은 다변수 함수에서 한 변수에 대한 미분을 의미한다.

예를 들어, 인공신경망에서는 비용 함수를 최적화하기 위해 가중치와 편향에 대한 편미분을 사용한다.

이렇게 간단하게 함수와 기울기, 일차방적정식, 2차방정식, 지수, 로그, 미분, 편미분의 개념에 대해서 간단하게 알아보았다.

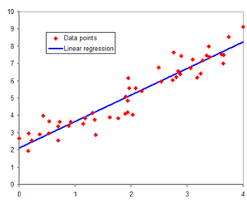

선형회귀란?

선형 회귀란 뭘까?

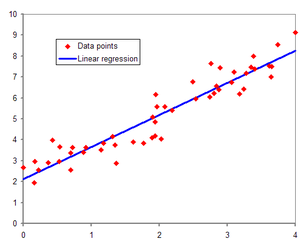

선형 회귀는 알려진 다른 관련 데이터 값을 사용하여 알 수 없는 데이터의 값을 예측하는 데이터 분석 기법이다.

통계학에서 선형 회귀는 종속 변수 y와 한 개 이상의 독립 변수 (또는 설명 변수) X와의 선형 상관 관계를 모델링하는 회귀분석 기법이다.

한 개의 설명 변수에 기반한 경우에는 단순 선형 회귀, 둘 이상의 설명 변수에 기반한 경우에는 다중 선형 회귀라고 한다

선형 회귀는 선형 예측 함수를 사용해 회귀식을 모델링하며, 알려지지 않은 파라미터는 데이터로부터 추정한다. 이렇게 만들어진 회귀식을 선형 모델이라고 한다.

선형 회귀는 깊이있게 연구되고 널리 사용된 첫 번째 회귀분석 기법이다. 이는 알려지지 않은 파라미터에 대해 선형 관계를 갖는 모델을 세우는 것이, 비선형 관계를 갖는 모델을 세우는 것보다 용이하기 때문이다.

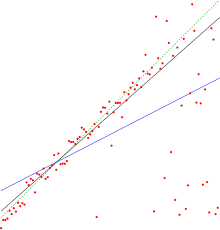

선형 회귀 모델 추정 기법

선형 회귀에서 파라미터 추정을 위해 다양한 기법들이 개발되었다. 각각의 기법들은 알고리즘의 연산 복잡도, 닫힌 형태의 해법 존재 여부, 데이터의 분포에 대한 가정, 변수의 관계에 대한 이론적 가정 등이 다르다. 아래에서는 일반적인 선형 회귀 추정 기법에 대해 설명하고자 한다.

가장 단순하고 많이 쓰이는 Ordinary least squares(OLS)가 있다.

개념적으로 단순하고, 계산이 간단하다.

OLS 추정은 일반적으로 실험이나 관측치에 적용하고자 할 때 사용되며, OLS 기법은 오차의 제곱의 합을 최소화하는 기법이다.

그 외에는

OLS를 확장한 개념인 Generalized least squares (GLS)가 있고, 오차의 퍼센트를 줄이는 Percentage least squares, Iteratively reweighted least squares (IRLS) 등이 있다.

선형회귀가 실생활에 끼치는 영향

선형회귀는 생각보다 다양한 분야에서 쓰인다.

특히 예측 분석, 데이터 분석, 기계 학습, 인공지능 분야에서 널리 사용되며, 예측 모델링, 분류, 이상 탐지, 회귀 등의 문제를 해결하는 데 주로 적용된다.

글을 마치며

수학을 열심히 공부하지 않았었기 때문에, 로그까지 밖에 제대로 몰랐는데 이번 기회에 미분과 편미분까지 알게 되어서 머리는 복잡했지만 뭔가 뿌듯했다.

그리고 선형회귀에 대해서 들어본적은 있으나 이렇게 정리해보니까 선형회귀가 생각보다 우리 삶에 많이 쓰일 수 있고 없으면 안되겠다는 생각이 들었다. 선형회귀가 엄청 어려운 개념도 아니니 익혀두면 좋을 것 같다.