외부의 영향을 처리하는 방법

1.제거 -> 잘 안씀

2. 상쇄, 완화 = Randomization (무작위화)

피쳐

-> 독립변수, 입력변수

피쳐의 유형

-속성에 따라

범주형

수치형

-인과관계에 따라

독립변수 : 다른 변수에 영향을 받지 않고 종속변수에 영향을 줌

종속변수 : 독립변수로부터 영향을 받음

-머신러닝에서

입력 : 변수(Feature), 속성(Attribute), 예측변수(Predictor), 차원(Dimension), 관측치(Observation), 독립변수(Independent Variable)

출력 : 라벨(Label), 클래스(Class), 목푯값(Target), 반응(Response), 종속변수(Dependent Variable)

※ 독립변수 종속변수 간

X -> Y : 인과 관계

X <-> Y : 상관 관계

인과관계가 되기위한 조건

1. X,Y가 상관 관계이어야 함

2. 시간적 선후관계가 있어야함

3. 비허위적(non-spurious) 관계 (= 중간에 낀 다른 변수가 있어서 영향을 주지 않는 관계, ex)연봉과 혈압의 관계 : 실질적으로 연관이 없지만 상관관계가 있는것으로 보임)

피쳐엔지니어링

피쳐 추출

-

피쳐들 사이에 내재한 특성이나 관계를 분석하여 이들을 잘 표현할 수 있는 새로운 선형 혹은 비선형 결합 변수를 만들어 데이터를 줄이는 방법

-

고차원의 원본 피쳐 공간을 저차원의 새로운 피쳐 공간으로 투영

-

PCA(주성분 분석), LDA(선형 판별 분석) 등

피쳐 선택

-

피쳐 중 타겟에 가장 관련성이 높은 피쳐만을 선정하여 피쳐 수를 줄임

-

관련없거나 중복되는 피쳐들을 필터링하고 간결한 subset을 생성

-

모델 단순화, 훈련 시간 축소, 차원의 저주 방지, 과적합(Over-fitting)을 줄여 일반화해주는 장점이 있음

-

ilter, Wrapper, Embedded 메서드

차원의 저주?

일상 경험의 3차원 물리적 공간과 같은 저차원 환경에서는 발생하지 않는 고차원 공간에서 데이터를 분석하고 정리할 때 발생하는 다양한 현상

피쳐 추출

-

변수들 사이에 내재한 특성이나 관계를 분석하여 이들을 잘 표현할 수 있는 새로운 선형 혹은 비선형 결합 변수를 만들어 데이터를 줄이는 방법

주성분 분석(Principal Component Analysis, PCA)

-

변수들의 공분산 행렬이나 상관행렬을 이용

-

원래 데이터 특징을 잘 설명해주는 성분을 추출하기 이하여 고차원 공간의 표본들을 선형 연관성이 없는 저차원 공간으로 변환하는 기법

-

행의 수와 열의 수가 같은 정방행렬에서만 사용

PCA 절차

- 학습 데이터셋에서 분산이 최대인 축(axis)을 찾음

- 첫번째 축과 직교(orthogonal)하면서 분산이 최대인 두 번째 축을 찾음

- 첫 번째 축과 두 번째 축에 직교하고 분산을 최대한 보존하는 세 번째 축을 찾음

- 1~3과 같은 방법으로 데이터셋의 차원(특성 수)만큼의 축을 찾음

선형판별분석(Linear Discriminant Analysis, LDA)

- 데이터의 Target값 클래스끼리 최대한 분리할 수 있는 축을 찾음

- 특정 공간상에서 클래스 분리를 최대화하는 축을 찾기 위해 클래스 간 분산(between-class scatter)과 클래스 내부 분산(within-class scatter)의 비율을 최대화하는 방식으로 차원을 축소

LDA 절차

- 특정 공간상에서 클래스 분리를 최대화하는 축을 찾기 위해 클래스 간 분산(between-class scatter)과 클래스 내부 분산(within-class scatter)의 비율을 최대화하는 방식으로 차원을 축소

- SVM 같은 다른 분류 알고리즘을 적용하기 전에 차원을 축소시키는 데 사용

특이값 분해(Singular Value Decomposition)

- M X N 차원의 행렬데이터에서 특이값을 추출하고 이를 통해 주어진 데이터 세트를 효과적으로 축약할 수 있는 기법

요인분석(Factor Analysis)

- 데이터 안에 관찰할 수 있는 잠재적인 변수(Latent Variable)가 존재한다고 가정

- 모형을 세운 뒤 관찰 가능한 데이터를 이용하여 해당 잠재 요인을 도출하고 데이터 안의 구조를 해석하는 기법

- 주로 사회과학이나 설문 조사 등에서 많이 활용

독립성분분석(Independent Component Analysis)

- 주성분 분석과는 달리 다변량의 신호를 통계적으로 독립적인 하부성분으로 분리하여 차원을 축소하는 기법

- 독립 성분의 분포는 비정규 분포를 따르게 되는 차원축소 기법

다차원 척도법(Multi-Dimensional Scaling)

- 개체들 사이의 유사성, 비유사성을 측정하여 2차원 또는 3차원 공간상에 점으로 표현하여 개체들 사이의 집단화를 시각적으로 표현하는 분석 방법

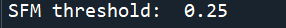

Scikit-Learn으로 PCA와 LDA 수행

from sklearn import datasets

from sklearn.decomposition import PCA

from sklearn.discriminant_analysis import LinearDiscriminantAnalysis

iris = datasets.load_iris()

X = iris.data

y = iris.target

target_names = list(iris.target_names)

print(f'{X.shape = }, {y.shape = }')

print(f'{target_names = }')

# PCA의 객체를 생성, 차원은 2차원으로 설정(현재는 4차원)

pca = PCA(n_components=2)

# PCA를 수행. PCA는 비지도 학습이므로 y값을 넣지 않음

pca_fitted = pca.fit(X)

print(f'{pca_fitted.components_ = }') # 주성분 벡터

print(f'{pca_fitted.explained_variance_ratio_ = }') # 주성분 벡터의 설명할 수 있는 분산 비율

X_pca = pca_fitted.transform(X) # 주성분 벡터로 데이터를 변환

print(f'{X_pca.shape = }') # 4차원 데이터가 2차원 데이터로 변환됨

# LDA의 객체를 생성. 차원은 2차원으로 설정(현재는 4차원)

lda = LinearDiscriminantAnalysis(n_components=2)

lda_fitted = lda.fit(X, y)

print(f'{lda_fitted.coef_=}') # LDA의 계수

print(f'{lda_fitted.explained_variance_ratio_=}') # LDA의 분산에 대한 설명력

X_lda = lda_fitted.transform(X)

print(f'{X_lda.shape = }') # 4차원 데이터가 2차원 데이터로 변환됨

피쳐 선택 기법

필터기법

모든 피쳐 배정 -> 최적의 subset 선택 -> 학습 알고리즘 -> 성능평가

필터기법 종류

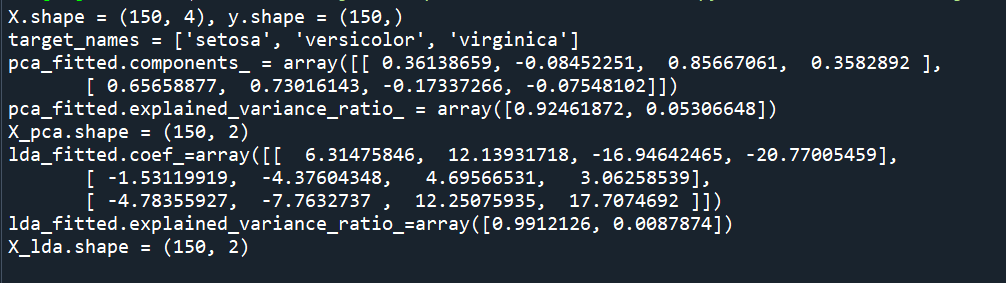

분산 기반 선택(Variance-based Selection)

- 분산이 낮은 변수를 제거하는 방법

from sklearn import datasets

from sklearn.feature_selection import VarianceThreshold

# iris 데이터셋을 로드

iris = datasets.load_iris()

X = iris.data # iris 데이터셋의 피쳐들

y = iris.target # iris 데이터셋의 타겟

X_names = iris.feature_names # iris 데이터셋의 피쳐 이름

y_names = iris.target_names # iris 데이터셋의 타겟 이름

# 분산이 0.2 이상인 피쳐들만 선택하도록 학습

sel = VarianceThreshold(threshold=0.2).fit(X)

print(f'{sel.variances_ = }') # 각 피쳐의 분산 확인

# 분산이 0.2 이상인 피쳐들만 선택 적용

X_selected = sel.transform(X) # 분산이 0.2 이상인 피쳐들만 선택

X_selected_names = [X_names[i] for i in sel.get_support(indices=True)] # 선택된 피쳐들의 이름

print(f'{X_selected_names = }')

print(f'{X_selected[:5] = }')

정보 소득(Information Gain)

- 가장 정보 소득이 높은 속성을 선택하여 데이터를 더 잘 구분하게 되는 것

카이제곱 검정(Chi-Square Test)

- 카이제곱 분포에 기초한 통계적 방법으로 관찰된 빈도가 기대되는 빈도와 의미있게 다른지 여부를 검증하기 위해 사용되는 검증 방법

피셔 스코어(Fisher Score)

- 최대 가능성 방정식을 풀기 위해 통계에 사용되는 뉴턴(Newton)의 방법

상관계수(Correlation Coefficient)

- 두 변수 사이의 통계적 관계를 표현하기 위해 특정한 상관관계의 정도를 수치적으로 나타낸 계수

scikit-learn에서 제공하는 피쳐 선택기법

from sklearn.feature_selection import SelectKBest

from sklearn.feature_selection import f_classif, f_regression, chi2

# k개의 베스트 피쳐를 선택

sel_fc = SelectKBest(f_classif, k=2).fit(X, y)

print('f_classif: ')

print(f'{sel_fc.scores_ = }')

print(f'{sel_fc.pvalues_ = }')

print(f'{sel_fc.get_support() = }')

print('Selected features: ', [X_names[i] for i in sel_fc.get_support(indices=True)]) # 선택된 피쳐들의 이름

sel_fr = SelectKBest(f_regression, k=2).fit(X, y)

print('\nf_regression: ')

print(f'{sel_fr.scores_ = }')

print(f'{sel_fr.pvalues_ = }')

print(f'{sel_fr.get_support() = }')

print('Selected features: ', [X_names[i] for i in sel_fr.get_support(indices=True)]) # 선택된 피쳐들의 이름

sel_chi2 = SelectKBest(chi2, k=2).fit(X, y)

print('\nchi2: ')

print(f'{sel_chi2.scores_ = }')

print(f'{sel_chi2.pvalues_ = }')

print(f'{sel_chi2.get_support() = }')

print('Selected features: ', [X_names[i] for i in sel_chi2.get_support(indices=True)]) # 선택된 피쳐들의 이름

래퍼기법

모든 피쳐 배정 -> 최적의 subset 선택(subset 생성 -> 학습 알고리즘 -> 성능평가)

변수선택위한 알고리즘

전진 선택법(Forward Selection)

- 모형을 가장 많이 향상시키는 변수를 하나씩 점진적으로 추가하는 방법

후진 제거법(Backward Elimination) - 모두 포함된 상태에서 시작하여 가장 적은 영향을 주는 변수부터 하나씩 제거

단계적 방법(Stepwise Method) - 전진선택과 후향제거의 결합

-각 단계에서 최상의 속성을 선택하고 나머지 속성 중 최악의 속성을 제거하는 과정을 실행

의사결정트리

래퍼기법의 종류

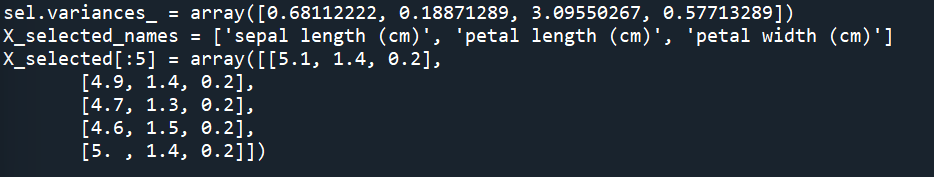

RFE(Recursive Feature Elimination)

- SVM(Support Vector Machine)을 사용하여 재귀적으로 제거하는 방법

- 전진 선택, 후진 제거, 단계적 방법 사용

SFS(Sequential Feature Selection) - 그리디 알고리즘(Greedy Algorithm)으로 빈 부분 집합에서 특성 변수를 하나씩 추가하는 방법

- 전진 선택, 후진 제거 사용

# RFE(Recursive Feature Elimination) 적용

from sklearn.datasets import load_iris

from sklearn.feature_selection import RFE, RFECV, SelectFromModel, SequentialFeatureSelector

from sklearn.svm import SVC, SVR

# iris 데이터셋 로드

X, y = load_iris(return_X_y=True)

# 분류기 SVC 객체 생성, 선형분류, 3개의 클래스

svc = SVR(kernel="linear", C=3)

# RFE 객체 생성, 2개의 피쳐 선택, 1개씩 제거

rfe = RFE(estimator=svc, n_features_to_select=2, step=1)

# RFE+CV(Cross Validation), 5개의 폴드, 1개씩 제거

rfe_cv = RFECV(estimator=svc, step=1, cv=5)

# 데이터셋에 RFE 적용

rfe.fit(X, y)

print('RFE Rank: ', rfe.ranking_)

# rank가 1인 피쳐들만 선택

X_selected = rfe.transform(X)

X_selected_names = [X_names[i] for i in rfe.get_support(indices=True)] # 선택된 피쳐들의 이름

print(f'{X_selected_names = }')

print(f'{X_selected[:5] = }')

# 데이터셋에 RFECV 적용

rfe_cv.fit(X, y)

print('RFECV Rank: ', rfe_cv.ranking_)

# rank가 1인 피쳐들만 선택

X_selected = rfe_cv.transform(X)

X_selected_names = [X_names[i] for i in rfe_cv.get_support(indices=True)] # 선택된 피쳐들의 이름

print(f'{X_selected_names = }')

print(f'{X_selected[:5] = }')임베디드 기법

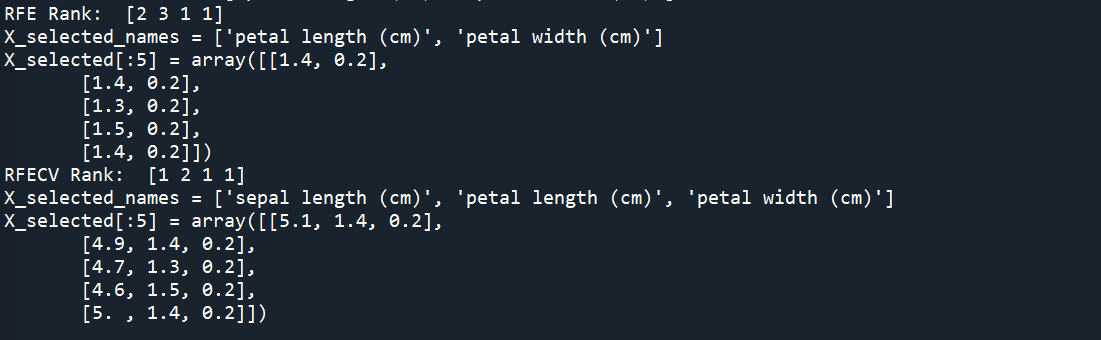

SelectFromModel

-의사결정나무 기반 알고리즘에서 변수를 선택하는 기법

from sklearn.feature_selection import SelectFromModel

from sklearn import tree

from sklearn.datasets import load_iris

# 데이터를 로드하고, 분류기를 초기화한 후 SFS를 적용

X, y = load_iris(return_X_y=True)

clf = tree.DecisionTreeClassifier()

sfm = SelectFromModel(estimator=clf)

# 모형 구조 확인 및 출력을 pandas로 설정

sfm.set_output(transform='pandas')

# 모형 학습

sfm.fit(X, y)

print('SFM threshold: ', sfm.threshold_)

# 선택된 피쳐들만 선택

X_selected = sfm.transform(X)

X_selected.columns = [X_names[i] for i in sfm.get_support(indices=True)] # 선택된 피쳐들의 이름

X_selected.head()