파인튜닝을 위해서 Llama-3.1-8B 모델을 로드하려고 한다.

Hugging-face에서 로드

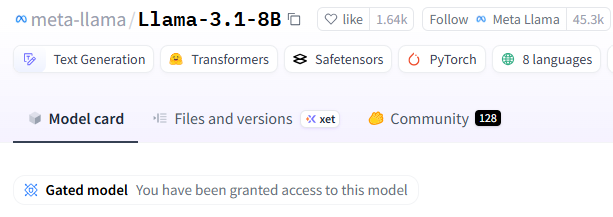

hugging face에 meta-llama의 모델을 보면

- meta-llama/Meta-Llama-3-8B : 베이스 모델

- meta-llama/Llama-3.1-8B : 위 모델과 차이 모르겠음

- meta-llama/Llama-3.1-8B-Instruct : instruction 방식 사전 파인튜닝 된 모델

베이스 모델을 사용하기 위해서 2번 모델을 사용하기로 했다.

hugging face 해당 모델에서 모델 접근 승인

https://huggingface.co/meta-llama/Llama-3.1-8B

코드에서 허깅페이스 토큰으로 접속 후 모델 로드

login(token='...')

model_id = "meta-llama/Llama-3.1-8B"

tokenizer = AutoTokenizer.from_pretrained(model_id)

model = AutoModelForCausalLM.from_pretrained(

model_id,

quantization_config=bnb_config,

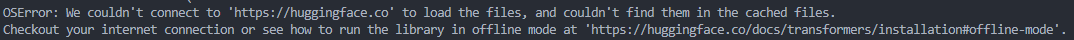

)하지만 이때 huggingface 서버에 접속하지 못한다는 에러 발생

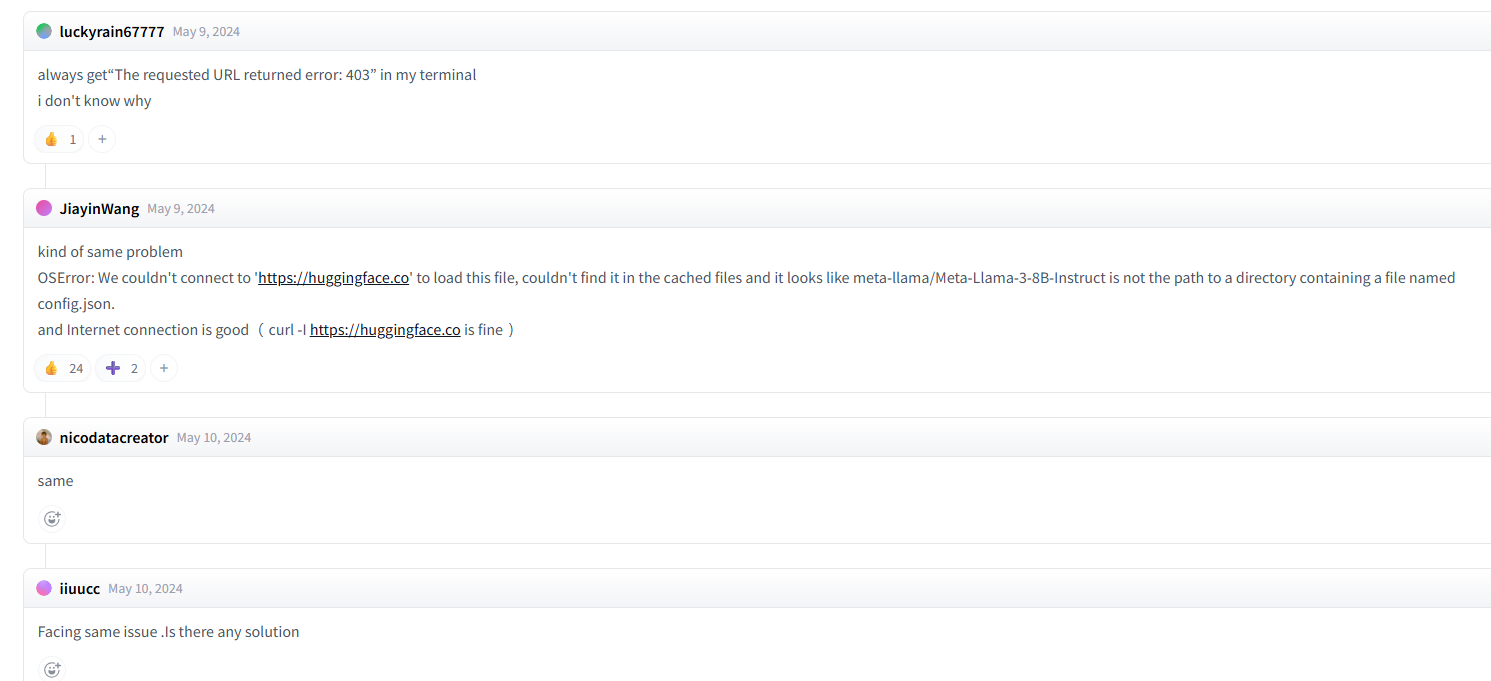

1번모델을 해도 마찬가지 이고, 아래 사이트 처럼 meta-llama의 모델을 허깅페이스에서 다운받아서 사용 할때 이런 현상이 나오는 사람이 많은 것을 확인하였다.

https://huggingface.co/meta-llama/Meta-Llama-3-8B-Instruct/discussions/97

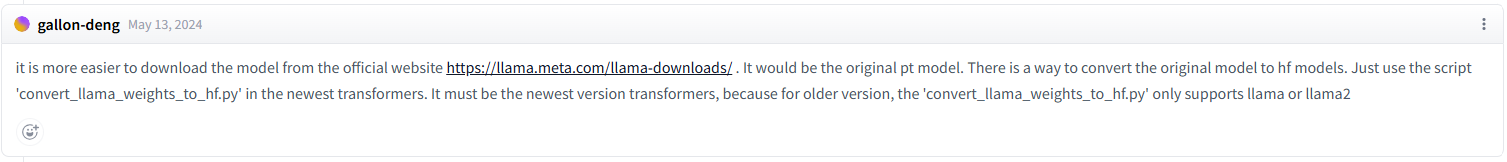

그 중 공식 사이트에서 모델을 다운받고 사용하는 것이 더 쉽다는 글이 있었다.

공식 사이트 https://www.llama.com/llama-downloads/

사이트에서 엑세스 요청을 받고 모델을 선택한 후 URL을 받았다.

# 터미널에서

pip install llama-stack

llama model download --source meta --model-id Llama3.1-8B

<받은 url 복붙>이렇게 모델을 다운 받으면

/root/.llama/checkpoints/Llama3.1-8B/checklist.chk경로에 설치되었다고 한다

tokenizer = AutoTokenizer.from_pretrained("/root/.llama/checkpoints/Llama3.1-8B/checklist.chk")이렇게 사용하면 끝