합성곱 계층

CNN의 계층은 Conv-ReLU-(pooling) 흐름으로 연결된다.

Affine 계층의 문제점

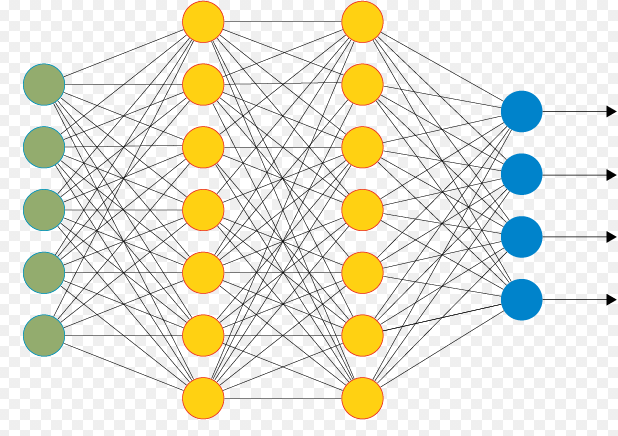

완전 연결 계층의 문제점은 데이터의 형상이 무시된다는 점이다. 예를 들어서 이미지는 3차원 데이터 가로x세로x색상(채널)의 값을 가지고 있는데 affine 계층에서 사용될 때의 데이터를 1차원으로 unravel된 상태로 사용했었다. 예를 들어서 MNIST 데이터 셋에서 1x28x28인 이미지를 1차원으로 핀 784x1 데이터로 변형하여 affine 계층에서 사용했던 것이다.

이미지는 3차원인데 만약에 가까운 픽셀이나 rgb값에 따라서 연관을 가지는 이미지 데이털르 1차원으로 바꿔서 학습을 하게된면 3차원속에서 의미를 갖는 패턴의 본질을 깰 수 있다. 따라서 완전연결 계층은 형상을 무시하고 모든 입력 데이터를 동등한 뉴런으로 취급하여 형상에 담긴 정보를 살릴 수 없다.

cnn의 합성곱 계층은 항상 형상을 유지한다. 이미지도 3차원 데이터로 입력 받으며, 마찬 가지로 다음 계층에도 3차원 데이터로 전달한다.

cnn에서는 합성 곱 계층의 입출력 데이터를 feature map이라고 한다.

완전 연결 신경망에서의 가중치와 편향이 CNN에서는 필터의 매개변수가 그 동안의 가중치에 해당한다.

패딩(padding)

합성곱의 연산을 수행하기 전에 입력 데이터 주변을 특정값(0)으로 채우기도 한다. 이를 패딩이라한다. 패딩은 주로 출력 크기를 조정할 목적으로 사용한다. 예를 들어 (4, 4) 입력 데이터에 (3, 3) 필터를 적용하면 출력은 (2, 2)가 되어, 입력보다 2만큼 줄어든다.