Model Compression

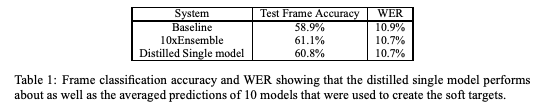

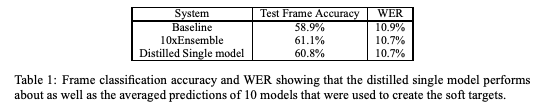

1.[KD] Distilling the Knowledge in a Neural Network 리뷰

Distilling the Knowledge in a Neural Network 리뷰

2025년 2월 12일

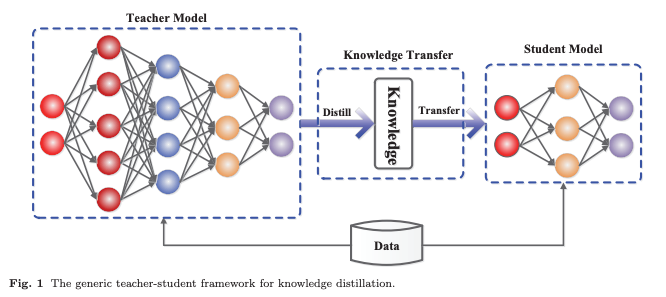

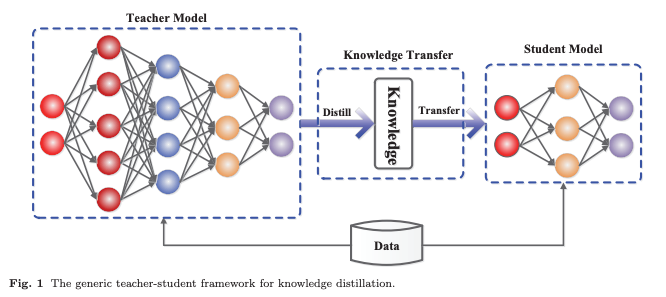

2.[KD] Knowledge Distillation: A Survey 정리 & 번역

Knowledge Distillation: A Survey 정리 & 번역

2025년 2월 3일

Distilling the Knowledge in a Neural Network 리뷰

Knowledge Distillation: A Survey 정리 & 번역