2025년 4월, 라스베이거스에서 열린 Google Cloud Next 2025는 단순한 기술 컨퍼런스를 넘어, AI 중심의 클라우드 혁신이 실질적으로 비즈니스에 어떤 영향을 주고 있는지를 보여주는 자리였습니다. 이번 키노트는 “Why not?”이라는 도전적인 질문으로 시작하며, 기술이 단순한 도구를 넘어서 인류의 상상력을 실현하는 수단이 되는 미래를 제시했습니다.

본 글에서는 발표의 전체 흐름에 따라 주요 발표 내용을 시간 순서대로 정리하고, 각각의 발표가 Google Cloud의 전략에서 어떤 위치를 차지하는지를 설명합니다.

영상 링크:

참고 링크:

📽️ 00:14 - Countdown powered by Veo 2

요약:

Google Cloud Next 2025 키노트는 Veo 2 기반으로 제작된 카운트다운 영상으로 시작했습니다. 이는 단순한 시간 알림의 기능을 넘어, Google의 최신 생성형 비디오 AI 기술의 성능을 실시간으로 체험하는 경험으로 연출되었습니다.

Veo 2 특징 요약:

- 텍스트 프롬프트 기반 영상 생성 (Text-to-Video)

- 4K 해상도, 수 분 단위 영상 생성 가능

- 카메라 프리셋 (드론 샷, 패닝, 줌 등) 사용 가능

- Inpainting/Outpainting 기능 내장 (오브젝트 추가/삭제)

- 영상의 첫 장면/마지막 장면 고정 기능 지원

기술적 메시지:

“Veo는 단순한 딥러닝 기반 동영상 생성기가 아니라, 크리에이티브 전문가와 브랜드 마케터의 파트너가 될 수 있다.”

의미:

이 Countdown은 AI를 활용한 콘텐츠 제작이 엔터프라이즈 도구로 진입했음을 시각적으로 선언한 것입니다. 또한 이 기술이 Sphere 프로젝트, Creative Agent, Veo 2 시연 등으로 이어지는 전체 흐름의 시각적 단서를 제공했습니다.

🎬 01:00 - Opening Film: "Why Not?"

요약:

이번 Google Cloud Next 2025 키노트의 도입부는 “Why not?”이라는 짧지만 강력한 메시지로 시작되는 영화 스타일의 오프닝 영상이었습니다. 기술을 향한 인간의 꿈과 도전을 상징하는 이 질문은, 앞으로 소개될 Google Cloud AI 기술들이 기존의 한계를 어떻게 허물고 있는지를 시청각적으로 표현했습니다.

영상 속 대표 장면 예시:

- 의료: “왜 치료법을 찾지 못하겠어?” → AI 기반 신약 후보 탐색\n- 농업: “왜 적합한 작물을 바로 여기 심을 수 없지?” → AI 기반 작물 최적화\n- 물류: “하루 80만 개의 소포를 왜 일일이 사람이 검사해야 해?” → AI 비전 기반 자동화 검사\n- 사이버 보안: “피싱 공격을 왜 못 막아?” → AI 기반 실시간 패턴 감지\n- 개발자 도구: “왜 개발자가 코딩 외의 일로 시간을 낭비해야 하지?” → Gemini Code Assist

컨셉 요약:

- 단순한 슬로건이나 제품 광고가 아닌, “AI의 실질적인 문제 해결 능력”을 다양한 산업과 일상 속에서 보여주는 비주얼 내러티브 구성\n- 마치 영화 예고편처럼 구성하여 시청자의 몰입도 극대화\n- 대사와 질문에 대한 응답은 대부분 “Yes, really.” → 실제로 가능해진 기술임을 강조

기술적 메시지:

“우리가 만든 가장 도움이 되는 AI(Gemini)는 이제 상상을 넘어서 실행 가능한 현실로 나아가고 있다.”

전략적 의미:

이 오프닝은 전체 키노트의 핵심 메시지를 미리 압축해 보여주는 도입부 역할을 했습니다. 또한, Google Cloud가 단순한 클라우드 인프라 제공자가 아니라, 기업과 사회의 혁신 파트너임을 강조하는 상징적인 장치이기도 합니다.

🚀 02:53 - Google Cloud Momentum

요약:

Thomas Kurian (Google Cloud CEO)는 Google Cloud의 지난 1년간의 성과를 요약하며 키노트의 본론을 열었습니다. 이 세션은 Google이 기술적 진보뿐 아니라 글로벌 인프라 확장과 고객 기반 확대에 집중해 왔다는 점을 강조합니다.

주요 성과 하이라이트:

- ✅ 기능 개선: 2024년 한 해 동안 Google Cloud 및 Workspace에 3,000개 이상의 제품 기능 업데이트

- ✅ 글로벌 리전 확장: 클라우드 인프라를 42개 리전으로 확대

- 새로 추가된 지역: 스웨덴, 멕시코, 남아프리카공화국

- 향후 확장 예정: 말레이시아, 태국, 쿠웨이트 등

- ✅ 네트워크 인프라 강화:

- 전 세계 200개 국가/지역에 연결된 2백만 마일 규모의 지상 및 해저 광섬유망

- 신규 해저 케이블 프로젝트: Umoja, Bosun, Proa

- ✅ AI 확산 지표:

- Gemini 사용자 400만 명 돌파

- Vertex AI 사용량 20배 증가 (Gemini Flash, Imagen 3, Gemini 2.0, Veo 도입 효과)

- Google Workspace에서 월 20억 건의 AI Assist 활용 (문서 작성, 회의 요약, 이메일 작성 등)

핵심 메시지:

"작년에는 AI의 미래를 이야기했지만, 올해는 그 미래를 실제로 구현하고 있다."

전략적 의미:

- Google Cloud는 단순한 클라우드 인프라 제공자에서 AI 중심의 생산성 플랫폼으로 변모하고 있음

- 특히 Workspace(문서, 메일, 스프레드시트 등)에서 AI 기능이 실사용으로 안착되었음을 강조

- 제품 개선, 고객 확장, 인프라 구축, 생태계 확장을 통해 클라우드 AI의 대중화 기반이 마련되었음을 시사

사례 연결 포인트:

- 이어지는 세션에서는 이러한 인프라 및 AI 모델이 어떤 식으로 제품화(Productization) 되었는지를 구체적으로 다루게 됩니다. 특히 다음 챕터인 💸 05:12 - Investment in Every Layer of the Stack에서 구체적 CAPEX 투자 전략과 AI 전용 하드웨어가 소개됩니다.

💸 05:12 - Investment in Every Layer of the Stack

발표자:

Sundar Pichai (Google & Alphabet CEO)

핵심 메시지:

Google은 인공지능의 미래를 위해 하드웨어, 네트워크, 소프트웨어, 모델, 제품에 이르기까지 AI 전체 스택에 걸친 투자를 단행하고 있다.

📌 주요 발표 내용 요약

1. CAPEX 투자 규모 (2025 계획)

- 총 투자 규모: $75 Billion (약 100조 원)

- 투자 영역:

- 데이터 센터 확장

- AI 전용 연산 인프라 (TPU, GPU)

- 글로벌 네트워크 (광섬유, 클라우드 엣지 등)

2. Google Cloud WAN 출시

- Google의 프라이빗 글로벌 네트워크(2백만 마일 광케이블)를 엔터프라이즈 고객에 개방

- 기존 대비 최대 40% 성능 향상, 총소유비용 40% 절감

- Citadel Securities, Nestlé 등 이미 활용 중

- 향후 모든 Google Cloud 고객에게 적용 예정

3. 7세대 TPU: Ironwood 공개

- 2013년부터 자체 개발한 Tensor Processing Unit의 최신 버전

- 1세대 대비 3,600배 성능 향상

- Google이 만든 역대 가장 강력한 AI 칩

- Gemini 2.5 같은 초대형 모델 학습과 추론에 최적화

- 에너지 효율성도 29배 향상

4. Quantum AI: Willow Chip 발표

- 양자 오류 수정(Quantum Error Correction) 기술을 최초로 실현

- Willow는 양자 컴퓨팅 상용화의 전제 조건을 해결한 칩

- Google DeepMind 연구팀과 공동 개발

- 향후 대규모 양자 컴퓨팅으로 연결될 수 있는 중요한 기반

💡 기술적/전략적 의미

- 단순히 AI 모델 성능 경쟁이 아니라, Google은 AI를 위한 물리적 세계의 기반(Compute, Storage, Network)을 직접 설계하고 있다는 점에서 차별화됨.

- 특히 “End-to-End AI Stack”을 자체적으로 구축, 제어함으로써 가격/성능/에너지 측면에서 경쟁자 대비 우위를 확보.

- Cloud WAN을 통해 네트워크마저 “Google화”하여 고객이 Google의 글로벌 속도와 신뢰성을 직접 이용할 수 있게 됨.

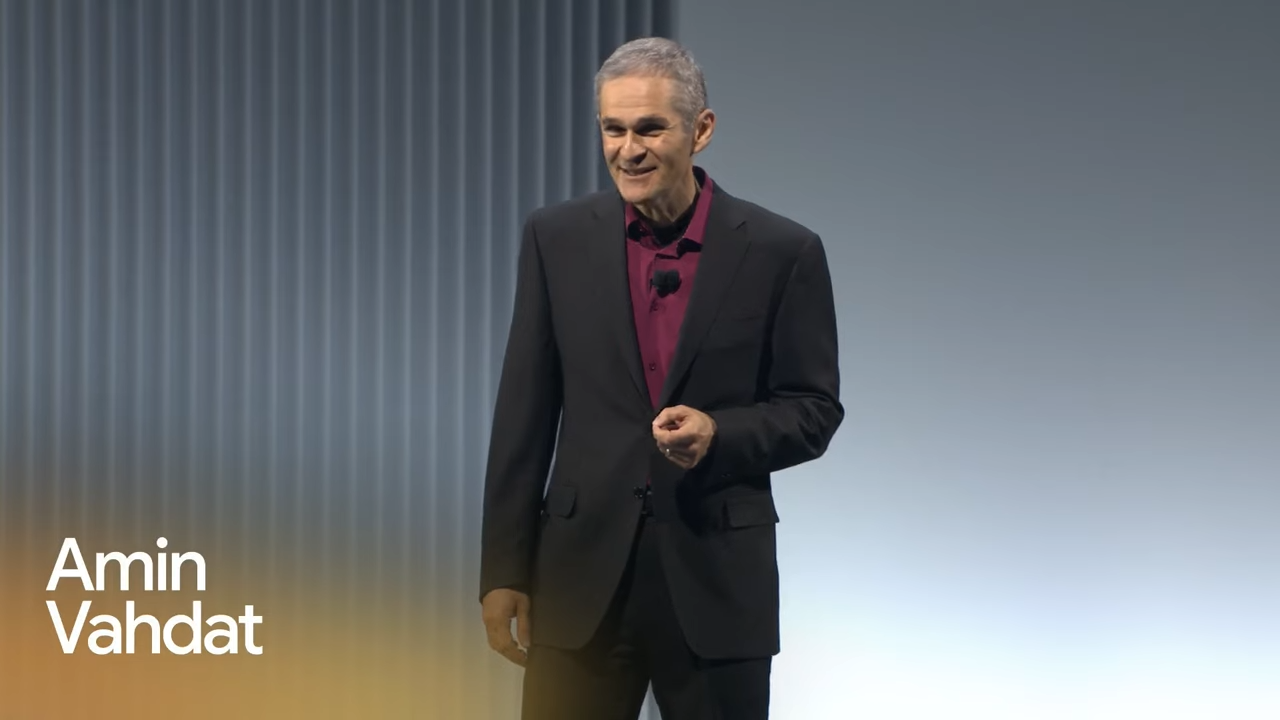

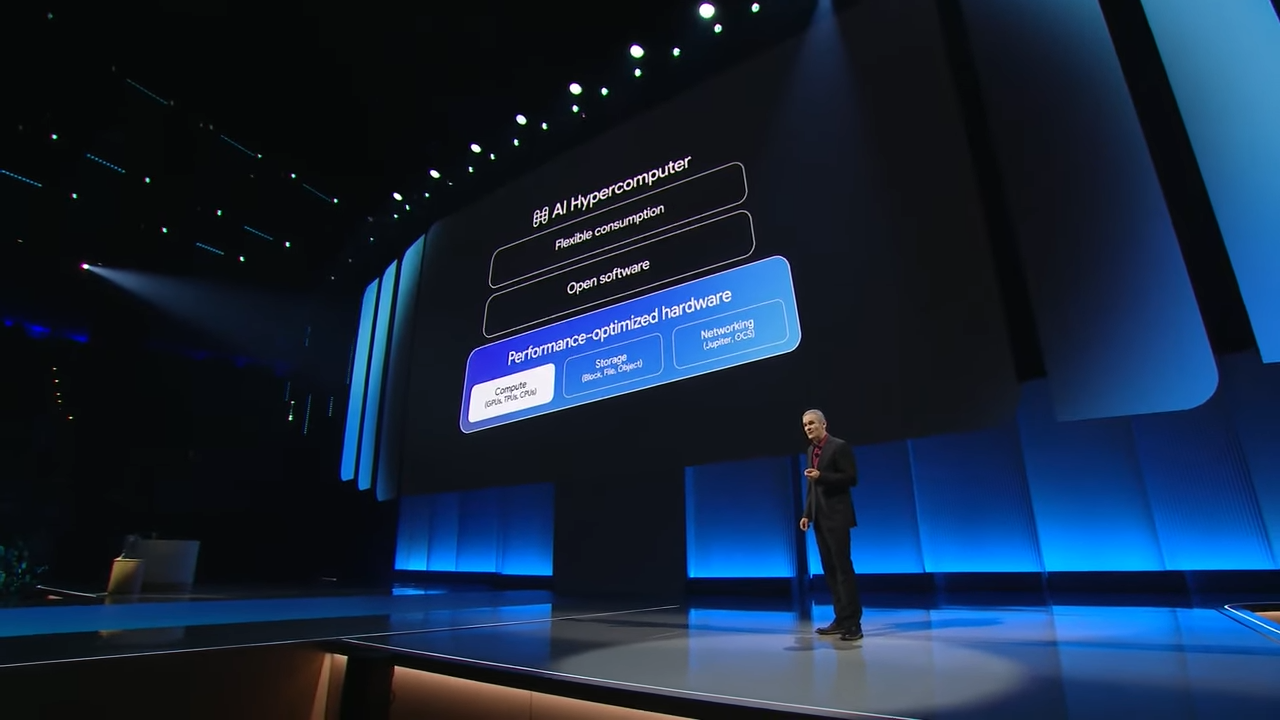

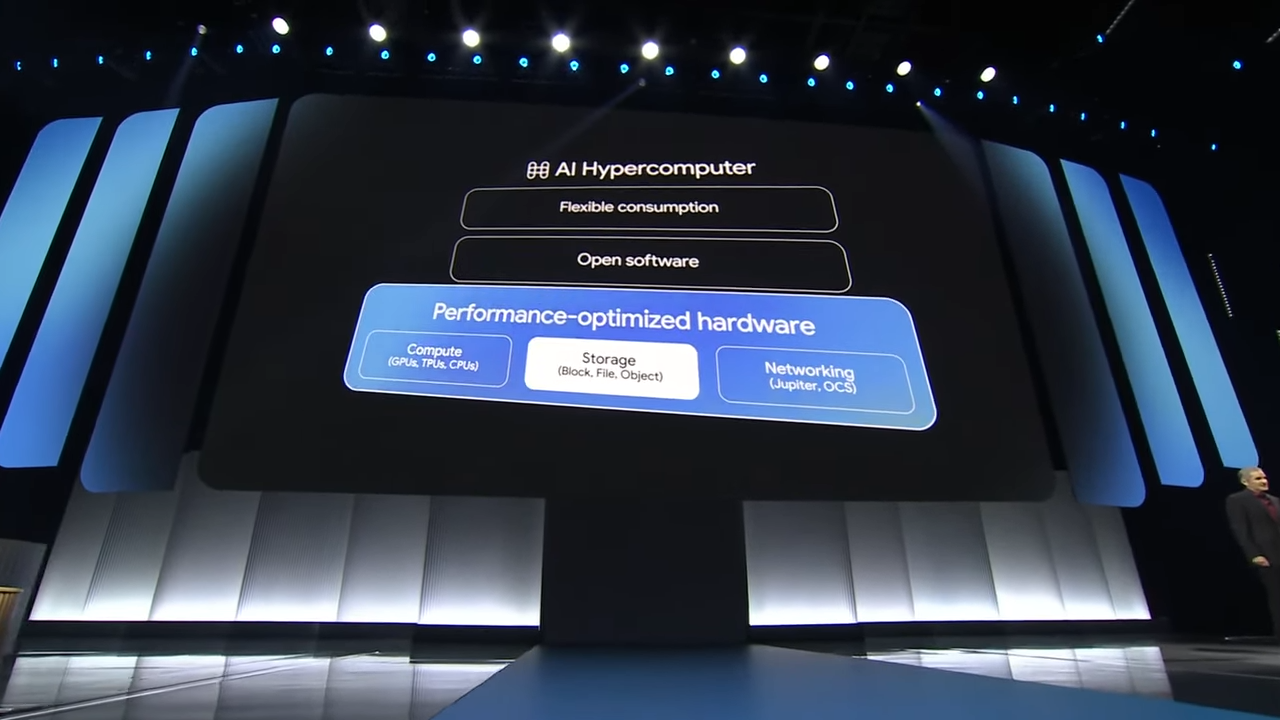

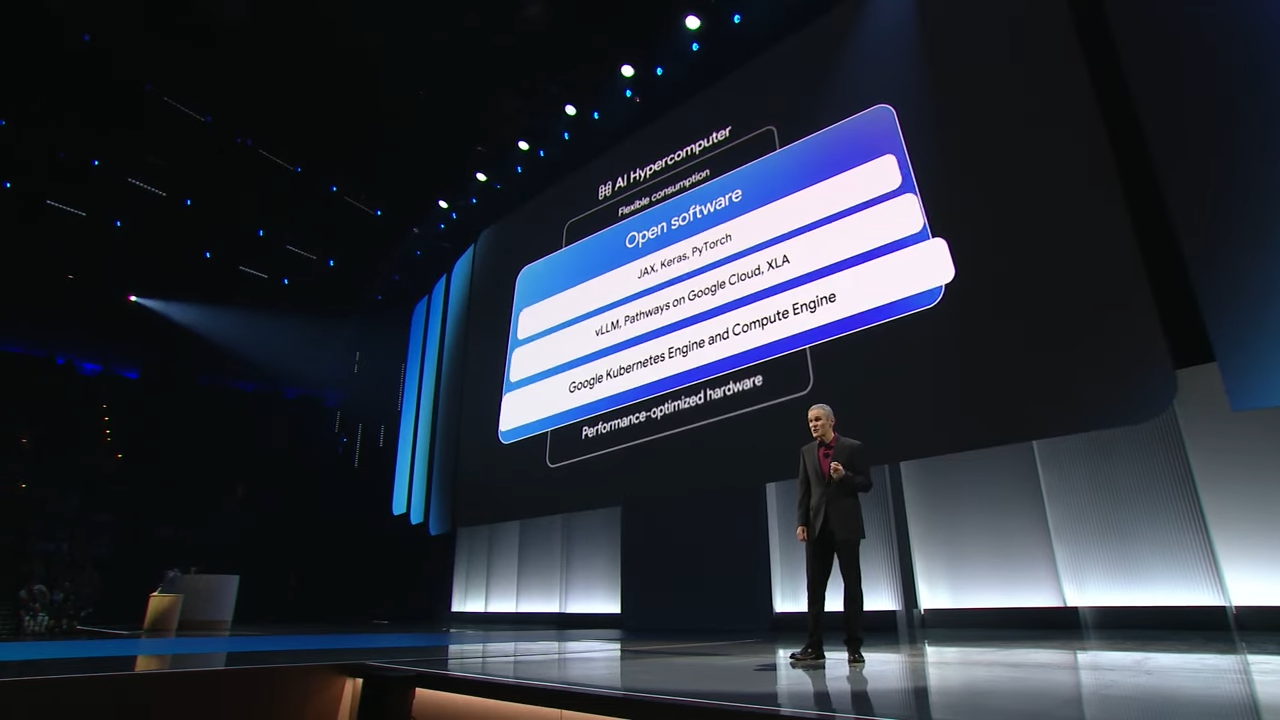

✅ 5) 🧠 16:19 – AI Hypercomputer & Infrastructure

발표자:

Amin Vahdat (VP/GM, Systems & Services Infrastructure, Google Cloud)

핵심 메시지:

AI 시대의 컴퓨팅 수요는 기존 인프라로는 감당할 수 없다. Google은 이를 해결하기 위해 AI Hypercomputer라는 새로운 형태의 슈퍼컴퓨터급 인프라 아키텍처를 설계했다.

📌 주요 구성 요소 요약

1. Ironwood TPU Pod

- 7세대 TPU 칩 기반

- Pod 당 9,000개 이상의 TPU를 탑재

- 최대 42.5 exaFLOPS 성능 제공

- 비교: 세계 1위 수퍼컴퓨터 Frontier (1.7 exaFLOPS)의 25배 수준

- Gemini 2.5 같은 ‘Thinking Model’을 위한 고성능 학습/추론 전용 설계

2. GPU 포트폴리오 확장

- NVIDIA 최신 GPU(B200, GB200, Vera Rubin) 조기 도입

- Vera Rubin: 1랙당 15 exaFLOPS FP4 추론 성능

- Google은 이 GPU를 가장 먼저 상용화하는 클라우드 중 하나

3. 스토리지 최적화

- Hyperdisk Exapools: AI 클러스터를 위한 최대급 IOPS/용량 제공

- Anywhere Cache: 가속기 근처에 데이터를 캐싱해 latency 70% 감소

- Rapid Storage (Zonal Object Storage): 기존 클라우드 대비 5배 빠른 R/W latency 제공

4. 소프트웨어 레이어 통합

- Pathways Runtime 공개: Google 내부 Gemini 모델을 학습/서빙하는 분산 ML 런타임을 외부에 공개

- vLLM on TPU: 기존 PyTorch + vLLM 사용자를 TPU에서 저비용으로 실행 가능하게 지원

- GKE (Kubernetes): GenAI aware auto-scaling + load balancing 도입 → 비용 30% 절감, 성능 40% 향상

💡 전략적 가치

- “Hypercomputer”는 단순히 빠른 서버의 집합이 아니라,

인프라 하드웨어 + 스토리지 + 네트워크 + 스케일러블 런타임까지 통합한 AI 전용 수퍼컴퓨터 플랫폼 - 고객 입장에서는 고성능 LLM도 낮은 비용, 높은 유연성, 빠른 서빙 지연시간으로 사용할 수 있게 됨

- 이는 Gemini 모델군이 GPT-4o보다 24배 높은 intelligence-per-dollar를 달성하는 기술적 기반임

🧬 18:44 - Research & Foundation Models

발표자:

Thomas Kurian (Google Cloud CEO)

핵심 메시지:

“우리는 세계 최고의 AI 연구를 바탕으로 모델의 한계를 넘어서는 도전을 이어가고 있다. 이제 AI는 ‘생성’만이 아니라 ‘사고(Thinking)’하기 시작했다.”

📌 대표 모델 및 연구 성과 요약

1. Gemini 2.5 Pro (Thinking Model)

- 가장 지능적인 Google AI 모델로 소개됨

- 고차원 추론(Reasoning) 능력을 보유: 계획 세우기, 코드 해석, 단계별 문제 해결 등

- 예시:

- 루빅스 큐브 코드 시뮬레이션

- 물리 현상 시각화(중력, 자기장 시뮬레이션)

- Chatbot Arena 1위 모델

- Humanity’s Last Exam 등 고난도 벤치마크에서도 최고점 기록

2. Gemini 2.5 Flash (경량 + 고속 모델)

- 추론 속도와 비용 최적화에 집중

- reasoning 정도를 직접 조절 가능

- 고성능/저비용을 병행할 수 있는 기업용 실시간 AI 서빙 모델

- Vertex AI, Gemini App에 곧 출시

3. Imagen 3

- 이미지 생성 품질 대폭 향상

- 세밀한 조명 표현, 질감, 얼굴 묘사 능력 강화

- 광고, 브랜드 콘텐츠 제작 등에서 활용 증가

4. Chirp 3 & Lyria

- Chirp 3: 사용자 목소리 10초만으로 고품질 TTS 음성 생성

- Lyria: 텍스트 → 음악 변환 (30초 클립 생성 가능)

- 음성 내레이터, 브랜드 음향 디자인에 사용됨

5. Veo 2

- 장시간 4K 비디오 생성 가능

- Sphere 프로젝트(Wizard of Oz) 적용 사례 소개

- 영화급 퀄리티로 기존 콘텐츠 리마스터링

- Google DeepMind와 협력하여 딥러닝 기반 영화 제작 시대의 서막을 알림

🧪 AI 연구의 방향성과 확장성

- AI는 단순한 언어 모델(LM)을 넘어, 멀티모달(Multimodal) 모델, 도구 사용(Tool Use), 에이전트 기반 사고 체계로 진화 중

- 연구와 제품이 완전히 연결되어 있으며, Gemini 모델군은 이를 대표하는 플래그십 체계임

💡 전략적 의미

- Google은 자체 연구 역량(DeepMind + Research)과 인프라를 결합해 기술적 파운더십을 유지하고 있음

- 단순한 챗봇 경쟁에서 벗어나, 지식 추론, 멀티모달 생성, 협업적 에이전트 설계까지 전방위에서 선도

- 기업과 개발자에게는 Google의 모델이 가장 빠르게 실험 → 적용 → 확장 가능한 생태계로 자리 잡고 있음을 강조

🧩 33:22 - Vertex AI

발표자:

Thomas Kurian (CEO, Google Cloud)

핵심 메시지:

“Vertex AI는 단순한 모델 제공 플랫폼을 넘어, 에이전트 생태계 전체를 아우르는 통합 AI 플랫폼으로 진화하고 있습니다.”

📌 주요 내용 요약

1. Model Garden 확장

- Vertex AI의 Model Garden에서 200개 이상의 파운데이션 모델 제공

- Google 자체 모델: Gemini, Imagen, Veo, Chirp, Lyria 등

- 외부 모델 통합: Meta LLaMA 4, Mistral, AI2 오픈모델 등 서드파티 및 오픈소스 모델 포함

- 통합 관리: 모델 선택 → 튜닝 → 배포 → 성능 모니터링까지 한 플랫폼에서 가능

2. 실시간 데이터 & 엔터프라이즈 시스템 연결

- BigQuery, NetApp, SAP, Oracle, Salesforce, ServiceNow, Workday 등과의 통합 강화

- 별도 복제 없이 연결 가능한 네이티브 데이터 연동 구조 제공

- 다양한 벡터 데이터베이스 및 문서 저장소도 자동 연결 지원

3. Fact-grounded AI를 위한 '팩추얼리티 보정(Factuality Grounding)' 기술

- Google Search, 기업 내부 데이터, Google Maps, 제3자 API 등을 통해 응답의 정확도(grounding)를 개선

- 기업 고객이 AI 응답의 신뢰도를 높일 수 있도록 설계됨

4. 새로운 모델 튜닝 & 운영 기능

- 파인튜닝, SFT, LoRA 등 다양한 튜닝 방법 제공

- 자동화된 지표 기반 튜닝 지원

- 대시보드에서 사용량, 지연시간, 실패율, 성능을 통합 모니터링 가능

💡 전략적 의미

- Vertex AI는 단순한 ML 플랫폼에서 멀티모달, 멀티모델, 멀티에이전트 통합 플랫폼으로 확대됨

- 클라우드 기반 MLOps/LLMOps를 지원하면서도, Open/Interoperable 구조를 갖추어 기업 내 기존 IT 자산과 충돌 없이 자연스럽게 통합 가능

- 모델 중심 → 에이전트 중심으로 중심축이 이동하고 있으며, 이는 이어지는 ‘Agents’ 세션으로 본격 확장됨

🤖 46:40 - Agents: 멀티에이전트 시대의 도래

발표자:

Thomas Kurian (CEO, Google Cloud)

핵심 메시지:

“AI는 이제 단일 응답형 챗봇이 아니라, 계획하고 기억하고 도구를 사용하며 다른 에이전트와 협업하는 실질적 작업 수행자(Agent)로 진화하고 있다.”

📌 에이전트(Agent)의 정의와 역할

- 에이전트(Agent)는 단일 질문-응답 구조를 넘어, 다음 기능을 수행하는 지능형 작업 단위입니다:

- 추론(Reasoning)

- 계획(Planning)

- 기억(Memory)

- 도구 사용(Tool Use)

- 다중 단계 수행(Multi-step Execution)

- 타 에이전트와 협업(Agent-to-Agent Collaboration)

이러한 시스템은 단순 챗봇보다 훨씬 진화된 형태로, 실제 비즈니스 프로세스를 자동화하고 대체할 수 있는 가능성을 보여줍니다.

🛠️ 주요 구성 요소 및 기술

1. Agent Development Kit (ADK)

- 오픈소스 멀티에이전트 프레임워크

- 에이전트 정의, 스킬 등록, 툴 연동, 계획 설정 등 복잡한 구성 가능

- 복잡한 업무를 분해하고, 역할별로 여러 에이전트를 조합하여 대화 시퀀스 구성

2. Model Context Protocol (MCP)

- 하나의 모델/에이전트가 다양한 데이터 소스와 도구를 표준 방식으로 접근할 수 있도록 하는 통합 인터페이스

- 매번 커스텀 API 연동 없이도 ERP, CRM, Vector DB 등과 연결 가능

3. Agent-to-Agent Protocol

- 서로 다른 언어 모델 (Gemini, Claude, Llama 등)로 만들어진 에이전트들이 상호 협력할 수 있는 다중모델 호환 프로토콜

- LangGraph, Crew AI 등과 상호 운용성 확보

🔗 실질적 의미 및 활용 방향

-

기업은 이제 단일 AI 도우미를 넘어서, 팀 단위의 AI 에이전트 체계를 구성할 수 있음

-

예:

- 고객 요청 → 정보 수집 → 가격 비교 → 결재 승인 → 메일 발송 → 회의 생성까지

- 전 과정을 여러 에이전트가 나누어 협력해 처리

-

Google은 이를 통해 단순한 “AI 플랫폼”에서 “Enterprise Multi-Agent Operating System”으로 확장 중

🌐 외부 생태계와의 연계

- LangGraph, Crew AI 등 주요 오픈 멀티에이전트 프레임워크와 호환

- Google Agentspace, Agent Builder 등과 결합해 엔드유저도 에이전트를 쉽게 생성 및 배치 가능

🧑💼 58:18 - Customer Agents

발표자:

Lisa O'Malley (Director, Product Management, Google Cloud)

핵심 메시지:

“AI는 이제 고객 서비스 영역에서 단순 FAQ를 넘어서, 감정 인식, 멀티모달 이해, 실시간 대응까지 수행하는 고객 대응 파트너로 진화하고 있습니다.”

🧾 주요 기업 사례

1. Verizon

- 28,000명의 고객 상담사에게 개인 맞춤형 AI 리서치 어시스턴트 제공

- 고객 이력, 선호, 상황에 따라 실시간으로 가장 적절한 응답과 해결책 제안

- 효과: 평균 처리 시간 단축, 문제 해결율 향상

2. YouTube

- AI 도입 후 고객 콜 이탈률 75% 감소

- AI가 실시간으로 이슈를 요약, 분류, 응대 경로 지정해줌

3. DBS 은행

- 대화형 AI로 복잡한 금융상품 문의 대응

- 감정 기반 대화 설계로 고객 만족도 향상

4. Mercado Libre (라틴 아메리카 이커머스 플랫폼)

- Vertex AI 기반으로 1.5억 개 이상의 상품을 멀티모달 검색으로 연결

- 고객이 이미지+텍스트로 상품 검색 가능, 구매 전환율 향상

🧠 AI 에이전트가 수행하는 능력

- 고객의 텍스트/음성/영상 요청을 이해하고 적절한 도구를 호출하여 작업 수행

- 자연어 기반 질의 응답, 제품 추천, 장바구니 추가, 결제 처리, A/S 예약까지 자동화

- 감정 인식 기능을 통해, 고객 불만 시 태도 전환, 담당자 연결 등도 수행 가능

🛠️ 새로운 기능 요약

- 음성 & 비디오 인터페이스 지원: 고객이 제품을 비추면 자동 식별

- 감정 인식 기반 대화 전환: 고객의 톤, 표현 등을 분석해 적절한 대응

- API 연동 자동화: CRM, 주문 시스템, 창고 정보 등과 연결해 업무 실행

💡 전략적 의미

- 이제 기업은 콜센터 자동화를 넘어서, 실시간 맞춤형 응대와 고객 만족을 동시에 달성할 수 있는 시스템을 구축 가능

- Google은 단일 챗봇을 넘어서, 고객의 행위와 맥락을 이해하는 “Agent-based Customer Experience 플랫폼”으로 자리매김하고 있음

- 이는 향후 소개되는 Creative, Data, Code, Security 에이전트와의 에이전트 생태계 통합으로 확장됨

🎨 1:12:54 - Creative Agents

발표자:

Lisa O'Malley & Nenshad Bardoliwalla (Google Cloud)

핵심 메시지:

“AI는 단지 생산성을 높이는 도구를 넘어서, 창조성(Creativity)의 파트너로 확장되고 있습니다. 이제 브랜드, 스튜디오, 크리에이터들은 Google Cloud의 에이전트 기반 생성형 미디어 기술을 활용하여 새로운 방식으로 콘텐츠를 제작하고 있습니다.”

🖼️ 대표 에이전트 및 모델 소개

1. Veo 2 – 고해상도 비디오 생성

- 4K 해상도, 수분 분량의 동영상 생성 가능

- 새로운 기능:

- 카메라 프리셋(패닝, 드론샷 등)

- First & Last Shot Control (시작/끝 장면 설정)

- Dynamic Inpainting/Outpainting (장면 내 요소 추가/삭제)

- 사례:

- 라스베이거스 Sphere 공연장에서 상영되는 ‘오즈의 마법사’ 리마스터링에 사용

- 스튜디오급 영상 퀄리티를 AI로 재현 가능함을 시각적으로 증명

2. Imagen 3 – 고정밀 이미지 생성

- 텍스트 프롬프트로 고품질 이미지 생성

- 질감, 조명, 얼굴 표현 등 디테일 향상

- Adobe Express와의 통합으로 디자이너 워크플로우에 쉽게 활용 가능

3. Lyria – 음악 생성 모델

- 텍스트 기반 입력으로 30초 분량 음악 생성

- 감정/장르/템포를 제어할 수 있음

- 광고, 소셜 콘텐츠, 인터랙티브 미디어용 음악 제작에 최적화

4. Chirp 3 – 커스텀 음성 생성

- 사용자의 목소리 샘플 10초만으로 AI 내레이터 생성

- 오디오북, 튜토리얼, 마케팅 콘텐츠 등에서 활용 가능

🎥 데모 시연: AI 콘서트 예고편 만들기

Nenshad Bardoliwalla가 실제 데모로 Veo + Lyria를 활용해 콘서트 예고편 영상을 만드는 과정을 실시간 시연함:

- 라스베이거스 스카이라인 이미지 불러오기

- Veo의 드론샷 프리셋으로 영상 생성

- 등장인물, 무대, 관객 등 개별 씬 생성

- 실수로 등장한 스태프를 inpainting으로 삭제

- Lyria로 배경 음악 2개 생성 → 원하는 분위기로 선택

- 전체 씬 + 음악 조합으로 최종 예고편 완성

➡️ 이 과정을 통해 Veo는 전문가가 아닌 일반 사용자도 시네마틱 영상 제작을 가능하게 하는 툴임을 강조

💡 전략적 의미

- 기업은 이제 콘텐츠 기획–제작–수정–배포 과정을 AI를 통한 자동화 및 협업 구조로 전환 가능

- 광고/마케팅, 미디어/방송, 교육/엔터테인먼트 업계는 비용과 시간 단축 + 창의적 실험 증가

- Google은 생성형 미디어 모델을 영상, 이미지, 오디오, 음악까지 “모든 모달리티”로 확장해 제공 중

📊 1:16:40 - Data Agents

발표자:

Yasmeen Ahmad (Managing Director, Google Cloud AI)

핵심 메시지:

“데이터 분석의 미래는 더 이상 복잡한 코드나 도구를 배우는 것이 아니라, 자연어 기반 대화와 에이전트를 통해 누구나 분석과 인사이트를 실현하는 시대로 전환되고 있습니다.”

📊 데모 시나리오: “Cash Flow 분석하기”

Yasmeen은 Colab + BigQuery + Vertex AI를 이용해 기업의 현금 흐름 악화 원인을 자연어 기반으로 분석하는 에이전트 기반 워크플로우를 시연했습니다.

- SAP, Salesforce, Google Ads, PDF 청구서 등의 데이터를 BigQuery에 연결

- 데이터 엔지니어링 에이전트를 통해 여러 소스에서 멀티모달 테이블 생성

- 날짜 포맷 등 데이터 품질 문제 → Gemini 기반 자동 정제

- PDF 문서에서 구매자 정보와 지불 조건 추출 (멀티모달 분석)

- 분류 모델로 구매자 세그먼트 분리

- Gemini의 ‘Thinking Model’ 기반 원인 분석 →

➤ 원인은 “36개월 지불 조건이 도입된 신규 프로모션” - 향후 3개월 현금 흐름 예측 → 신상품 및 고객군 별로 분석

- 특정 세그먼트(식음료 도매상)에서만 위험 발생

- 전략 제안: 프로모션 조건을 타겟팅 방식으로 변경

💡 주요 기술 포인트

- BigQuery가 단순 SQL 쿼리 엔진을 넘어,

➤ 멀티모달 분석 플랫폼 + ML 모델 서빙 + 예측 수행 엔진으로 진화 - 자연어로 분석 요청 → 전처리 → 모델 학습 → 예측 → 전략 제안까지 하나의 워크플로우 수행 가능

- Colab 내에서 에이전트가 코드를 직접 생성하고 수정 → “AI와 함께 일하는 분석가” 구조

🧠 제공되는 에이전트 유형

- Data Engineer Agent: 데이터 결합, 정제, 카탈로그 생성

- Data Scientist Agent: 특성 엔지니어링, 예측 모델링

- Business Analyst Agent: 자연어 질의 기반 KPI 분석 및 리포팅

- Embedded Agent: Web/Mobile App 내 임베딩 가능

🧩 전략적 의미

- Google Cloud는 데이터를 가장 먼저 연결하고 가장 빠르게 분석하는 “End-to-End Data AI Stack”을 지향

- AI가 단지 모델이나 기능이 아니라, 실제 업무에서 Insight를 주는 디지털 동료(Agent)로 작동함

- 이는 LLM + Data + Application 통합 플랫폼으로서 Vertex AI의 확장성을 보여줌

💻 1:20:14 - Code Agents

발표자:

Brad Calder (VP, Google Cloud Platform)

핵심 메시지:

“개발의 미래는 ‘AI가 함께 코딩하는 팀원’과 함께하는 것입니다. Gemini Code Assist는 단순한 코드 제안이 아닌, 계획, 생성, 리뷰, 디버깅까지 전 과정을 지원하는 에이전트 기반 개발 파트너입니다.”

🛠️ 주요 기능 및 구조

1. Gemini Code Assist 플랫폼

- Vertex AI 기반의 LLM 기반 개발자 도구

- 실시간 제안 + 전체 파일 단위 이해 + 코드 수정 자동화

- Enterprise 환경에 최적화된 형태로 보안, 문서화, 테스트 코드를 동시에 생성

2. 개발 프로세스별 전용 Agent 지원

- 요구사항 정의 → 코드 생성 → 단위 테스트 → 리뷰 → 배포까지

- 각 프로세스를 분담하는 에이전트들이 상호 협력하는 구조

- 예:

- “Refactor this legacy Java service to use async Python.”

- “Detect all SQL injection risk in the following Flask app.”

- “Generate a test plan for this microservice.”

3. 실시간 협업 인터페이스: Kanban Board

- 개발자가 에이전트와 작업 단위별로 협업 가능

- 자동으로 태스크 생성, 우선순위 지정, 리뷰 가능

- 각 작업의 상태 및 에이전트의 작업 내용을 시각적으로 파악 가능

4. 다양한 통합 환경 지원

- IDE: VS Code, JetBrains, Android Studio

- 협업 툴: GitHub, GitLab, Jira, Sentry, Snyk, Replit, Tabnine 등

- Google 내부뿐 아니라 Aider, Cursor 등 외부 툴과도 연동

💡 전략적 의미

- Gemini Code Assist는 GPT 기반 코드 보조 도구(Copilot 등)와 달리, 엔터프라이즈 보안, 표준 준수, 팀 기반 협업을 내장한 구조

- 개발자는 코드를 직접 작성하지 않고도, 대화 기반의 개발 기획–구현–검토–배포를 수행할 수 있음

- 이는 기업의 개발 생산성을 극적으로 높이는 동시에, AI 개발자와 인간 개발자가 협업하는 시대의 시작을 의미함

🔐 1:29:53 - Security Agents

Sandra Joyce는 Google Unified Security (GUS)를 소개하며 보안 에이전트의 도입을 공식화했습니다.

- 프롬프트 유출 탐지, 악성 요청 자동 차단, LLM 보호 기능

- VM 및 브라우저 트래픽 상관관계 분석

- 실시간 리스크 시각화 및 대응 플로우 자동화

특히, 개발자와 보안 담당자가 실시간 협업하며 보안 리스크를 즉시 대응할 수 있는 환경이 GUS로 구현되고 있다는 점을 강조했습니다.

맺음말: AI 중심의 새로운 클라우드

발표자:

Thomas Kurian (CEO, Google Cloud)

핵심 메시지:

“Google Cloud는 단순한 클라우드 공급자가 아닙니다. 우리는 여러분이 AI 중심 조직으로 전환할 수 있도록, AI에 최적화된 풀스택 플랫폼과 생태계를 제공합니다.”

🌎 Google Cloud의 3대 전략적 비전

1. AI Optimized Platform

- Google은 모델, 인프라, 플랫폼, 서비스 전 영역을 AI 최적화 구조로 설계

- 자체 설계한 칩(7세대 TPU), Hypercomputer 아키텍처, Gemini 모델군, Vertex AI, Workspace까지 하나의 수직 통합 AI 스택 제공

2. Open & Interoperable Multi-Cloud

- Amazon, Azure, Oracle 등 다른 클라우드 및 SaaS와 서로 연결 가능

- Cross-Cloud Interconnect, Federated Identity, BigQuery Omni, Vertex AI Multicloud Serving 등으로 구현

- 다양한 ISV, 파트너사와 사전 통합된 솔루션도 Marketplace에서 즉시 배포 가능

3. Sovereign & Trusted AI

- Google Distributed Cloud + Sovereign AI 전략을 통해 규제, 데이터 주권, 보안 요건을 갖춘 AI 도입 가능

- 미국 정부의 Secret/Top Secret 인증을 받은 Air-Gapped 환경 제공

- Workspace, Gemini, Veo, Vertex AI 모델들도 이 환경에서 활용 가능

🤝 생태계 협력 강조

- Accenture, Deloitte, TCS, KPMG, Wipro, HCL 등 글로벌 파트너와 에이전트 개발 협업

- 각 산업별 특화 에이전트를 수천 개 개발 및 배포 중

- Adobe, SAP, Salesforce, NVIDIA 등 주요 기업과도 통합 및 공동 개발 발표

📆 마무리 메시지

- 다음 Google Cloud Next 2026은 2026년 4월 22~24일, 다시 라스베이거스에서 개최 예정

- Thomas는 “우리는 지금, AI 중심 시대의 클라우드를 함께 만들어가고 있다”는 말로 키노트를 마무리