저자소개 : 최원희, 송찬우, 김재혁

최원희; 정보통신산업진흥원(NIPA) 전문위원. 현대전자, 삼성 종합기술원, 삼성전자 DMC 연구소를 거쳐 무선사업부 선행 랩장을 역임했다. 삼성종합기술원에서 10여 년간 미래 기술을 연구하면서 ICT 분야 100여 건의 특허를 보유하고 있기도 하다. 이 책 『돈이 되는 메타버스』는 엔지니어로 20년 넘게 살아온 그녀가 메타버스라는 키워드에 포함된 다양한 하드웨어의 발전 현황과 소프트웨어 콘텐츠 및 빅테크의 동향까지 두루 파악해 자신만의 언어로 풀어간 대장정의 기록이다. 동시에 열정과 아이디어는 넘쳐나지만 현실적인 문제에 부딪혀 힘들어하는 엔지니어 후배에게 건네는 따뜻하고 든 든한 조언이기도 하다. ‘기술’과 ‘사람’ 사이에서 현명한 접점을 찾아가는 그녀의 행보는 ICT 분야 대학생 멘토링(한이음)과 전문개인투자자(엔젤투자자)로 발자취를 넓히며 여전히 진행 중이다.

송찬우; 한국과학영재학교를 졸업하고 KPF(KAIST Presi-dential Fellowship)로 선발되며 카이스트에 진학했 다. 상상을 현실로 만들어내는 다양한 재료들에 학문적 호기심을 느껴 신소재공학과를 택한 그는 최우등 졸업 후 현재 동대학 석사 과정을 마무리하고 있다. 인공지능, 메타버스, 모빌리티, 블록체인 등 여러 미래 기술 분야가 사람들의 삶을 어떻게 변화시키고 이끌어가는지에 대한 인사이트를 찾던 중 학문이 실제 비즈니스에서 어떻게 활용되는지 탐구하기 위해 잠시 학업을 쉬고 비디씨랩스㈜의 연구원으로 일했으며, 그때의 인연으로 이 프로젝트에 참여해 『돈이 되는 메타버스』 공저자로 이름을 올렸다.

김재혁; ㈜레티널 대표. 한양대 산업공학과에 재학하던 중 인지공학연구소에서 인간-컴퓨터 상호작용을 공부하였으며 이와 관련한 다양한 프로젝트를 수행해 국회 전시, 기술사업화 부분 산업통상자원부 장관상 수상 등의 쾌거를 이루었다. 2016년 증강현실 하드웨어 전문 기업 ㈜레티널을 창업해 현재까지 대표로 재직 중이며 열정과 실력 모두를 겸비한 대한민국 젊은 리더로 자리매김했다. 2021년 메타버스 어워드 과학기술정보 통신부 장관상을 수상했으며 2020년에는 《포브스》 선정 ‘아시아에서 영향력 있는 30세 이하 리더 30인’에 선정되기도 했다.

(2022.1.13 유튜브 삼프로TV 최원희 저자 심층인터뷰 中) URL : https://www.youtube.com/watch?v=mHZthgqNkD0&t=1858s&ab_channel=%EC%82%BC%ED%94%84%EB%A1%9CTV_%EA%B2%BD%EC%A0%9C%EC%9D%98%EC%8B%A0%EA%B3%BC%ED%95%A8%EA%BB%98

목차

프롤로그

게임 밖으로 나온 메타버스, 어떻게 세상을 바꿀 것인가

Part 1 - 왜 지금 메타버스인가?

1. 메타버스는 어디에서 왔나?

2. 메타버스는 왜 뜨거운 감자가 되었을까?

3. 게임과 메타버스는 어떻게 다른 걸까?

4. COVID-19가 끝나도 메타버스는 여전히 핫할까?

5. 메타버스와 가상화폐는 무슨 관계일까?

6. 메타버스 속 부캐의 의미는?

7. 빅테크들은 왜 XR 기기에 집착하는 것일까?

Part 2 - 메타버스는 어디에 쓰는 것인가?

1. 메타버스는 여가생활에 어떻게 활용될까?

2. 메타버스는 e커머스를 어떻게 변화시킬까?

3. 메타버스가 바꾸는 교육 현장은 어떤 모습일까?

4. 기업은 메타버스를 어떻게 활용하고 있나?

5. 메타버스에서 스마트 팩토리의 역할은 무엇인가?

6. 메타버스 속 도시는 어떤 모습일까?

7. 메타버스 시대의 자동차에는 어떤 일이 일어날까?

Part 3 - 다가올 웨어러블 메타버스에는 어떤 기술들이 사용될까?

1. VR/AR 기기의 필요성 : 어떤 기기가 웨어러블 메타버스에서 더 많이 사용될까?

2. 마이크로 디스플레이: 작고 가벼운 XR 기기를 위해 디스플레이는 어떻게 진화해야 할까?

3. 컴바이너 : 안경처럼 투명한 기기가 어떻게 디스플레이를 눈에 보이게 할까?

4. 인터페이스 : 웨어러블 메타버스 속에서는 어떻게 소통할까?

5. 공간 매핑과 장면 이해 : 메타버스 속 반려견이 소파에 앉아 있게 하려면?

6. 컴퓨터 그래픽 : 현실처럼 느껴지는 가상 콘텐츠를 만들 수 있을까?

7. 에지 클라우드 : 수백만 명이 동시에 접속하는 메타버스 세계를 매끄럽게 운영하려면?

8. 미래 인터페이스 (1) 촉각 : 메타버스 속 가상의 물체를 만질 수 있을까?

9. 미래 인터페이스 (2) 두뇌 : 일론 머스크의 ‘뉴럴링크’처럼 될 수 있을까?

10. 미래 디스플레이 : XR 글라스를 착용하면 「스타워즈」 레아 공주의 홀로그램이 보일까?

220621 |

part 1

1️⃣ 메타버스 - 블록체인 - NFT

로블록스나 제페토는 싸이월드나 다르지않다

2021년 로블록스 나스닥상장. 현재시점의 메타버스는 10대들이 현실에서 할 수없는걸 가상공간에서 체험하게 하는 기능 수단일뿐이긴 하나, 여러 상업적분야의 기능이 추가 되고있는 시점.

[블록체인시스템]

<디지털 자산>

-

현금대체 디지털 자산 : 디지털캐시, 쿠폰, 기프티콘, 디지털 상품권, 마일리지 포인트, 로열티 포인트

-

디지털 세상의 아이템 : 게임 내 아이템, 아바타, 디지털 가상제품, 가상부동산, 토지(샌드박스 등)

-

암호화폐 : 비트코인, 이더리움 등, 스테이블 코인, 유틸리티 코인, 증권형 코인

-

디지털화된 전통 실물자산 : 실물자산의 디지털화, 디지털 금융자산(주식, 채권, 금 등)

-

저작권, 소유권 : 디지털 영상 등 콘텐츠 저작권, 소설/만화 등, 실물자산에 대한 소유권

-

데이터관련 : 거래 증명서, 개인정보, 시스템운영, 기업 데이터 등

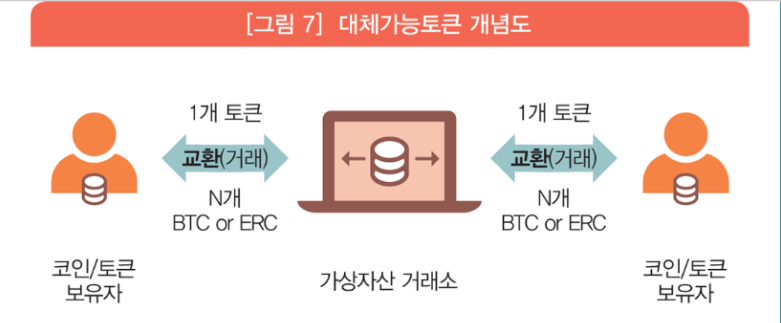

220622 | 메타버스 내 거래를 위해 가상화폐 외에 대체불가토큰 NFT(ERC-20규격 토큰가치동일, ERC-721), 블록체인 기술

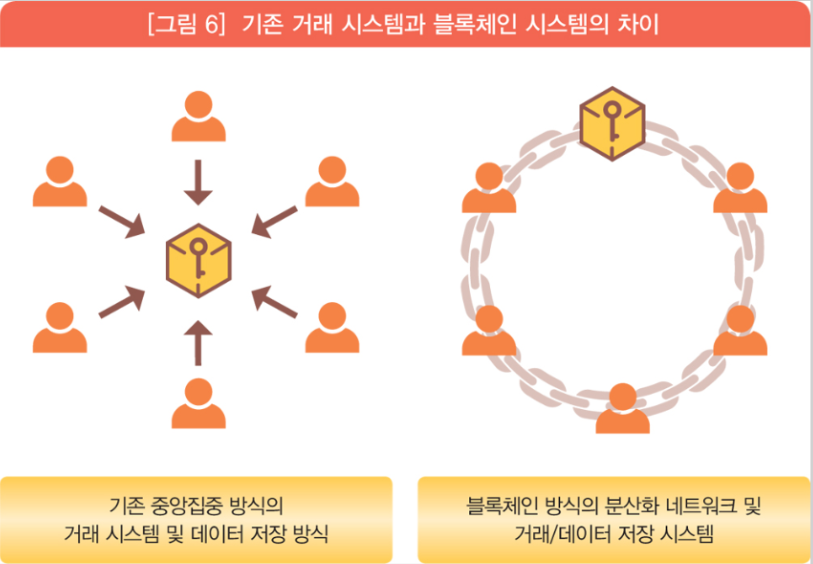

블록체인 : 탈중앙화로 변조 불가능(immutable), 추적이가능(traceable)

, 감사가 가능한 거래 장부를 만들어서 거래행위(transaction)을 부인하거나 조작하지못하게 가능.

before) 기준 중앙집중 방식의 거래 시스템 및 데이터 저장 방식

current) 블록체인 방식의 분산화 네트워크 및 거래/데이터 저장 시스템

[대체가능토큰개념도]

NFT생성시 컴퓨터 기계내 이산화탄소 만들어 친환경적이지는 않다는 것.

로블록스 -가상화폐거래시스템)

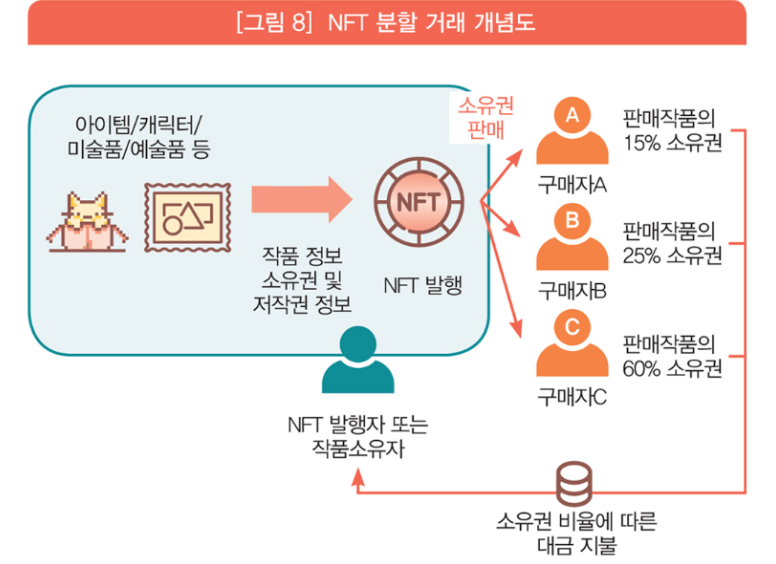

[NFT 분할 거래 개념도]

로블록스(미국,유럽)의 1로벅스, 1달러를 1200원으로 환산-> 15원/ 우리나라는 환전이 안됨

정식경로로는 안됨

제페토는 메타버스 소셜 플랫폼이라 게임서비스는 아님. 애매모호한 법률이 임시 기준으로 명명되어 가상융합 사업자 등의 제안에 따라 적용할 기준을 마련하도록 준비중.

디센트럴랜드의 마나-블록체인 기반거래시스템) -토지구매, 판매 가능/ 가상화폐 토큰은 마나 300명수준에서 우리돈 약 8억원거래량

[메타버스의 진심인 MS(좌) APPLE(우) QR로 확인]

220623 | 부캐란 학술적 표현으로 페르소나(그리스 어원 '가면')라 할 수 있다.

멀티페르소나 (사회적인 나, 본래의 나 극명하게 다르다고 높은 조사 수치)

저자는 현실에서는 이중적인 '나'의 모습에서 가지는 직업과는 전혀 상반되는 메타버스의 '나'는 새로운 2차 직업을 가지면서, 본인의 장점을 더 절실히 드러내며 경제활동이 가능 할 것이라 예상해본다.

빅테크들이 XR/VR기기에 집착하는 이유?

큰기업(애플메타구글) 생활기기(스마폰상용화) 사용으로 급격히 변화되는 걸 체험했기에, 다음세대의 모습을 상상하기 때문일 것이다. 현실세계를 뛰어넘는 미래사회는 발전된 기기를 통해 인간의 세밀하고, 감춰진 부분을 더 자세히 알 수 있어서가 아닐까?

[ MS심박수측정 APP]

0628 |

part 2

1️⃣ 메타버스의 여가생활

누구는 노동시간의 공백을 메우기 위해, 누구는 은퇴 후 시간의 활용을 위해 시작하게 될 메타버스라이프. 국내에는 펄어비스의 '도깨비', 엔씨소프트의 '유니버스'가 함께하고있다. 특이하게 엔씨소프트의 메타버스는 온오프라인 'K팝 플랫폼'을 전향해서 메타버스 엔터테인먼트(메타휴먼 등)도 설립해가는 중이다. K팝 버추얼 아이돌이라니,,,( 라떼에 아담이라는 사이버가수가 생각이난다) 여기 엔터테인먼트에는 넷플릭스(OTT 플랫폼)의 영향으로 기존 K팝 공연, 음반, 미술 전시 등을 넘어 웹툰에 까지 영향을 뻗어 가고 있다. 21년 11월에 네이버는 기술분야의 집합체 '아크버스'를 공개해 다양한 시도를 하며, 정밀한 3차원 매핑을 위해 항공사진과 이동지도제작시스템(MMS) 데이터를 결합한 '얼라이크'를 결합해, 보다 현실적인 상황을 구현했다.

0629 |

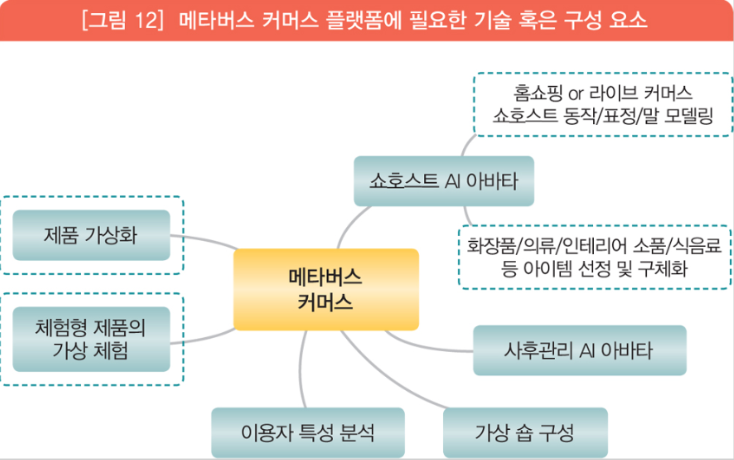

2️⃣ :메타버스의 e커머스

(1) 제품가상화

- 실물 디지털화, 대표적인 회사로 2017년에 설립된 이스라엘의 레스트AR 기업의 기술로 진행이 되었고, 국내기업에는 2019년 설립된 리콘랩스가 플리카라는 서비스로 실물화를 진행하고있다. 기술 방법은 제품을 1분내외의 동영상 촬영 후 자사 클라우드로 업로드하면 3D모델을 생성해, 이를 메타버스 시스템에 추가한다.

리콘랩스는 VR콘텐츠기업이었으나 코로나 팬데믹으로 사업모델을 변경해서 성공적으로 전향(피보팅)했다.

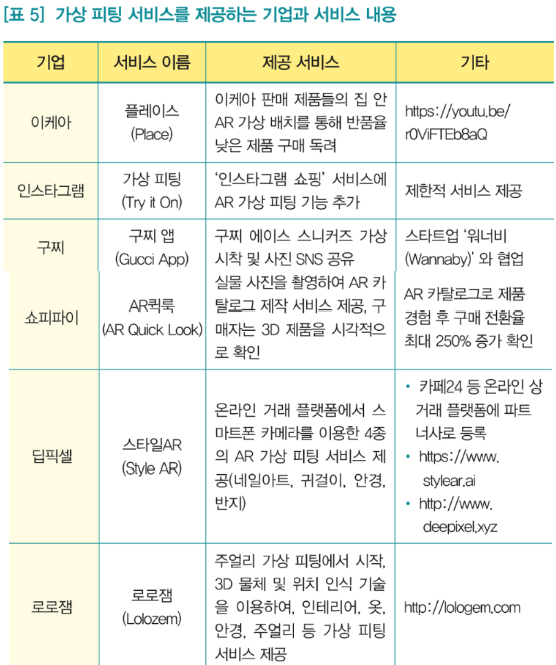

(2) 가상피팅

- 얼굴인식 주변을 꾸며주는 '스노우' 어플리케이션 처럼, 사물인식 프로그램으로 실물의 크기를 측정하여 메타버스상에서도 그래픽을 실물크기와 매칭시킨다. 가상피팅쪽 기술로는 레이트레이싱과 로로잼 회사의 3D벡터 위치 추적 기술로 접근가능.

0630 |

(3) 사후 관리 AI 아바타와 쇼호스트 AI 아바타

- 사후 관리AI는 주로 반품, 고장, 불량, 접수 분야의 챗봇으로 한정된 대답만 하는 것으로 알고 있으나, 강화된 AI 대화엔진 도입이 가능해져 있는 시점.

쇼호스트 AI는 실존인물을 3D 가상화하고있는 주력 회사는 국내기업'마인즈랩'과 '딥브레인 AI'가 있고. 이런 모델을 통해 키오스크 안내나, 기획전시, 이벤트 소개를 위한 아바타 대여사업을 한다.

회외 쇼호스트 사례를 들면 엔비디아 개발자 컨퍼런스GTC2020에서 가상화된 젠슨황 CEO의모습으로 가상화 기술단계를 체험해 볼 수 있다.

(4) 가상 숍 구성

- 배너나 광고가 아닌 3D의 현실성있는 가상숍은 보다 더 소비를 촉진할 것임.

[기업의 가상피팅 서비스]

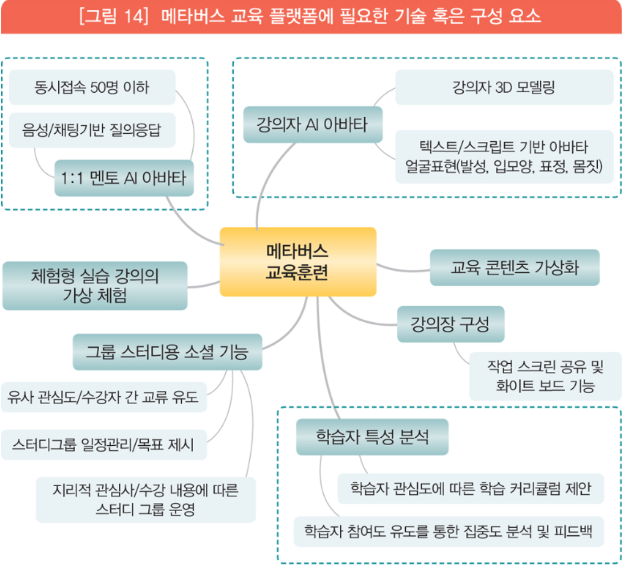

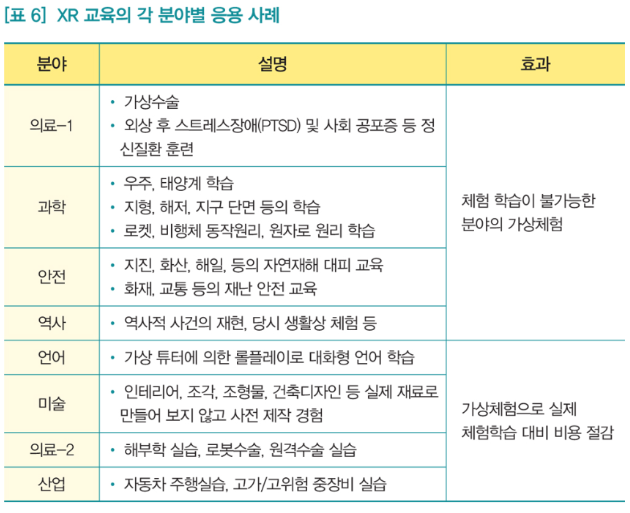

3️⃣ 메타버스 교육현장

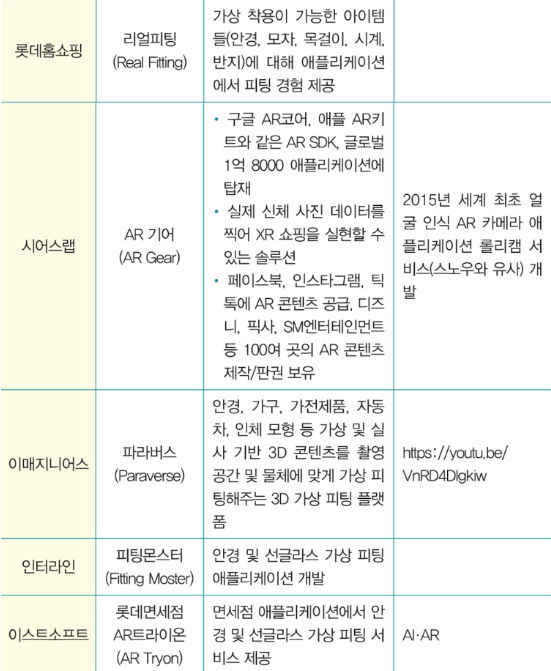

물리현상과 화학반응을 물리엔진과 3D그래픽으로 결합해 안전하면서 사실적인 장면을 연출 할 수 있으리라 생각하며, 다중감각자극에 인지부하를 줄여 큰 영향을 주리라 저자는 평가

기억저장의 단계(눈, 귀)를 통해서 사실기억과 더불어야 장기기억으로 이어지는 것에 대한 연구결과있음.

[기억저장단계]

[메타버스 교육을 알아보자!]

220705 |

(1) '1타강사' 아바타와 AI 멘토 아바타

-

메타e커머스에서 사후관리 AI예를 들었었다. AI 아바타는 산업마케팅분야에서뿐만 아니라, 교육문화에서도 발전해 나갈 것이다. 가상의 아바타라 신뢰도가 떨어질 것을 예상해, 유명 학원강사/대학교수 등이 가상화 될 것이라 본다. (본인이 아닌 가상화 아바타가 본인의 역학을 한다면, AI의 자율기능에대한 입장표명이 모호 해 질꺼라 독자인 나는 생각한다.) 자연어 처리성능 발달이 높아 웬만한 사람의 언어를 인식한다고 하는데, 질의응답이 어떻게 될지 궁금하다. 이세돌을 이긴 '알파고'인데, 얼마나 수준높은 대답이 나올지 기대해본다. 답을 줄때는 텍스트 기반의 자료를 음성으로 되돌리는 기술을 사용해, 유명인 목소리를 발화하여 친근함을 유지하는 기술(네오사피엔스의 '타입캐스트', 네이버 '오디오북' 등이 이런 부류,,,)

등을 이용해 학습자의 상대역으로 쓰일 것에 대해 연기분야의 교육 등이나 다양한 분야의 교육에 사용을 도울꺼 같다. 이런 수준높은 가상이지만 소셜기능이 강화되어 교육과정 이탈방지도 예상해본다.*AI 아바타 강사의 효과

a) 실제상대역 같은 수행능력으로 소셜 기능 높임

b) 실사 유명인을 가상화한 과정에서 교육과정 이탈방지률 높임

(2) 교육 콘텐츠 가상화

-

교육자체를 컴퓨터를 통해, 기계적인 요소로 가상화하다보니 게임적 특성으로의 반환으로 이어져. 교육의 흥미를 높힌다는 의견. 예를 내가 어릴 때 했던 '네이버 놀이터'?! 같은 교육기관의 엔터테인먼트 부분을 더 한 느낌이겠지. 저자는 엔씨소프의 '호두잉글리쉬' 예를 들면서 학습효과는 앞전에 얘기한 '사실기억'에 근거하여 주장을 더하였다. 내가 상상하기로는 오징어게임 같은 교육적인 대회를 열어 서바이벌 형식을 통해 선의의 경쟁?! 또한 끌어 낼 수 있지 않을까?

-

외에, 일반인들이 소홀히 했던 분야(군사, 재난/안전 등)의 훈련이 조금 더 흥미요소로 넓은시각을 가질 수 있게 되는 것에도 긍정적인 면이 있다. 이런 팬데믹 중요하면서도, 실제로 접하지 않으면 와닿지 않을 분야를 가상화 한다는 것은 거대한 효과임이 분명하다. 실제 군/경찰에게도 부상은없으며, 교육효과는 높은 교육이 필요한데, 필요충족해주는 대안임.

*교육가상화의 효과

a) 교육에 흥미도를 게임화하여 높임

b) 실습교육의 빈도가 적었던 분야를 새로운 교육적인 시각을 갖게함/자각성을 높임

c) 실제 실습이 필요한 부분을 실사화 느낌으로 구현하여 교육의 의미를 높임

d) 물리적 효과를 감각적으로 느끼지만, 실제물리적 접촉없어 부상방지 가능

(3) 스터디용 소셜 기능

- 교육분야가 메타버스로만 다 이뤄진다면 교육 집단(어린 학습자들)의 결집이 높아질꺼라 예측

(4) 학습자 특성 분석

- 학습자에게 있던 시간, 공간적인 제약으로의 변화

(5) 다양한 교육 및 훈련 주제

- '(2)'맥락의 빈도수가 적은 분야에서의 교육집중/확대

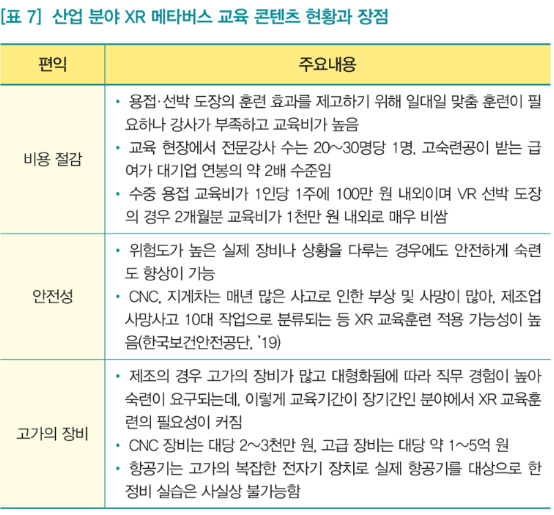

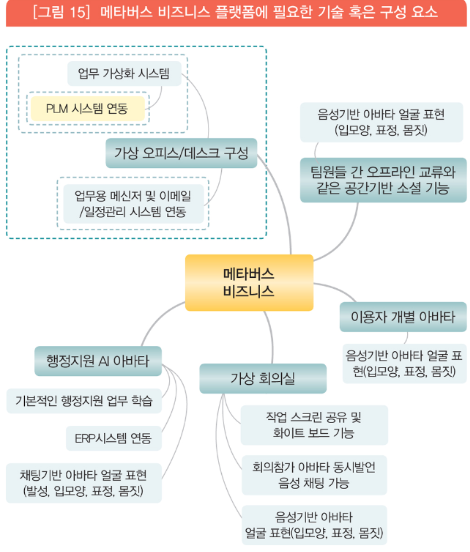

4️⃣ 기업에서의 메타버스 활용

[비즈니스 폴랫폼 구성요소]

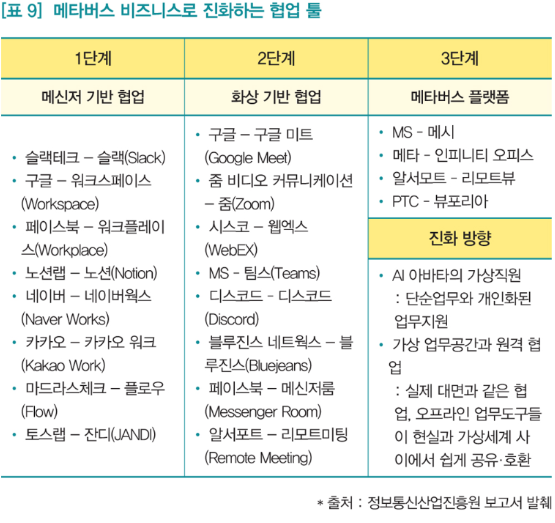

- 국내 오피스 프로그램 대표 기업으로는 한컴이 있다. 이들은 2019년 오피스 기능 관련 서비스와 콘텐츠를 제공하는 '말랑말랑 플랫폼'을 오픈하고, 2021년에는 메타버스 전문 기업인 프론티스(지능형 사물인터넷 통합관제, AR, VR 솔루션 개발)를 인수하는 등 미래의입지를 위해 고민하고 있는 듯하다. 또한, 알서포트는 원격근무 솔루션 '리모트뷰'와 화상회의 서비스 '리모트미팅'을 주축으로 메타버스 비즈니스 플랫폼을 확장하고 있다. 직방은 메타버스 오피스 툴 '메타폴리스'를 공개하여 많은 주목을 끌었다.

[협업툴의 진화 방향 예상]

5️⃣ 메타버스에서 스마트 팩토리의 역할은 무엇일까?

(1) 스마트 팩토리와 AI

- 스마트 팩토리 : 공장 내 설비와 기계에 각종 센서(카메라, 온습도 센서, 유해 가스 감지 센서 등)를 설치하고 데이터를 실시간으로 수집 및 분석하여 공장 내 상황을 일목요연하게 보고(observability). 이를 바탕으로 목적된 바에 따라 공장이 스스로를 제어하도록 자동화 함. 여기에 AI를 더해 컴퓨터 비전을 통한 정보 수집으로 판단과 제어를 가능케 하여 '데이터 기반 운영체계'를 갖춰 스마트 팩토리를 더 스마트하게 완성킴.

(2) 엔비디아와 스마트 팩토리

-

25년 전에 GPU를 선보여 지금까지 가상그래픽에 파급력을 가진 엔비디아는 데이터센터용으로 GPU를 양산하면서 시장이 더 커짐. 20년 상반기 멜라녹스와 큐물러스 네트웍스를 인수합병 뒤 '정보가상화', 'AI', '클라우드'로 눈을 돌림. 단순연산에 GPU가 CPU보다 월등한 성능이 있어, AI 개발산업에 엔비디아는 높은 사업매출을 21년기준 가져가고 있음. 엔비디아가 메타버스 플랫폼으로 발표한 '옴니버스'는 가상공간이지만 현실 속 지구에서 벌어지는 물리현상을 100% 재현해 내어 놀라움을 자아냄

-

이외 스마트 팩토리를 가동하는 기업 스웨덴 통신사 '에릭슨'이 있음. 5G전파기술 시뮬레이션으로 실제환경같은 디지털트윈으로 구현하여 최대의 전파커버가 가능한 5G 중계기 배치안 시뮬레이션 중임 그리고 판매,설치.

-

BMW도 15개국 31개 공장을 옴니버스에서 가상공장으로 구현했는데, 이후 어쨌든 생산공정 시간단축효과로 생산단계 효율이 30% 증대.

220706 |

(3) 스마트 팩토리 현황

-

앞서 말한 실시간 원격혐업, 시각기반의 디지털트윈 구현으로 최적의 제품생산을 위한 프로세스를 도출함으로써 비용 절감과 생산성 향상까지 가능한 시점.

-

국내의 경우, 물리적 현상을 가상공간의 모델로 구축한 물리엔진을 그래픽 엔진 노하우로 보유하고 있음.

-

사실, 엔비디아가 산업용 가상 시뮬레이터를 활용한 최초의 기업은 아님. (저자 생각)최초는 프랑스의 다쏘시스템이 아닐까 싶다. 분야를 자동차, 우주항공, 국방 분야 설계 및 엔지니어링 가상 AI 시뮬레이션 포지션으로 우위에 둠.

=용어정리=

*디지털트윈 : 시뮬레이션으로 장비와 설비 최적화, 물리엔진 시뮬레이션 가능. 디지털로 호환가능한 현실

6️⃣ 메타버스 속 도시는 어떤 모습일까?

(1) 스마트 시티란?

-

말그대로 편리/쾌적한 삶의 도시. 세계 공통추세 저출산, 고령화의 인구구조변화와 탄소 중립을 추구하는 친환경이 바탕된 도시.

-

2020년 스위스 경영개발대학원에서 [스마트 시티 인덱스]에서 매년 발표하는 가장 스마트한 도시로 부산과 서울이 46위, 47위에 올랐다(평가위원이나 평가항목이 정확히 어떻게 되는지는 몰라도, 세계 국가가 193개가 있다는 가정하에 도시 갯수로는 더 막대한 범위가 있다 생각되는데, 실로 놀라운 위치의 한국!). 1위 도시는 싱가포르가 차지했는데, 통합 모빌리티 서비스가 구축된 점의 이유에서라고 함.

-

2020년 우리나라 정부는 '한국판 뉴딜'내세우며, 전국 4차선 이상 도로를 3차원 디지털 지도, 자율주행, 자동차, 스마트 시티 등에 활용하겠다 발표. 이러한 열의는 '버추얼 싱가포르'를 모방하겠다는 '버추얼 전주', 전라북도 전주의 포부에서 볼 수 있다. 싱가포르를 1위 스마트 시티로 발돋움 시켜준 '다쏘시스템'과 국토정보공사가 협약해서 큰 프로젝트를 추진하고 있는 대한민국이 실로 놀라우면서 자랑스럽다.

=용어정리=

*통합모빌리티 : 전기자동차 / 전기스쿠터 공유 등 데이터기반의 경제 플랫폼 활용, 도로교통체계 등 전반적인 '틀'을 일컫음

(2) 스마트 시티 - 디지털 트윈 - 메타버스 도시 플랫폼

-

스마트 시티만으로는 메타버스라고 할 수 없음. 그러나 BIM, 디지털트윈, 통합모빌러티를 갖춘 데이터의 기반한 과정은 메타버스 도시로 바로 이어져 시뮬레이션 기반의 가상공간을 만들기 용이. 여기 산업류에 대표적 두 기업이 앞서 얘기한 다쏘 시스템(프랑스)과 오토데스크(미국)가 있음. 아래 오토데스크가 합볍한 기업들의 특성을 보면 그들의 행보가 보임

=용어정리=

*BIM : 시설물의 형상이나 속성 등을 디지털로 표현하여 정보의 통합 활용이 가능하도록 만든 디지털 모델. '스마트도시'와 '빌딩 IoT'를 말할 때 늘 거론 되는 개념.

[오토테스크의 합병기업들]

| 인수시기 | 인수기업 | 특 징 |

|---|---|---|

| 2005년 | 앨리어스 | 영화, 애니메이션 분야 컴퓨터그래픽 제작 툴 마야 |

| 2015년 | 씨컨트롤, 넷파브 | IoT클라우드 서비스 플랫폼 개발사 씨컨트롤과 산업용 적층 설계 및 제조 소프트웨어 솔루션 개발사 넷파브 |

| 2018년 | 어셈블 시스템즈, 플랜그리드 | 건설 생산성 SW 업체 |

| 2019년 | 빌딩커넥티드 | 입찰 관리 플랫폼 업체 |

7️⃣ 메타버스의 시대의 자동체이는 어떤일이 일어날까?

아래 3가지로 메타버스-자동차를 알아보자

(1) XR HUD

-

네비게이션, 스마트폰을 넘어선 가상공간실현이 구현된 길안내잡이. XR HUD에 요구되는 것들을 알아보자.(실제 장애물이 디스플레이에 표현됨)

=용어정리=

*XR HUD : 가상 시뮬레이터 Head-Up-Display[XR 요구사항]

요구사항 설 명 정보종류 주행정보 메인 표시장치, ADAS 및 네비게이션 기능 강화, 대화면 XR 구현 최소 시야 범위

(핸들윗쪽 정면주시 기준)- 상시정보표시: 눈동장의 이동 없는 각 10도 이내, 정보인지 0.2초

-유효 정보(클러스터 수준) 표시 : 눈동자 이동 있으나 머리 이동 없는 약 각 20도 이내, 정보인지 0.3초운전자의 주의 분산 최소화 - 2초 간 전방 미주시 시속 50km/h에서 28m 이동, 100km/h에서 55m 이동

- 주행 속도에 따른 전방 주시 거리 변화 필요

->다중초점면(Multi-focal plane) 혹은 가변 초점(Vari-focal plane) XR HUD 필요XR HUD FoV 정확한 네비게이션 정보 표시를 위해 최소 근거리 3차선 도로 위 표시 필요

-> HUD FoV 각 15도 이상 필요

(2) 자율 주행 시뮬레이션

-

주행거리 가상공간 구현과 SLAM을 이용한 자율주행 시뮬레이션을 살펴보자. 21년 9월 테슬라는 AI학습용 슈퍼컴퓨터 '도조'를 발표. 도조에게 각 종 물리현상과 교통상황의 특이경우를 시뮬레이션해서 자율주행의 완성도를 높이기 위해 디지털트윈 기술 접목이 필요함(이것은 스마트 팩토리 플랫폼과 동일).

=용어정리=

SLAM : 위치 측정 및 동시 지도화 명칭

도조 : 'Vision-Only'방식의 자율주행을 달성하기 위한 훈련용 AI -

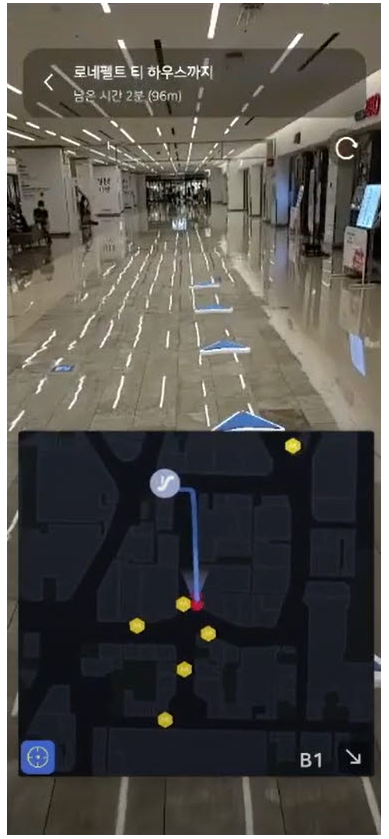

국내 기업 현대차 그룹도 2019년 스위스 '웨이레이사'와 XR HUD를 '소비자전자제품박람회'발표. 그러나 자동차 부품 공급망관리(SCM)상 티어1에서 HUD 전장 시스템과 차량 앞유리 부품 동시 납품의 대량 생산과정 구조 상용화 한계. 한계점 극복위한 '엔비직스(영국, 스타트기업)와 파트너쉽하여 과정해결중. 현대차는 또한 로봇 자율주행과 XR 네비게이션 개발을 위해 '앨리스/워렌' 이라고 불리는 실내외 AR 지도 개발에 들어가 24년 상용화예정이라 밝힘(아래뉴스링크참고).

실내외 AR/VPS 자료출처 뉴스링크

[실내외AR]

[VPS맵]

220707 |

Part 3

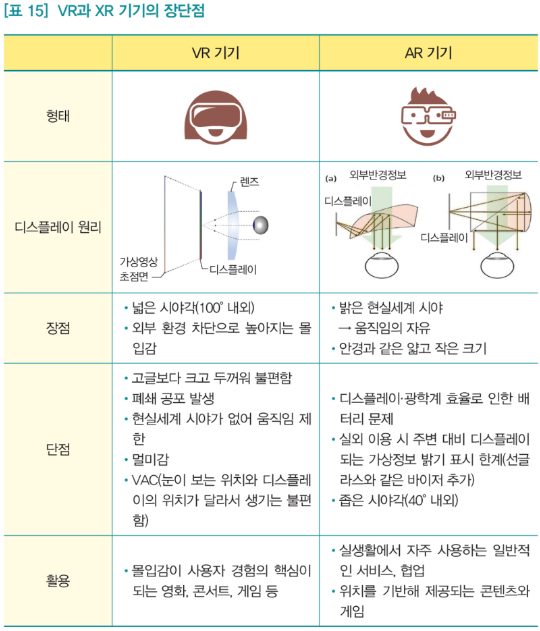

1️⃣ VR/AR 기기의 필요성 : 어떤 기기가 웨어러블 메타버스에서 더 많이 사용될까?

[빅테크 XR 하드웨어 발표시기]

-

평상시 뇌에서 처리하는 감각정보의 약 70%가 시각 정보, 약 20%는 시시각각의 강화된 청각 외 나머지 감각임. 이에 상응하여 VR/AR 기기가 메타버스사회의 적합하다 판단.

[VR 과 AR 차이점 및 장단점]

VR : 기기 외 외부시각적 자극 차단. 자세의 제약이없어 사용자 편이. 편이에 의한 오락용 기기로만 전락될 가능성

AR : 주변환경의 가상정보 투영화. 따라서 접속위치마다의 다채로움 제공

-

장단점이 상호보완적인게 있어, 두 기능을 결합한 기술 개발중. 대표적인 예가 메타(페이스북)의 '오큘러스 퀘스트2'로 VR중심인것 같지만, 전면카메라에는 AR기능 제공, 중국의 엔리얼또한 부착형으로 두 기능 제공함. 두 기능이 자연스레 전환위한 방식의 연구가 흥미로운데, 조명에 따른 렌즈의 변색을 유도한 일반렌즈, 버튼으로 변색조절 하는 '전기선막' 방식 두가지가 있음. 차이점을 보면 일반은 변색속도가 느리고 전기선막은 소비전력이 커서 배터리에 영향을 준다는 견해가 있음.

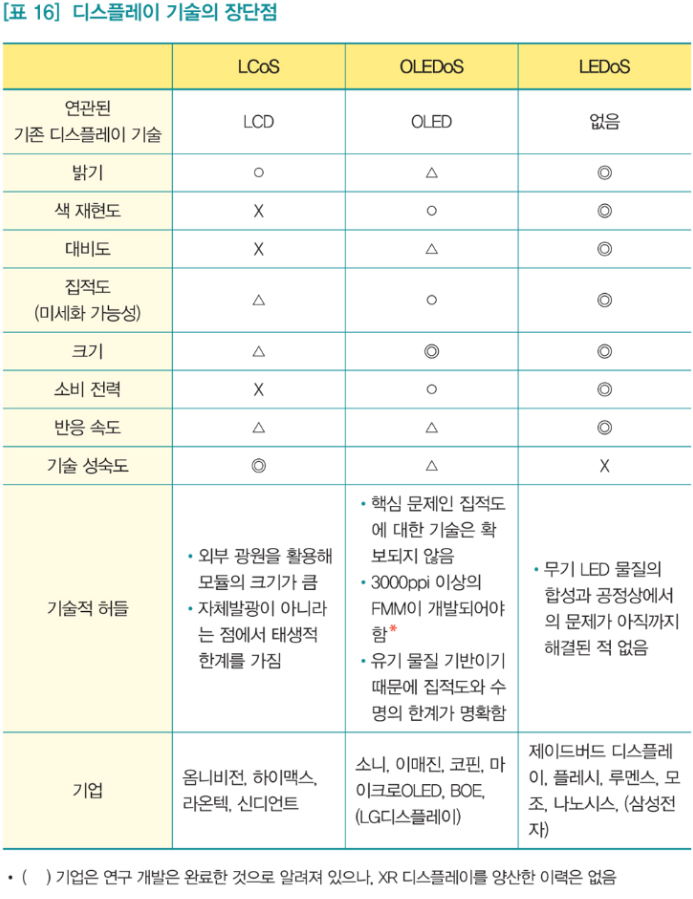

2️⃣ 마이크로 디스플레이 : 작고 가벼운 XR기기를 위해 디스플레이는 어떻게 진화해야 할까?

-

안경형 기기에서 사용되는 마이크로 디스플레이의 크기는 보통 1인치(약 2.54cm)라고 하는데, 디자인을 고려해 볼때 0.5인치 이하가 적합하다 저자는 말함. FHD(1920x1080) 해상도 구현을 위해, 1인치 디스플레이라 하더라도 픽셀 하나의 크기가 10마이크로미터 이하로 작아져야 하기 때문에 기술한계가 있는 시점임.

-

문제점 해결에 LCos(Liquid Crystal on Silicon), OLEDoS(OLED on Silicon), LEDoS(LED on Silicon) 세 가지로 좁혀 개발중. 이유는 집적도가 확보된 실리콘 반도체 공정을 활용해서임(아래표 참고).외 LBS(Laser Beam Sacnner), MEMS(Micro Electro Mechanical System)도 있지만 디스플레이가 아니라 기술소개만 한다.

=용어정리=

LBS : 레이저에 나온 빛을 빠르게 각도를 바꾸는 작은 거울로 스캔해서 전체 화면을 만드는 기술

MEMS : 작은 거울을 빠르게 회전시키는 시스템. 부피도 크고 매 순간 오차 보정을 위한 센서가 필요해 소모전력 큼

[디스플레이 기술의 장단점]

(1) 어떻게 LED 물질을 만들어 구동회로와 결합할 것인가?

-

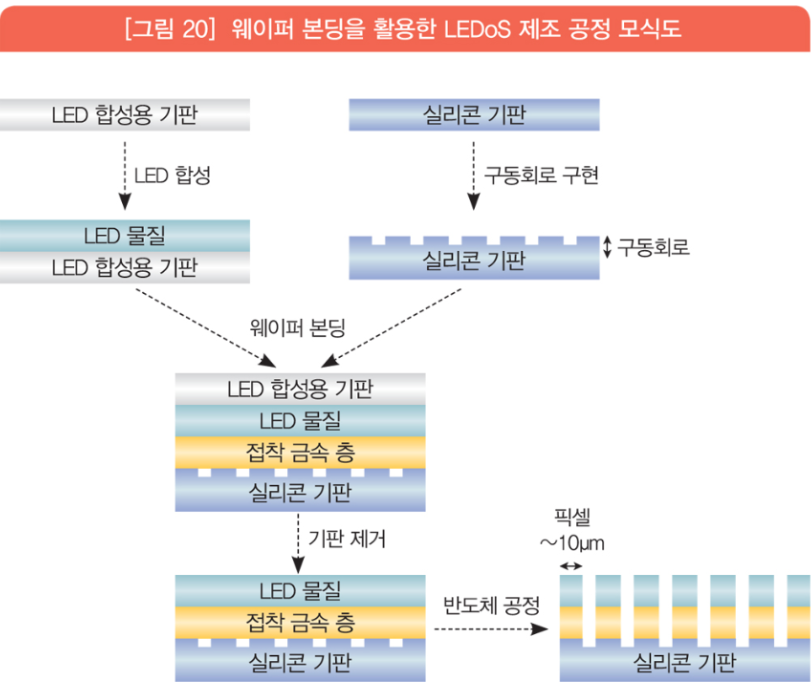

LEDoS는 자체 발광하고 실리콘 반도체 공정을 활용할 수 있어 집적도도 1마이크로미터 보다 작은 수준까지 가능한 시점임. LEDoS 무기물 발광 물질의 합성온도가 750°C 수준이라 실리콘 기판 위에 준비된 구동회로보다 견딜 수 있는 온도가 훨씬 높음(구동회로 선설계 X, CMOS 회로는 통상 200~300°C). 이에 다른기판 위에 LED 물질 증착 뒤, 실리콘 기판에 옮기는 웨이퍼 본딩 방식을 통해 제조 공정을 극복 구현함(아래 모식도 참고)

-

LED의 기판교체에서 LED손상이 따르므로, 기존의 실리콘 위에 LED를 바로 증착시키는 방법으로 다시 돌아가 연구함.(영궁의 플레시, 프랑스 알레디아, 삼성전자가 기술개발 성공)

(2) 어떻게 RGB를 구현할 것인가?

a) 색깔별 패널을 광학적 방법으로 합치기

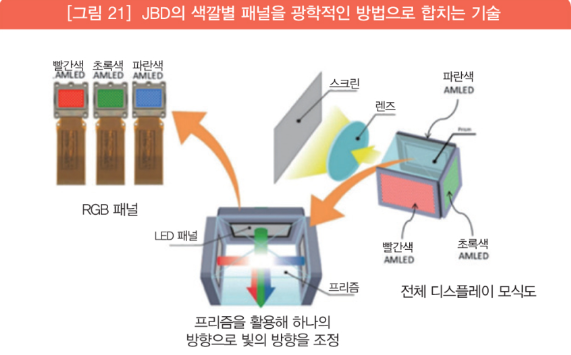

샤오미의 JBD 방식을 주로따름(그림참고)

b) 하나의 기판에 성장시키기

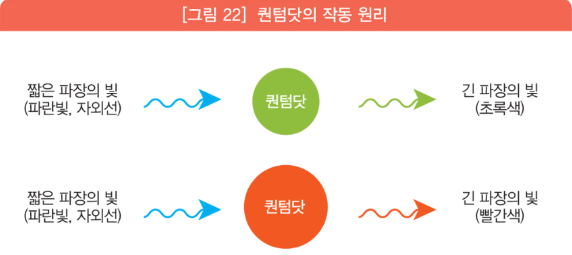

c) 퀀덤닷을 비롯한 광변환 물질 사용(그림참고)

퀀덤닷은, '짧은 파장의 빛을 흡수해 긴 파장의 빛을 방출하는 발광체'임. 파란빛을 발광하는 LED물질만 증착해도 RGB 모두 구현가능(자외선에서 초록색과 빨간색을 발광할 수 있기떄문).

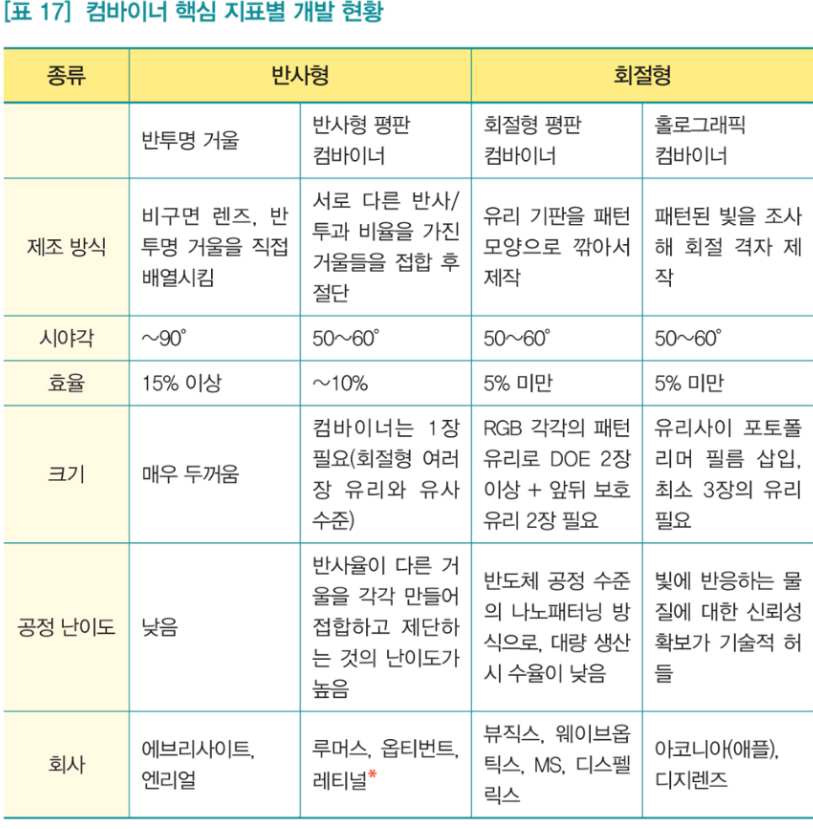

3️⃣ 컴바이너 : 안경처럼 투명한 기기가 어떻게 디스플레이를 눈에 보이게 할까?

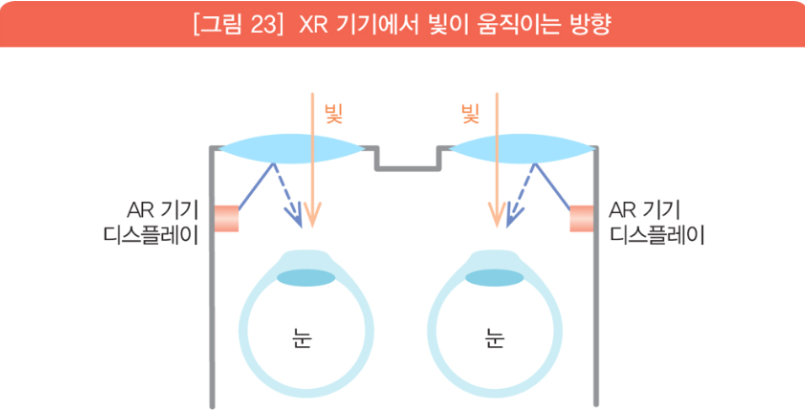

- 아래그림에서 빛이 나오는방향(파란색 화살표)과 외부의 빛이 눈에 들어오는 방향(빨간색 화살표)이 다름. 그래서 외부의 빛과 디스플레이에서 전달되는 빛을 합성하고 눈으로 보내주는 광학부품(렌즈)이 필요.

-

컴바이너 : XR기기의 렌즈는 시력 교정용 안경 렌즈와 다르게 특수한 구조로 제작되어 우리 눈에 외부 광(풍경) 외에도 디스플레이 광을 함께 전달하는 과정의 광학계를 일컫음. 핵심지표 4가지(시야각, 효율, 크기, 생산성)로 축약함.

a) 시야각 : 몰입감과 움직임의 자유동와 직겸됨

b) 아이박스 : 눈에 비춰지는 그림의 크기 의미. 아이박스 확장해 시야넓힘.

c) 효율 : 디스플레이에서 나온 빛이 얼마나 많이 사용자의 눈에 전달되는지 의미. 배터리 지속시간과 용량이 중점.

d) 크기와 무게 : 심미성 및 편리성과 관계가 있다.

e) 생산성 : 만들기 쉬워야하고 양산하는 것이 어려운 컴바이너는 XR글라스의 가격을 높이게됨 -

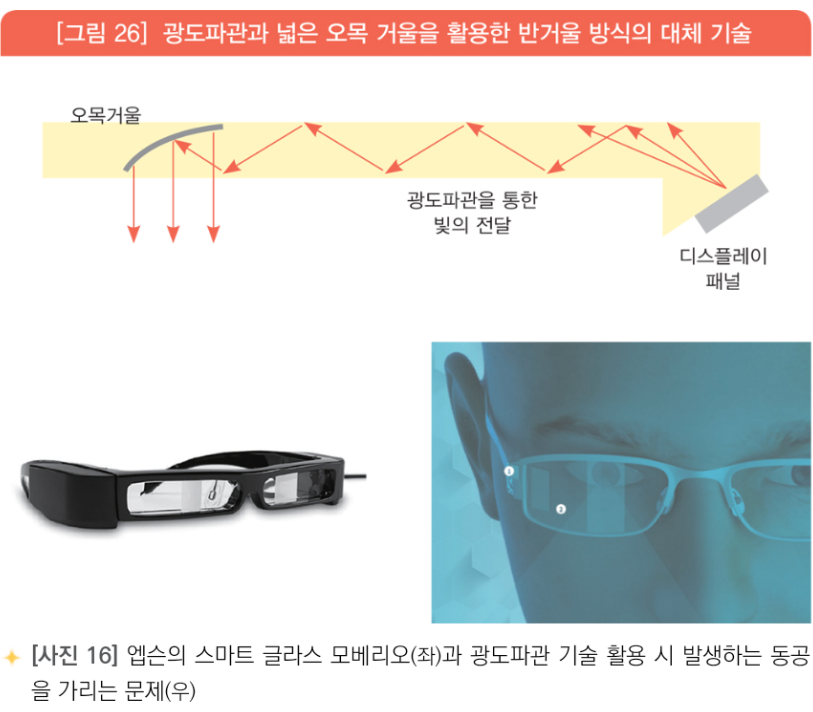

컴바이너의 큰 아이박스의 문제를 해결하기 위해, 통신용 광 케이블과 같은 원리의 광도파관를 활용하는 방법이 개발됨. 디스를레이에서 나온 빛을 XR 기기의 유리에 가두고 오목 거울을 활용해서 눈으로 빛을 전달하여 문제를 해결. 여기서의 아이박스는 좌우뱡향은 넓힐 수 있지만, 위아래로는 확장이 어려워 저가의 솔루션으로 이용되고 있음(오목거울과 광도파관 기술).

-

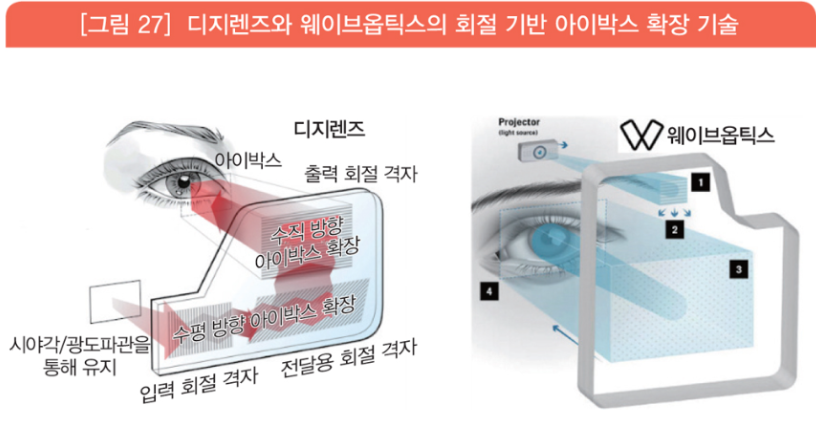

'회절'방식을 이용한 컴바이너. 무지개빛문제(무아레 Moire)가 있지만, 동공을 가리는 문제해결. 시약각과 효율의 증대를 만듦

-

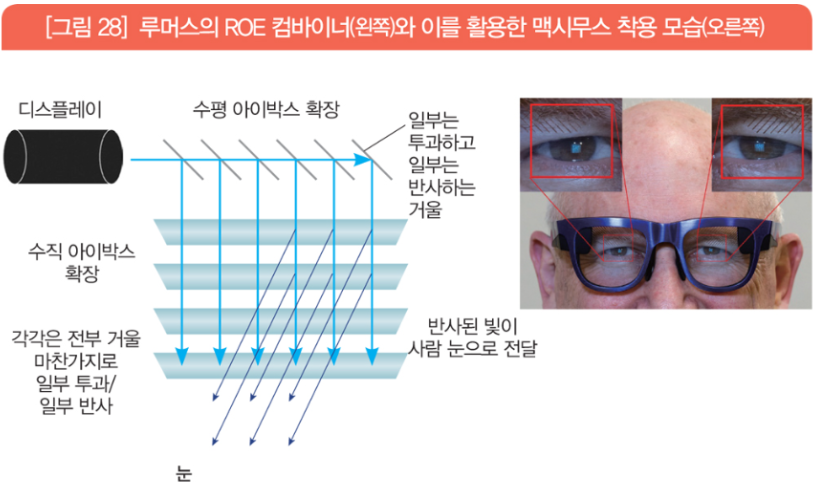

21년 5월 이스라엘 스타트업 '루머스'는 거울을 여러 조각으로 나누어서 배열하는 형태로 아주 얇은 반사형 컴바이너 개발함. 'ROE(Reflective Optical Element)'방식이라 함. 기존 회절 방식에서 10배 가까운 효율개선. 그러나, 빛이 눈으로 전달되는 모든 위치에서 동일한 밝기를 제공하기 위해서는 각 거울이 서로 다른 투과/반사 비율을 가져야 함. 아래 그림에서의 컴바이너는 오른쪽 아래로 내려갈수록 점점 빛의 세기가 감소함.

-

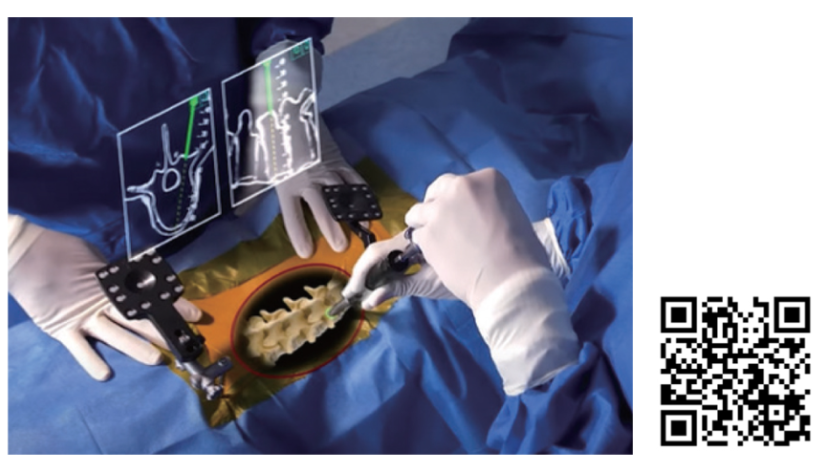

일반인 구매자 타깃이 아닌, 디자인을 포기하더라도 증강현실의 효과를 톡톡히 볼 수 이는 국방, 제조(스마트팩토리) 등의 분야에서는 이미 본격적으로 XR기기를 도입함. MS의 '홀로렌즈'를 공급한 국방은 물론이거니와 제조쪽으로는 방산업체 록히드 마틴, 항공업체 에어버스 및 보잉, 자동차 업체 BMW 등 활용되는중임. 의료분야에서는 어그메딕스의 '엑스비전'XR을 활용해 환부에 정확한 시술 부위를 투영화시켜 수술성공률도 높이고 수술설계도 실시간 확인 가능하여 수술시간도 줄일 수 있음.

[엑스비전을 활용한 수술과정 QR로확인가능)

- 국내에서는 스타트업 '피앤씨솔루션'이 반사형 컴바이너 기반의 XR을 국방, 제조, 의료로 각 분야의 국내빅테크회사들과 협업시도를 해나가고 있다.

220708 |

4️⃣ 인터페이스 : 웨어러블 메타버스 속에서는 어떻게 소통할까?

소통의 종류

a) 컴퓨터의 기능 수행을 위한 명령

- '복사하기'명령은 키도드 'Ctrl+C'를 눌러 전달 할 수 있다. 이처럼 컴퓨터에게 특정한 기능을 요청하는 소통이 첫번째이다.

b) 메타버스 속 NPC와의 대화

- Ai를 기반으로 한 NPC(특정한대화, 자의식, 감정적대화 등)

c) 메타버스 속 다른 사용자와의 대화

- 통화선넘어 현실감있는 공간감, 몰입감을 줌

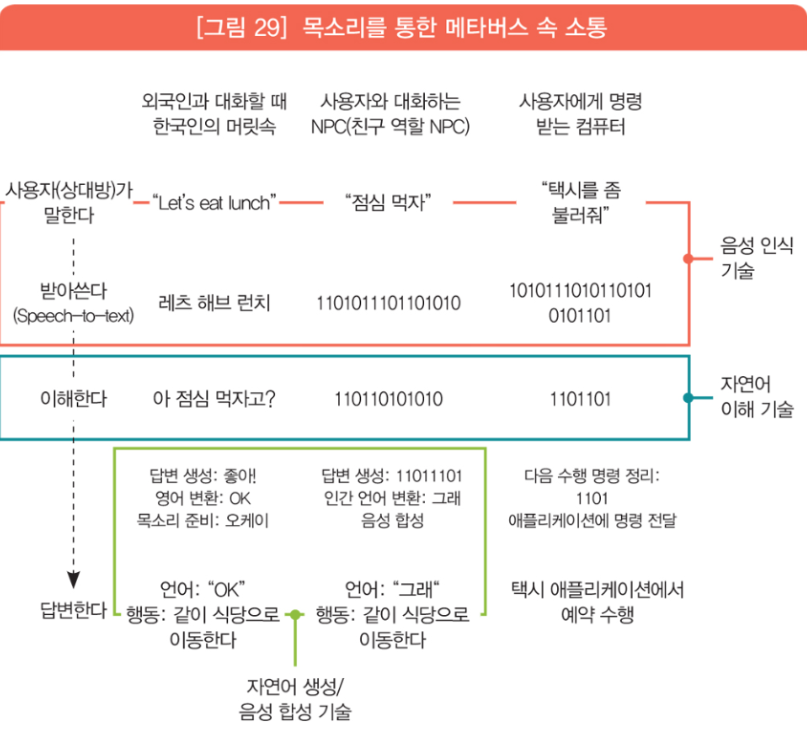

(1) 목소리를 활용한 언어적인 표현 전달 : 대화형 AI 기술

- 소통에서 인간이 가장 많이 사용하는 매체는 목소리. 컴퓨터가 인간의 언어를 처리하는 방식은 한국인이 영어나 중국어 등의 외국어를 배우는 방식과 유사.

1단계 : 음성인식(그림참고)

2단계 : 자연어 이해

컴퓨터는 텍스트를 숫자의 나열로 받아들이기 때문에 인간의 언어를 쉽게 이해 못함. 그러나 방대한 양의 데이터 기반으로 복잡한 언어 AI모델을 훈련에 성공한 사례에, 구글의 버트(BERT0)가 있음. 오픈AI의 GPT-3모델과 같은 트랜스포머 기반의 언어모델은 자연어 이해영역을 AI가 해소/해결해주고 있음.3단계 : 자연어 생성/음성 합성

컴퓨터가 직접언어를 만들어 냄. 대화형 AI가 가지는 가장 큰 문제점 및 어려움. 그 이유에는 앞서 말한 방대한 양의 데이터가 사람들의 대화를 기록한 데이터가 아니라 AI 답변의 능력은 어려운 것. 이를 해결하고 있는 국내기업 스캐터랩은 AI'이루다'를 개발하여, 인간과 유사한 수준의 감정적 소통을 가능케 함(비속어를 제외한 훈련으로 유저들의 불편한 말에는 대응이 힘듦). 인간이 아니라고 도덕적 잣대가 무너지는거에 대하여 깊이 반성하고 고려해 봐야할 문제로 대두됨. 이와 다르게 성공적인해외 대화형 AI사레에는 구글의 LaMDA가 있음.

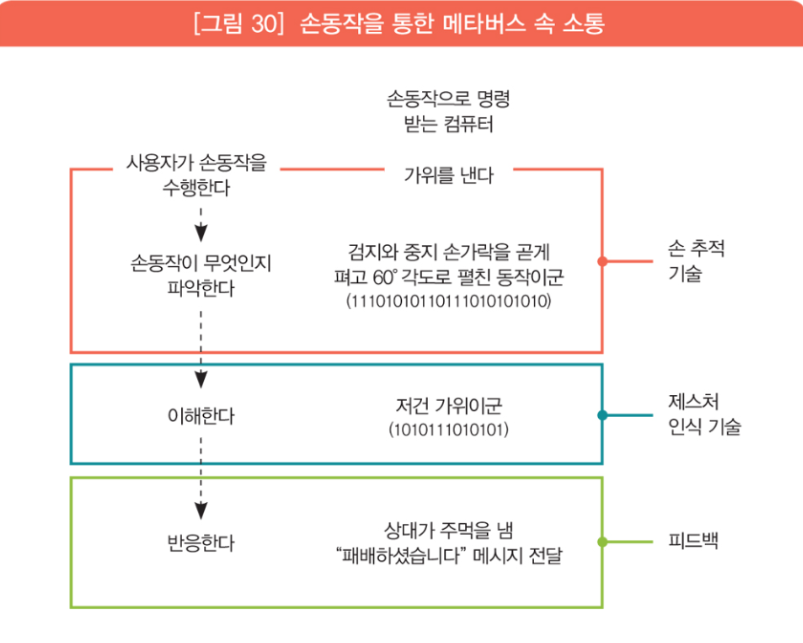

(2) 입체적인 손동작을 활용한 소통 : 손 추적 기술과 제스처 인식 기술

- 목소리에 대체되는 손을 활용해도 소통하는 대화형 AI가 거치는 단계와 유사하게 소통 할 수 있음.

1단계 : 손추적

주로 관성 측정장치 IMU(Inertial Measurement Unit) 센서를 손가락, 관절, 손바닥 위치에 부착하여 손의 움직임 추적. 관성 측정장치는 일상쓰임에 어려워 이미지 센서를 활용한 방법이 나왔지만, 문제가 많다(손의 움직임이 센서의 측정범위 초과, 손의 모든 움직임 파악 오류, 데이더가 큼, 사용자들의 생김새가 다른 손의 움직임 포착을 위한 연산과정이 무거움 등 등 ). 그래서 새로운 아이디어로 손목의 신경과 근육에서 발생하는 전기 신호로 손의 움직임 파악(이러한 방식을 BCI-Brain Computer Interface라고 함)

2단계 : 제스처 인식

예를 들면, 검지와 중지를 60도 각도로 곧게 펴고 나머지 세 손가락을 모으는 움직임을 감지했다면 '가위'로 인식해야 하는 과정을 일컫음. 이러한 제스처가 인식된다면 XR기기의 실물적인 부피나 구성품이 더해지지 않고 편의를 제공하게 됨

3단계 : 피드백 대화형

다시 한번 예를 들어, 사용자가 가위를 냈고, 상대방이 주먹을 내면, 메타버스상에서는 '사용자의 패배'를 알려줘야하는 과정을 말함.

(3) 비언어적 표현과 몸짓의 활용 : 아바타 기술

- Part 2, 3장에 기술 참조

5️⃣ 공간 매핑과 장면이해 : 메타버스 속 반려견이 소파에 앉아 있게 하려면?

(1) 공간 매핑 기술

-

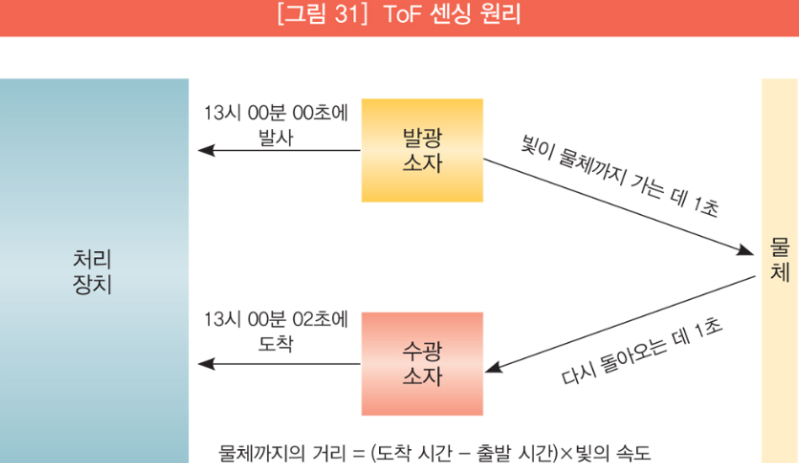

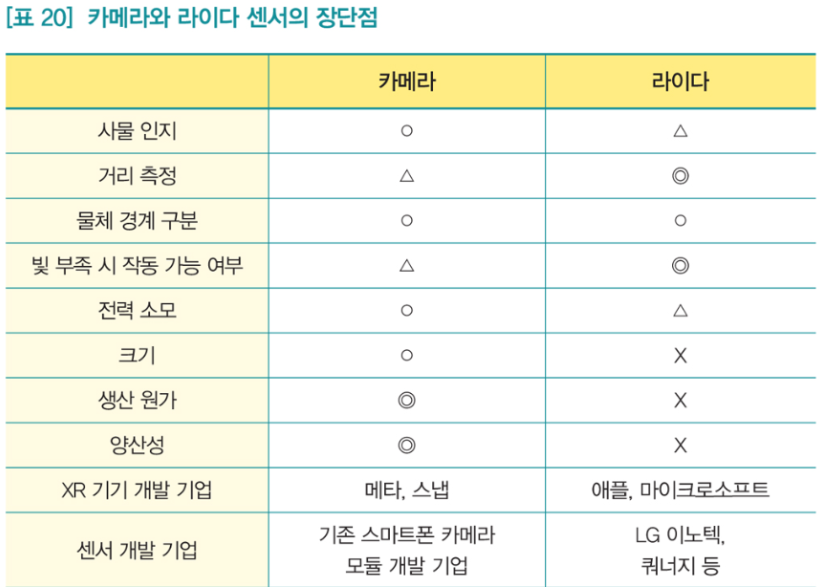

주변 공간의 '본을 뜨는 기술'이라 생각하자. 공간 매핑을 구현하기 위해서는 주변공간의 정보를 수집하는 센서가 필요한데 카메라와 라이다가 크게 쓰임. 여러대의 카메라를 쓰면 공간을 3차원으로 인식시킬 수 있는데, 카메라에 기반한 매핑 기술구현을 위해 메타(페이스북)는 20년 9월부터 '프로젝트 아리아'라는 개발을 수행중임.

흑표범 XR 비디오 링크 -

라이다 센서는 아래 그림과 같이 빛을 보내고, 벽이나 물체 등에 맞고 반사되어 돌아오는 빛을 감지해, ToF(Time of Flight) 센싱 기술을 활용해 3차원 공간을 재구성함(구글의 웨이모, GM 크루즈에서 사용). 라이다 개발업체 쿼너지는 라이다의 크기를 줄여 소형 IoT기기를 위한 라이다를 제공 하리라 예측해 봄.

[카메라와 라이다 센서의 장단점]

(2) 장면 이해 기술

- 준비된 본에 '색칠'작업이라 보자. 2차원 사진 속의 물체가 무엇인지 분류하는 간단한 작업은 2015년부터 AI가 인간의 수준을 넘음. MS는 자사가 직접 개발한 장면 이해 기술을 개발자 도구로 제공하며, 구글은 3차원 공간에서 장면 이해를 돕는 텐서플로우 기반 알고리즘을 개발하여 오픈소싱중임. AI가 분석하는 장면은 막대한 데이터 크기떄문에 3차원 포인트 클라우드와 서버로 네트워크를 통해 주고받는 시간이 길어짐.

데이터의 크기로 인한 네트워킹 문제해결방법

방법 1 ) 에지클라우드

: 중앙 서버와 사용자 가운데에서 프로그램의 수행 시간을 단축할 수 있도록 구축된 중소 규모의 서버를 의미.

방법 2 ) AI용 반도체

: AR/VR 등의 사용자 기기에서 AI 연산이 가능하도록 관련 연산에 최적화된 반도체(AI Accelerator). 인텔에서는 VPU(Vision Processing Unit) 새로운 반도체 칩 개발. 구글은 TPU(Tensor Processing Unit)기반으로 코럴(Coral) 반도체 칩 개발.

방법 3 ) 미리 그려놓은 3차원 지도

: 메타는 누군가 같은 장소에서 매핑해놓은 3차원 지도를 다운로드해서 사용하는 방법 고려중(라이브 맵스-LiveMaps)-> 이게 '프로젝트 아리아'로 이어져 실험중

메타의 오큘러스-라이브맵 구동 URL

6️⃣ 컴퓨터 그래픽 : 현실처럼 느껴지는 가상 콘텐츠를 만들 수 있을까?

그래픽 전달을 위한 필요 요소

a) 그래픽 디자인

: 플립북 애니메이션에서 그림을 그리는 과정. 사람이 달려가는 모습을 보여주고자 할 때에는 팔과 다리가 적당히 움직인 상태로 전체 몸은 아주 조금 앞으로 나아간 그림을 그려야한다. 프레임들마다 노동 집약적 작업

b) 물리엔진

: 위에 움직임을 짧은 시간에 자연스럽게 연출하기 위함. 현실세계의 물리 법칙을 따라 프레임을 자동으로 그릴 수 있게 됨.

c) 렌더링

: 평면화 그래픽의 아쉬움을 없애고 3차원 그래픽을 고안해내고, 가상공간에 3차원그래픽을 그려 자신들이 원하는 시점에서 사진을 찍어 하나의 프레임을 완성하는 방법을 개발함. 이렇게 가상의 공간에서 찍은 사진이 현실 세계 속 빛의 움직임에 기반해 촬영될 수 있도록 하는 것이 렌더링.

(1) 빛을 추적하는 기술의 발전 - 렌더링의 정확성 확보

- 렌더링과정은 수많은 빛의 움직임을 가상공간에서 역으로 계산하여, 픽셀 하나하나의 색깔을 결정하는 과정. 실제 빛의 움직임과 가상공간에서 역산한 빛의 움직임이 비슷할수록 우리는 현실과 구분해내기 힘든 그래픽을 즐길수 있음. 하지만 빛의 움직임을 역산하기위해 많은 근사와 적분과정이 필요함. 더구나 많은 시간과 에너지도 소모됨. 이래서 '실시간 렌더링(Real-time Rendering)'이 중요하게 언급됨.

렌더링교육위한 칸아카데미 강의 URL 10분내외

-

그래픽 회사 에픽게임즈의 언리얼 엔진과 유니티의 유니티 엔진 중 많은 사람이 언리얼 엔진을 더 높게 평가하는데, 빛을 추적하는 기술(Ray Tracing)에 보다 많은 개발과 투자를 에픽게임즈가 해온 것으로 보임. 21년 5월 에픽게임즈는 '루멘(Lumen)'을 공개해, 많은 사람의 의견을 입증함. 이에 맞서 뒤쳐지지 않기 위해 유니티는 21년 11월 타 그래픽개발회사 '웨타 디지털'을 인수하며 SF 영화 '아바타', '혹성탈출', '이터널스'의 시각 효과를 담당하며 자존심 회복함.

-

엔비디아는 GPU RTX 시리즈가 실시간 빛 추적에 최적화된 세계 최초의 하드웨어임(나도 RTX 시리즈 3060쓰는중 TMI). 아래 게임 속 이미지의 빛 추적기술로 물의 반사된 이미지를 연출하는 그래픽을 느껴보아라. 감탄 밖에 안나옴ㅜㅜ

(2) 물리엔진의 발전 - 움직임의 자연스러움 확보

-

엔비디아의 '피즈엑스(PhysX)'가 세계 최고수준임. 띠라서 언리얼과 유니티도 기본옵션으로 채택하는거임. 성능좋은 물리엔진 기반으로 옴니버스 개발(Part 2, 5장 참고).

-

국내에서는 게임사 펄어비스가 독자적인 엔진 개발함. 따라서 공용엔진보다 훨씬 가볍고, 효율적임. 향후 독특하고 유니크한 사용자 경험이 제공될꺼라 기대해봄.

(3) GPU와 알고리즘 - 렌더링 속도 확보

- 정확성만큼 중요한 것이 속도. PC 및 서버 GPU 시장은 엔비디아와 함께 인텔, AMD가 과점하고 있고, 모바일 GPU 시장은 퀄컴과 암(Arm)이 과점. GPU와 더불어 알고리즘을 활용해 렌더링 속도를 높이는 방법이 개발중임. 엔진5의 핵심 기술 나나이트(Nanite)는 사용자가 구별하기 힘든 수준의 미세한 그래픽 유닛을 하나로 뭉치는 방법으로 연산을 최소화하고, 저장장치인 SSD(Solid State Device)의 데이터를 GPU에 실시간 스트리밍하는 방법을 통해 혁신적으로 렌더링 시간을 줄이는데 성공함. 아래 언리얼 엔진5의 영상가이드에서 사물로 표현되는 삼각형의 구현체를 '폴리곤(polygon)'이라 하는데, 많은수록 연산량이 많아져 끊김 현상 발생. 그러나 사물 표현을 매끄럽게, 필요한만큼의 폴리곤을 넣어 최적화 시켜 렌더링 속도를 확보함.

언리얼 엔진5의 게임영상 리뷰 URL

7️⃣ 에지 클라우드 : 수백만명이 동시에 접속하는 메타버스 세계를 매끄럽게 운영하려면?

-

나도 재밌게 본 영화인데 레디 플레이어 원(메인예고편 URL)에서의 '오아시스'가 우리가 바라는 메타버스 모습이 아닐 듯 싶다. 수백만명이 접속해서 끊김이 없게 하려면, 그것도 전 세계인이 동시번역과 더불어 함께 소통하는 그런모습을 위해서는 어마마한 서버와 알고리즘이 필요할 것임.

-

병렬 처리 기술을 효율적으로 구현하기 위한 핵심 인프라가 '에지 클라우드'임. 중앙 서버로 모이는 트래픽을 분산해서 처리하여, 사용자들이 더욱 빠르게 서비스를 활용 할 수 있도록 도와줌. 또한 데이터 트래픽을 분산시켜줄 뿐만 아니라 연산에도 집중함. 자연히 그래픽이 보다 정교해지면 데이터가 커지고, 자연스럽게 이 데이터를 처리하는 데 필요한 연산의 양도 많아지는데 아직까지는 사용자 기기에서 처리하기에는 현시점에 반도체 기술이 충분하지 않은 상태이기때문에 에지 클라우드에서 연산을 도와주는 구조가 나오게 된거임. 최근에는 '멀티 액세스 에지 클라우드(Multi-access Edge Cloud, MEC)'의 개념이 소개되어, 사용자 기기가 위치에 기반하여 가장 가까운 에지 클라우드 유동적인 연결성을 가지는 시스템이 이야기 됨. 이에 따른, 통신사의 역할도 급부상함. 에지 클라우드 생태계에서 4개의 그룹을 알아보자.

그룹 1) 통신사

: MEC가 메타버스, 자율주행과 함께 핵심 기술로 부상하면서 지속적으로 연결성을 제공할 수 있는 통신사 역할이 강조됨. 최근에는 통신사의 기지국과 에지 클라우드를 결합하는 방식이 의미있게 논의중임.

그룹 2) 거대 클라우드 기업

: 클라우드 서비스를 제공하는 거대 기업은 중앙서버 역할.

그룹 3) 중소 규모의 로컬 데이터 센터 및 콜로케이션 기업

: 중소 규모의 로컬 데이터센터와 콜로케이션 기업은 중앙 서버보다 사용자와 가까운 위치에 서버를 구축하는 역할을 수행해오는 점에서 에지 클라우드와 가장 유사한 사업을 영위했던 기업들임.

같은 수의 프로세서를 활용해도 배치와 연결 기술에 따라서 수행 할 수 있는 연산의 능력과 소모에너지의 양이 판이하게 달라지기 때문에 서버를 구축하는 경험은 굉장히 중요함. 그래서 이전에 기업들의 노하우인 GPU, CPU를 비롯한 컴퓨팅 리소스의 배치 기술, 발생하는 열을 효과적으로 식히는 방법 등을 통해 에지 클라우드 구축에 필요한 비용한 최소화 할 수 있음.

그룹 4) 반도체 및 통신 장비 개발 기업

: 에지 클라우드가 보다 핵심적인 인프라로서 역할을 하는 과정에서 CPU, GPU, DRAM, NAND 등에 대한 수요는 필연적으로 증가 할 것임. 따라서 반도체 제조 공급망 전반에도 투자 기회가 생길 것. 이에 대한의견은 SK증권 김영우 애널리스트의 [반도체 투자 전쟁]을 추천.

8️⃣ 미래 인터페이스 (1)촉각 : 메타버스 속 가상의 물체를 만질 수 있을까?

- 메타버스 속 물체를 실제로 만질 수 있도록 하는 것을 '햅틱(Haptic)'기술이라 함. 햅틱은 촉각을 위한 디스플레이라 정의. 시각 디스플레이와는 달리 촉각은 기계적인 신호부터 열적인 변화, 화학적 신호에 이르는 자극원을 지니고 있어 기본적인 구현 난이도가 높음.

(1) 손을 제외한 신체 부위를 대상으로 한 햅틱 기술

- 손을 제외한 몸통, 다리, 팔 등 다른 신체 부위를 대상으로 한 햅틱 슈트가 개발중임. 실제 현장의 훈련체험용 등 특수응용분야에서 촉각의 보조적인 부분으로 활용성이 있을 것. 가장 각광 받고 있는 회사인 영국의 '테슬라수트'가 전신햅틱 슈트를 개발해, 온도 제어, 생체 신호 수집, 모션 캡쳐를 통한 사용자 움직임 분석까지 가능함. 그래서 이미 앞서 말한 특수응용분야에서 활용되고 있는 중. 국내에서는 '비햅틱스'가 조끼 모양의 상반신용 햅틱 슈트를 개발해 판매중.

테슬라수트의 햅틱슈트]

비햅틱스의 햅틱슈트]

(2) 손을 위한 햅틱 기술

테슬라수트의 글러브

메타 리얼리티 랩스의 햅틱 장갑 프로토타입

메타 리얼리티 랩스의 햅틱 피드백 실험

메타 리얼리티 주커버그의 햅틱장갑 시현 링크

HaptX의 햅틱글러브 시현 링크

- 테슬라수트의 글러브가 울버린을 연상시킨다. 리얼리티 랩스의 햅틱 피드백은 가상공간의 공이 떨어졌는데, 손가락에 부딧히는 반응을 준다. 메타(페이스북)에 따르면 현재의 기계적 방식으로 움직이는 딱딱한 액츄에이터는 많은 양의 열을 발산하고, 밀도가 높아지면 장갑 자체가 굉장히 무거워지기 때문에 실감나는 촉각을 구현하기 여려움. 단점보완에 맞춰 부드러운 고분자 소재와 미세유체공학을 응용해 굉장히 빠른 속도로 반응하는 유연한 액츄에이터를 개발함. 메타의 햅틱장갑 시현영상을 보면 액츄에이터를 효과적으로 구동하기위해 반도체 회로까지 구현한 걸 살펴볼 수 있음.

9️⃣ 미래 인터페이스(2) 두뇌 : 일론 머스크의 '뉴럴링크'처럼 될수 있을까?

*뉴럴링크의 활용분야 링크

*원숭이뇌에 칩셋을 심은 뉴럴링크 실험영상 링크

-

사람의 신경 신호는 전하를 띤 이온의 움직임을 통해 전달되기 때문에, 정보가 전달될 때 전류 혹은 전압 펄스가 생김. 하지만 인간 두뇌에 있는 수십억 개의 뉴런에서 신호를 측정하는 일은 현실적으로 불가능함. 그럼에도 연구하고 연구한끝에 과학자들과 의사들이 두피를 통해서 두뇌에서 발생하는 전기 신호를 측정할 수 있다는 것을 알아냄(미쳤다;;). 그 전위 변화를 기록한 것이 바로'뇌파(Electronephalogram, EEG)'. 이를 활용해 테슬라 CEO 일론머스크가 주도한 실험이 원숭이 뉴럴링크 실험임(위에 링크참조). 여기서보면 두뇌에서 발생하는 정보 혹은 생각을 컴퓨터와의 소통에 활용하는 개념을 '두뇌-컴퓨터 인터페이스(BCI)'라 함(앞서 Part3, 4장). 이 새로운 개념을 왜 메타버스에서 이야기하냐면, XR기기의 번거로움을 대처하기?! 위함이랄까. 그러나 원숭이 뉴럴링크 실험은 사회적이슈로는 큰파장이 아니라 성공했다지만, 사람의 두개골을 열어 무선 인터넷칩셋을 연결하는 것은 현시대에는 아직 법적조치와 도덕적개념이 잡히지 않았음. 그럼에도 이 개념은 상당한 엘리트로만 이뤄져 가는 미래시대의 필요한 연구과제라 봄.

-

메타는 두뇌칩 실험외에도 2019년 컨트롤랩스를 인수해 손목시계 형태의 에어러블 디바이스를 활용해 손목에서 발생하는 전기 신호를 수집해 손의 움직임을 정확하게 추적하는 기술개발 성공함(메타의 웨어러블 손목밴드 실험영상).

1️⃣0️⃣ 미래 디스플레이 : XR 글라스를 착용하면 [스타워즈] 레아 공주의 홀로그램이 보일까?

(1) 홀로그램이란?

-

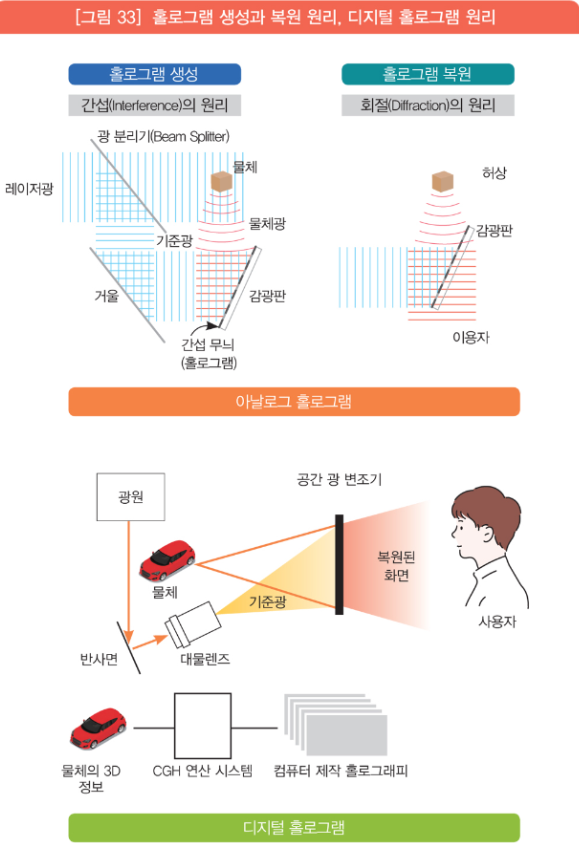

홀로그램의 어원은 'holo(완전함, 전체)'와 'gram(정보)'의 결합어라고 함. 일반적으로는 우리가 사물을 인식하는데 사용하는 빛의 정보를 담아, 공간에 놓인 물체를 보는 것 같은 착각을 불러일으키는 영상이라고 사전정의를 함. 홀로그램의 초기 시험은 1947년, 데니스 가보르가 빛의 간섭현상을 이용해 입체 정보를 기록하고 재생하는 방법(홀로그래피)에서 시작됨. 이러한 입체정보를 기록하고 재생하는 걸 통해 일상에서는 위조나 변조를 방지하기 위한 인쇄물에서 볼 수 있음.

-

현 시점 대표적인 유사 홀로그램으로는 홀로그램 팬과 플로팅 홀로그램이 있음. 홀로그램 팬은 촘촘히 박히 LED바를 빠르게 회전시켜 뒷배경과 함께 LED 잔상을 보여주는 것이고, 플로팅 홀로그램은 XR 글라스의 반투명 거울과 같이 빛의 일부는 반사하고 일부는 투과시켜 이미지가 허공에 떠있는 효과를 만든 기술임.

(2) 홀로그램과 3D 영상의 관계

-

3차원(3D) 영상과 입체영상에는 어떤차이가 있을까? 3D영상은 3차원으로 인식되는 모든 영상이며, 홀로그램은 3D 영상 구현 방법 중 가장 완벽에 가까운 방법임. 이말은 즉슨, XR글라스가 3차원 영상을 보여 주더라도 홀로그램이 아닐 확률이 높다는 것.

-

양쪽 눈에 다른 정보를 보여주는 방법(입체감을 보여줌)을 '양안 시차 방식(stereoscopy)'라 부름. 이러한 방법을 이용한 XR기기는 아직까지 장시간 착용/사용하면 두통이 발생.

(3) 홀로그래픽 디스플레이

- 위 그림은 홀로그램의 원리를 보여줌. 먼저 빛을 2개의 경로로 분리 후, 피사체에 직접 비춰져 반사된 물체광과 거울에 반사된 기준광이 서로 간섭하여 만들어진 무늬를 사진 감광판에 기록함. 간섭패턴이 기록된 이 사진 감광판에 동일한 기준광을 비추면 이제 피사체의 이미지가 복원됨. 빛의 간섭 현상을 이용하여 디스플레이에서 어떤 이미지를 만들고, 감광판이 아닌 디지털 신호로 매번 이미지를 변경할 수 있는 공간 광 변조기(SLM-Spatial Light Modulator)을 이용하면, 광의 간섭에 의한 상쇄 및 보강이 일어남. 공간 광 변조기는 컴퓨터가 연산하여 만든 홀로그램(CGH-Computer Generated Hologram) 디스플레이에 빛을 비추어 홀로그램을 보여줌. 이 원리에 의해 모바일과 XR 글라스 등에 적용하기 어려운 이유를 알아보자

<홀로그램을 XR 기기나 소형물에 적용하기 힘든 이유>

a) 공간 광 변조기와 CGH는 고성능 컴퓨팅을 필요로 하여, 게이밍 노트북 수준의 GPU 컴퓨팅 파워가 아니라면 모바일 소류션으로 적용힘듦

b) 아주 좁은 시야각과 거리에서만 이상적인 3D 콘텐츠를 볼 수 있어, 안경현 디스플레이에서 약간의 안구움직임만 있어도 시야를 잃어버림(눈과 디스플레이 거리의 적정위치와 거리를 유지해야함)

c) 공간 광 변조기는 광원을 쪼개고 어떤 부분은 상쇄 간섭이 일어나도록 표현하므로 원래의 광원 대비 광 전달 효율이 현저히 떨어짐. 즉, 밝은 곳에서는 잘보이지 않음.

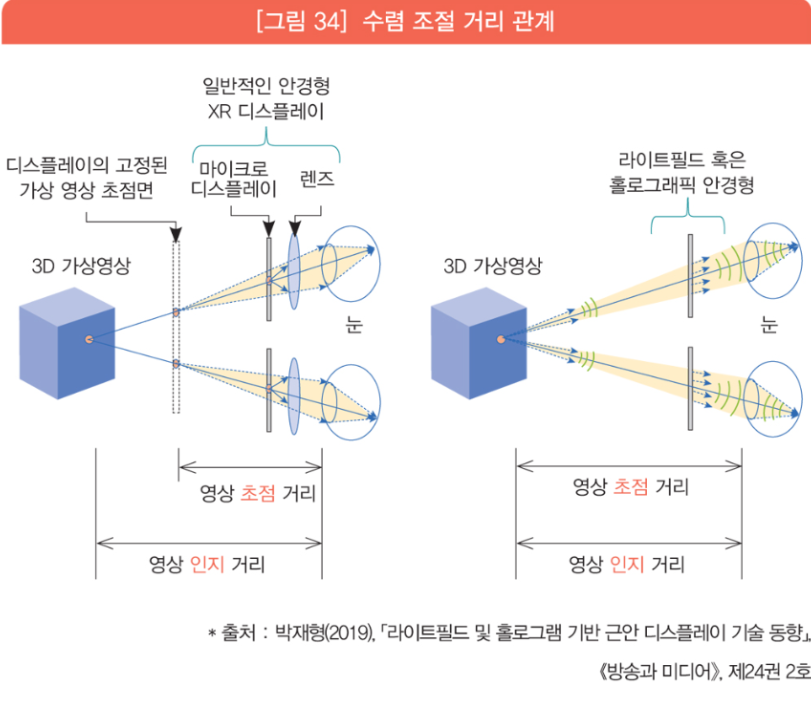

(4) 지금의 XR 글라스는 입체 영상 또는 거리 표현이 가능할까?

-

3D 디스플레이 기술과 달리 안경형 XR 글라스는 양쪽 눈에 각각 정보를 전달할 수 있음. 따라서 TV와 같은 평판 디스플레이보다 양안 시차를 이용한 입체 영상 표현에 훨씬 쉬움. 하지만 안경형 스테레오스코픽 디스플레이라 할지라도 여전히 앞서 소개한 수렴-초점 불일치의 문제는 존재하기 때문에 이를 해결하기 위한 아이디어들이 소개되고 있음

-

돌고래 영상을 구현한 '매직리프' 기업은 아래그림의 라트필드 디스플레이에 연구에 박차를 가하고 있음. 라이트필드 디스플레이 기술은 시청자 시선의 움직임에 따라 눈으로 들어오는 빛의 경로를 변경하여 보여줄 수 있는 기술임.

-

그런데 XR글라스과 VR은 왜 두통과 어지러움을 유발할까? 그것은 원거리의 풍경과 근거리의 XR 텍스트 정보 사이에서 시작 시스템의 초점거리 조절이 빈번하게 일어나면, 또 다른 시각 피로감을 유발하기 때문임. 그래서 아직까지 XR기기는 근거리(10m 이내) 수준의 실내 혹은 어두운 야외 활동에서 활용되는데 그침. 이러한 문제를 해결하려는 국내 스타트업 기업 '레티널'은 우리가 어릴 때 가지고 놀던 바늘구멍 사진기의 원리를 이용한 광학렌즈(컴바이너 원리)를 개발하고 있음. 이들은 컴바이너 내부에서 디스플레이의 빛을 꺾어주는 반사체를 바늘구멍과 결합시켜, 디스플레이에서 사용자가 어떤 거리의 물체나 건물을 보든 선명하게 콘텐츠를 볼 수 있게 해줌. 현시점 XR 글라스는 근거리에서 입체감을 살려주는 것은 어느 정도 가능함. 하지만 홀로그램 수준의 거리표현은 조금 더 기다려보자.

👽 책 후기

메타버스에 관해 두 번째로 고른 책인데, (22년출간) 20-21년 기준 각 빅테크들의 기술이 상세히 그림과 함께 이해설명을 높히면서 잘 정리되어있다. 여러가지 메타버스 책을 읽기보단 이 책으로 현 시점기술의 위치확인이나 현황을 보면 좋을 듯 싶다. 저자가 3분이라서 상세한 내용을 기입할 수는 있었으나 메타버스의 산업적 전망을 예측하는 저자 자신들의 의견이 많이 기재 되지않아 아쉬웠고, chapter가 끝나고 챕터요약과 투자포인트에 관한이야기에서도 챕터의 부록같은 느낌이라 아쉬웠다. '더알아보기'에서 쉽게 접할수 없던 기술들의 시연영상, 홍보영상을 접하는 부분은 긴 기술이론에 지쳐있을 때, 쉬어가는 페이지로 좋게 다가왔다. 그래도 이 책은 '한권으로 끝내는 메타버스'라는 수식어와 타이틀 달아주고 싶다.