출처: https://bruders.tistory.com/79

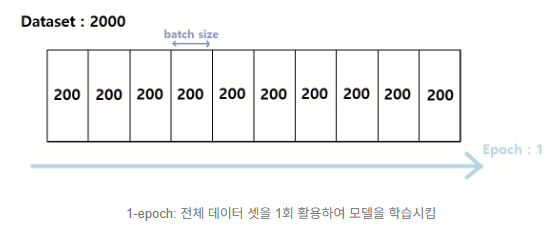

1 epoch = 전체 데이터셋에 대해 한번의 학습

※한번의 학습 = "forward & backward 를 한번 한다"

500개의 데이터가 있고, 아래와 같이 셋팅이 되어있다면,

-

epoch : 20

-

batch size : 50

1epoch에는 50의 batch size로 나눠진 데이터가 10번 들어가게 됩니다. iteration은 10이 되겠죠.

총 학습 횟수는 20번, iteration은 200번이 되게 됩니다.