통계학 맛보기

중요개념

- 모수의 개념

- 최대가능도 추정법

목표

표본분포와 표집분포, 가능도(likelihood)와 확률 등 헷갈릴 수 있는 개념들에 대해 각각의 정확한 의미와 차이점을 충분히 공부합시다.

권고사항

최대가능도 추정법을 통해서 정답에 해당하는 확률분포와 모델이 추정하는 확률분포의 거리를 최소화함으로써 모델을 학습시킬 수 있으며, 이 원리는 딥러닝/머신러닝에서 아주 유용하게 사용되기 때문에 확실하게 이해하고 넘어갑시다.

※ 고민합시다!

1. 확률과 가능도의 차이는 무엇일까요? (개념적인 차이, 수식에서의 차이, 확률밀도함수에서의 차이)

2. 확률 대신 가능도를 사용하였을 때의 이점은 어떤 것이 있을까요?

3. 다음의 code snippet은 어떤 확률분포를 나타내는 것일까요? 해당 확률분포에서 변수 theta가 의미할 수 있는 것은 무엇이 있을까요?import numpy as np import matplotlib.pyplot as plt theta = np.arange(0, 1, 0.001) p = theta ** 3 * (1 - theta) ** 7 plt.plot(theta, p) plt.show()

모수

- 모수란, 모집단의 특성(모평균, 모분산 등)을 나타내는 값을 말합니다.

- 통계적 모델링은 적절한 가정 위에서 확률분포를 추정(interface)하는 것이 목표이며, 기계학습과 통계학이 공통적으로 추구하는 목표입니다.

- 그러나 유한한 개수의 데이터만 관찰해서 모집단의 분포를 정확하게 알아낸다는 것은 불가능하므로, 근사적으로 확률분포를 추정할 수 밖에 없습니다.

- 예측모형의 목적은 분포를 정확하게 맞추는 것 보다는 데이터와 추정 방법의 불확실성을 고려해서 위험을 최소화하는 것이다.

- 데이터가 특정 확률분포를 따른다고 선험적으로(a priori) 가정한 후 그 분포를 결정하는 모수(parameter)를 추정하는 방법을 모수적(parametric)방법론이라 합니다.

- 특정 확률분포를 가정하지 않고 데이터에 따라 모델 구조 및 모수의 개수가 유연하게 바뀌는 것을 비모수(nonparametric)방법론이라 부릅니다.

- 기계학습의 많은 방법론은 비모수 방법론에 속합니다.

확률분포 가정하기

- 확률분포를 가정하는 기본적인 방법 -> 히스토그램을 통한 모양 관찰

- 데이터가 2개의 값(0 또는 1)만 가지는 경우 -> 베르누이 분포

- 데이터가 n개의 이산적인 값을 가지는 경우 -> 카테고리 분포

- 데이터가 [0,1] 사이에서 값을 가지는 경우 -> 베타 분포

- 데이터가 0 이상의 값을 가지는 경우 -> 감마 분포, 로그정규분포 등

- 데이터가 R전체에서 값을 가지는 경우 -> 정규 분포, 라플라스 분포 등

- 기계적으로 확률분포를 가정해서는 안되며, 데이터를 생성하는 원리를 먼저 고려하는 것이 원칙입니다.

- 각 분포마다 검정하는 방법들이 있으므로 모수를 추정한 후에는 반드시 검정을 해야 한다.

데이터로 모수 추정하기

- 데이터의 확률분포를 가정했으면 모수를 추정해볼 수 있습니다.

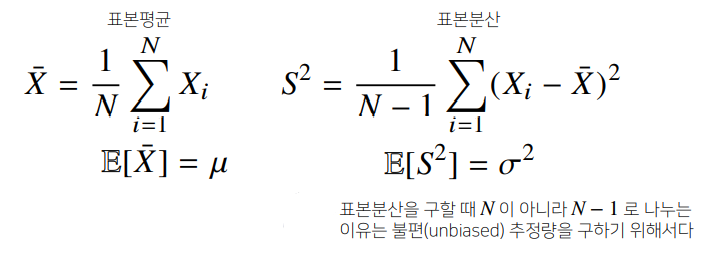

- 정규분포의 모수는 평균과 분산으로 이를 추정하는 통계량은 다음과 같습니다.

- 통계량의 확률분포를 표집분포(sampling distribution)라 부르며, 특히 표본평균의 표집분포는 N이 커질수록 정규분포를 따릅니다.

- 이를 중심극한정리(Central Limit Theorem)이라 부르며, 모집단의 분포가 정규분포를 따르지 않아도 성립합니다.

최대가능도 추정법

- 표본평균이나 표본분산은 중요한 통계량이지만 확률분포마다 사용하는 모수가 다르므로 적절한 통계량이 달라지게 됩니다.

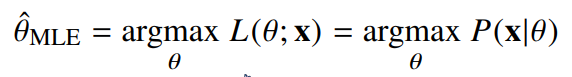

- 이론적으로 가장 가능성이 높은 모수를 추정하는 방법 중 하나는 최대가능도 추정법(maximum likelihood estimation, MLE)입니다.

- 가능도 함수는 모수(theta)를 따르는 분포가 x를 관찰할 가능성을 뜻하지만 확률로 해석하면 안됩니다.

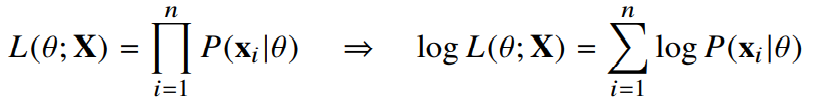

- 데이터 집합 X가 독립적으로 추출되었을 경우 로그가능도를 최적화합니다.

로그 가능도를 쓰는 이유

- 로그 가능도를 최적화하는 모수(theta)는 가능도를 최적화하는 MLE가 됩니다.

- 데이터의 숫자가 적으면 상관없지만 만일 데이터의 숫자가 수억 단위가 된다면 컴퓨터의 정확도로는 가능도를 계산하는 것은 불가능합니다.

- 데이터가 독립일 경우, 로그를 사용하면 가능도의 곱셈을 로그가능도의 덧셈으로 바꿀 수 있기 때문에 컴퓨터로 연산이 가능해집니다.

- 경사하강법으로 가능도를 최적화할 때 미분 연산을 사용하게 되는데, 로그가능도를 사용하면 연산량을 O(N^2)에서 O(N)으로 줄여줍니다.

- 대개의 손실함수의 경우 경사하강법을 사용하므로 음의 로그가능도(negative log-likelihood)를 최적화하게 됩니다.

딥러닝에서 최대가능도 추정법

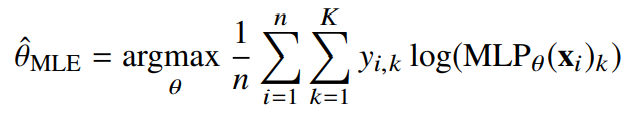

- 최대가능도 추정법을 이용해서 기계학습 모델을 학습할 수 있습니다.

- 딥러닝 모델의 가중치를 theta = (W1, ... , WL)라 표기했을 때 분류 문제에서 소프트맥스 벡터는 카테고리분포의 모수 (p1, ..., pk)를 모델링합니다.

- 원핫벡터로 표현한 정답레이블 y = (y1, ..., yk)을 관찰데이터로 이용해 확률분포인 소프트맥스 벡터의 로그가능도를 최적화할 수 있습니다.

확률분포의 거리

- 기계학습에서 사용되는 손실함수들은 모델이 학습하는 확률분포와 데이터에서 관찰되는 확률분포의 거리를 통해 유도합니다.

- 데이터공간에서 두 개의 확률분포 P(x), Q(x)가 있을 경우 두 확률분포 사이의 거리(distance)를 계산할 때 다음과 같은 함수들을 이용합니다.

- 총변동거리 (Total Variation Distance, TV)

- 쿨백-라이블러 발산 (Kullback-Leibler Divergence, KL)

- 바슈타인 거리 (Wasserstein Distance)

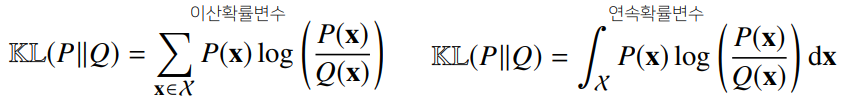

쿨백-라이블러 발산

- 쿨백-라이블러 발산 (Kullback-Leibler Divergence, KL)은 다음과 같이 정의합니다.

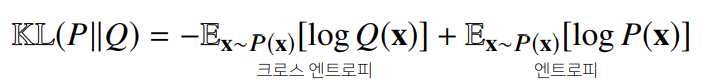

- 쿨백-라이블러는 다음과 같이 분해할 수 있습니다.

- 분류 문제에서 정답레이블을 P, 모델 예측을 Q라 두면 최대가능도 추정법은 쿨백-라이블러 발산을 최소화하는 것과 같습니다.