도입 배경

xavier nx로 nlp 서버를 돌리려니 1만개 기준 360초(그것도 FP16...!!!)가 걸렸습니다. 초당 30개 처리니 그렇게 느린건 아니지만 사람의 심리가 다 그렇잖아요? 느린거 싫어하는거.

그래서 여러 마켓에 문의해보고 대략적인 가격을 물어본 결과 중고 사는게 그렇게 가격도 나쁘지 않아보여서 중고로 업어왔습니다. 신품가에서 10만정도 쌌네요!

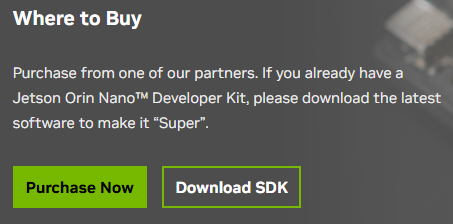

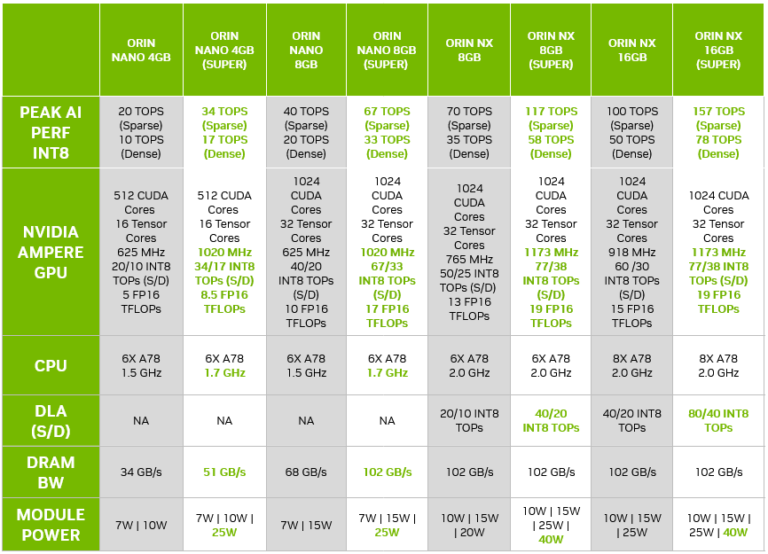

그리고 Orin Nano에서 몇몇 작업만 좀 해주면 Orin Nano Super로 업그레이드(!!) 되는 상황이라 안가져올 이유가 없더라고요.

공홈에 이렇게 나와있어요!

관련된 질문은 nvidia developer - different in super and non-super를 참고바랍니다.

OS 설치

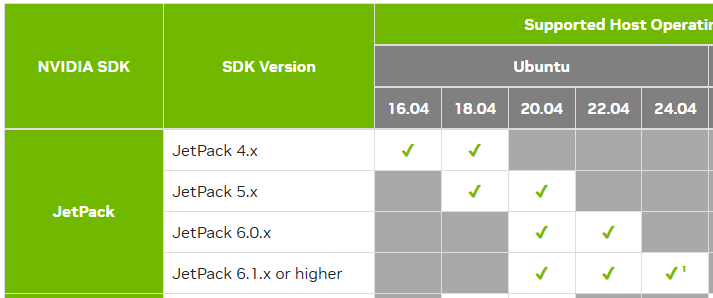

OS를 드라이브에 flash 하기 위해서는 우분투 머신이 필요합니다. GUI를 지원하는 우분투 머신이 없기에 무료로 풀린 VMware workstation 9 pro를 이용하여 가상머신에 올려서 하였습니다.

jetson orin은 JetPack 6.2를 쓰므로, 최소 20.04를 선택하면 됩니다. 추후 업데이트까지 생각하면 22.04나 24.04를 선택하는 것도 나쁜 선택은 아닙니다.

jetson에서 해줘야 할 것

주의! 40핀이 있는쪽이 아닙니다.

Jetson Xavier 시리즈든, Jetson Orin 시리즈든 FC REC라는 핀 헤더가 있습니다. 이걸 점프시켜서, 즉 REC와 GND를 연결하여 복구 모드로 진입하게 합니다.

어느 시리즈든 간에 위에서 3번째가 FC REC고 그 위, 아래는 GND 입니다. 위의 기준은 핀이 많은 쪽!

이후 전원을 연결하고 host pc와 usb 연결을 해주면 됩니다.

그 전에!!!!

이 글에서 먼저 펌웨어가 36.X 이상인지 확인합니다.

아니라면 업데이트 해줘야해요.

host pc에서 해줘야 할 것

SDK Manager를 다운받아줍니다. 호스트 pc에서 deb를 다운받아 설치해주면 됩니다!

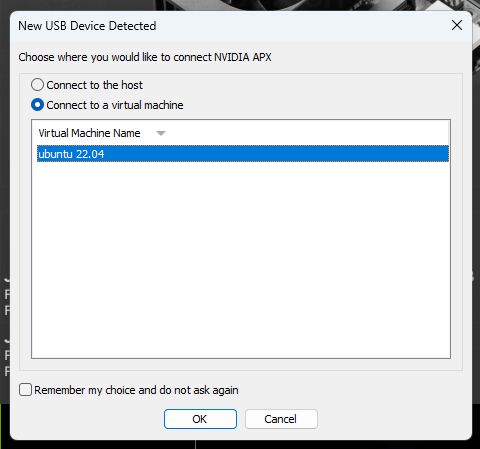

VMware를 쓴다면?

pc에 연결 후 virtual machine에 jetson을 인식시켜줍니다.

설치 완료되었다면 host pc에서 sdk manager를 실행하고 로그인 합니다.

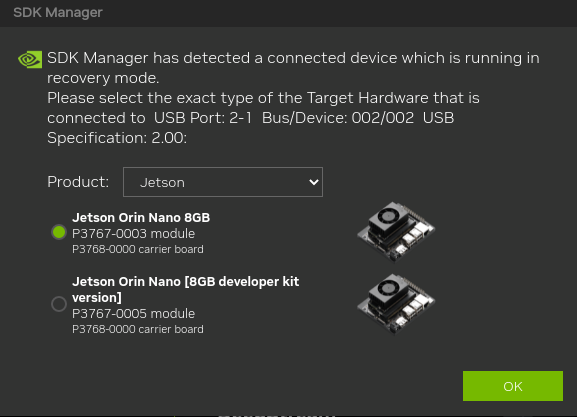

이후 아래의 팝업이 뜰건데, dev kit version이라면 아래를, 기타 다른 carrier board를 쓴다면 위를 선택해주면 됩니다. 큰 차이는 없는것같아요.

이후 SDK가 jetpack 6.2로 잘 설정 되어있는지 확인해줍니다.

다음으로 넘어가서 설치할 것을 선택하라 하는데

- Jetson Linux: 필수

- 나머지: 선택

jetson linux(os)만 빼고 나머지는 선택해서 설치하면 됩니다. 나중에 따로 설치 가능해요!

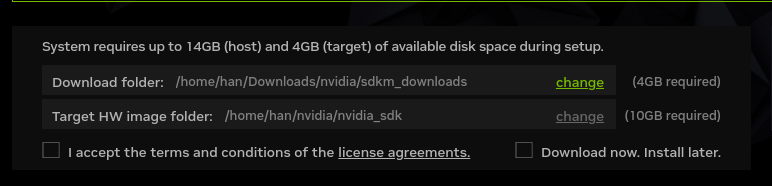

하단의 동의문을 선택하고 continue를 눌러줍니다.

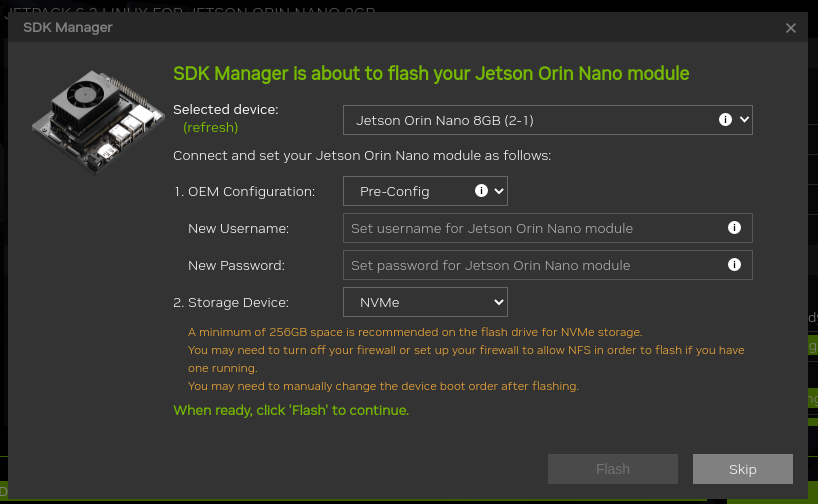

다음으로 username, password, 설치 위치를 선택하라 하는데 ssd를 장착했다면 nvme, sd카드를 쓴다면 sd card를 선택합니다.

ssh 접속

USB to SSH 접속 ip는 192.168.55.1 입니다

host pc에서 ssh 접속으로 기본 설정을 해줍니다.

설정은 제 다른 포스트를 참고해주세요!

위 포스트에서 apt 업데이트, jetpack 설치, pip 설치, jtop 설치를 먼저 해주세요.

재부팅 후 host os는 종료해도 문제 없습니다! FC REC에 연결한 점퍼선도 제거해줍시다.

지금부터는 vscode에서 진행됩니다. Wi-Fi 연결을 해놨기 때문이죠!PyTorch 설치

Jetson Orin Nano를 JetPack 6.2로 설치했다면 아래와 같을겁니다.

CUDA: 12.6.68

cuDNN: 9.8.0.87CUDA는 12.6이고, cuDNN은 9.8이죠. 이거에 맞는 PyTorch를 찾아야 합니다.

일단 아래를 타이핑하여 관련 라이브러리 및 pip를 설치해줍니다.

sudo apt-get install -y python3-pip libopenblas-dev;이전 포스팅에서는 develop forum의 pytorch for jetson을 사용하였지만, 저기에는 JetPack 6.2에 관련된 내용은 없습니다. 새로 찾아야겠네요.

이 문서에 따라 설치하면 됩니다.

더 간단히는 아래를 사용하여 설치해주면 됩니다.

wget https://pypi.jetson-ai-lab.dev/jp6/cu126/+f/6cc/6ecfe8a5994fd/torch-2.6.0-cp310-cp310-linux_aarch64.whl

pip install torch-2.6.0-cp310-cp310-linux_aarch64.whl이후 cuda 사용 가능을 보면...

import torch

torch.cuda.is_available()

>> True성공입니다!

트러블 슈팅

cudnn8 관련 오류가 떠요

잘못된 torch 버전을 설치한겁니다. 전 포스팅 말고 이번 포스팅에서 알려준 방식을 쓰세요.

cudnn9긴 한데 없대요

cuDNN 페이지에서 가이드라인을 받아 설치해보세요.