출처: 모두를 위한 딥러닝 강좌 시즌 1 by Sung Kim

선형 회귀(Linear Regression)

선형회귀의 가정: 선형 회귀 모델은 데이터의 특징(feature)과 예측하고자 하는 결과값이 선형적인 관계(H(x) = aX + b)를 맺을 것이라고 가정하고 있다.

- 여기서 H(x)는 데이터의 특징과 예측하고자 하는 결과의 관계에 대한 하나의 가설적인 선임

- ex) 공부시간과 성적의 관계

선형 회귀 모델에서는, 데이터의 특징을 가지고 결과를 가장 잘 예측할 수 있는 선을 찾는 것이 학습이다.

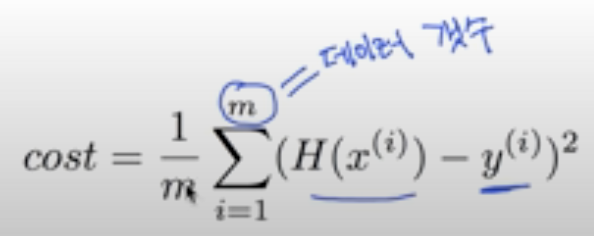

Cost function(비용 함수)

- 우리가 세운 가설과 실"제 데이터가 얼마나 다른가에 대한 지표를 계산하는 함수

- 손실 함수(Loss fuction)라고도 함

- 가장 작은 값을 산출하는 W와 b를 구하는 것이 linear regression의 학습임