Abstract

레이블 정보를 얻는 어려움과 결합된 최신 데이터 세트의 크기가 계속 증가함에 따라 반지도 학습은 현대 데이터 분석에서 실질적으로 중요한 문제 중 하나가 되었습니다. 생성 모델을 사용하여 준지도 학습에 대한 접근 방식을 다시 검토하고 작은 레이블이 지정된 데이터 세트에서 레이블이 없는 큰 데이터 세트에 이르기까지 효과적인 일반화를 허용하는 새로운 모델을 개발합니다. 지금까지 생성 접근 방식은 유연하지 않거나 비효율적이거나 확장 불가능했습니다. 우리는 변형 방법의 최근 발전을 활용하는 심층 생성 모델과 근사 베이지안 추론을 사용하여 상당한 개선을 제공하여 생성 접근 방식을 반지도 학습에 대해 매우 경쟁력 있게 만들 수 있음을 보여줍니다.

1. Introduction

준지도 학습은 관측치의 작은 하위 집합에만 해당 클래스 레이블이 있는 경우 분류 문제를 고려합니다. 이러한 문제는 이미지 검색 (Fergus et al., 2009), 유전체학 (Shi and Zhang, 2011), 자연어 파싱 (Liang, 2005), 음성 분석 (Liu 및 Kirchhoff, 2013), 여기서 레이블이 지정되지 않은 데이터는 풍부하지만 클래스 레이블을 얻는 것은 비용이 많이 들거나 전체 데이터 세트에 대해 얻을 수 없습니다. 그런 다음 질문은 데이터 속성을 사용하여 결정 경계를 개선하고 레이블이 지정된 데이터만 사용하여 구성된 분류자를 기반으로 하는 분류 기준보다 더 정확한 분류를 허용하는 방법입니다. 이 논문에서 우리는 데이터 밀도의 명시적 모델을 활용하고, 심층 생성 모델과 확장 가능한 변이 추론의 최근 발전을 기반으로 유도 및 전환 반지도 학습을 위한 확률 모델을 개발하여 이 질문에 답합니다 (Kingma and Welling, 2014; Rezende et al., 2014).

기존 접근 방식 중에서 반지도 학습을 위한 가장 간단한 알고리즘은 자체 학습 방식 (Rosenberg et al., 2005)을 기반으로 합니다. 여기에서 모델은 자신의 매우 확신이 있는 예측에서 얻은 추가 레이블 데이터로 부트스트랩 됩니다. 이 프로세스는 일부 종료 조건에 도달할 때까지 반복됩니다. 이러한 방법은 추론적이며 잘못된 예측을 강화할 수 있기 때문에 오류가 발생하기 쉽습니다. Transductive SVM (TSVM) (Joachims, 1999)은 최대 마진 분류를 목표로 SVM을 확장하는 동시에 마진 근처에 레이블이 지정되지 않은 관측치가 최대한 적도록 합니다. 이러한 접근 방식은 많은 양의 레이블이 지정되지 않은 데이터로 확장하는 데 어려움이 있으며 이 설정에서 효율적인 최적화는 여전히 열려있는 문제입니다. 그래프 기반 방법은 가장 널리 사용되며 유사한 관찰을 연결하는 그래프를 구성하는 것을 목표로 합니다. 레이블 정보는 최소 에너지 (MAP) 구성을 찾아 레이블이 지정된 노드에서 레이블이 없는 노드로 그래프를 통해 전파됩니다 (Blum et al., 2004; Zhu et al., 2003). 그래프 기반 접근 방식은 그래프 구조에 민감하며 효율적인 스펙트럼 방법을 사용할 수 있지만 이러한 방법을 적용할 수 있는 척도를 제한하는 그래프 Laplacian의 고유 분석이 필요합니다 (Fergus et al., 2009). 신경망 기반 접근 방식은 피드 포워드 분류기를 훈련하여 비지도 학습과 지도 학습을 자동 인코더 또는 기타 비지도 데이터 임베딩의 추가 페널티와 결합합니다 (Ranzato and Szummer, 2008; Weston et al., 2012). Manifold Tangent Classifier (MTC) (Rifai et al., 2011)는 대조적 자동 인코더 (CAE)를 훈련하여 데이터가 있는 다양체를 학습한 다음 TangentProp의 인스턴스가 로컬 섭동에 거의 불변하는 분류기를 훈련시킵니다. 다양체를 따라. 그래프 기반 방법을 사용한 다양한 학습 아이디어는 가장 최근에 Atlas RBF 모델 (Pitelis et al., 2014)의 커널 (SVM) 방법과 결합되었으며 현재 사용 가능한 가장 경쟁력 있는 성능을 제공합니다.

대신 이 논문에서 우리는 준지도 학습 문제를 분류 문제에 대한 전문화된 결측 데이터 대치 작업으로 인식하는 생성 모델의 힘을 활용하기로 선택합니다. 가우시안 혼합 또는 은닉 마르코프 모델 (Zhu, 2006)과 같은 모델을 기반으로 하는 기존 생성 접근 방식은 많은 수의 혼합물 성분 또는 상태가 잘 수행되어야 하므로 그다지 성공적이지 못했습니다. 더 최근의 솔루션은 트리 (Kemp et al., 2003) 또는 가우스 프로세스 (Adams and Ghahramani, 2009)를 기반으로 하는 비모수 밀도 모델을 사용했지만 이러한 접근 방식에 대한 확장성과 정확한 추론은 여전히 부족합니다. 반 감독 클러스터링에 대한 변이 근사도 이전에 탐구되었습니다 (Li et al., 2009; Wang et al., 2009).

따라서 이전에 소규모 생성 접근 방식이 탐색되었지만 준지도 학습을 위한 일반화되고 확장 가능한 확률적 접근 방식은 여전히 부족합니다. 우리가 다음과 같은 기여를 통해 해결하는 것은 이 차이입니다.

-

확률적 모델링과 심층 신경망의 융합으로 형성된 풍부한 매개 변수 밀도 추정기를 사용하여 생성 모델을 사용하는 반지도 학습을 위한 새로운 프레임 워크를 설명합니다.

-

반 감독 분류 문제에 대해 변이 추론이 어떻게 적용될 수 있는지 처음으로 보여줍니다. 특히, 모델과 변형 매개 변수의 공동 최적화를 허용하고 대규모 데이터 세트로 확장 가능한 확률적 변형 추론 알고리즘을 개발합니다.

-

벤치마크 문제에 대한 최신 결과를 제공하는 여러 데이터 세트에 대한 접근 방식의 성능을 보여줍니다.

-

질적으로 생성되는 준지도 모델은 데이터 클래스 (콘텐츠 유형)를 클래스 내 변동성 (스타일)에서 분리하는 방법을 학습하여 매우 간단한 방식으로 다양한 데이터 세트에서 이미지의 유사성을 시뮬레이션 할 수 있음을 보여줍니다.

2. Deep Generative Models for Semi-supervised Learning

우리는 쌍 , 번째 관측치 및 해당 클래스 레이블 . 관측치에는 로 표시되는 해당하는 잠재 변수가 있습니다. 단일 데이터 포인트와 관련된 용어를 참조하는 것이 분명할 때마다 인덱스 i를 생략합니다. 준지도 분류에서는 관측치의 하위 집합에만 해당 클래스 레이블이 있습니다. 레이블이 지정된 하위 집합과 레이블이 없는 하위 집합에 대한 경험적 분포를 각각 및 라고 합니다. 이제 레이블이 지정된 데이터 만 사용하여 얻을 수 있는 분류 성능을 향상시키기 위해 데이터의 생성적 설명을 활용하는 준지도 학습용 모델을 개발합니다.

Latent-feature discriminative model (M1):

일반적으로 사용되는 접근 방식은 데이터의 임베딩 또는 기능 표현을 제공하는 모델을 구성하는 것입니다. 이러한 기능을 사용하여 별도의 분류기가 훈련됩니다. 임베딩을 사용하면 제한된 수의 레이블로도 정확한 분류를 허용하는 잠재 특징 공간에서 관련 관측 값을 클러스터링 할 수 있습니다. 선형 임베딩 또는 일반 자동 인코더에서 얻은 기능 대신 더 강력한 잠재 기능 세트를 제공할 수 있는 데이터의 심층 생성 모델을 구성합니다. 우리가 사용하는 생성 모델은 다음과 같습니다.

여기서 는 잠재 변수 세트의 매개 변수 를 사용하는 비선형 변환에 의해 확률이 형성되는 적절한 우도 함수 (예 : 가우스 또는 베르누이 분포)입니다. 이 비선형 변환은 밀도 모델에서 데이터의 더 높은 순간을 캡처할 수 있도록 하는데 필수적이며 이러한 비선형 함수를 심층 신경망으로 선택합니다.

잠재 변수 에 대한 사후 분포의 근사 샘플은 (전이적) SVM 또는 다항 회귀와 같은 클래스 레이블 를 예측하는 분류기를 훈련하는 기능으로 사용됩니다. 이 접근 방식을 사용하면 일반적으로 차원이 관측치보다 훨씬 낮은 잠재 변수를 사용하므로 더 낮은 차원 공간에서 분류를 수행할 수 있습니다. 이러한 저 차원 임베딩은 데이터의 비선형 변환 시퀀스에 의해 매개 변수가 형성되는 독립적인 잠복 가우스 사후를 사용하므로 이제 더 쉽게 분리할 수 있습니다. 이 간단한 접근 방식은 SVM의 성능을 향상시키며 섹션 4에서 이를 보여줍니다.

Generative semi-supervised model(M2):

우리는 연속 잠재 변수 와 함께 잠재 클래스 변수 에 의해 생성되는 데이터를 설명하는 확률 모델을 제안합니다. 데이터는 생성 프로세스로 설명됩니다.

여기서 는 다항 분포이고, 클래스 레이블을 사용할 수 없고 가 추가 잠재 변수인 경우 클래스 레이블 는 잠재 변수로 처리됩니다. 이러한 잠재 변수는 약간 독립적이며, 예를 들어 숫자 생성의 경우 클래스 사양을 숫자의 쓰기 스타일에서 분리할 수 있습니다. 이전과 마찬가지로 는 잠재 변수의 비선형 변환으로 매개 변수화된 Bernoulli 또는 Gaussian 분포와 같은 적절한 우도 함수입니다. 실험에서 우리는 이 비선형 함수로 심층 신경망을 선택했습니다. 대부분의 레이블 는 관찰되지 않기 때문에 추론 프로세스 중에 레이블이 지정되지 않은 모든 데이터의 클래스를 통합하여 추론으로 분류를 수행합니다. 누락된 라벨에 대한 예측은 추론 된 사후 분포 에서 얻습니다. 이 모델은 서로 다른 혼합물 성분이 매개 변수를 공유하는 하이브리드 연속 이산 혼합물 모델로도 볼 수 있습니다.

Stacked generative semi-supervised model (M1+M2):

먼저 M1의 생성 모델을 사용하여 새로운 잠재 표현 을 학습한 다음 원시 데이터 대신 의 임베딩을 사용하여 생성적인 반지도 모델 M2를 학습하여 이 두 가지 접근 방식을 결합할 수 있습니다. 결과는 확률적 변수의 두 계층이 있는 심층 생성 모델입니다 :

, 여기서 사전 와 는 위의 와 의 것과 같고 와 는 모두 심층 신경망으로 매개 변수화됩니다.

4. Expeimental Results

가장 중요한 결과와 수치를 재현할 수 있는 오픈 소스 코드는 http://github.com/dpkingma/nips14-ssl 에서 확인할 수 있습니다. 최신 실험 결과는 http://arxiv.org/abs/1406.5298 을 참조하십시오.

4.1 Bentchmark Classification

표준 MNIST 숫자 분류 벤치마크에서 성능을 테스트합니다. 준지도 학습을 위한 데이터 세트는 레이블이 지정된 세트와 레이블이 없는 세트 사이에 50,000 개의 트레이닝 포인트를 분할하고 레이블이 지정된 크기를 100에서 3000으로 변경하여 생성됩니다. 이를 수행할 때 모든 클래스가 균형을 이루도록 합니다. 즉, 각 클래스가 동일합니다. 레이블이 지정된 포인트의 수입니다. 반복되는 데이터 세트 그리기에서 평균 성능에 대한 신뢰 한계에 대한 무작위 샘플링을 사용하여 많은 데이터 세트를 생성합니다.

모델 M1의 경우 50 차원 잠재 변수 를 사용했습니다. 생성 및 추론 모델의 일부를 구성하는 MLP는 softplus 활성화 함수를 사용하여 각각 600 개의 은닉 유닛이 있는 두 개의 은닉 계층으로 구성되었습니다. 맨 위에 로 추론된 값에 대해 TSVM (Transductive SVM)을 학습했습니다. 모델 M2의 경우 50 차원 도 사용했습니다. 각 실험에서 MLP는 각각 500 개의 은닉 유닛과 softplus 활성화 함수가 있는 하나의 은닉 계층으로 구성되었습니다. SVHN 및 NORB의 경우 PCA로 데이터를 사전 처리하는 것이 도움이 된다는 것을 알았습니다. 이는 모델을 한 수준 더 깊게 만들고 처리되지 않은 데이터의 가능성에 대한 하한을 최적화합니다.

분류 결과를 표 1에 나타냅니다. 특히 NN (근접 이웃), SVM (Label Set)의 지원 벡터 머신, TSVM (Transductive SVM) 및 CAE (Contractive Auto Encoder)를 사용한 분류와 같은 준지도 학습의 광범위한 기존 솔루션과 비교합니다. 현재 가장 좋은 결과 중 일부는 MTC (manifold tangent classifier) (Rifai et al., 2011)와 AtlasRBF 방법 (Pitelis et al., 2014)을 통해 얻을 수 있습니다. 이 비교에서 다른 모델과 달리, 우리 모델은 완전히 확률적이지만 이러한 대안과 동일한 순서로 비용이 발생합니다.

Results:

잠재 특징 판별 모델 (M1)은 데이터의 단순한 임베딩을 기반으로 다른 모델보다 더 나은 성능을 발휘하여 쉽게 분류할 수 있는 강력한 기능을 제공하는 데 있어 잠재 공간의 효과를 보여줍니다. 조건부 생성 모델 (M2)에서와 같이 동일한 모델에서 이러한 기능을 분류 메커니즘과 직접 결합하여 별도의 TSVM 분류기 없이 유사한 결과를 얻을 수 있습니다.

그러나 모델 M1 및 M2 스택을 사용하여 지금까지 최상의 결과를 얻었습니다. 이 결합된 모델은 모든 조건에서 정확한 테스트 세트 예측을 제공하며 이전에 가장 좋은 방법을 쉽게 능가합니다. 또한 사용 가능한 모든 레이블을 사용하여 지도 학습을 위해 이 심층 생성 모델을 테스트하고 이 순열 불변 MNIST 분류 작업에 대해 가장 잘 게시된 결과 중 하나인 0.96 %의 테스트 세트 성능을 얻었습니다.

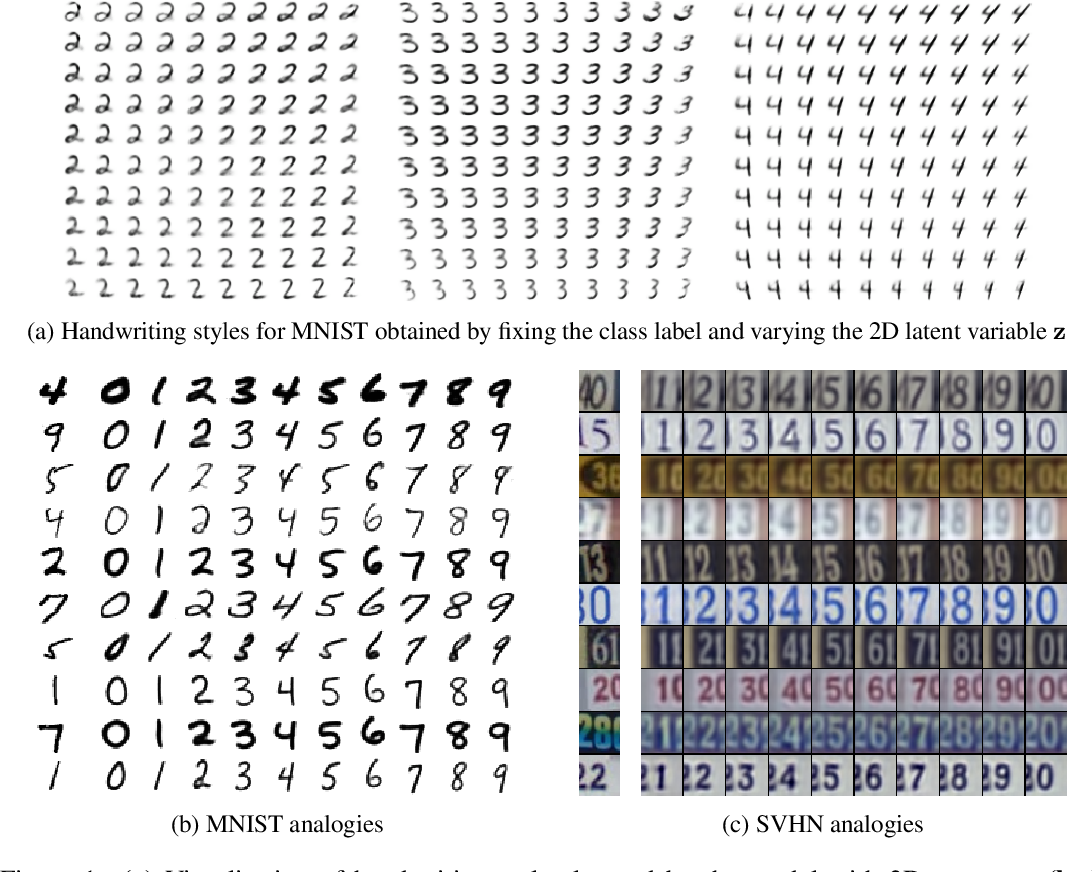

4.2 Conditional Generation

조건부 생성 모델을 사용하여 데이터의 기본 구조를 탐색할 수 있으며, 이는 두 가지 형태의 유추적 추론을 통해 보여줍니다. 먼저, 클래스 레이블 를 고정한 다음 값 범위에서 잠재 변수 를 변경하여 스타일과 콘텐츠 분리를 보여줍니다. 그림 1은 두 개의 잠재 변수가 있는 훈련된 모델을 사용하고 2D 잠재 변수가 -5에서 5까지의 범위에서 변하는 세 가지 MNIST 클래스를 보여줍니다. 모든 경우에 잠복의 주변 영역이 비슷한 쓰기 스타일에 해당하는 것을 볼 수 있습니다. 클래스와 무관합니다. 왼쪽 영역은 수직 쓰기 스타일을 나타내고 오른쪽 영역은 기울어진 스타일을 나타냅니다.

Figure 1: (a) 2D 공간이 있는 모델에서 학습 한 필기 스타일의 시각화. (b,c) 고차원 -공간을 사용하는 생성적 준지도 모델을 사용한 유추적 추론. 가장 왼쪽 열에는 테스트 세트의 이미지가 표시됩니다. 다른 열은 생성 모델에 의한 의 유추적 환상을 보여줍니다. 여기서 각 행의 잠재 변수 는 추론 네트워크에 의해 왼쪽에 있는 테스트 세트 이미지에서 추론된 값으로 설정됩니다. 각 열은 클래스 레이블 에 해당합니다.

Figure 1: (a) 2D 공간이 있는 모델에서 학습 한 필기 스타일의 시각화. (b,c) 고차원 -공간을 사용하는 생성적 준지도 모델을 사용한 유추적 추론. 가장 왼쪽 열에는 테스트 세트의 이미지가 표시됩니다. 다른 열은 생성 모델에 의한 의 유추적 환상을 보여줍니다. 여기서 각 행의 잠재 변수 는 추론 네트워크에 의해 왼쪽에 있는 테스트 세트 이미지에서 추론된 값으로 설정됩니다. 각 열은 클래스 레이블 에 해당합니다.

값, 클래스 레이블 를 변경하고 와 의 해당 조합에 해당하는 생성 모델의 이미지를 시뮬레이션합니다. 이것은 다시 클래스에서 스타일의 분리를 보여줍니다. 그림 1은 MNIST 및 SVHN 데이터 세트에 대한 이러한 비유적 환상을 보여줍니다 (Netzer et al., 2011). SVHN 데이터 세트는 MNIST보다 훨씬 복잡한 데이터 세트이지만 모델은 집 번호의 스타일을 수정할 수 있고 해당 스타일에 잘 나타나는 숫자를 변경할 수 있습니다. 이러한 세대는 이러한 데이터 세트에 대한 생성 모델의 시뮬레이션에서 현재 최고의 성능을 나타냅니다.

이러한 방식으로 사용된 모델은 Tang and Salakhutdinov (2013)가 설명한 확률적 피드 포워드 네트워크 (SFNN)에 대한 대안 모델도 제공합니다. 중요도 샘플링에 의존하는 비효율적인 Monte Carlo EM 알고리즘 대신 확장하기 쉬운 효율적인 공동 추론을 수행할 수 있기 때문에 모델의 성능이 SFNN에서 크게 향상되었습니다.

4.3 Image Classification

SVHN 및 NORB 이미지 데이터 세트에 대한 이미지 분류 성능을 보여줍니다. 반 감독 설정에서 비교 결과가 존재하지 않기 때문에 RBF 커널을 사용하여 가장 가까운 이웃 및 TSVM 분류를 수행하고 잠재 특징 식별 모델에서 생성된 기능의 성능을 원래 기능과 비교합니다. 결과는 표 2와 3에 나와 있으며, 반 감독 분류에 대한 접근 방식의 효율성을 다시 보여줍니다.

4.4 Optimization details

매개 변수는 0으로 초기화된 바이어스 매개 변수를 제외하고 에서 무작위로 샘플링하여 초기화되었습니다. 목표는 모멘텀 및 초기화 바이어스 보정이 있는 RMSProp의 변형을 사용하여 수렴될 때까지 미니 배치 기울기 상승을 사용하여 최적화되었습니다. 0.0003의 일정한 학습률, 0.1의 첫 번째 모멘트 감쇠 (모멘텀) 및 0.001의 두 번째 모멘트 감쇠. MNIST 실험의 경우 이미지의 정규화 된 픽셀 강도를 Bernoulli 확률로 처리하고 이 분포에서 이진 이미지를 샘플링하여 훈련을 위한 미니 배치를 생성했습니다. M2 모델에서는 의 사전에 해당하는 가중치 감쇠를 사용했습니다.

5. Discussion and Conclusion

여기에 소개된 근사 추론 방법은 변형 학습의 모든 기능을 활용하여 모델의 매개 변수로 쉽게 확장할 수 있습니다. 이러한 확장은 또한 모델 선택을 수행하기 위한 원칙적인 근거를 제공합니다. 반지도 학습과 같이 사용 가능한 데이터의 양이 많지 않을 때 효율적인 모델 선택이 특히 중요합니다.

이미지 분류 작업의 경우 관심 분야 중 하나는 이러한 방법을 현재 감독되는 분류 방법의 표준을 형성하는 컨볼루션 신경망과 결합하는 것입니다. 모델의 모든 구성 요소가 신경망에 의해 매개 변수화되기 때문에 컨볼루션 또는 보다 일반적인 로컬 연결 아키텍처를 쉽게 활용할 수 있으며 향후 탐색을 위한 유망한 길을 형성합니다.

우리가 제시한 모델의 한계는 데이터 세트의 클래스 수에서 선형적으로 확장된다는 것입니다. 훈련 중에 각 클래스의 생성 가능성을 재평가해야 하는 것은 비용이 많이 드는 작업입니다. 후방 질량의 절단을 사용하여 평가 횟수를 잠재적으로 줄일 수 있습니다. 예를 들어 우리는 우리의 방법을 Pal et al. 이 제안한 절단 알고리즘과 결합할 수 있습니다. (2005) 또는 오류 수정 출력 코드와 같은 메커니즘을 사용합니다 (Dietterich 및 Bakiri, 1995). 이미지 태깅에 필수적인 다중 라벨 분류 문제로 모델을 확장하는 것도 가능하지만 클래스 당 가능성 평가 수를 줄이기 위해 유사한 근사치가 필요합니다.

우리는 생성 모델을 사용하여 데이터 밀도의 정보를 활용하여 예측의 품질을 향상시킬 수 있는 반지도 학습을 위한 새로운 모델을 개발했습니다. 우리는 이러한 모델에서 근사 베이지안 추론을 위한 효율적인 변형 최적화 알고리즘을 개발했으며 현재 준지도 학습에 사용할 수 있는 가장 경쟁력 있는 모델 중 하나임을 입증했습니다. 우리는 이러한 결과가 생성 모델을 기반으로 한 훨씬 더 강력한 반 감독 분류 방법의 개발을 촉진하기를 희망합니다.