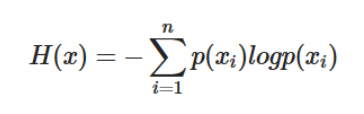

1. 엔트로피

엔트로피(Entropy)란 변수의 불확실정도를 나타내는 수치다. 이 때, 불확실하다는 것은 어떤 값이 될지 예측하기 어려운 경우를 의미한다. 즉, 결과를 예측하기 어려울수록 엔트로피 값이 높다.

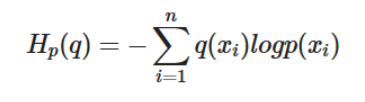

2. 크로스 엔트로피

크로스 엔트로피(Cross-Entropy)란 모델에서 예측한 확률이 실제와 틀릴 수 있는 정보량을 의미한다. 실제 분포를 q, 예측 모델링으로 구한 분포를 p라고 하자. 이 때, q를 예측하는 p 분포를 만들었을 때 크로스 엔트로피 식은 다음과 같다.

크로스 엔트로피는 실제 분포를 알지 못 하는 상태에서 예측 값을 관찰해가며 실제 분포를 예측한다. 실제 값과 예측 값이 맞을 경우에는 0으로 수렴하고, 다를 경우에는 값이 점점 커지기 때문에, 머신러닝에서 손실 함수(loss function)로 많이 사용한다. 손실 함수를 간단히 말하자면 실제 값과 예측 값의 차이를 의미하며, 추후에 시간이 되면 손실 함수의 종류에 대해서도 정리하도록 하겠다.

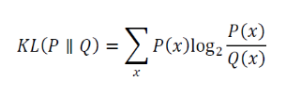

3. KL 다이버전스

KL 다이버전스(KL Divergence)란, 서로 다른 두 분포 간의 거리를 측정하는 값이다. 크로스 엔트로피 = 엔트로피 + KL 다이버전스 로 표현할 수 있으며, 예측 값인 크로스 엔트로피가 실제 값인 엔트로피보다 크거나 같기 때문에 KL 다이버전스는 항상 0 이상의 값을 갖게 된다.