잔차 연결(Residual Connection): ResNet vs GPT(Transformer) 완전 비교

깊은 신경망의 핵심 생명줄! Residual Connection의 개념과 활용법을 두 대표 모델로 이해해보자.

잔차 연결(Residual Connection)이란?

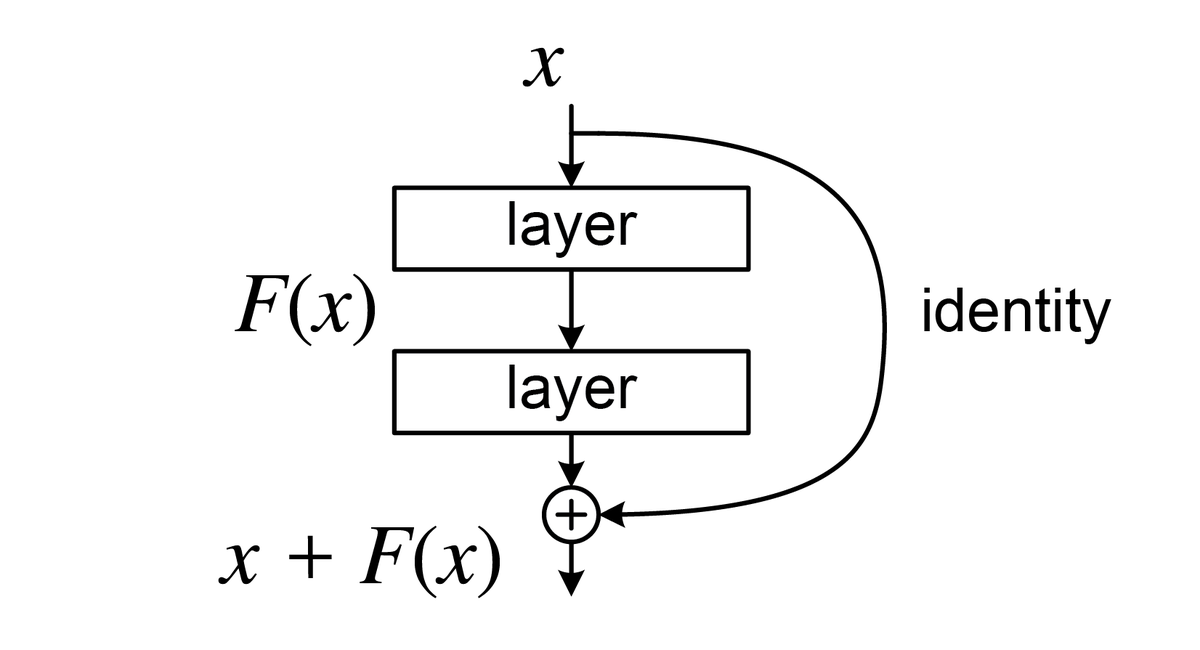

잔차 연결이란, 레이어의 입력을 출력과 더해서 다음 레이어로 넘기는 구조입니다.

이 방식은 정보 손실을 줄이고, 기울기 소실 문제를 완화해줍니다.

기본 구조 비교

일반 연결 방식

x → Layer → y잔차 연결 방식

x → Layer → F(x)

↘

F(x) + x → 다음 레이어즉, 레이어의 출력(F(x))과 입력(x)을 더해주는 방식입니다.

ResNet에서의 잔차 연결

ResNet(2015)은 CNN에 처음으로 잔차 연결을 도입한 대표적인 구조입니다.

왜 도입했을까?

- 딥러닝 모델이 깊어질수록 학습이 어려워짐

- 특히 기울기 소실 문제가 심각

- 입력을 더해주는 잔차 연결로 정보 흐름을 확보

- 덕분에 100개 이상의 레이어도 학습 가능해짐

수식 표현

- : 입력

- : 레이어의 학습 결과

GPT(Transformer)에서의 잔차 연결

GPT와 같은 Transformer 구조에서도 잔차 연결은 모든 서브 블록에 적용됩니다.

Transformer 블록 구조 예시

Input x

↓

LayerNorm

↓

Self-Attention → A

↓

(x + A) ← 잔차 연결 #1

↓

LayerNorm

↓

FeedForward → B

↓

(x + A) + B ← 잔차 연결 #2- 각각 Self-Attention과 FeedForward 블록에서 잔차 연결이 사용됩니다.

GPT에서 잔차 연결의 부작용과 해결책

Transformer는 ResNet보다 훨씬 더 깊은 네트워크입니다.

문제: 잔차 연결이 누적되면서 출력의 크기(값)가 커짐

해결: 잔차 연결에 쓰이는 가중치를 줄임

해결책: 스케일 조절 초기화

GPT 논문에서는 다음과 같이 제안합니다:

“잔차 연결에 사용되는 가중치를 로 초기화하자.”

- : 전체 residual 레이어 수 (예: 12, 24, 48 등)

- 이렇게 하면 출력의 폭주를 방지하고 안정적인 학습이 가능해집니다.

ResNet vs GPT(Transformer) 비교 정리

| 항목 | ResNet | GPT (Transformer) |

|---|---|---|

| 모델 구조 | CNN | Transformer |

| 잔차 연결 위치 | Conv 블록 사이 | Attention, FeedForward 블록 사이 |

| 도입 목적 | 깊은 CNN의 학습 안정화 | 깊은 Transformer의 누적 방지 |

| 부가 처리 | 없음 (단순 덧셈) | 가중치 초기화 조정 (1/√N로 스케일 다운) |

핵심 요약

- 잔차 연결은 입력 정보를 손실 없이 전달하여 학습 효율을 높이는 핵심 기술입니다.

- ResNet에서는 기울기 소실 방지가 목적이고, GPT에서는 출력 크기 폭주 방지가 핵심입니다.

- GPT 구조에서는 모든 블록마다 잔차 연결이 들어가며, 이에 따라 가중치 초기화 전략이 중요합니다.