udemy에서 학습한 내용 정리

Tensorflow

- 처음에 NN을 위한 것이 아님

- 그래프의 수학적 연산 목적으로 만들었음

- GPU를 이용한 연산 가능

- C++ 코드를 효율적으로 사용 가능

- tensor를 이용하여 그래프를 만듦

import tensorflow as tf

a = tf.Variable(1, name="a")

b = tf.Variable(2, name="b")

f = a + b #일반적 수학 연산이 아닌 그래프의 연산이 f에 저장, f는 a와 b의 관계 형성을 나타낸다

tf.print(f)Tensorflow에서 NN 만들기

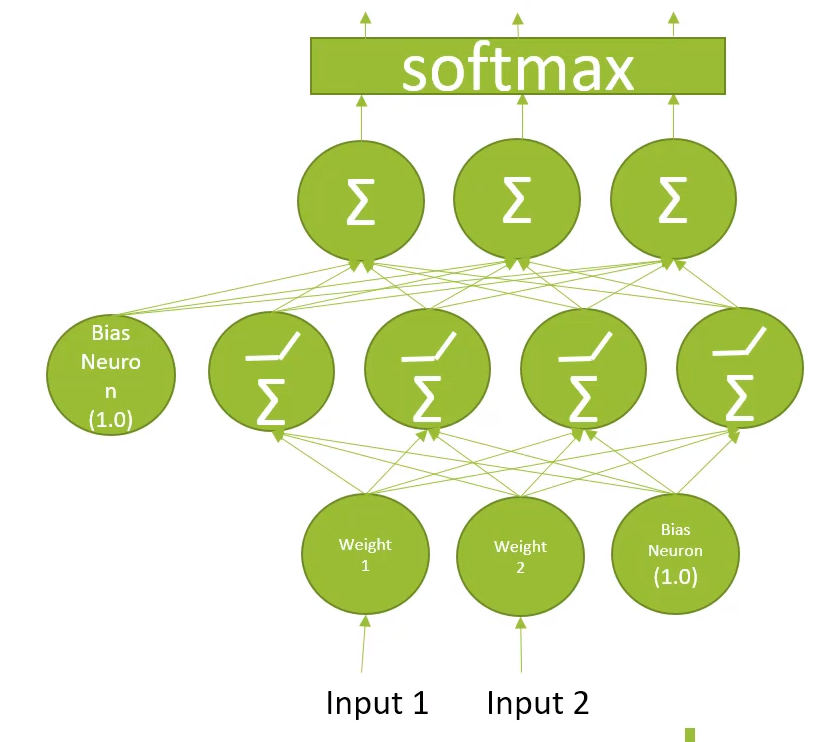

- 수학적 관점

- 모든 노드(뉴런)의 연결은 가중치의 곱으로 아주 큰 행렬의 연산과 같다

- bias는 행렬 곱의 결과에 더해진다

절차

- training, testing 데이터 load

- NN을 설명할 graph 구축

- 네트워크에 optimizer(gradient descent) 연관시키기

- training data를 이용하여 optimizer 실행

- testing data를 이용하여 훈련된 모델 평가

input data가 정규화(normalized)되어야 한다

- NN은 정규화된 입력 데이터에서 잘 작동한다

- 모든 입력 특성이 magnitude를 이용하여 비교가능해야 함

- scikit_learn을 통해 가능

Keras

- 쉽고 prototyping이 빠름

- 딥러닝을 위해 만들어짐

- scikit_learn을 이용함

- optimize에 대해 사용하기 쉬움