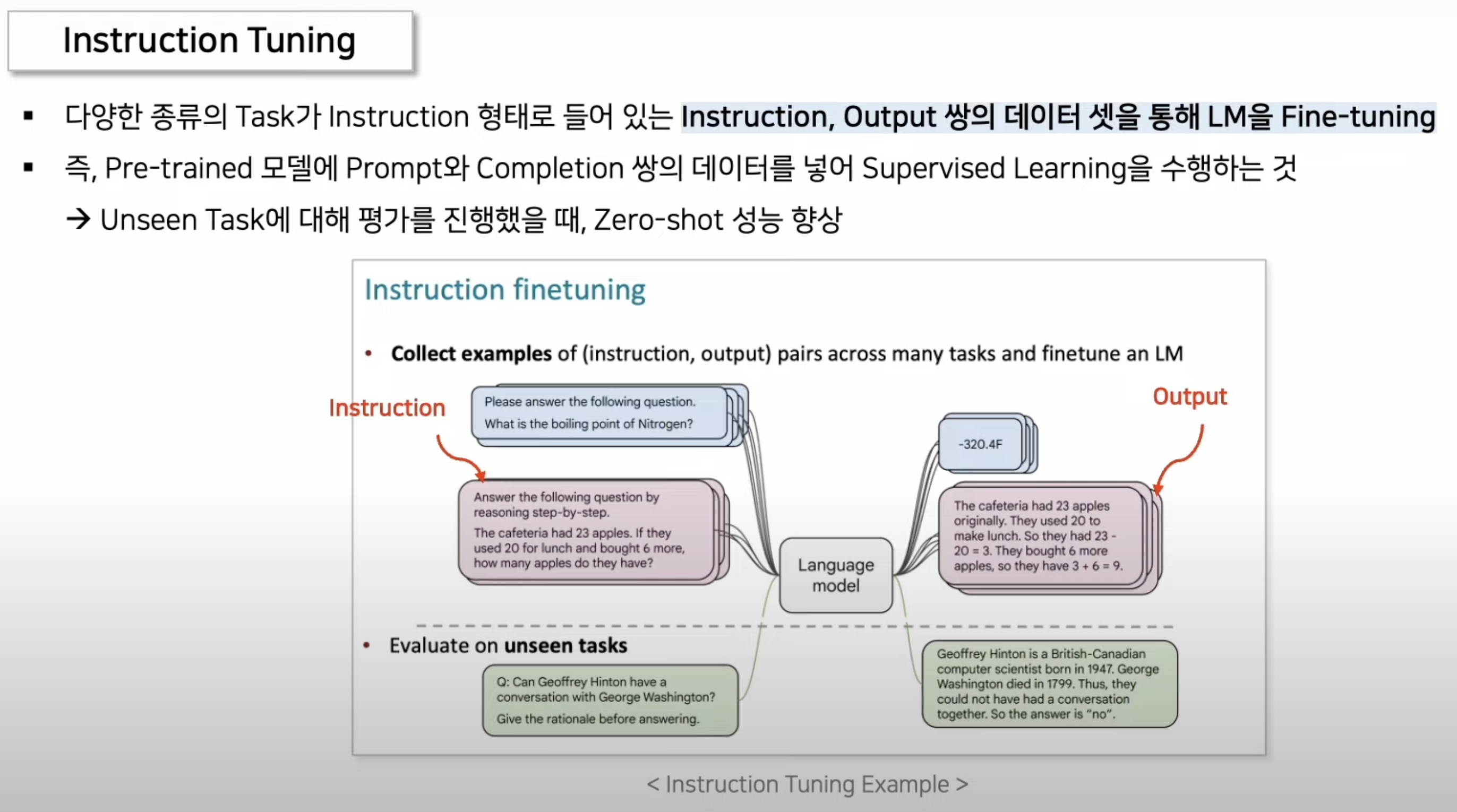

0.1. instruction Tuning? following?

- 이 기술은 모델이

주어진 지침을 정확히 이해하고,원하는 출력 또는 행동을 생성하도록 튜닝하는 과정에서 사용 - data pair 예시

<Instruction>- 다음 질문에 대해 단계별로 추론하여 답변하세요.

- 식당에 사과가 23개 있었습니다.

- 점심 식사를 위해 20개를 사용하고, 6개를 더 샀다면, 지금 사과는 몇 개인가요?

<Output>- 식당에는 원래 사과가 23개 있었습니다.

- 점심 식사를 위해 20개를 사용했습니다. 따라서 23 - 20 = 3개가 남았습니다.

- 그리고 사과를 6개 더 샀으니, 지금은 3 + 6 = 9개가 있습니다.

- 위 pair로 된 다양한 종류의 Task dataset을 통해, LM을 fine-tuning 하는 것이 instruction Tuning

- Instruction Tuning은 모델의 weight parameters를 업데이트하는 과정

- 그 결과, Unseen Task에 대한 성능 향상

- Q:

- Geoffrey Hinton이 George Washington과 대화를 나눌 수 있을까요?

- 답변 전에 이유를 설명하세요.

- A:

- Geoffrey Hinton은 1947년에 태어난 영국-캐나다의 컴퓨터 과학자입니다.

- George Washington은 1799년에 사망했습니다.

- 따라서 그들이 서로 대화를 나눌 수는 없었습니다. 그래서 답은 "아니요"입니다.

- Q:

- instruction Tuning의 장점

간단(Simple)하고 직관적(Straightforward)인 방법을 통해 높은 성능 향상을 냄- Unseen Task까지 Generalize 할 수 있음 (

제로샷 성능 향상)

- Instruction Tuning의 단점

- 너무 많은 Task에 대한 Demonstration을 수집하는 데 많은 비용이 듦

- but, GPT로 데이터 만들 수 있음!!

- LM의 Objective와 사람의 Preference 사이의 Mismatch가 있음

- 그럴 듯한 거짓말을 하는 등의 Hallucination 문제 발생

- Hallucination 문제를 보정해주기 위해 RLHF(Reinforcement Learning from Human Feedback) 방법론 등장

- https://velog.io/@hsbc/RLHF-Reinforcement-Learning-with-Human-Feedback

- 너무 많은 Task에 대한 Demonstration을 수집하는 데 많은 비용이 듦

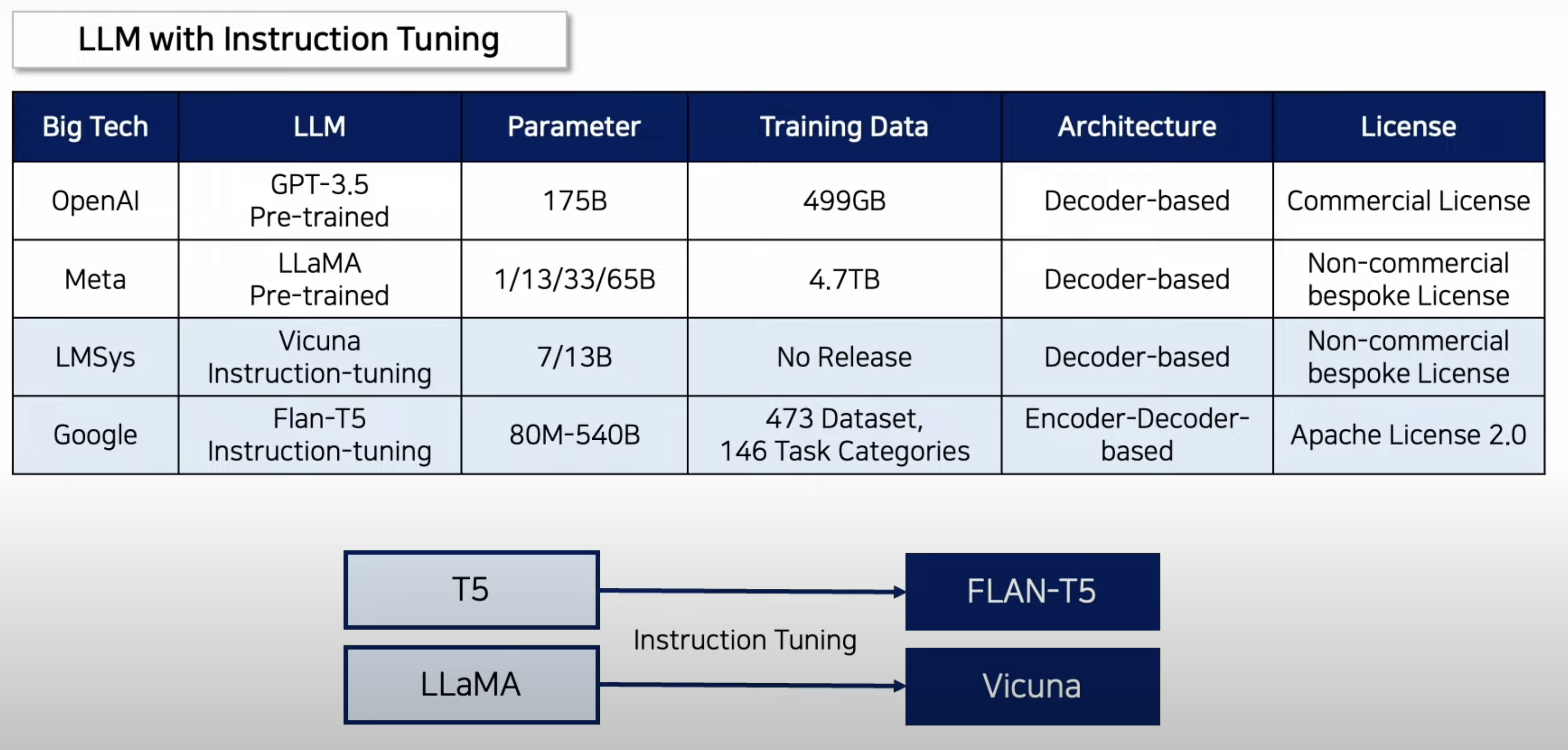

0.2. LLM with instruction Tuning?

- 용어 정의:

machine-generated instruction-following data:- 기계(예: GPT-4)가 생성한 지시와 그에 따른 응답 데이터

- 예

- 지시: "다음 문장을 감정 분석해라:

오늘 날씨가 정말 좋아서 기분이 좋다." - 응답: "긍정적인 감정"

- 지시: "다음 문장을 감정 분석해라:

machine-generated instruction-following data를 사용하여 대형 언어 모델(LLMs)을Instruction tuning하면- 새로운 작업에 대한 제로샷 능력을 향상시킬 수 있지만,

- 멀티모달 분야(VLM)에서는 이러한 아이디어가 덜 탐구되었음