트랜스포머

1.다시 인공지능 공부 할 시간

2019년 때만 해도인공지능을 구현만 해도 취직이 되었고 사람들이 놀라워 했다.그러나, 현재는 아니다5년이라는 시간이 지났다.이제 모두가 안다.모델은 만든 사람들이 천재이지구현을 하는 사람은 아니라는 걸그래서 데이터가 중요한 것이지 모델링 자체는 필요 없다는 걸왜냐하면

2.유튜브로 트랜스포머 겉핥기

MIT 101매우 high level로 설명해서 이해하는데 매우 쉬움트랜스포퍼에 대한 큰 픽쳐 만들어 줄 수 있다.Standford트랜스포퍼가 탄생한 배경에 대해 알려주고 시작하여, 왜 이렇게 발전 했지를 알려줌허민석 설명듣고 있으면 이해하는 듯 보이나, 실제로 알아들

3.금융에 트랜스포머는 적용 불가

트랜스포머를 적용 할 수 있는 분야는 쉽게 repeat 가능 한 분야 이다. 그러나 금융 분야는 그렇지 않다. 과거 데이터로 과거와 미래를 나눌 수는 있는데 미래를 그릴 수는 없다. 왜냐하면 미래가 과거 데이터에 비추어 볼 때 매우 어긋나는 일들이 많기 때문이다. 예를

4.트랜스포머 중요한 틀

트랜스포머, 파인튜닝, 전이 학습 = 다시 '답'을 어떠한 형태로 넣을 것인가

5.attention 과 self-attention 차이 예제로 요약

task주어진 영어 문장을 한국어로 번역 하시요.inputthe cat didn't cross the street.답그 고양이는 길을 건너지 않았다.attention"the cat" = "고양이"와 연관성self-attention"the"와 "cat"의 연관성

6.Query, Key, Value Weights

Observed Datay, x2, 43, 64, 8x = weightx can be a vectorTrained Weight = 2y = 2xwhenever there's a vector and y, you can use A.I. or in other words yo

7.Add & Norm 블록에 왜 두개의 input 브랜치가 필요한가

Gradient Normalization(Norm):Gradient normalization rescales the gradients to have a fixed norm, such as unit norm or a desired norm. This can prevent

8.multi-head Attention의 필요성

context를 더 많이 담기 위해.각 attention 마다 다른 context를 담을 수 있음.즉 더 많은 정보를 담기 위해.예) "I gave my dog Charlie some food"attention 1 = gave -> Iattention 2 = gave

9.추천 - 쉬운 트랜스포머 관련 책

나는 답을 봐야 빨리 이해 한다.그래서 어떻게 하면 transformer를 여러 분야에 적용 할 수 있고 쉽게 적용 가능 한지 알고 싶었다.운좋게도 그런 책을 찾았다.트랜스포머 with 파이토치예전에는 text의 감정을 분류 하려면 유/무료로 api를 써야 했다. 파인

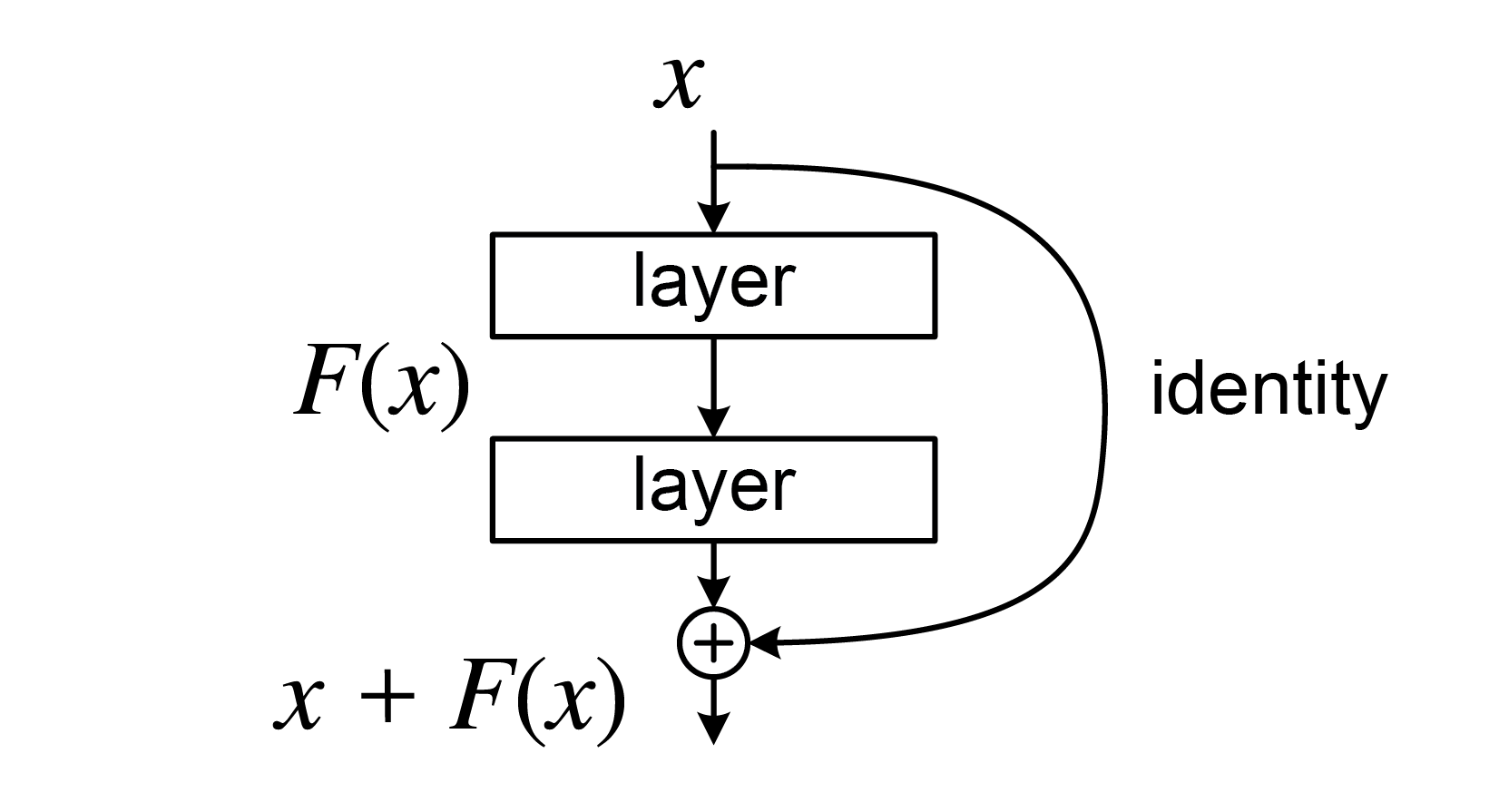

10.Residual Block in ResNet, identity connection in PyTorch

코드 출처중여기서 shortcut은 그림에서identity connection을 의미한다.element wise addition을 하려면 차원의 동일해야 되니,을 넣는 것 이다.stride가 2이상일 경우는 크기가 축소 될 것 이고input(in_planes)과 ou

11.ResNet 차원을 늘리고 줄이는 이유

중에서 input_planes가 16,32,64 로 바뀌는 이유는...ResNet 아키텍처에서 평면(채널) 수의 변경은 사용되는 특정 ResNet 변형에 기반합니다. 일반적으로, 한 "레이어"에서 다음으로 넘어갈 때 평면 수가 증가합니다. 예를 들어, ResNet-34