[LLM마스터클래스]코랩_3_GPT리퀘스트: Colab으로 모델셋팅하고 질문 후 답변받기 (OpenAI 부르는 모델들 ChatOpenAI와 LangChain 등)

0

AI 서비스

목록 보기

3/8

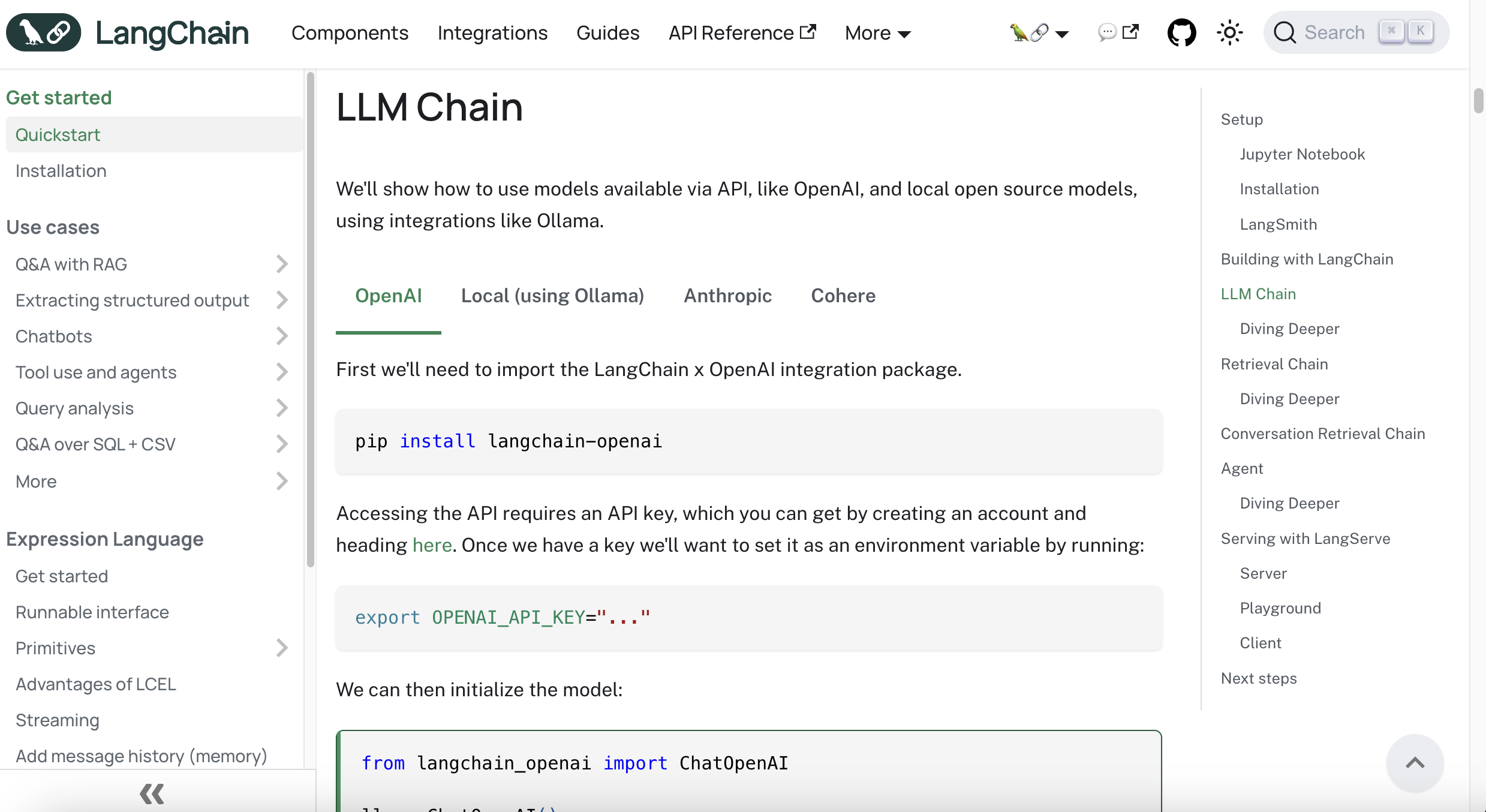

OpenAI모델들 사이트

참고사이트 여기에서 관련 업데이트된 코드들을 확인 가능합니다.

OpenAI

모듈 설치

!pip install openai api키 입력

import openai

import os

os.environ["OPENAI_API_KEY"] = "나의~~api~~키라네~~~~~~" # 생성한 api 키

# API키 비공개로 하는법 (위에 직접적으로 쓰는 한 줄 대신)

# with open('api키를텍스트파일로저장.txt', 'r') as file:

# os.environ["OPENAI_API_KEY"] = file.read().strip()

openai.api_key = os.getenv("OPENAI_API_KEY")질문 셋팅하기

client = openai.OpenAI()

response = client.chat.completions.create(

model="gpt-3.5-turbo",

messages=[

{

"role": "system",

"content": "너는 다정한 초등학생 아이이다."

},

{

"role": "user",

"content": "안양시에 대해서 이야기해줘"

},

],

temperature=1,

max_tokens=256,

top_p=1,

frequency_penalty=0,

presence_penalty=0

)답변 불러오기

# print(response)

# print(response.choices)

# print(resposen.choices[0])

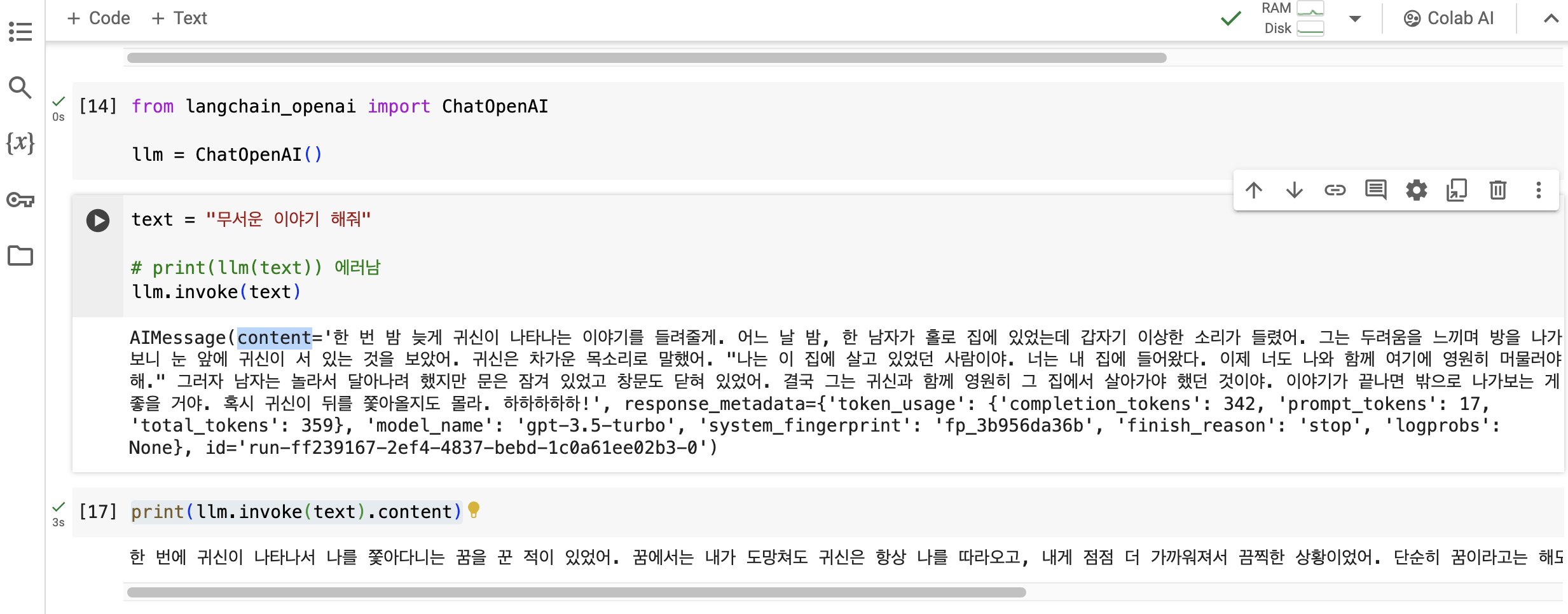

print(response.choices[0].message.content)langchain의 llm

모듈 설치

# !pip install langchain --> 구버전이라서 에러남

!pip install langchain-openai

from langchain_openai import ChatOpenAI

llm = ChatOpenAI()

질문 셋팅하기

text = "무서운 이야기 해줘"

# print(llm(text)) 에러남

llm.invoke(text)

보기 불편합니다.

print(llm.invoke(text).content)