AI

1.생성형 AI 서비스 활용하기

생성형 AI의 생태계 구조는 위 그림과 같다. 보통 개인이나 규모가 작은 회사는 기존에 만들어진 AI 를 활용한 서비스를 만드는 것이다. 그럼 잘 활용해 봐야겠지 ? ChatGPT OpenAPI를 사용해 보겠다. ChatGPT OpenAPI 사용하기 > http

2.LangChain

LLM 을 활용해서 애플리케이션을 효율적으로 개발할 수 있게 해주는 Python 라이브러리다.OpenAI랑 뭐가 다르냐 ?OpenAI 보다 좀 더 상세한 기능들이 가능한 것 같다.OpenAi는 기본적인 텍스트를 받아오거나 단순한 API를 호출하는 것이 다라면,LangC

3.LangChain - Cache

LLM 을 사용하다 보면, 같은 질문에 대해서도 계속 해서 요청을 보내면서 시간이 오래 걸리는 경우가 발생한다. 이런 경우들을 방지하기 위해서 Cache 기능을 사용할 수 있다. 여러 실습 예제를 통해서 알아보자우선 LangChain 의 InMemoryCache 가 있

4.LangChain - PromptTemplate

.

5.LangChain - ChatPromptTemplate

이전에 단일 문장에 대한 템플릿을 만드는 PromptTemplate 에 대해서 알아봤다.이번 포스트에서는 메시지 목록 을 입력받는 ChatPromptTemplate에 대해서 알아보겠다.각 메시지의 역할이 구분되어야 할 때 사용한다. 메시지는 system, user, a

6.LangChain - PipeLine

이번 글에서는 여러 개의 템플릿을 조합해 하나의 최종 프롬프트를 만드는 PipelinePromptTemplate을 실습해보겠다.뉴스나 정보성 텍스트를 요약하고 다시 스타일을 바꾸는 등 여러 단계를 거쳐야 할 때프롬프트를 논리적으로 분리하고 구성하고 싶을 때프롬프트의 재

7.LangChain - Partial

LangChain에서는 PromptTemplate이나 ChatPromptTemplate을 사용할 때일부 입력 변수만 미리 고정시켜 재사용성을 높일 수 있다.이때 사용하는 기능이 바로 partial()이다.자주 반복되는 값을 매번 입력하지 않고 미리 고정시켜 놓고 싶을

8.LangChain - Output parser

LangChain의 OutputParser는 LLM의 응답을 원하는 형식으로 후처리해주는 도구다.LLM은 기본적으로 텍스트를 출력하지만, 우리는 그 결과를 JSON, 숫자, 리스트 등으로 바꿔서 활용해야 하는 경우가 많다.이럴 때 OutputParser를 사용한다.LL

9.LangChain - LCEL

To be Continue...

10.LangChain - RAG

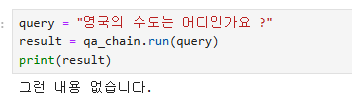

RAG 란 AI 가 외부 지식을 검색하고 접근할 수 있도록 문서를 불러오고 그걸 기반으로 답변을 생성하는 방식을 말한다.만약, A 라는 기업에 다니고 있다고 가정해 보자.A라는 기업에서 제공하고 있는 상품에 대해서 사용자에게 답변을 해주어야 하는데, A의 경쟁사인 B

11.Hugging Face 사용해보기

.

12.LLAMA 사용해보기

.