1주차 때 한 일들

논문 읽기

Metric 관련

- Reference and Document Aware Semantic Evaluation Methods for Korean Language Summarization

- Sentence-BERT: Sentence Embeddings using Siamese BERT-Networks

- SBERT 관련 논문

- RDASS Metric을 위해 읽음

Dialogue Summarization

- A Survey on Dialogue Summarization: Recent Advances and New Frontiers

- Survey of Dialogue Summarization

- Controllable abstractive dialogue summarization with sketch supervision

- Survey에서 SOTA를 달성한 Model이여서 한 번 읽어봄

- Survey에서 Pre-trained Model을 활용한 논문은 한 번 씩 읽어봄

Dialogue Summarization 적용해보기

과정

- 영어에 Dialogue Summarization을 적용해보고, 만약 잘 요약이 되지 않는다면 Project 주제를 바꾸기로 함

- SAMSum 데이터를 활용했고, Pretrained Model로는 BART를 활용함

- BART를 활용한 이유 : 현재 Dialogue Summarization 중 Abstractive Summarization Task에서는 BART를 Base Model로 하는 분위기이고, 우리는 Output을 Text2Image Model에 전달해야하는데 문장 형식인 것이 더 좋기 때문에 BART를 활용

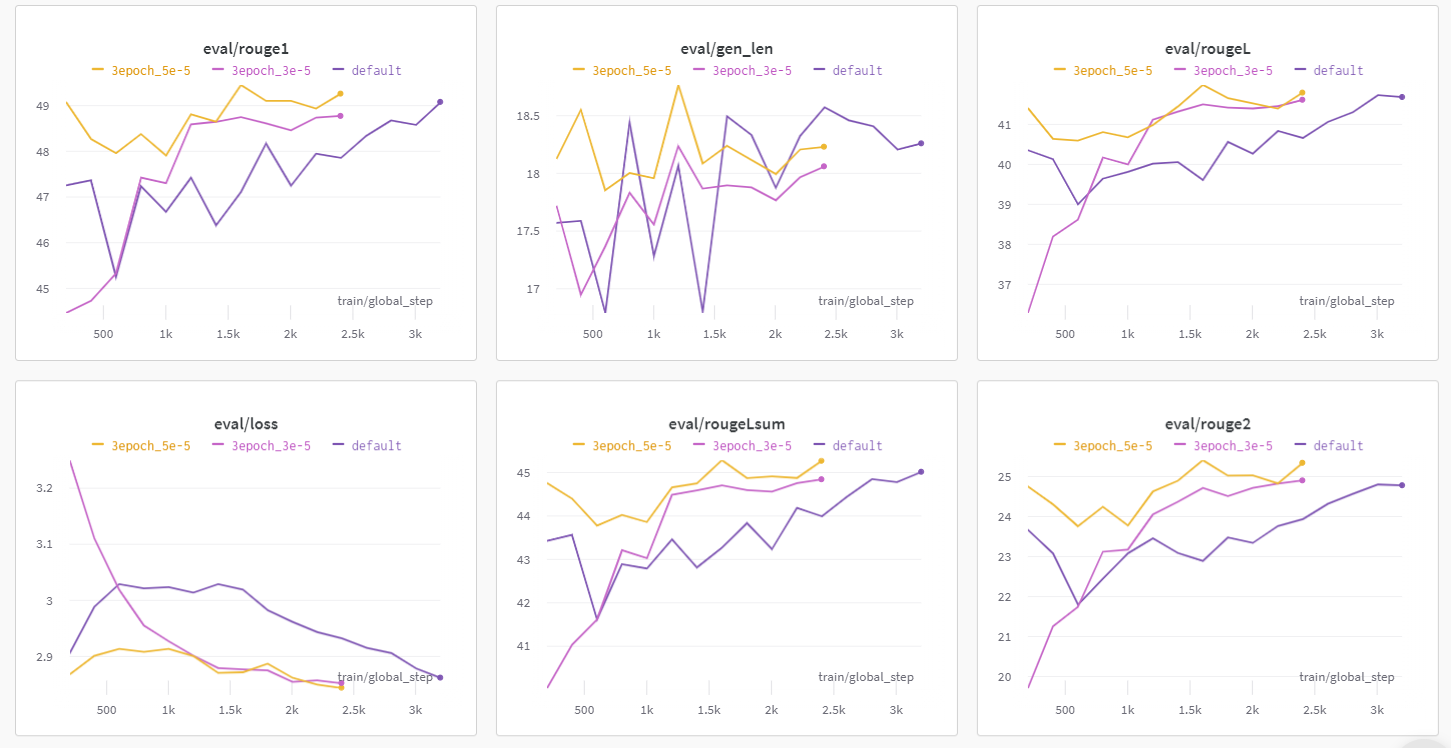

결과

- 논문에서 밝힌 Rouge의 SOTA가 50점 정도이기 때문에, 이 정도의 Rouge 점수를 내는 모델이라면 충분히 활용 가능하다고 판단

- 이번 프로젝트 주제를 그대로 Fix하기로 결정함

정리

사실 1주차 때는 강의 듣고 논문을 읽는 것에 많은 시간을 두어 따로 정리할 필요성을 느끼지는 못했다.

또한 SAMSum 데이터로 Dialogue Summarization을 수행하는 것도 주말에 코드를 짰기 때문에 사실 따로 정리하기가 애매했다.

따라서, 1주차에 수행한 모든 것들을 그냥 한 번에 정리했다.